[问题][已解决] 并发场景下 "mysql: too many connections" 原因

问题出现是这样的,用node写爬虫, 之前每条数据都是await插入,并且是阻塞的,后来改成了非阻塞,可以并行插入操作,结果一直找不到原因。

后来在日志中找到了 too many connections,分析如下:

用nodejs写爬虫的时候,使用了类似这样的函数

let conn = null;

try{

conn = await pool.getConnection();

await conn.begin()

let rst = await .conn.query('xxxx',params);

// 处理rst

...

await conn.commit()

}catch(e){

if(conn) await conn.rollback();

}finally{

if(conn) await conn.release();

}

乍一看没有问题,执行爬虫之后,我会调用这段代码把分析过的数据存在数据库里。

但是由于我是使用非阻塞的形式进行抓取数据的,如下

emitter.on('url_found', async (url)=>{

// 请求url地址,获取返回的response body

let res = await request(url);

// 处理res

...

// 后面调用上面的第一段代码

})

这里会发生一件事,就是可能同时触发了1000个这样的事件,然后一起获取链接,但是还没有释放,然后报错: too many connections

============================ 解决方案 ===============================

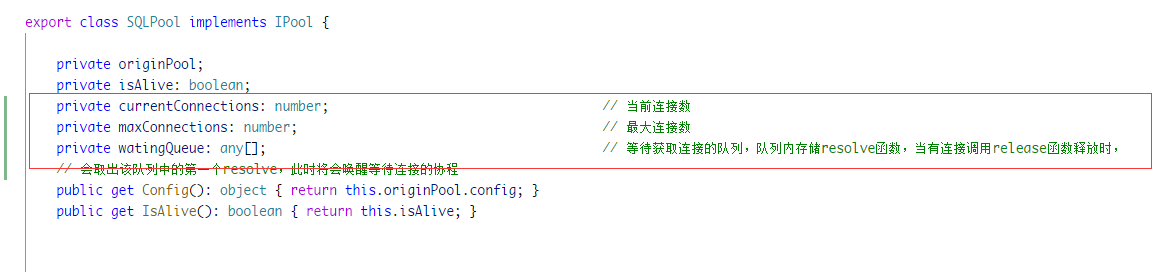

改造获取sql连接的函数

1. 判断当前连接数是否达到最大,如果否,则直接返回连接池内连接,连接数++

2. 如果上述判断为true,则等待一个promise,将该promise的resolve函数推入等待队列

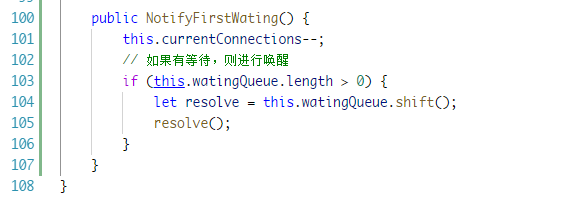

3. 当某一个连接release的时候,连接数--

4. release中调用pool的notifyFirstWaiting方法,每次取出队列第一个resolve并执行,然后该resolve出列

5. 第二步中的promise的resolve被执行后,则会执行后续代码,此时等待的promise被唤醒,尝试重新获取连接返回

[问题][已解决] 并发场景下 "mysql: too many connections" 原因的更多相关文章

- 【已解决】Windows下 MySQL大小写敏感 解决方案及分析

Windows下 MySQL大小写敏感配置 zoerywzhou@163.com http://www.cnblogs.com/swje/ 作者:Zhouwan 2017-3-27 最近在window ...

- 【转】记录PHP、MySQL在高并发场景下产生的一次事故

看了一篇网友日志,感觉工作中值得借鉴,原文如下: 事故描述 在一次项目中,上线了一新功能之后,陆陆续续的有客服向我们反应,有用户的个别道具数量高达42亿,但是当时一直没有到证据表示这是,确实存在,并且 ...

- 秒杀场景下MySQL的低效(转)

秒杀场景下MySQL的低效 2016-01-14 17:12 178人阅读 评论(0) 收藏 举报 最近业务试水电商,接了一个秒杀的活.之前经常看到淘宝的同行们讨论秒杀,讨论电商,这次终于轮到我们自己 ...

- 【转载】秒杀场景下MySQL的低效原因和改进以及Redis的处理

分享的PPT在如下网址: http://www.doc88.com/p-4199037770087.html 秒杀场景下mysql的低效原因和改进 另外有一个篇文章是针对以上内容的总结: http:/ ...

- C++高并发场景下读多写少的解决方案

C++高并发场景下读多写少的解决方案 概述 一谈到高并发的解决方案,往往能想到模块水平拆分.数据库读写分离.分库分表,加缓存.加mq等,这些都是从系统架构上解决.单模块作为系统的组成单元,其性能好坏也 ...

- C++高并发场景下读多写少的优化方案

概述 一谈到高并发的优化方案,往往能想到模块水平拆分.数据库读写分离.分库分表,加缓存.加mq等,这些都是从系统架构上解决.单模块作为系统的组成单元,其性能好坏也能很大的影响整体性能,本文从单模块下读 ...

- Qunar机票技术部就有一个全年很关键的一个指标:搜索缓存命中率,当时已经做到了>99.7%。再往后,每提高0.1%,优化难度成指数级增长了。哪怕是千分之一,也直接影响用户体验,影响每天上万张机票的销售额。 在高并发场景下,提供了保证线程安全的对象、方法。比如经典的ConcurrentHashMap,它比起HashMap,有更小粒度的锁,并发读写性能更好。线程安全的StringBuilder取代S

Qunar机票技术部就有一个全年很关键的一个指标:搜索缓存命中率,当时已经做到了>99.7%.再往后,每提高0.1%,优化难度成指数级增长了.哪怕是千分之一,也直接影响用户体验,影响每天上万张机 ...

- HashMap在并发场景下踩过的坑

本文来自网易云社区 作者:张伟 关于HashMap在并发场景下的问题有很多人,很多公司遇到过!也很多人总结过,我们很多时候都认为这样都坑距离自己很远,自己一定不会掉入这样都坑.可是我们随时都有就遇到了 ...

- 高并发场景下System.currentTimeMillis()的性能问题的优化 以及SnowFlakeIdWorker高性能ID生成器

package xxx; import java.sql.Timestamp; import java.util.concurrent.*; import java.util.concurrent.a ...

随机推荐

- error: expected '=', ',', ';', 'asm' or '__attribute__' before '{' token

头文件函数声明少了“:(分号)”

- 项目Alpha冲刺(团队8/10)

项目Alpha冲刺(团队8/10) 团队名称: 云打印 作业要求: 项目Alpha冲刺(团队) 作业目标: 完成项目Alpha版本 团队队员 队员学号 队员姓名 个人博客地址 备注 221600412 ...

- xcode编译 debug版或release 版

编译debug版本或release 版本 在Run和Stop按钮的右边有一个工程名 点击工程名,选择Manage Schemes 选择Edit... 左侧选择Run ProjectName.app 右 ...

- Java中的常用异常处理方法

觉得自己是一个Java专家吗?是否肯定自己已经全面掌握了Java的异常处理机制?在下面这段代码中,你能够迅速找出异常处理的六个问题吗? 1 OutputStreamWriter out = ... 2 ...

- hadoop mapred和mapreduce包

mapred包是老的1.0的map reduce api mapreduce包是新的2.0的map reduce api

- gcc 头文件是用户应用程序和函数库之间的桥梁和纽带 功能的真正逻辑实现是以硬件层为基础

gcc GCC, the GNU Compiler Collection - GNU Project - Free Software Foundation (FSF) http://gcc.gnu.o ...

- Codeforces Round #254 (Div. 2):B. DZY Loves Chemistry

B. DZY Loves Chemistry time limit per test 1 second memory limit per test 256 megabytes input standa ...

- java 监听文件或者文件夹变化的几种方式

1.log4j的实现的文件内容变化监听 package com.jp.filemonitor; import org.apache.log4j.helpers.FileWatchdog; public ...

- bootstrap的学习注意点

1.bootstrop里面所有的内容都需要用一个container 容器包裹起来: 2.一屏二屏什么的,是通过id 与href实现的: 3.下拉与菜单之类的都有固定的代码: 4.需要修改相关属性的话, ...

- android adb源码分析(5)【转】

本文转载自:http://blog.csdn.net/xgbing/article/details/52096880 本篇以“adb devices"命令为例,跟踪代码的执行流程. (1) ...