pandas中DataFrame和Series的数据去重

在SQL语言中去重是一件相当简单的事情,面对一个表(也可以称之为DataFrame)我们对数据进行去重只需要GROUP BY 就好。

select custId,applyNo from tmp.online_service_startloan group by custId,applyNo

1.DataFrame去重

但是对于pandas的DataFrame格式就比较麻烦,我看了其他博客优化了如下三种方案。

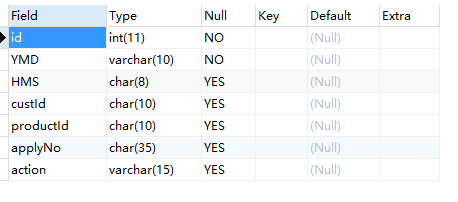

我们先引入数据集:

import pandas as pd

data=pd.read_csv(r'D:/home/nohup.out.20191028.startloan.csv',encoding='utf-8')

print(data.info())

共有14936条数据,那我们还是按 custId和applyNo去重。

1.使用list后手写去重

定义去重函数:我这里使用了遍历行,添加列表的的方式去重。

# 定义去重函数

def dropRep(df):

list2=[]

for _,i in df.iterrows():

i=list(i)

if i not in list2:

list2.append(i)

return list2

keydata=data[['custId','applyNo']]

len1=keydata.count()

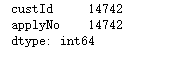

print('去重之前custId +applyNo:',len1) list2=dropRep(keydata)

print('去重之后custId +applyNo:',len(list2))

2.使用list后set去重

用set去重其实遇到了很多问题,set里面的数据必须是不可变数据类型,可hash等等。。所以只能把key1+key2拼成字符串作为一个元素。

# 定义去重函数

def dropRepBySet(df):

set1=set()

for _,i in df.iterrows():

set1.add("_".join(list(map(lambda x:str(x),list(i)))))

return list(set1)

而且明显感觉这个方法比上面手写list遍历去重快一些

keydata=data[['custId','applyNo']]

len1=keydata.count()

print('去重之前custId +applyNo:',len1) list2=dropRepBySet(keydata) print('去重之后custId +applyNo:',len(list2))

3.使用pd.DataFrame自带drop_duplicates()函数去重

DataFrame.drop_duplicates(subset=None, keep='first', inplace=False)

- subset : column label or sequence of labels, optional

用来指定特定的列,默认所有列

- keep : {‘first’, ‘last’, False}, default ‘first’

first删除重复项并保留第一次出现的项,last删除重复保留最后一条,False就是删除重复、只要不重复的数据

- inplace : boolean, default False

是直接在原来数据上修改还是保留一个副本

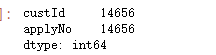

keydata.drop_duplicates().count()

keydata.drop_duplicates(keep=False).count()

补充提取重复数据

# 剔除重复的数据

data1=keydata.drop_duplicates(keep=False)

data1.count()

#至少保留一条

data2=keydata.drop_duplicates(keep="first")

data2.count()

#这样正常的数据就重复了,重复的数据就只有一条

data1.append(data2).drop_duplicates(keep=False).count()

2.Series去重

我也是最近才遇到series去重这个场景,比较了一下两种去重的性能比较。

场景如下

sql==>pd.dataframe【数据量为8000rows】==>取出这个df的cust_id字段【series】==>转为list===>下一个sql:'''···where cust_id not in (%s)'''%".".join(list)

方法1:

方法2:seiries.drop_duplicates()

pandas中DataFrame和Series的数据去重的更多相关文章

- Spark与Pandas中DataFrame对比

Pandas Spark 工作方式 单机single machine tool,没有并行机制parallelism不支持Hadoop,处理大量数据有瓶颈 分布式并行计算框架,内建并行机制paral ...

- Spark与Pandas中DataFrame对比(详细)

Pandas Spark 工作方式 单机single machine tool,没有并行机制parallelism不支持Hadoop,处理大量数据有瓶颈 分布式并行计算框架,内建并行机制paral ...

- Pandas中DataFrame修改列名

Pandas中DataFrame修改列名:使用 rename df = pd.read_csv('I:/Papers/consumer/codeandpaper/TmallData/result01- ...

- pandas中DataFrame的ix,loc,iloc索引方式的异同

pandas中DataFrame的ix,loc,iloc索引方式的异同 1.loc: 按照标签索引,范围包括start和end 2.iloc: 在位置上进行索引,不包括end 3.ix: 先在inde ...

- pandas中DataFrame重置设置索引

在pandas中,经常对数据进行处理 而导致数据索引顺序混乱,从而影响数据读取.插入等. 小笔总结了以下几种重置索引的方法: import pandas as pd import numpy as n ...

- pandas中DataFrame对象to_csv()方法中的encoding参数

当使用pd.read_csv()方法读取csv格式文件的时候,常常会因为csv文件中带有中文字符而产生字符编码错误,造成读取文件错误,在这个时候,我们可以尝试将pd.read_csv()函数的enco ...

- Pandas中DataFrame数据合并、连接(concat、merge、join)之merge

二.merge:通过键拼接列 类似于关系型数据库的连接方式,可以根据一个或多个键将不同的DatFrame连接起来. 该函数的典型应用场景是,针对同一个主键存在两张不同字段的表,根据主键整合到一张表里面 ...

- Pandas中DataFrame数据合并、连接(concat、merge、join)之join

pandas.DataFrame.join 自己弄了很久,一看官网.感觉自己宛如智障.不要脸了,直接抄 DataFrame.join(other, on=None, how='left', lsuff ...

- Pandas中DataFrame数据合并、连接(concat、merge、join)之concat

一.concat:沿着一条轴,将多个对象堆叠到一起 concat(objs, axis=0, join='outer', join_axes=None, ignore_index=False, key ...

随机推荐

- mysql 监听ip地址修改

如何修改MySQL监听IP地址 Mysql默认在本地环路地址127.0.0.1的3306端口监听,要使用其它IP地址需要修改配置文件. 1.编辑/etc/my.cnf 在[mysqld]节中增加下面一 ...

- HDU 6470 【矩阵快速幂】

题目链接:http://acm.hdu.edu.cn/showproblem.php?pid=6470 写这道题是为了让自己不要忘记矩阵快速幂如何推出矩阵式子的. 注意 代码是TLE的!! #incl ...

- spring cloud微服务docker启动

1. 背景 将系统拆分成微服务,一个系统可能拆分成十几个服务,服务太多会影响发布和管理,所以容器话之后易于管理和版本发布,鉴于此将spring cloud微服无docker容器化. 2.依赖环境 Ce ...

- 如何使用RedisTemplate访问Redis数据结构之字符串操作

Redis 数据结构简介 Redis 可以存储键与5种不同数据结构类型之间的映射,这5种数据结构类型分别为String(字符串).List(列表).Set(集合).Hash(散列)和 Zset(有序集 ...

- 2.1spring cloud 环境配置

前提:SpringBoot可以离开SpringCloud独立使用开发项目,但是SpringCloud离不开SpringBoot,属于依赖的关系. 所以基本是搭建SpringBoot + 组件 = Sp ...

- 用JavaScript写一个简单的倒计时,可以应用在发送短信验证码的“59秒后重新发送验证短信”

倒计时——从10倒数到0,点击按钮会还原倒计时 <body> <!-- 将textvalue值设为10,从10倒数 --> <input type="text& ...

- cygwin gcc 编译windowsAPI 报错的一个解决方案

一开始按照linux的习惯去编译一个使用了windowsAPI的程序 结果提示: $ i686-pc-cygwin-g++ screen_catch.cscreen_catch.c: In funct ...

- Asp.net core 学习笔记 Node Service

我们知道 npm 是很大的库,很多轮子可以用 所以 .net core 替我们封装了一个调用 nodejs 的 service 就叫 node service 我们只要在 server 安装 node ...

- sentinel与hystrix对比

近期有同事再提要不要使用sentinel.所以我就对现在已经用hystrix.先看两者的线程模型.大部分对比项是sentinel开源工程对比的,本人做了一些修改以及增加了一些对比项和说明. 从线程模型 ...

- Python中异常打印——面向程序猿

import logging # logging.disable(logging.CRITICAL) logging.basicConfig(filename="loggingBug.txt ...