强化学习复习笔记 - DEEP

Outline

使用逼近器的特点:

较少数量的参数表达复杂的函数 (计算复杂度)

对一个权重的调整可以影响到很多的点 (泛化能力)

多种特征表示和逼近器结构 (多样性)

激活函数

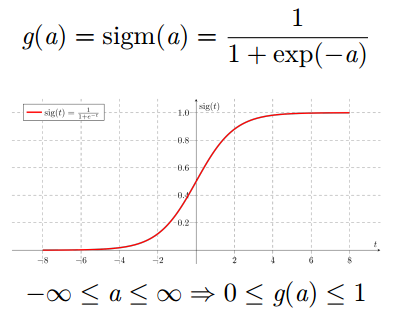

Sigmoid 激活函数

将神经元的输出压缩在 0 和 1 之间

永远都是正数

有界

严格递增

tanh 双曲正切函数

将神经元的输出压缩在

-1 和 1 之间

有正有负

有界

严格递增

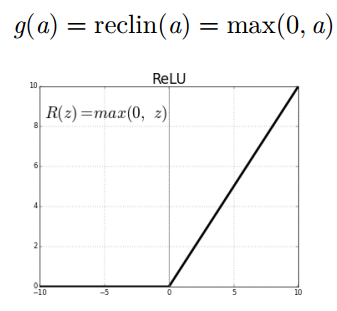

线性整流 (Rectified Linear Unit, ReLU) 激活函数

以 0 作为下界 (永远都是非负的)

容易让神经元产生稀疏的激活行为

无上界

严格递增

通用近似定理 (Hornik, 1991)

“如果一个前馈神经网络具有线性输出层和至少一层隐藏层, 只要给予网络足够数量的神经元,便可以实现以足够高精度来逼近任意一个在 Rn 的紧子集 (Compact subset) 上的连续函数。 ”

定理适用于 sigmoid, tanh, 和其它激活函数

但是定理并不代表一定存在某个学习算法, 能够找到具有满足近似性能的参数

置信风险: 分类器对 未知样本进行分类,得到的误差。

经验风险: 训练好的分类器,对训练样本重新分类得到的误差。即样本误差

结构风险:置信风险 + 经验风险

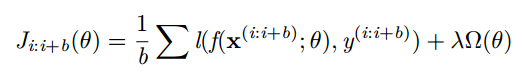

小批量 Mini-batch 梯度下降

更新是基于一组小批量的样本 {(x(i:i+b); y(i:i+b))}(不再是单 一样本)

梯度对应于正则化损失在小批量样本上的平均

可以得到对梯度更加精确的估计

可以使用矩阵运算, 计算效率更高

在训练集 Dtrain上训练你的模型

在验证集 Dvalid上选择模型

-----包括选择超参; 隐含层尺寸; 学习率; 迭代/训练次数; 等等

在测试集 Dtext上评估泛化能力

泛化的含义是模型在未见过的样本上的表现

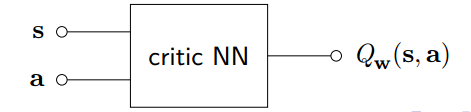

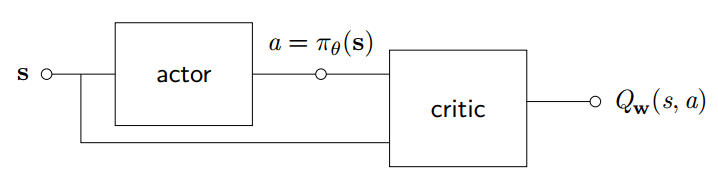

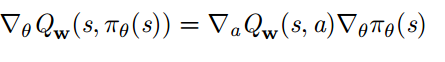

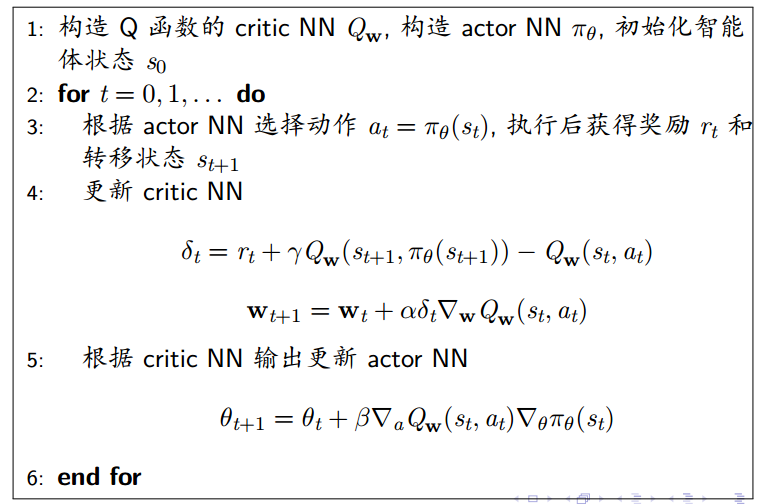

确定性 Actor-Critic

对于确定性策略, 可以使用神经网络逼近器构建 actor, 直接输出策略确定性的动作

设计另一个神经网络构造 Critic 用于逼近 Q 函数

对 Critic NN 可以使用例如 TD 学习算法训练网络权重

对 Actor NN 希望能够输出最优动作使得 Q 函数最大化

强化学习复习笔记 - DEEP的更多相关文章

- 强化学习读书笔记 - 02 - 多臂老O虎O机问题

# 强化学习读书笔记 - 02 - 多臂老O虎O机问题 学习笔记: [Reinforcement Learning: An Introduction, Richard S. Sutton and An ...

- 强化学习读书笔记 - 05 - 蒙特卡洛方法(Monte Carlo Methods)

强化学习读书笔记 - 05 - 蒙特卡洛方法(Monte Carlo Methods) 学习笔记: Reinforcement Learning: An Introduction, Richard S ...

- 强化学习读书笔记 - 06~07 - 时序差分学习(Temporal-Difference Learning)

强化学习读书笔记 - 06~07 - 时序差分学习(Temporal-Difference Learning) 学习笔记: Reinforcement Learning: An Introductio ...

- 强化学习读书笔记 - 13 - 策略梯度方法(Policy Gradient Methods)

强化学习读书笔记 - 13 - 策略梯度方法(Policy Gradient Methods) 学习笔记: Reinforcement Learning: An Introduction, Richa ...

- 强化学习读书笔记 - 12 - 资格痕迹(Eligibility Traces)

强化学习读书笔记 - 12 - 资格痕迹(Eligibility Traces) 学习笔记: Reinforcement Learning: An Introduction, Richard S. S ...

- 强化学习读书笔记 - 11 - off-policy的近似方法

强化学习读书笔记 - 11 - off-policy的近似方法 学习笔记: Reinforcement Learning: An Introduction, Richard S. Sutton and ...

- 强化学习读书笔记 - 10 - on-policy控制的近似方法

强化学习读书笔记 - 10 - on-policy控制的近似方法 学习笔记: Reinforcement Learning: An Introduction, Richard S. Sutton an ...

- 强化学习读书笔记 - 09 - on-policy预测的近似方法

强化学习读书笔记 - 09 - on-policy预测的近似方法 参照 Reinforcement Learning: An Introduction, Richard S. Sutton and A ...

- 强化学习系列之:Deep Q Network (DQN)

文章目录 [隐藏] 1. 强化学习和深度学习结合 2. Deep Q Network (DQN) 算法 3. 后续发展 3.1 Double DQN 3.2 Prioritized Replay 3. ...

随机推荐

- 【Wince-自定义控件】ImageButton 带图片、文字

1.看图 可以实现MouseDown改变背景颜色或背景图片. 遗憾是没有实现键盘触发按钮事件. 2.选择继承自Control基类 public class ImageButton : Control ...

- Spring 初探(一) IoC 图集

Spring 框架总体结构 IoC 直观 Spring IoC容器 Spring提供两种容器类型: - BeanFactory - ApplicationContext ApplicationCont ...

- SimpleThreadPool给线程池增加拒绝策略和停止方法

给线程池增加拒绝策略和停止方法 package com.dwz.concurrency.chapter13; import java.util.ArrayList; import java.util. ...

- RabbitMQ TTL、死信队列

TTL概念 TTL是Time To Live的缩写,也就是生存时间. RabbitMQ支持消息的过期时间,在消息发送时可以进行指定. RabbitMQ支持队列的过期时间,从消息入队列开始计算,只要超过 ...

- TypeScript----函数与类

TypeScript中的类 传统的JavaScript程序使用函数和基于原型的继承来创建可重用的组件,但对于熟悉使用面向对象方式的程序员来讲就有些棘手,因为他们用的是基于类的继承并且对象是由类构建出来 ...

- 在CentOS 7上搭建WordPress

环境(ECS阿里云服务器) 服务器操作系统:CentOS 7.3 : 博客部署服务器:Apache HTTP: 数据库:MySql: 框架:WordPress: 步骤 一.安装 Apache HTTP ...

- mongoRepository 支持的所有接口

与HibernateRepository类似,通过继承MongoRepository接口,我们可以非常方便地实现对一个对象的增删改查,要使用Repository的功能,先继承MongoReposito ...

- 开启两个线程,一个线程打印A~Z,一个线程打印1~52的数据

开启两个线程,一个线程打印A-Z,一个线程打印1-52的数据 import java.util.concurrent.locks.Condition; import java.util.concurr ...

- springboot拦截异常信息发送邮件提醒

-- private JavaMailSender sender; 可能会出现注入错误,请注意yam配置文件中格式是否一致:否则会找不到注入的bean 一 发送邮件 在Springboot中发送邮件非 ...

- 【南工程开源计划】南京工程学院 信息与通信工程学院 课程设计说明书(论文) 宽带接入技术--WLAN接入设计

文章目录 蓝奏云文件存放地址 一.课程设计目的 二.课程设计要求 三.课程设计网络环境 四.课程设计内容 4.1 WLAN接入设计 4.1.1设计拓扑 4.1.2设计原理 1)WLAN 2)RADIU ...