Logistic Loss的简单讨论

首先应该知道Logistic Loss和Crossing Entropy Loss本质上是一回事。

所以所谓的SoftMaxLoss就是一般二分类LogisitcLoss的推广。之所以在网络中采取这种损失,而不是最小二乘的原因是LogisticLoss更易于求导。

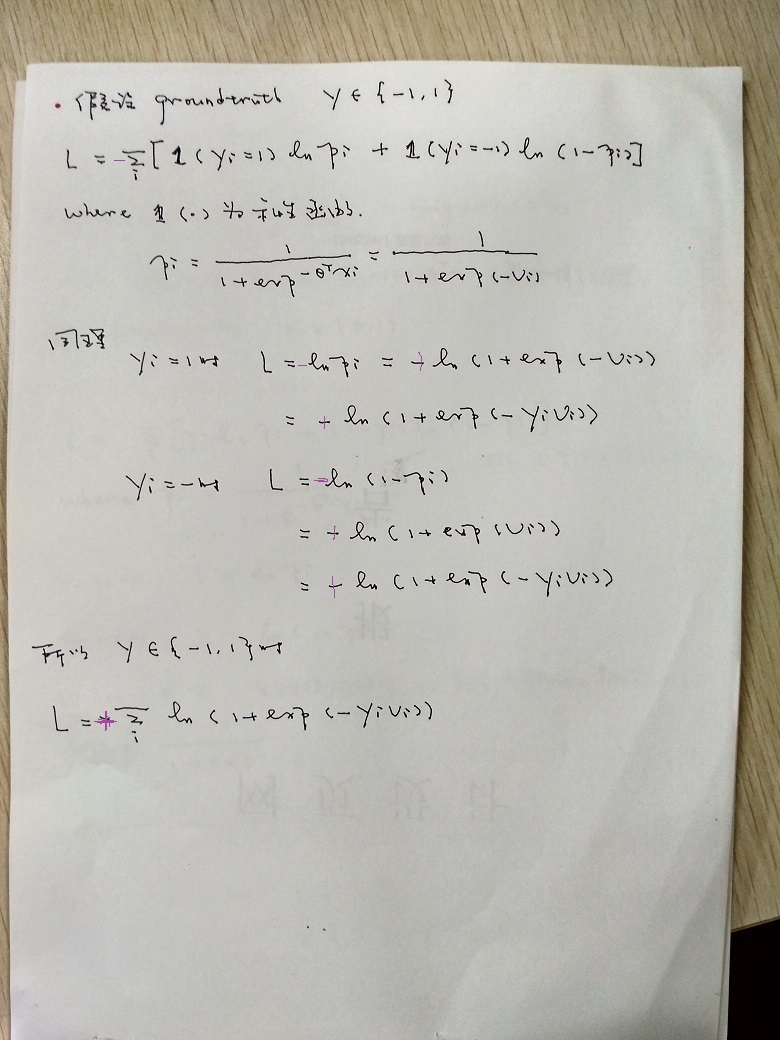

也可以统一写成

Loss=ln(1+exp(-(2*y_i-1)*v_i)))

++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++

上面的推导都是基于Logistic Loss和Crossing Entropy Lossing本质一样的前提讨论的。

其实Logistic Loss和最大似然也是一样的出发点。

我们假设x为数据输入。SoftMax层的输入为(/theta_1^{T}x,/theta_2^{T}x,...,/theta_K^{T}x)^T,即假设x的分类可能有K种。

那么SoftMax层的输出就是(p_1,p_2,...,p_K),其中 p_i=exp(/theta_i^{T}x)/(/sigma_{j=1}^K{expexp(/theta_j^{T}x)}), i=1,...,K

这里p_i=p(x;/theta_i)就是数据x属于第i类的概率,也就是x的似然,亦即p_i=p(x;/theta_i)=L(/theta_i;x)

我们假设x的groundtruth为第c类,所以我们训练的目标就使似然函数L_c=L(/theta_c;x)最大。

当时实际上我们都是求对数似然函数,亦即使得Loss=-log(L(/theta_c;x))最小。

即Loss=-log(p_c)。这个就和SoftMax的损失完全一致了。

+++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++++2018.5.15++++++++++++++++++++

Logistic Loss的简单讨论的更多相关文章

- Logistic Regression 的简单推导

Logistic Regression 是一种 Generalized Linear Model(GLM),也即广义线性模型. 1. LR 的基本假设 LR 模型假设观测值 y 成立的对数几率(log ...

- 简单讨论数据类型(byte)强制转化后的数值变化规律

package com.wangzhu.datatype; /** * Java基本数据类型练习 * * @ClassName: DataTypes * @Description: TODO * @a ...

- 简单讨论一下 jQuery 事件

事件是 Web 应用中不可或缺的一个东西,用户在应用中执行一个操作的时候,比如鼠标单击时要触发执行一些事情,就可以给该事件绑定一个事件处理程序(event handler).使用 jQuery 的 . ...

- 惩罚因子(penalty term)与损失函数(loss function)

penalty term 和 loss function 看起来很相似,但其实二者完全不同. 惩罚因子: penalty term的作用是把受限优化问题转化为非受限优化问题. 比如我们要优化: min ...

- Logistic Regression 模型简介

逻辑回归(Logistic Regression)是机器学习中的一种分类模型,由于算法的简单和高效,在实际中应用非常广泛.本文作为美团机器学习InAction系列中的一篇, 主要关注逻辑回归算法的数学 ...

- Logistic Regression 模型

逻辑回归(Logistic Regression)是机器学习中的一种分类模型,由于算法的简单和高效,在实际中应用非常广泛.本文作为美团机器学习InAction系列中的一篇,主要关注逻辑回归算法的数学模 ...

- 机器学习 Logistic Regression

Logistic Regression 之前我们讨论过回归问题,并且讨论了线性回归模型.现在我们来看看分类问题,分类问题与回归问题类似,只不过输出变量一个是离散的,一个是连续的.我们先关注二分类问题, ...

- 如何理解logistic函数?

作者:煎挠橙链接:https://www.zhihu.com/question/36714044/answer/78680948来源:知乎著作权归作者所有.商业转载请联系作者获得授权,非商业转载请注明 ...

- Caffe Loss分析

Caffe_Loss 损失函数为深度学习中重要的一个组成部分,各种优化算法均是基于Loss来的,损失函数的设计好坏很大程度下能够影响最终网络学习的好坏.派生于 \(LossLayer\),根据不同的L ...

随机推荐

- 第 8 章 容器网络 - 067 - 如何部署 Calico 网络?

0.准备工作 Calico 是一个纯三层的虚拟网络方案,Calico 为每个容器分配一个 IP,每个 host 都是 router,把不同 host 的容器连接起来. 与 VxLAN 不同的是,Cal ...

- 『TensorFlow』网络操作API_下

一.优化器基类介绍 标注一点,优化器中的学习率可以是tensor,这意味着它可以feed, learning_rate: A Tensor or a floating point value. 正常使 ...

- Matlab:高阶常微分三种边界条件的特殊解法(隐式Euler)

函数文件1: function b=F(f,x0,u,h) b(1,1)=x0(1)-h*x0(2)-u(1); b(2,1)=x0(2)+h*x0(1)^2-u(2)-h*f; 函数文件2: fun ...

- 数据分析库之Numpy

Numpy get started NumPy中我们要学习的核心其实就是一个 ndarray n多 d dimension 维度 array数组 多维数组 创建一个ndarray的几种方法 impor ...

- vue轮播,vue-awesome-swiper动态数据渲染,loop无效,轮循无效

解决办法:在渲染数组数据前.判断是否为空 v-if="slideList.length>1" <template> <div class="ban ...

- struts2必备jar包(2.1.6版本)

struts2必备jar包(2.1.6版本) struts2(2.1.6版本)必备的jar包有6个 struts2-core-2.1.6.jar freemarker-2.3.13.jar commo ...

- python画箱线图

# -*- coding: utf-8 -*- """ Created on Wed Jun 14 13:00:11 2017 @author: Miao "& ...

- ES5和ES6那些你必须知道的事儿(一)

ES5和ES6那些你必须知道的事儿 ES5新增的东西 一.数组方法 1.forEach 用途:遍历,循环 对于空数组不会执行回调函数 //用法 array.forEach( function( ...

- Android 音视频深入 十四 FFmpeg与OpenSL ES 播放mp3音乐,能暂停(附源码下载)

项目地址https://github.com/979451341/FFmpegOpenslES 这次说的是FFmpeg解码mp3,数据给OpenSL ES播放,并且能够暂停. 1.创建引擎 slCre ...

- UVa 10340 - All in All 水题 难度: 0

题目 https://uva.onlinejudge.org/index.php?option=com_onlinejudge&Itemid=8&page=show_problem&a ...