Pytorch-tensor的感知机,链式法则

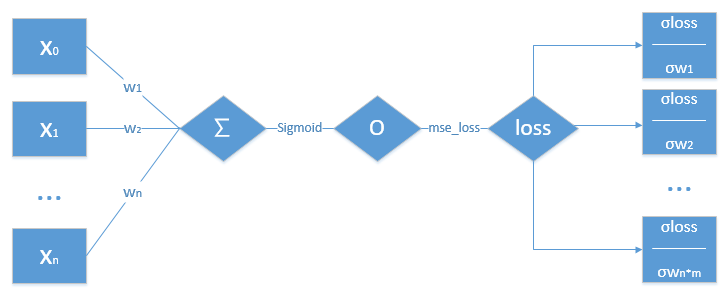

1.单层感知机

单层感知机的主要步骤:

- 1.对数据进行一个权重的累加求和,求得

∑ - 2.将

∑经过一个激活函数Sigmoid,得出值O - 3.再将

O,经过一个损失函数mse_loss,得出值loss - 4.根据

loss,以及前边所求得的值,求得loss对各个w的偏导数 - 5.更新

w值

# 单层感知机梯度的推导

# 要进行优化的是w,对w进行梯度下降

a=torch.randn(1,10)

# a是一个【1,10】的向量

w=torch.randn(1,10,requires_grad=True)

# w是一个可导的【1,10】的向量

# 1.2.经过一个sigmoid激活函数

o=torch.sigmoid(a@w.t())

print(o.shape)

# 3.经过一个mse_loss损失函数

# loss是一个标量

loss=F.mse_loss(torch.ones(1,1),o)

print(loss.shape)

# 4.求loss对w0,w1....w9的偏导数

loss.backward()

print(w.grad)

# 5.后边就可以对w进行梯度更新

输出结果

torch.Size([1, 1])

torch.Size([])

tensor([[ 3.6432e-05, -7.3545e-05, -4.3179e-05, 3.3986e-04, -9.5312e-05,

-1.7416e-04, -1.7869e-05, -2.3893e-04, -1.5513e-04, -2.1554e-05]])

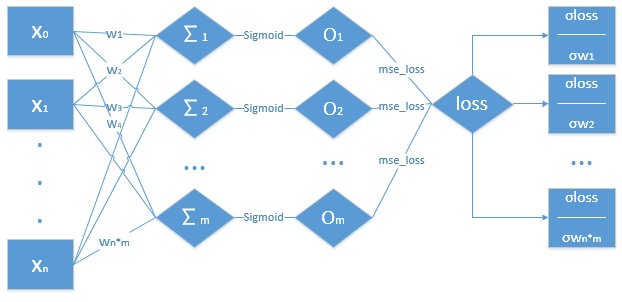

多层感知机的主要步骤:

1.对数据进行一个权重的累加求和,求得

∑1,∑2,,,∑m2.将

∑1,∑2,,,∑m经过一个激活函数Sigmoid,得出值O1,O2,,,Om3.再将

O1,O2,,,Om,经过一个损失函数mse_loss,得出值loss4.根据

loss,以及前边所求得的值,求得loss对各个w的偏导数5.更新

w值

# 多层感知机梯度的推导

# 要进行优化的是w,对w进行梯度下降

a=torch.randn(1,10)

# a是一个【1,10】的向量

w=torch.randn(2,10,requires_grad=True)

# w是一个可导的【2,10】的向量

# 1.2.经过一个sigmoid激活函数

o=torch.sigmoid(a@w.t())

print(o.shape)

# 3.经过一个mse_loss损失函数

# loss是一个标量

loss=F.mse_loss(torch.ones(1,2),o)

print(loss)

# 4.求loss对w0,w1....w9的偏导数

loss.backward()

print(w.grad)

# 5.后边就可以对w进行梯度更新

输出结果

torch.Size([1, 2])

tensor(0.2823, grad_fn=<MeanBackward0>)

tensor([[-0.0654, 0.0242, 0.0045, -0.1007, 0.0259, -0.0522, -0.0327, 0.0805,-0.0180,-0.0186],

[-0.1300, 0.0481, 0.0090, -0.2002, 0.0514, -0.1037, -0.0650, 0.1599,-0.0358,-0.0371]])

链式法则:

y=f(u),u=f(x),y对x的导数,可以通过u来中间传递,也就是说

dy/dx=(dy/du)*(du/dx)

x=torch.rand(1)

w1=torch.rand(1,requires_grad=True)

b1=torch.rand(1)

w2=torch.rand(1,requires_grad=True)

b2=torch.rand(1)

y1=x*w1+b1

y2=y1*w2+b2

dy1_dw1=torch.autograd.grad(y1,[w1],retain_graph=True)[0]

dy2_dy1=torch.autograd.grad(y2,[y1],retain_graph=True)[0]

dy2_dw1=torch.autograd.grad(y2,[w1],retain_graph=True)[0]

print(dy1_dw1*dy2_dy1)

print(dy2_dw1)

输出结果

tensor([0.1867])

tensor([0.1867])

Pytorch-tensor的感知机,链式法则的更多相关文章

- Pytorch Tensor 常用操作

https://pytorch.org/docs/stable/tensors.html dtype: tessor的数据类型,总共有8种数据类型,其中默认的类型是torch.FloatTensor, ...

- Pytorch Tensor, Variable, 自动求导

2018.4.25,Facebook 推出了 PyTorch 0.4.0 版本,在该版本及之后的版本中,torch.autograd.Variable 和 torch.Tensor 同属一类.更确切地 ...

- 从头学pytorch(五) 多层感知机及其实现

多层感知机 上图所示的多层感知机中,输入和输出个数分别为4和3,中间的隐藏层中包含了5个隐藏单元(hidden unit).由于输入层不涉及计算,图3.3中的多层感知机的层数为2.由图3.3可见,隐藏 ...

- pytorch tensor与numpy转换

从官网拷贝过来的,就是做个学习记录.版本 0.4 tensor to numpy a = torch.ones(5) print(a) 输出 tensor([1., 1., 1., 1., 1.]) ...

- pytorch tensor 维度理解.md

torch.randn torch.randn(*sizes, out=None) → Tensor(张量) 返回一个张量,包含了从标准正态分布(均值为0,方差为 1)中抽取一组随机数,形状由可变参数 ...

- pytorch tensor的索引与切片

切片方式与numpy是类似. * a[:2, :1, :, :], * 可以用-1索引. * ::2,表示所有数据,间隔为2,即 start:end:step. * a.index_select(1 ...

- Pytorch Tensor 维度的扩充和压缩

维度扩展 x.unsqueeze(n) 在 n 号位置添加一个维度 例子: import torch x = torch.rand(3,2) x1 = x.unsqueeze(0) # 在第一维的位置 ...

- 【Code】numpy、pytorch实现全连接神经网络

""" 利用numpy实现一个两层的全连接网络 网络结构是:input ->(w1) fc_h -> relu ->(w2) output 数据是随机出 ...

- Pytorch 常用函数

1. torch.renorm(input, p, dim, maxnorm, out=None) → Tensor Returns a tensor where each sub-tensor of ...

- 神经网络架构PYTORCH-几个概念

使用Pytorch之前,有几个概念需要弄清楚. 什么是Tensors(张量)? 这个概念刚出来的时候,物理科班出身的我都感觉有点愣住了,好久没有接触过物理学的概念了. 这个概念,在物理学中怎么解释呢? ...

随机推荐

- element_ui实现表格内套表单,点击可以编辑

<template> <div class="app-container"> <el-table :data="list" str ...

- go-view 依赖库

go-view 依赖库 打包es5 由于当前node版本是 16.18 最新版本的不支持,所以装个老版的 npm install @vitejs/plugin-legacy@4.0.4 --save- ...

- 跨域测试代码 - console 里面直接就可以测试

跨域测试代码 - console 里面直接就可以测试 var xhr = new XMLHttpRequest(); xhr.open("GET", "https://w ...

- 安装debian后,发现进入不了root

回想了一下,自己安装的时候,没有设置root密码! 解决方法: sudo passwd root 随后设置密码: 再次su 就可以进入root目录了!

- 基于六轴传感器MPU6050的物体移动监测报警系统

一 系统简介 1.简介 MPU-60x0 是全球首例 9 轴运动处理传感器.它集成了 3 轴MEMS陀螺仪,3 轴MEMS加速度计,以及一个可扩展的数字运动处理器 DMP(Digital Motion ...

- Java的Class类,注解与反射

Class对象: 我们每创建一个类,经过build都会生成对应的.class文件 该类无法只能由虚拟机创建对象,其构造函数为private 当我们创建某个类的对象,ClassLoader(一个类)就会 ...

- 使用RTX Voice,用N卡打造降噪麦克风

原文地址:使用RTX Voice,用N卡打造降噪麦克风 | Stars-One的杂货小窝 随着直播的流行,不少人为了追求良好的直播效果,都选择购买相应的设备.如想要实现降噪的功能,得通过物理手段(买个 ...

- 记录--Vue自动生成组件名

这里给大家分享我在网上总结出来的一些知识,希望对大家有所帮助 unplugin-generate-component-name 一款用于以文件夹名或者setup标签写入名字来自动生成Vue组件名的插件 ...

- 记录--『uni-app、小程序』蓝牙连接、读写数据全过程

这里给大家分享我在网上总结出来的一些知识,希望对大家有所帮助 本文简介 这是一次真实的 蓝牙收发数据 的全过程讲解. 本文使用 uni-app + Vue3 的方式进行开发,以手机app的方式运行(微 ...

- 【Docker】Dockerfile基础知识,相信你一定有所收获

Dockerfile常用命令 FROM: 继承基础镜像 MAINTAINER:镜像制作作者信息 RUN: 用来执行shell命令 EXPOSE: 暴露端口号 CMD: 启动容器默认执行的命令,会被覆盖 ...