k8s集群之上运行etcd集群

一.知识点:

1.headless services

NOTE:: 我们在k8s上运行etcd集群,集群间通告身份是使用dns,不能使用pod ip,因为如果pod被重构了ip会变,在这种场景中不能直接使用k8s 的service,因为在集群环境中我们需要直接将service name映射到pod ip,而不是 service ip,这样我们才能完成集群间的身份验证。

2.env

NOTE: pod还没启动之前怎么能知道pod的ip呢?那我们启动etcd时绑定网卡的ip该怎样拿到呢?这时就可以用env将pod ip 以变量方式传给etcd,这样当pod启动后,etcd就通过env拿到了pod ip, 从而绑定到container 的ip

二.架构:

采用三节点的etcd:

分别为:etcd1,etcd2,etcd3

etcd持久数据采用nfs

etcd1.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: etcd1

labels:

name: etcd1

spec:

replicas:

selector:

matchLabels:

app: etcd1

template:

metadata:

labels:

app: etcd1

spec:

containers:

- name: etcd1

image: myetcd

imagePullPolicy: IfNotPresent

volumeMounts:

- mountPath: /data

name: etcd-data

env:

- name: host_ip

valueFrom:

fieldRef:

fieldPath: status.podIP

command: ["/bin/sh","-c"]

args:

- /tmp/etcd

--name etcd1

--initial-advertise-peer-urls http://${host_ip}:2380

--listen-peer-urls http://${host_ip}:2380

--listen-client-urls http://${host_ip}:2379,http://127.0.0.1:2379

--advertise-client-urls http://${host_ip}:2379

--initial-cluster-token etcd-cluster-

--initial-cluster etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

--initial-cluster-state new

--data-dir=/data volumes:

- name: etcd-data

nfs:

server: 192.168.85.139

path: /data/v1

etcd2.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: etcd2

labels:

name: etcd2

spec:

replicas:

selector:

matchLabels:

app: etcd2

template:

metadata:

labels:

app: etcd2

spec:

containers:

- name: etcd2

image: myetcd

imagePullPolicy: IfNotPresent

volumeMounts:

- mountPath: /data

name: etcd-data

env:

- name: host_ip

valueFrom:

fieldRef:

fieldPath: status.podIP command: ["/bin/sh","-c"]

args:

- /tmp/etcd

--name etcd2

--initial-advertise-peer-urls http://${host_ip}:2380

--listen-peer-urls http://${host_ip}:2380

--listen-client-urls http://${host_ip}:2379,http://127.0.0.1:2379

--advertise-client-urls http://${host_ip}:2379

--initial-cluster-token etcd-cluster-

--initial-cluster etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

--initial-cluster-state new

--data-dir=/data volumes:

- name: etcd-data

nfs:

server: 192.168.85.139

path: /data/v2

etcd3.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: etcd3

labels:

name: etcd3

spec:

replicas:

selector:

matchLabels:

app: etcd3

template:

metadata:

labels:

app: etcd3

spec:

containers:

- name: etcd3

image: myetcd

imagePullPolicy: IfNotPresent

volumeMounts:

- mountPath: /data

name: etcd-data

env:

- name: host_ip

valueFrom:

fieldRef:

fieldPath: status.podIP

command: ["/bin/sh","-c"]

args:

- /tmp/etcd

--name etcd3

--initial-advertise-peer-urls http://${host_ip}:2380

--listen-peer-urls http://${host_ip}:2380

--listen-client-urls http://${host_ip}:2379,http://127.0.0.1:2379

--advertise-client-urls http://${host_ip}:2379

--initial-cluster-token etcd-cluster-

--initial-cluster etcd1=http://etcd1:2380,etcd2=http://etcd2:2380,etcd3=http://etcd3:2380

--initial-cluster-state new

--data-dir=/data volumes:

- name: etcd-data

nfs:

server: 192.168.85.139

path: /data/v3

etcd1-svc.yml

apiVersion: v1

kind: Service

metadata:

name: etcd1

spec:

clusterIP: None

ports:

- name: client

port:

targetPort:

- name: message

port:

targetPort:

selector:

app: etcd1

etcd2-svc.yml

apiVersion: v1

kind: Service

metadata:

name: etcd2

spec:

clusterIP: None

ports:

- name: client

port:

targetPort:

- name: message

port:

targetPort:

selector:

app: etcd2

etcd3-svc.yml

apiVersion: v1

kind: Service

metadata:

name: etcd3

spec:

clusterIP: None

ports:

- name: client

port:

targetPort:

- name: message

port:

targetPort:

selector:

app: etcd3

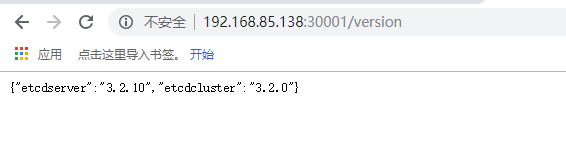

在任意节点查看etcd状态:

[root@node1 test]# kubectl exec etcd1-79bdcb47c9-fwqps -- /tmp/etcdctl cluster-health

member 876043ef79ada1ea is healthy: got healthy result from http://10.244.1.113:2379

member 99eab3685d8363a1 is healthy: got healthy result from http://10.244.1.111:2379

member dcb68c82481661be is healthy: got healthy result from http://10.244.1.112:2379

提供外部访问:

apiVersion: v1

kind: Service

metadata:

name: etcd-external

spec:

type: NodePort

ports:

- name: client

port:

targetPort:

nodePort:

- name: message

port:

targetPort:

nodePort:

selector:

app: etcd1

k8s集群之上运行etcd集群的更多相关文章

- K8s二进制部署单节点 etcd集群,flannel网络配置 ——锥刺股

K8s 二进制部署单节点 master --锥刺股 k8s集群搭建: etcd集群 flannel网络插件 搭建master组件 搭建node组件 1.部署etcd集群 2.Flannel 网络 ...

- 使用k8s operator安装和维护etcd集群

关于Kubernetes Operator这个新生事物,可以参考下文来了解这一技术的来龙去脉: https://yq.aliyun.com/articles/685522?utm_content=g_ ...

- ETCD:在容器中运行etcd集群

原文地址:Docker container 以下指南显示了如何使用静态引导过程在rkt和Docker上运行etcd. rkt 运行单节点的etcd 以下rkt run命令将在端口2379上公开etcd ...

- k8s集群中遇到etcd集群故障的排查思路

一次在k8s集群中创建实例发现etcd集群状态出现连接失败状况,导致创建实例失败.于是排查了一下原因. 问题来源 下面是etcd集群健康状态: 1 2 3 4 5 6 7 8 9 10 11 [roo ...

- Kubernetes集群搭建之Etcd集群配置篇

介绍 etcd 是一个分布式一致性k-v存储系统,可用于服务注册发现与共享配置,具有以下优点. 简单 : 相比于晦涩难懂的paxos算法,etcd基于相对简单且易实现的raft算法实现一致性,并通过g ...

- Kubernetes集群部署之三ETCD集群部署

kuberntes 系统使用 etcd 存储所有数据,本文档介绍部署一个三节点高可用 etcd 集群的步骤,这三个节点复用 kubernetes 集群机器k8s-master.k8s-node-1.k ...

- k8s基础(3)etcd集群

下载安装 https://github.com/coreos/etcd/releases 在这网页,可以看到有多个版本共选择. 下载3.25 解压后, cd etcd-v3.2.5-linux-amd ...

- etcd集群部署与遇到的坑

在k8s集群中使用了etcd作为数据中心,在实际操作中遇到了一些坑.今天记录一下,为了以后更好操作. ETCD参数说明 —data-dir 指定节点的数据存储目录,这些数据包括节点ID,集群ID,集群 ...

- etcd集群部署与遇到的坑(转)

原文 https://www.cnblogs.com/breg/p/5728237.html etcd集群部署与遇到的坑 在k8s集群中使用了etcd作为数据中心,在实际操作中遇到了一些坑.今天记录一 ...

随机推荐

- Spring cloud微服务安全实战-6-10sentinel之热点和系统规则

热点规则 热点就是经常访问的数据.很多时候我们希望争对某一些热点数据,然后来进行限制.比如说商品的信息这个服务,我们给它做一个限流,qps是100,某一天我想做一个秒杀活动,可能会有很大的流量,这个时 ...

- Grafana修改背景色

grafana默认主题色是黑底白字,我们将它修改成白底黑字: in /etc/grafana/grafana.ini uncomment line and set default_theme = li ...

- vscode插件Power Mode

Power Mode官网 设置里添加 "powermode.enabled": true, "powermode.presets": "flames& ...

- Elasticsearch集群+kibana

目录: 软件及环境准备 JDK安装配置 ElasticSearch安装及配置 启动ES集群 es常规操作 安装及配置ES前端图形化操作工具 kibana汉化及时区修改 ElasticSearch和ki ...

- liunx mysql数据库目录迁移

1.查看mysql安装目录 从目录etc/my.cnf中查看安装目录 2.进入mysql目录,停止mysql服务 命令: cd usr/local/mysql 命令:service mysql sto ...

- 图片url地址的生成获取方法

在写博客插入图片时,许多时候需要提供图片的url地址.作为菜鸡的我,自然是一脸懵逼.那么什么是所谓的url地址呢?又该如何获取图片的url地址呢? 首先来看一下度娘对url地址的解释:url是统一资源 ...

- Socket简单Demo

Socket协议网上介绍的有很多了,就不在画蛇添足了,本文主要编写一个小Demo,介绍下它具体实现 一:Socket服务器端 package com.founderit; import java.io ...

- SpringBoot 常用配置 静态资源访问配置/内置tomcat虚拟文件映射路径

Springboot 再模板引擎中引入Js等文件,出现服务器拒绝访问的错误,需要配置过滤器 静态资源访问配置 @Configuration @EnableWebMvc public class Sta ...

- Python接口自动化基础---get请求

1.没有参数的get请求 import requests r=requests.get('http://docs.python-requests.org/zh_CN/latest/user/quick ...

- idea: unable to import maven project

新搭建的maven环境,使用idea创建maven项目时,一直提示 unable to import maven project,百度良久未解决 有说关闭防火前的,亲测无效,后看到说是maven-3. ...