[Reinforcement Learning] Value Function Approximation

为什么需要值函数近似?

之前我们提到过各种计算值函数的方法,比如对于 MDP 已知的问题可以使用 Bellman 期望方程求得值函数;对于 MDP 未知的情况,可以通过 MC 以及 TD 方法来获得值函数,为什么需要再进行值函数近似呢?

其实到目前为止,我们介绍的值函数计算方法都是通过查表的方式获取的:

- 表中每一个状态 \(s\) 均对应一个 \(V(s)\)

- 或者每一个状态-动作 <\(s, a\)>

但是对于大型 MDP 问题,上述方法会遇到瓶颈:

- 太多的 MDP 状态、动作需要存储

- 单独计算每一个状态的价值都非常的耗时

因此我们需要有一种能够适用于解决大型 MDP 问题的通用方法,这就是本文介绍的值函数近似方法。即:

\[

\hat{v}(s, \mathbf{w}) \approx v_{\pi}(s) \\

\text{or } \hat{q}(s, a, \mathbf{w}) \approx q_{\pi}(s, a)

\]

那么为什么值函数近似的方法可以求解大型 MDP 问题?

对于大型 MDP 问题而言,我们可以近似认为其所有的状态和动作都被采样和计算是不现实的,那么我们一旦获取了近似的值函数,我们就可以对于那些在历史经验或者采样中没有出现过的状态和动作进行泛化(generalize)。

进行值函数近似的训练方法有很多,比如:

- 线性回归

- 神经网络

- 决策树

- ...

此外,针对 MDP 问题的特点,训练函数必须可以适用于非静态、非独立同分布(non-i.i.d)的数据。

增量方法

梯度下降

梯度下降不再赘述,感兴趣的可以参考之前的博文《梯度下降法的三种形式BGD、SGD以及MBGD》

通过随机梯度下降进行值函数近似

我们优化的目标函数是找到一组参数 \(\mathbf{w}\) 来最小化最小平方误差(MSE),即:

\[J(\mathbf{w}) = E_{\pi}[(v_{\pi}(S) - \hat{v}(S, \mathbf{w}))^2]\]

通过梯度下降方法来寻优:

\[

\begin{align}

\Delta\mathbf{w}

&=-\frac{1}{2}\alpha\triangledown_{\mathbf{w}}J(\mathbf{w})\\

&=\alpha E_{\pi}\Bigl[\Bigl(v_{\pi}(S) - \hat{v}(S, \mathbf{w})\Bigr)\triangledown_{\mathbf{w}}J(\mathbf{w})\Bigr]

\end{align}

\]

对于随机梯度下降(Stochastic Gradient Descent,SGD),对应的梯度:

\[\Delta\mathbf{w} = \alpha\underbrace{\Bigl(v_{\pi}(S) - \hat{v}(S, \mathbf{w})\Bigr)}_{\text{error}}\underbrace{\triangledown_{\mathbf{w}}\hat{v}(S, \mathbf{w})}_{\text{gradient}}\]

值函数近似

上述公式中需要真实的策略价值函数 \(v_{\pi}(S)\) 作为学习的目标(supervisor),但是在RL中没有真实的策略价值函数,只有rewards。在实际应用中,我们用target来代替 \(v_{\pi}(S)\):

- 对于MC,target 为 return \(G_t\):

\[\Delta\mathbf{w}=\alpha\Bigl(G_t - \hat{v}(S_t, \mathbf{w})\Bigr)\triangledown_{\mathbf{w}}\hat{v}(S_t, \mathbf{w})\] - 对于TD(0),target 为TD target \(R_{t+1}+\gamma\hat{v}(S_{t+1}, \mathbf{w})\):

\[\Delta\mathbf{w}=\alpha\Bigl(R_{t+1} + \gamma\hat{v}(S_{t+1}, \mathbf{w})- \hat{v}(S_t, \mathbf{w})\Bigr)\triangledown_{\mathbf{w}}\hat{v}(S_t, \mathbf{w})\] - 对于TD(λ),target 为 TD λ-return \(G_t^{\lambda}\):

\[\Delta\mathbf{w}=\alpha\Bigl(G_t^{\lambda}- \hat{v}(S_t, \mathbf{w})\Bigr)\triangledown_{\mathbf{w}}\hat{v}(S_t, \mathbf{w})\]

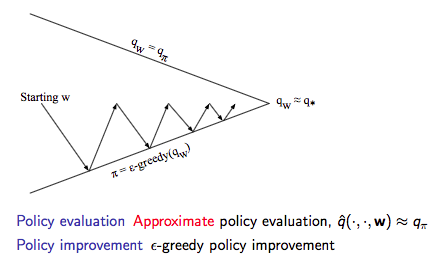

在获取了值函数近似后就可以进行控制了,具体示意图如下:

动作价值函数近似

动作价值函数近似:

\[\hat{q}(S, A, \mathbf{w})\approx q_{\pi}(S, A)\]

优化目标:最小化MSE

\[J(\mathbf{w}) = E_{\pi}[(q_{\pi}(S, A) - \hat{q}(S, A, \mathbf{w}))^2]\]

使用SGD寻优:

\[\begin{align}

\Delta\mathbf{w}

&=-\frac{1}{2}\alpha\triangledown_{\mathbf{w}}J(\mathbf{w})\\

&=\alpha\Bigl(q_{\pi}(S, A)-\hat{q}_{\pi}(S, A, \mathbf{w})\Bigr) \triangledown_{\mathbf{w}}\hat{q}_{\pi}(S, A, \mathbf{w})

\end{align}\]

收敛性分析

略,感兴趣的可以参考David的课件。

批量方法

随机梯度下降SGD简单,但是批量的方法可以根据agent的经验来更好的拟合价值函数。

值函数近似

优化目标:批量方法解决的问题同样是 \(\hat{v}(s, \mathbf{w})\approx v_{\pi}(s)\)

经验集合 \(D\) 包含了一系列的 <state, value> pair:

\[D=\{<s_1, v_1^{\pi}>, <s_2, v_2^{\pi}>, ..., <s_T, v_T^{\pi}>\}\]

根据最小化平方误差之和来拟合 \(\hat{v}(s, \mathbf{w})\) 和 \(v_{\pi}(s)\),即:

\[

\begin{align}

LS(w)

&= \sum_{t=1}^{T}(v_{t}^{\pi}-\hat{v}(s_t, \mathbf{w}))^2\\

&= E_{D}[(v^{\pi}-\hat{v}(s, \mathbf{w}))^2]

\end{align}

\]

经验回放(Experience Replay):

给定经验集合:

\[D=\{<s_1, v_1^{\pi}>, <s_2, v_2^{\pi}>, ..., <s_T, v_T^{\pi}>\}\]

Repeat:

- 从经验集合中采样状态和价值:\(<s, v^{\pi}>\sim D\)

- 使用SGD进行更新:\(\Delta\mathbf{w}=\alpha\Bigl(v^{\pi}-\hat{v}(s, \mathbf{w})\Bigr)\triangledown_{\mathbf{w}}\hat{v}(s, \mathbf{w})\)

通过上述经验回放,获得最小化平方误差的参数值:

\[\mathbf{w}^{\pi}=\arg\min_{\mathbf{w}}LS(\mathbf{w})\]

我们经常听到的 DQN 算法就使用了经验回放的手段,这个后续会在《深度强化学习》中整理。

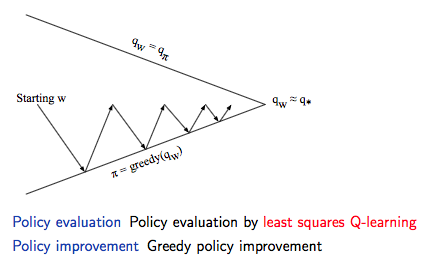

通过上述经验回放和不断的迭代可以获取最小平方误差的参数值,然后就可以通过 greedy 的策略进行策略提升,具体如下图所示:

动作价值函数近似

同样的套路:

- 优化目标:\(\hat{q}(s, a, \mathbf{w})\approx q_{\pi}(s, a)\)

- 采取包含 <state, action, value> 的经验集合 \(D\)

- 通过最小化平方误差来拟合

对于控制环节,我们采取与Q-Learning一样的思路:

- 利用之前策略的经验

- 但是考虑另一个后继动作 \(A'=\pi_{\text{new}}(S_{t+1})\)

- 朝着另一个后继动作的方向去更新 \(\hat{q}(S_t, A_t, \mathbf{w})\),即

\[\delta = R_{t+1} + \gamma\hat{q}(S_{t+1}, \pi{S_{t+1}, \mathbf{\pi}}) - \hat{q}(S_t, A_t, \mathbf{w})\] - 梯度:线性拟合情况,\(\Delta\mathbf{w}=\alpha\delta\mathbf{x}(S_t, A_t)\)

收敛性分析

略,感兴趣的可以参考David的课件。

Reference

[1] Reinforcement Learning: An Introduction, Richard S. Sutton and Andrew G. Barto, 2018

[2] David Silver's Homepage

[Reinforcement Learning] Value Function Approximation的更多相关文章

- 2.6. Statistical Models, Supervised Learning and Function Approximation

Statical model regression $y_i=f_{\theta}(x_i)+\epsilon_i,E(\epsilon)=0$ 1.$\epsilon\sim N(0,\sigma^ ...

- Awesome Reinforcement Learning

Awesome Reinforcement Learning A curated list of resources dedicated to reinforcement learning. We h ...

- 18 Issues in Current Deep Reinforcement Learning from ZhiHu

深度强化学习的18个关键问题 from: https://zhuanlan.zhihu.com/p/32153603 85 人赞了该文章 深度强化学习的问题在哪里?未来怎么走?哪些方面可以突破? 这两 ...

- 深度强化学习(Deep Reinforcement Learning)入门:RL base & DQN-DDPG-A3C introduction

转自https://zhuanlan.zhihu.com/p/25239682 过去的一段时间在深度强化学习领域投入了不少精力,工作中也在应用DRL解决业务问题.子曰:温故而知新,在进一步深入研究和应 ...

- (转) Deep Reinforcement Learning: Pong from Pixels

Andrej Karpathy blog About Hacker's guide to Neural Networks Deep Reinforcement Learning: Pong from ...

- (转) Deep Learning Research Review Week 2: Reinforcement Learning

Deep Learning Research Review Week 2: Reinforcement Learning 转载自: https://adeshpande3.github.io/ad ...

- 论文笔记之:Asynchronous Methods for Deep Reinforcement Learning

Asynchronous Methods for Deep Reinforcement Learning ICML 2016 深度强化学习最近被人发现貌似不太稳定,有人提出很多改善的方法,这些方法有很 ...

- [转]Deep Reinforcement Learning Based Trading Application at JP Morgan Chase

Deep Reinforcement Learning Based Trading Application at JP Morgan Chase https://medium.com/@ranko.m ...

- [转]Introduction to Learning to Trade with Reinforcement Learning

Introduction to Learning to Trade with Reinforcement Learning http://www.wildml.com/2018/02/introduc ...

随机推荐

- JDBC获取数据库连接

是什么? JDBC:Java Data Base Connectivity(java数据库连接) 为什么用? sun公司提供JDBC API接口,数据库厂商来提供实现 我们需要用哪个数据库就加载那个数 ...

- Python的应用小案例

1.python统计文本中每个单词出现的次数: #coding=utf-8__author__ = 'zcg' import collectionsimport os with open('abc.t ...

- “尝试加载 Oracle 客户端库时引发 BadImageFormatException。如果在安装 32 位 Oracle 客户端组件的情况下以 64 位模式运行,将出现此问题。”

远程连接服务器的数据库调试WCF程序时,可以正常访问数据库,但将程序发布成站点部署在数据库所在的服务器之后,一直报错,通过try/catch捕获得到以下报错信息: System.Exception: ...

- SQL 语法使用

SQL 语句 语句 语法 AND / OR SELECT column_name(s)FROM table_nameWHERE conditionAND|OR condition ALTER TABL ...

- egg.js与mysql的结合使用,以及部署事项

最近使用egg.js写了一个小项目练手,主要用来封装接口以及代理接口.进入正题: egg搭建以及各项配置 可以详见官方文档:https://eggjs.org,这里简单描述一下: 1.直接使用脚手架快 ...

- pytorch的函数中的group参数的作用

1.当设置group=1时: conv = nn.Conv2d(in_channels=, out_channels=, kernel_size=, groups=) conv.weight.data ...

- Elastic Stack-Elasticsearch使用介绍(六)

一.前言 很久没有更新博客,实在对不住大家.从10月份假期以后我就开始优化程序,来应对双11,这段时间确实很忙,不好意思.好在优化效果还不错,我负责的模块在双11期间没有任何大问题,整体效果还 ...

- selenium webdriver 如何实现将浏览器滚动条移动到某个位置

说明: 在做selenium webdriver 在做UI 自动化时,有些页面时使用懒加载的形式显示页面图片,如果在不向下移动滚动条时,获取到的图片会是网站的默认图片和真实的图片不相符. 所以研究了 ...

- CRM公海自动回收规则

企微云CRM操作指南 – 道一云|企微https://wbg.do1.com.cn/xueyuan/2568.html 销售云 - 美洽 - 连接客户,亲密无间https://meiqia.com/s ...

- iptables对端口流量统计

本篇文章主要介绍了Linux下如何对端口流量进行统计,小编觉得挺不错的,现在分享给大家,也给大家做个参考.一起跟随小编过来看看吧 在不修改源代码的情况下对程序暴露端口流量进行监控统计,可以利用Li ...