python3爬取全站美眉图片

爬取网站:https://www.169tp.com/xingganmeinv

该网站美眉图片有数百页,每页24张,共上万张图片,全部爬取下来

import urllib.request

import re

import os

from bs4 import BeautifulSoup page_flag = 0

base_url = "https://www.169tp.com/xingganmeinv/"

first_url ="https://www.169tp.com/xingganmeinv/list_1_1.html"

Imgnums = 0 def get_html(url):

response = urllib.request.urlopen(url)

html = response.read().decode('gb18030')

return html def get_Imgurl_list(html):

img_urllist = re.findall('src=["\']{1}(.+?\.jpg)["\']{1}', html)

return img_urllist def Download(img_urllist,page_flag,final_path,Imgnums):

num = 1

for imgurl in img_urllist:

imgname = "{}{}{}{}.jpg".format(final_path,page_flag,'_',num)

urllib.request.urlretrieve(imgurl,imgname)

print("已经爬取图片名:",imgname)

Imgnums += 1

num += 1 def makedir(path):

path = path.strip()

isExists = os.path.exists(path)

if not isExists:

print("创建了路径为 ",path," 的文件夹")

os.makedirs(path)

return True

else:

print("路径为 ",path," 的文件夹已经存在")

return False filepath = input("请输入保持图片的文件夹路径:")

print(filepath)

name = input("请输入保存图片的文件夹名:")

print(name)

finalpath = filepath + name

makedir(finalpath)

finalpath += '\\'

print(f"图片保存路径: {finalpath}") Download(get_Imgurl_list(first_url),page_flag,finalpath,Imgnums)

mysoup = BeautifulSoup(get_html(first_url),'html.parser')

next_page = mysoup.find('div',attrs = {'class':'page'}).find('li',text = '下一页').find('a')

while next_page:

new_url = base_url + next_page['href']

page_flag += 1

Download(get_Imgurl_list(get_html(new_url)),page_flag,finalpath,Imgnums)

mysoup = BeautifulSoup(get_html(new_url),'html.parser')

next_page = mysoup.find('div',attrs = {'class':'page'}).find('li',text = '下一页').find('a')

print(f"下载完成,共下载了 {Imgnums} 张图片!")

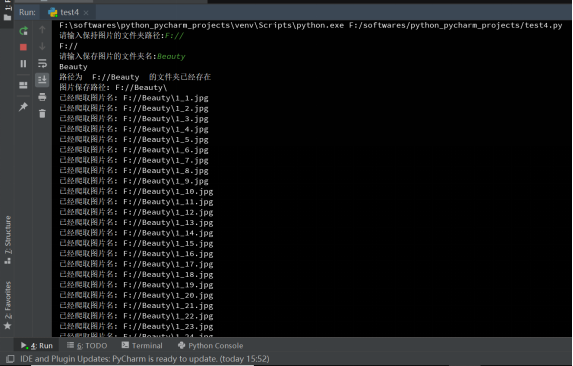

运行截图:

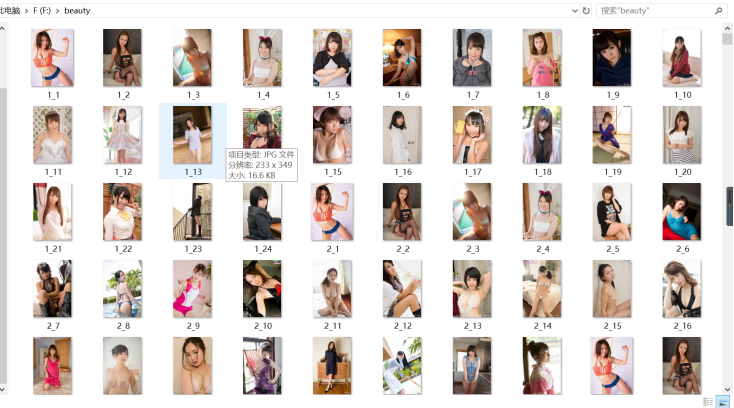

图片名命名规则:存储路径+页码+下划线+图片号+.jpg

图片文件夹截图:

python3爬取全站美眉图片的更多相关文章

- Python爬取全站妹子图片,差点硬盘走火了!

在这严寒的冬日,为了点燃我们的热情,今天小编可是给大家带来了偷偷收藏了很久的好东西.大家要注意点哈,我第一次使用的时候,大意导致差点坏了大事哈! 1.所需库安装 2.网站分析 首先打开妹子图的官网(m ...

- Python3爬取美女妹子图片转载

# -*- coding: utf-8 -*- """ Created on Sun Dec 30 15:38:25 2018 @author: 球球 "&qu ...

- python3爬取动态网站图片

思路: 1.图片放在<image>XXX</image>标签中 2.利用fiddler抓包获取存放图片信息的js文件url 3.利用requests库获取html内容,然后获取 ...

- python3爬取1024图片

这两年python特别火,火到博客园现在也是隔三差五的出现一些python的文章.各种开源软件.各种爬虫算法纷纷开路,作为互联网行业的IT狗自然看的我也是心痒痒,于是趁着这个雾霾横行的周末瞅了两眼,作 ...

- python3爬取女神图片,破解盗链问题

title: python3爬取女神图片,破解盗链问题 date: 2018-04-22 08:26:00 tags: [python3,美女,图片抓取,爬虫, 盗链] comments: true ...

- 如何用python爬虫从爬取一章小说到爬取全站小说

前言 文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. PS:如有需要Python学习资料的小伙伴可以加点击下方链接自行获取http ...

- python 爬虫入门----案例爬取上海租房图片

前言 对于一个net开发这爬虫真真的以前没有写过.这段时间学习python爬虫,今天周末无聊写了一段代码爬取上海租房图片,其实很简短就是利用爬虫的第三方库Requests与BeautifulSoup. ...

- Python3 爬取微信好友基本信息,并进行数据清洗

Python3 爬取微信好友基本信息,并进行数据清洗 1,登录获取好友基础信息: 好友的获取方法为get_friends,将会返回完整的好友列表. 其中每个好友为一个字典 列表的第一项为本人的账号信息 ...

- 使用Python爬虫爬取网络美女图片

代码地址如下:http://www.demodashi.com/demo/13500.html 准备工作 安装python3.6 略 安装requests库(用于请求静态页面) pip install ...

随机推荐

- makefile 通配符了解% $@ $^ $<

把目录下所有文件都编译的命令. 1 all:$(subst .c,.o,$(wildcard *.c)) 2 3 %.o:%.c 4 gcc -o $@ $< 下面是几个特舒符号的意思: $@: ...

- linux 设置git记住密码

linux下: 1.在~/下, touch创建文件 .git-credentials, 用vim编辑此文件,输入: https://{username}:{password}@github.com 注 ...

- react native项目直接全局定义横竖屏幕

这里指的是项目本身为横屏项目,直接全局设置,当然还有其他方法,使用react-native-orientation 全局定义如图: iOS android:

- c# 依赖注入之---反射(转)

详细请看http://www.cnblogs.com/leoo2sk/archive/2009/06/17/1504693.html 定义一个接口,和两个类(实现该接口) IButton: using ...

- 缓存服务Ehcache方案

1 Ehcache简介 在Java项目广泛的使用.它是一个开源的.设计于提高在数据从RDBMS中取出来的高花费.高延迟采取的一种缓存方案.正因为Ehcache具有健壮性(基于java 开发).被认证 ...

- Oracle从入门到精通 限定查询和排序查询的问题

视频课程:李兴华 Oracle从入门到精通视频课程 学习者:阳光罗诺 视频来源:51CTO学院 知识点 SQL语句的执行顺序 限定符号的使用. 具体内容: 如果想要对所选择的数据进行控制,就可以使 ...

- 关于单一网络适配器拓扑TMG

单网络适配器拓扑的功能 在单网络适配器拓扑中可以实现有限的 Forefront TMG 功能,其中包括: 针对 HTTP.HTTPS 和 CERN 代理 FTP 的正向 (CERN) 代理(仅限下载) ...

- Angular4 微信的坑

1.不要重置对象的引用!(重置只应该在组件或服务的初始化时) why:会使页面产生闪烁 2.不要给图片绑定一个空的值或空的图片引用(如果值从服务器异步过来,那应该在初始化时给它一个默认值) why:会 ...

- 沉淀,再出发——在Hadoop集群之上安装hbase

在Hadoop集群之上安装hbase 一.安装准备 首先我们确保在ubuntu16.04上安装了以下的产品,java1.8及其以上,ssh,hadoop集群,其次,我们需要从hbase的官网上下载并安 ...

- Wifi密码破解

Wifi密码破解1:通过字典(暴力)破解WIFI密码 简单破解WEP/WPA/WPA2加密的WIFI密码,平台kali-linux 工具:Aircrack-ng 过程很简单:先抓含有正确密码的握手 ...