【爬虫】-爬取猫眼TOP100

原文崔庆才《python3网络爬虫实战》

本文为自学记录,如有侵权,请联系删除

目标:

熟悉正则表达式,以及爬虫流程

获取猫眼TOP100榜单

1、网站分析

目标站点为http://www.manyan.com/board/4,需要获取网站TOP100榜单的影片名称、主演、上映时间、地区、评分等信息都直接显示在network对应的response中,可解析对应的html进行获取。且从第1页到第二页,URL变成http://maoyan.com/board/4?offset=10,比之前多了参数offset=10,对比第2页第3页发现该参数即为翻页参数。

2、获取首页

实现步骤:定义get_one_page()方法,传入url参数,将抓取的页面结果返回,通过main()方法调用。

# 首页

import requests def get_one_page(url):

# 输入headers信息伪装为浏览器

headers = {

'User-Agent':'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_14_2) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36'

}

response = requests.get(url, headers=headers)

if response.status_code ==200:

return response.text

return None def main():

url = 'http://www.maoyan.com/board/4'

html = get_one_page(url)

print(html) main()

即可把response中的html信息获取下来

2、正则提取

一部电影信息对应的源代码是一个dd的节点

html = '''

<dd>

<i class="board-index board-index-1">1</i>

<a href="/films/1203" title="霸王别姬" class="image-link" data-act="boarditem-click" data-val="{movieId:1203}">

<img src="//s0.meituan.net/bs/?f=myfe/mywww:/image/loading_2.e3d934bf.png" alt="" class="poster-default" />

<img data-src="https://p1.meituan.net/movie/20803f59291c47e1e116c11963ce019e68711.jpg@160w_220h_1e_1c" alt="霸王别姬" class="board-img" />

</a>

<div class="board-item-main">

<div class="board-item-content">

<div class="movie-item-info">

<p class="name"><a href="/films/1203" title="霸王别姬" data-act="boarditem-click" data-val="{movieId:1203}">霸王别姬</a></p>

<p class="star">

主演:张国荣,张丰毅,巩俐

</p>

<p class="releasetime">上映时间:1993-01-01</p> </div>

<div class="movie-item-number score-num">

<p class="score"><i class="integer">9.</i><i class="fraction">5</i></p>

</div> </div>

</div> </dd>

'''

获取排名信息

import re

result = re.search('<dd>.*?board-index.*?>(.*?)</i>', html, re.S)

print(result.group(1))

获取电影图片

tp = re.search('<dd>.*?data-src="(.*?)@.*?c"',html, re.S)

获取电影名称

mc = re.search('<dd>.*?name">.*?>(.*?)</a>',html,re.S)

获取主演

zy = re.search('<dd>.*?star">(.*?)</p>',html,re.S)

获取发布时间

fb = re.search('<dd>.*?releasetime">(.*?)</p>', html ,re.S)

获取评分

pf = re.search('<dd>.*?integer">(.*?)</i>.*?fraction">(.*?)</i>',html,re.S)

全部链接起来

<dd>.*?board-index.*?>(.*?)</i>.*?data-src="(.*?)@.*?c.*?name">.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>.*?integer">(.*?)</i>.*?fraction">(.*?)</i>

这样一个正则表达式可以匹配一个电影的结果,里面匹配了7个信息,接下来通过findall() 方法提取所有的内容。

def parse_one_page(html):

# 把正则表达式编译成一个正则表达式对象,方便复用

pattern = re.compile(

'<dd>.*?board-index.*?>(.*?)</i>.*?data-src="(.*?)@.*?c.*?name">.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>.*?integer">(.*?)</i>.*?fraction">(.*?)</i>',

re.S

)

items = re.findall(pattern, html)

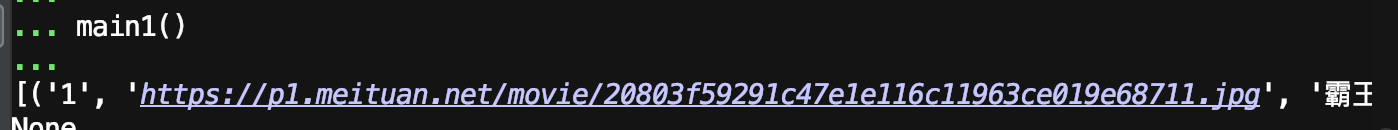

print(items) def main1():

html = '''

<dd>

<i class="board-index board-index-1">1</i>

<a href="/films/1203" title="霸王别姬" class="image-link" data-act="boarditem-click" data-val="{movieId:1203}">

<img src="//s0.meituan.net/bs/?f=myfe/mywww:/image/loading_2.e3d934bf.png" alt="" class="poster-default" />

<img data-src="https://p1.meituan.net/movie/20803f59291c47e1e116c11963ce019e68711.jpg@160w_220h_1e_1c" alt="霸王别姬" class="board-img" />

</a>

<div class="board-item-main">

<div class="board-item-content">

<div class="movie-item-info">

<p class="name"><a href="/films/1203" title="霸王别姬" data-act="boarditem-click" data-val="{movieId:1203}">霸王别姬</a></p>

<p class="star">

主演:张国荣,张丰毅,巩俐

</p>

<p class="releasetime">上映时间:1993-01-01</p> </div>

<div class="movie-item-number score-num">

<p class="score"><i class="integer">9.</i><i class="fraction">5</i></p>

</div> </div>

</div> </dd>

'''

items = parse_one_page(html)

print(items) main1()

结果

3、写入文件

通过JSON库的jumps()实现字典的序列化,并指定ensure_ascii参数为False ,保证输出结果是中文,而不是Unicode编码

def write_to_file(content):

with open('result.txt','w',encoding='utf-8') as f:

f.write(json.jumps(content, ensure_ascii=False)+'\n')

4、分页爬取

if __name__=='__main__':

for i in range(10):

main(offset=i*10)

5、整合代码

# 抓去首页

import requests

import re

import json

import time

from requests.exceptions import RequestException def get_one_page(url):

try:

headers = {

'User-Agent':'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_14_2) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36'

}

response = requests.get(url, headers=headers)

if response.status_code ==200:

return response.text

return None

except RequestException:

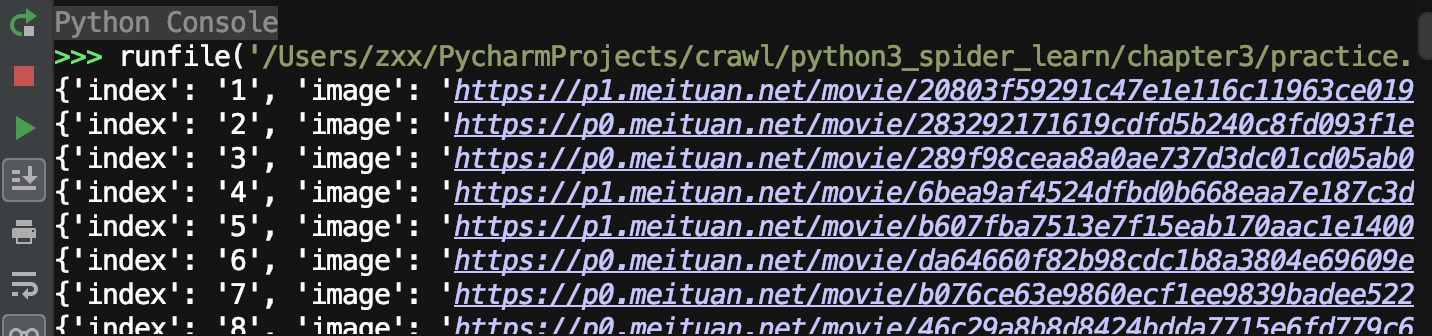

return None def parse_one_page(html):

pattern = re.compile(

'<dd>.*?board-index.*?>(.*?)</i>.*?data-src="(.*?)@.*?c.*?name">.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>.*?integer">(.*?)</i>.*?fraction">(.*?)</i>',

re.S

)

items = re.findall(pattern, html)

for item in items:

yield {

'index':item[0],

'image':item[1],

'title':item[2],

# 去除首尾空格,从第4位开始

'actor':item[3].strip()[3:],

'time': item[4].strip()[5:],

'sorce':item[5]+item[6]

} def write_to_file(content):

with open('result.txt','w',encoding='utf-8') as f:

f.write(json.dumps(content, ensure_ascii=False)+'\n') def main(offset):

url = 'http://www.maoyan.com/board/4?offset=' + str(offset)

html = get_one_page(url)

for item in parse_one_page(html):

print(item)

write_to_file(item) if __name__=='__main__':

for i in range(10):

main(offset=i*10)

time.sleep(1)

结果:

【爬虫】-爬取猫眼TOP100的更多相关文章

- python爬虫:爬取猫眼TOP100榜的100部高分经典电影

1.问题描述: 爬取猫眼TOP100榜的100部高分经典电影,并将数据存储到CSV文件中 2.思路分析: (1)目标网址:http://maoyan.com/board/4 (2)代码结构: (3) ...

- Python 爬取 猫眼 top100 电影例子

一个Python 爬取猫眼top100的小栗子 import json import requests import re from multiprocessing import Pool #//进程 ...

- 使用Beautiful Soup爬取猫眼TOP100的电影信息

使用Beautiful Soup爬取猫眼TOP100的电影信息,将排名.图片.电影名称.演员.时间.评分等信息,提取的结果以文件形式保存下来. import time import json impo ...

- 整理requests和正则表达式爬取猫眼Top100中遇到的问题及解决方案

最近看崔庆才老师的爬虫课程,第一个实战课程是requests和正则表达式爬取猫眼电影Top100榜单.虽然理解崔老师每一步代码的实现过程,但自己敲代码的时候还是遇到了不少问题: 问题1:获取respo ...

- 7.5爬取猫眼Top100电影名单

2018-7-5 20:22:57 还有有一丢丢成就感!以后可以爬取简单网站了!比如妹子图片,只是现在不知道咋下载! 正则还是刚看,要多去用正则!正则很强大的东西! #!/usr/bin/env py ...

- 爬取猫眼TOP100

学完正则的一个小例子就是爬取猫眼排行榜TOP100的所有电影信息 看一下网页结构: 可以看出要爬取的信息在<dd>标签和</dd>标签中间 正则表达式如下: pattern ...

- <scrapy爬虫>爬取猫眼电影top100详细信息

1.创建scrapy项目 dos窗口输入: scrapy startproject maoyan cd maoyan 2.编写item.py文件(相当于编写模板,需要爬取的数据在这里定义) # -*- ...

- python3爬虫爬取猫眼电影TOP100(含详细爬取思路)

待爬取的网页地址为https://maoyan.com/board/4,本次以requests.BeautifulSoup css selector为路线进行爬取,最终目的是把影片排名.图片.名称.演 ...

- Python爬取猫眼top100排行榜数据【含多线程】

# -*- coding: utf-8 -*- import requests from multiprocessing import Pool from requests.exceptions im ...

随机推荐

- [转]ubuntu linux下DNS重启后丢失(不是Network-manager造成的情况)

从网上得知 /etc/resolv.conf中的DNS配置是从/etc/resolvconf/resolv.conf.d/head中加载而来,所以每回改resolv.conf都会失效,在此文件里面已经 ...

- oracle问题:新建了一个PDM文件,建表后生成的sql语句中含有clustered

问题描述 为了在oracle中新增表,在PDM中建表,使用其生成的sql语句,但是建表不能成功,提示 ORA-00906: 缺失左括号 原因是多了clustered 关键字 情景重现 1. 新建一个p ...

- Alpha冲刺 - (8/10)

队名:彳艮彳亍团队 组长博客:戳我进入 作业博客:班级博客本次作业的链接 Part.2 成员汇报 组员1(组长)柯奇豪 过去两天完成了哪些任务 进一步优化代码,结合自己负责的部分修改功能 代码规范完整 ...

- 系统蓝屏stop:ox000007B错误解决方案

解决方法:开机进入bios:BIOS->Advanced->SATA Mode:[AHCI改为ATA或Compatibility],然后F10保存退出. ATA是指硬盘使用IDE兼容模式, ...

- Reporting Service服务SharePoint集成模式安装配置(7、配置SharePoint2010产品)

在第3步安装完成SharePoint2010产品后,没有选择[立即安装产品配置向导],这一小节将单独配置SharePoint2010产品数据库(管理中心). 1)启动SharePoint 2010 产 ...

- [JQuery]ScrollMe滚动特效插件

最近考完试,一切顺利,昨晚闲着无聊把最近要用的一个插件翻译了一下:ScrollMe. (╯‵□′)╯︵┻━┻地址请戳: /* ScrollMe -李明夕翻译(╯‵□′)╯︵┻━┻ */ ScrollM ...

- C#反射(转载)

转载原文出处忘了,一直保存在本地(勿怪) 前期准备 在VS2012中新建一个控制台应用程序(我的命名是ReflectionStudy),这个项目是基于.net 4.0.接着我们打开Program.cs ...

- ansible 常用模块的使用

安装 yum -y install ansible 配置文件/etc/ansible/hosts 模块介绍与使用 ping模块 [root@node1 config]# ansible k8s -m ...

- css3动画(animation)效果3-正方体合成

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- JS关闭页面弹窗提醒

<html> <head><title>JS测试</title> <script type="text/javascript" ...