Scrapy项目 - 源码工程 - 实现豆瓣 Top250 电影信息爬取的爬虫设计

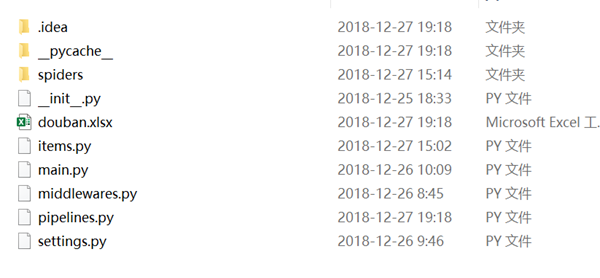

一、项目目录结构

spiders文件夹内包含doubanSpider.py文件,对于项目的构建以及结构逻辑,详见环境搭建篇。

二、项目源码

1.doubanSpider.py

# -*- coding: utf-8 -*-

import scrapy

from douban.items import DoubanItem #创建爬虫类

class DoubanspiderSpider(scrapy.Spider):

name = 'doubanSpider' #爬虫名字

allowed_domains = ['movie.douban.com'] #容许爬虫的作用范围

#定义开始的URL

offset=0

url='https://movie.douban.com/top250?start=' start_urls = [url+str(offset)] #爬虫开始的URL def parse(self, response):

#with open("douban.html","w",encoding="utf-8") as f:

#f.write(str(response.body,encoding="utf-8"))

#继承

item=DoubanItem()

#根节点

movies=response.xpath("//div[@class='info']") for each in movies:

#标题

item['title']=each.xpath(".//span[@class='title'][1]/text()").extract()[0]

#信息

#item['info'] = each.xpath(".//div[@class='bd']/p[@class='']/text()[2]").extract()[0]

item['info'] = each.xpath(".//div[@class='bd']/p[normalize-space(@class)='']/text()[2]").extract()[0] # xinxi

#item['info2'] = each.xpath(".//div[@class='bd']/p[@class='']/text()[2]").extract()[0]

# 评分

item['star'] = each.xpath(".//div[@class='bd']/div[@class='star']/span[@class='rating_num']/text()").extract()[0]

# 简介

quote = each.xpath(".//div[@class='bd']/p[@class='quote']/span/text()").extract() #异常处理

if len(quote)!=0:

item['quote']=quote[0] print(item)

yield item

if self.offset < 255:

self.offset += 25

# 每次处理完一页之后,重新发送下一页请求

# self offset 自增25,同时拼接为新的URL并调用回调函数,self parse 处理response

yield scrapy.Request(self.url + str(self.offset),callback=self.parse) # 通过scrapy 的xpath匹配所有老师的根节点列表集合

#teacher_list = response.xpath("//div[@class='teacher-text']") # 所有列表集合

#teacherItem = [] # 遍历根节点的集合

#for each in teacher_list:

# Item对象来保存数据

#item = GecspiderItem() # 不加extract() 结果为xpath匹配对象

#name = each.xpath('./h4/text()').extract()

# 职位

#title = each.xpath('./h6/text()').extract()

# 个人简介

#info = each.xpath('./p/text()').extract()

#item['name'] = name[0]

#item['title'] = title[0]

#item['info'] = info[0]

# 上一次运行位置暂停继续运行,病返回

# yield item #teacherItem.append(item) # print(name[0])

# print(title[0])

# print(info[0])

#return teacherItem

2.items.py

# -*- coding: utf-8 -*- # Define here the models for your scraped items

#

# See documentation in:

# https://doc.scrapy.org/en/latest/topics/items.html import scrapy class DoubanItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

#标题

title = scrapy.Field()

#信息

info = scrapy.Field()

#评分

star = scrapy.Field()

#简介 quote = scrapy.Field() pingjia = scrapy.Field()

3.main.py

from scrapy import cmdline

#

cmdline.execute("scrapy crawl doubanSpider ".split())

4.pipelines.py

# -*- coding: utf-8 -*- # Define your item pipelines here

#

# Don't forget to add your pipeline to the ITEM_PIPELINES setting

# See: https://doc.scrapy.org/en/latest/topics/item-pipeline.html

import json

from openpyxl import Workbook

class DoubanPipeline(object):

wb = Workbook()

ws = wb.active

# 设置表头

ws.append(['标题','评分','信息','简介']) def process_item(self, item, spider):

# 添加数据

line = [item['title'],item['star'],item['info'],item['quote']]

self.ws.append(line) # 按行添加

self.wb.save('douban.xlsx')

return item

5.settings.py

# -*- coding: utf-8 -*- # Scrapy settings for douban project

#

# For simplicity, this file contains only settings considered important or

# commonly used. You can find more settings consulting the documentation:

#

# https://doc.scrapy.org/en/latest/topics/settings.html

# https://doc.scrapy.org/en/latest/topics/downloader-middleware.html

# https://doc.scrapy.org/en/latest/topics/spider-middleware.html BOT_NAME = 'douban' SPIDER_MODULES = ['douban.spiders']

NEWSPIDER_MODULE = 'douban.spiders' # Crawl responsibly by identifying yourself (and your website) on the user-agent

USER_AGENT = 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/71.0.3578.98 Safari/537.36' # Obey robots.txt rules

#ROBOTSTXT_OBEY = True # Configure maximum concurrent requests performed by Scrapy (default: 16)

#CONCURRENT_REQUESTS = 32 # Configure a delay for requests for the same website (default: 0)

# See https://doc.scrapy.org/en/latest/topics/settings.html#download-delay

# See also autothrottle settings and docs

#DOWNLOAD_DELAY = 3

# The download delay setting will honor only one of:

#CONCURRENT_REQUESTS_PER_DOMAIN = 16

#CONCURRENT_REQUESTS_PER_IP = 16 # Disable cookies (enabled by default)

#COOKIES_ENABLED = False # Disable Telnet Console (enabled by default)

#TELNETCONSOLE_ENABLED = False # Override the default request headers:

#DEFAULT_REQUEST_HEADERS = {

# 'Accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8',

# 'Accept-Language': 'en',

#} # Enable or disable spider middlewares

# See https://doc.scrapy.org/en/latest/topics/spider-middleware.html

#SPIDER_MIDDLEWARES = {

# 'douban.middlewares.DoubanSpiderMiddleware': 543,

#} # Enable or disable downloader middlewares

# See https://doc.scrapy.org/en/latest/topics/downloader-middleware.html

#DOWNLOADER_MIDDLEWARES = {

# 'douban.middlewares.DoubanDownloaderMiddleware': 543,

#} # Enable or disable extensions

# See https://doc.scrapy.org/en/latest/topics/extensions.html

#EXTENSIONS = {

# 'scrapy.extensions.telnet.TelnetConsole': None,

#} # Configure item pipelines

# See https://doc.scrapy.org/en/latest/topics/item-pipeline.html

ITEM_PIPELINES = {

'douban.pipelines.DoubanPipeline': 300,

} # Enable and configure the AutoThrottle extension (disabled by default)

# See https://doc.scrapy.org/en/latest/topics/autothrottle.html

#AUTOTHROTTLE_ENABLED = True

# The initial download delay

#AUTOTHROTTLE_START_DELAY = 5

# The maximum download delay to be set in case of high latencies

#AUTOTHROTTLE_MAX_DELAY = 60

# The average number of requests Scrapy should be sending in parallel to

# each remote server

#AUTOTHROTTLE_TARGET_CONCURRENCY = 1.0

# Enable showing throttling stats for every response received:

#AUTOTHROTTLE_DEBUG = False # Enable and configure HTTP caching (disabled by default)

# See https://doc.scrapy.org/en/latest/topics/downloader-middleware.html#httpcache-middleware-settings

#HTTPCACHE_ENABLED = True

#HTTPCACHE_EXPIRATION_SECS = 0

#HTTPCACHE_DIR = 'httpcache'

#HTTPCACHE_IGNORE_HTTP_CODES = []

#HTTPCACHE_STORAGE = 'scrapy.extensions.httpcache.FilesystemCacheStorage'

Scrapy项目 - 源码工程 - 实现豆瓣 Top250 电影信息爬取的爬虫设计的更多相关文章

- Scrapy项目 - 数据简析 - 实现豆瓣 Top250 电影信息爬取的爬虫设计

一.数据分析截图(weka数据分析截图 ) 本例实验,使用Weka 3.7对豆瓣电影网页上所罗列的上映电影信息,如:标题.主要信息(年份.国家.类型)和评分等的信息进行数据分析,Weka 3.7数据分 ...

- Scrapy项目 - 实现豆瓣 Top250 电影信息爬取的爬虫设计

通过使Scrapy框架,掌握如何使用Twisted异步网络框架来处理网络通讯的问题,进行数据挖掘和对web站点页面提取结构化数据,可以加快我们的下载速度,也可深入接触各种中间件接口,灵活的完成各种需求 ...

- Scrapy项目 - 数据简析 - 实现斗鱼直播网站信息爬取的爬虫设计

一.数据分析截图(weka数据分析截图 2-3个图,作业文字描述) 本次将所爬取的数据信息,如:房间数,直播类别和人气,导入Weka 3.7工具进行数据分析.有关本次的数据分析详情详见下图所示: ...

- Scrapy项目 - 实现百度贴吧帖子主题及图片爬取的爬虫设计

要求编写的程序可获取任一贴吧页面中的帖子链接,并爬取贴子中用户发表的图片,在此过程中使用user agent 伪装和轮换,解决爬虫ip被目标网站封禁的问题.熟悉掌握基本的网页和url分析,同时能灵活使 ...

- Scrapy项目 - 实现斗鱼直播网站信息爬取的爬虫设计

要求编写的程序可爬取斗鱼直播网站上的直播信息,如:房间数,直播类别和人气等.熟悉掌握基本的网页和url分析,同时能灵活使用Xmind工具对Python爬虫程序(网络爬虫)流程图进行分析. 一.项目 ...

- Scrapy项目 - 实现腾讯网站社会招聘信息爬取的爬虫设计

通过使Scrapy框架,进行数据挖掘和对web站点页面提取结构化数据,掌握如何使用Twisted异步网络框架来处理网络通讯的问题,可以加快我们的下载速度,也可深入接触各种中间件接口,灵活的完成各种需求 ...

- python 豆瓣top250电影的爬取

我们先看一下豆瓣的robot.txt 然后我们查看top250的网页链接和源代码 通过对比不难发现网页间只是start数字发生了变化. 我们可以知道电影内容都存在ol标签下的 div class属性为 ...

- Scrapy项目 - 项目源码 - 实现腾讯网站社会招聘信息爬取的爬虫设计

1.tencentSpider.py # -*- coding: utf-8 -*- import scrapy from Tencent.items import TencentItem #创建爬虫 ...

- Scrapy项目 - 数据简析 - 实现腾讯网站社会招聘信息爬取的爬虫设计

一.数据分析截图 本例实验,使用Weka 3.7对腾讯招聘官网中网页上所罗列的招聘信息,如:其中的职位名称.链接.职位类别.人数.地点和发布时间等信息进行数据分析,详见如下图: 图1-1 Weka ...

随机推荐

- C++ 线程安全的单例模式总结

什么是线程安全? 在拥有共享数据的多条线程并行执行的程序中,线程安全的代码会通过同步机制保证各个线程都可以正常且正确的执行,不会出现数据污染等意外情况. 如何保证线程安全? 给共享的资源加把锁,保证每 ...

- 技术改变生活| 免费看VIP视频,屏蔽广告,解锁新姿势!

说到这个,我就忍不住的要介绍一下今天的主角 Tampermonkey 了.Tampermonkey 是一款免费的浏览器扩展和最为流行的用户脚本管理器,它适用于Chrome, Microsoft Edg ...

- Java Builder 模式,你搞明白了么?

Builder 模式定义 Builder 模式中文叫作建造者模式,又叫生成器模式,它属于对象创建型模式,是将一个复杂对象的构建与它的表示分离,使得同样的构建过程可以创建不同的表示.建造者模式是一步一步 ...

- [翻译] .NET Core 3.0 Preview 9 发布

原文: Announcing .NET Core 3.0 Preview 9 今天,我们宣布推出 .NET Core 3.0 Preview 9.就像 Preview 8 一样,我们专注于打磨 .NE ...

- 安装python的第三方库pillow

参考:http://jingyan.baidu.com/article/ff42efa929e6c8c19f220254.html 用Python做图像处理时,需要用到PIL(图像处理库).但是PIL ...

- cf--703--A-- Mishka and Game

题目链接:http://codeforces.com/problemset/problem/703/A Mishka is a little polar bear. As known, little ...

- MyBatis 传入List集合作为条件查询数据

使用的是SSM框架,数据库是MySQL,做查询的时候传入List集合,使用SQL语句的in方式查询数据 主要有两点问题:我的List集合是利用的另外一个语句查询出来的,传入参数是int类型,返回值是i ...

- 014 Python基本图形绘制小结

目录 一.Python基本语法元素 1.1 温度转换 二.Python基本图形绘制 2.1 Python蟒蛇绘制 一.Python基本语法元素 缩进.注释.命名.变量.保留字 数据类型.字符串. 整数 ...

- Invalid bound statement (not found): com.taotao.mapper.TbItemMapper.selectByExample问题解决

最近在做一个关于ssm框架整合的项目,但是今天正合完后出现了问题: Invalid bound statement (not found): com.taotao.mapper.TbItemMappe ...

- 实验吧CTF练习题---WEB---FALSE解析

实验吧web之FALSE 地址:http://www.shiyanbar.com/ctf/1787 flag值:CTF{t3st_th3_Sha1} 解题步骤: 1.点开题目链接,观察题意 2.题 ...