在Ubuntu上搭建Hadoop群集

前面我搭建的Hadoop都是单机伪分布式的,并不能真正感受到Hadoop的最大特点,分布式存储和分布式计算。所以我打算在虚拟机中同时开启3台机器,实现分布式的Hadoop群集。

1.准备3台Ubuntu Server

1.1复制出3台虚拟机

我们可以用之前编译和安装好Hadoop的虚拟机作为原始版本,在VirtualBox中复制三台新的虚拟机出来,也可以完全重新安装一台全新的Ubuntu Server,然后在VirtualBox中复制出2台,就变成了3台虚拟机。

1.2修改主机名

主机名保存在/etc/hostname文件中,我们可以运行

sudo vi /etc/hostname

命令,然后为三台机器起不同的名字,这里我们就分别起名:

master

slave01

slave02

1.3修改为固定IP

Ubuntu的IP地址保存到/etc/network/interfaces文件中,我们需要为3台虚拟机分别改为固定的IP,这里我的环境是在192.168.100.*网段,所以我打算为master改为192.168.100.40,操作如下:

sudo vi /etc/network/interfaces

然后可以看到每个网卡的配置,我这里网卡名是叫enp0s3,所以我改对应的内容为:

# The primary network interface

auto enp0s3

iface enp0s3 inet static

address 192.168.100.40

gateway 192.168.100.1

netmask 255.255.255.0

对slave01改为192.168.100.41,slave02改为192.168.100.42。

1.4修改Hosts

由于三台虚拟机是使用的默认的DNS,所以我们需要增加hosts记录,才能直接用名字相互访问。hosts文件和Windows的Hosts文件一样,就是一个域名和ip的对应表。

编辑hosts文件:

sudo vi /etc/hosts

增加三条记录:

192.168.100.40 master

192.168.100.41 slave01

192.168.100.42 slave02

1.5重启

这一切修改完毕后我们重启一下三台机器,然后可以试着各自ping master,ping slave01 ping slave02看能不能通。按照上面的几步操作,应该是没有问题的。

1.6新建用户和组

这一步不是必须的,就采用安装系统后的默认用户也是可以的。

sudo addgroup hadoop

sudo adduser --ingroup hadoop hduser

为了方便,我们还可以把hduser添加到sudo这个group中,那么以后我们在hduser下就可以运行sudo xxx了。

sudo adduser hduser sudo

切换到hduser:

su – hduser

1.7配置无密码访问SSH

在三台机器上首先安装好SSH

sudo apt-get install ssh

然后运行

ssh-keygen

默认路径,无密码,会在当前用户的文件夹中产生一个.ssh文件夹。

接下来我们先处理master这台机器的访问。我们进入这个文件夹,

cd .ssh

然后允许无密码访问,执行:

cp id_rsa.pub authorized_keys

然后要把slave01和slave02的公钥传给master,进入slave01

scp ~/.ssh/id_rsa.pub hduser@master:/home/hduser/.ssh/id_rsa.pub.slave01

然后在slave02上也是:

scp ~/.ssh/id_rsa.pub hduser@master:/home/hduser/.ssh/id_rsa.pub.slave02

将 slave01 和 slave02的公钥信息追加到 master 的 authorized_keys文件中,切换到master机器上,执行:

cat id_rsa.pub.slave01 >> authorized_keys

cat id_rsa.pub.slave02 >> authorized_keys

现在authorized_keys就有3台机器的公钥,可以无密码访问任意机器。只需要将authorized_keys复制到slave01和slave02即可。在master上执行:

scp authorized_keys hduser@slave01:/home/hduser/.ssh/authorized_keys

scp authorized_keys hduser@slave02:/home/hduser/.ssh/authorized_keys

最后我们可以测试一下,在master上运行

ssh slave01

如果没有提示输入用户名密码,而是直接进入,就说明我们配置成功了。

同样的方式测试其他机器的无密码ssh访问。

2.安装相关软件和环境

如果是直接基于我们上一次安装的单机Hadoop做的虚拟机,那么这一步就可以跳过了,如果是全新的虚拟机,那么就需要做如下操作:

2.1配置apt source,安装JDK

sudo vi /etc/apt/sources.list

打开后把里面的us改为cn,如果已经是cn的,就不用再改了。然后运行:

sudo apt-get update

sudo apt-get install default-jdk

2.2下载并解压Hadoop

去Hadoop官网,找到最新稳定版的Hadoop下载地址,然后下载。当然如果是X64的Ubuntu,我建议还是本地编译Hadoop,具体编译过程参见这篇文章。

wget http://www.apache.org/dyn/closer.cgi/hadoop/common/hadoop-2.7.3/hadoop-2.7.3.tar.gz

下载完毕后然后是解压

tar xvzf hadoop-2.7.3.tar.gz

最后将解压后的Hadoop转移到正式的目录下,这里我们打算使用/usr/local/hadoop目录,所以运行命令:

sudo mv hadoop-2.7.3 /usr/local/hadoop

3.配置Hadoop

3.1配置环境变量

编辑.bashrc或者/etc/profile文件,增加如下内容:

# Java Env

export JAVA_HOME=/usr/lib/jvm/java-7-openjdk-amd64

export JRE_HOME=$JAVA_HOME/jre

export CLASSPATH=.:$JAVA_HOME/lib/tools.jar:$JAVA_HOME/lib/dt.jar:$JRE_HOME/lib

export PATH=$PATH:$JAVA_HOME/bin:$JRE_HOME/bin

# Hadoop Env

export HADOOP_HOME=/usr/local/hadoop

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

3.2进入Hadoop的配置文件夹:

cd /usr/local/hadoop/etc/hadoop

(1)修改hadoop-env.sh

增加如下配置:

export JAVA_HOME=/usr/lib/jvm/java-7-openjdk-amd64

export HADOOP_PREFIX=/usr/local/hadoop

(2)修改core-site.xml

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/hduser/temp</value>

<description>A base for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

</configuration>

这里我们指定了一个临时文件夹的路径,这个路径必须存在,而且有权限访问,所以我们在hduser下创建一个temp目录。

(3)hdfs-site.xml

设置HDFS复制的数量

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

</configuration>

(4)mapred-site.xml

这里可以设置MapReduce的框架是YARN:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

(5)配置YARN环境变量,打开yarn-env.sh

里面有很多行,找到JAVA_HOME,设置:

export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64

(6)配置yarn-site.xml

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

</configuration>

(7)最后打开slaves文件,设置有哪些slave节点。

由于我们设置了3份备份,把master即是Name Node又是Data Node,所以我们需要设置三行:

master

slave01

slave02

3.3配置slave01和slave02

在slave01和slave02上做前面3.1 3.2相同的设置。

一模一样的配置,这里不再累述。

4.启动Hadoop

回到Master节点,我们需要先运行

hdfs namenode –format

格式化NameNode。

然后执行

start-all.sh

这里Master会启动自己的服务,同时也会启动slave01和slave02上的对应服务。

启动完毕后我们在master上运行jps看看有哪些进程,这是我运行的结果:

2194 SecondaryNameNode

2021 DataNode

1879 NameNode

3656 Jps

2396 ResourceManager

2541 NodeManager

切换到slave01,运行jps,可以看到如下结果:

1897 NodeManager

2444 Jps

1790 DataNode

切换到slave02也是一样的有这些服务。

那么说明我们的服务网都已经启动成功了。

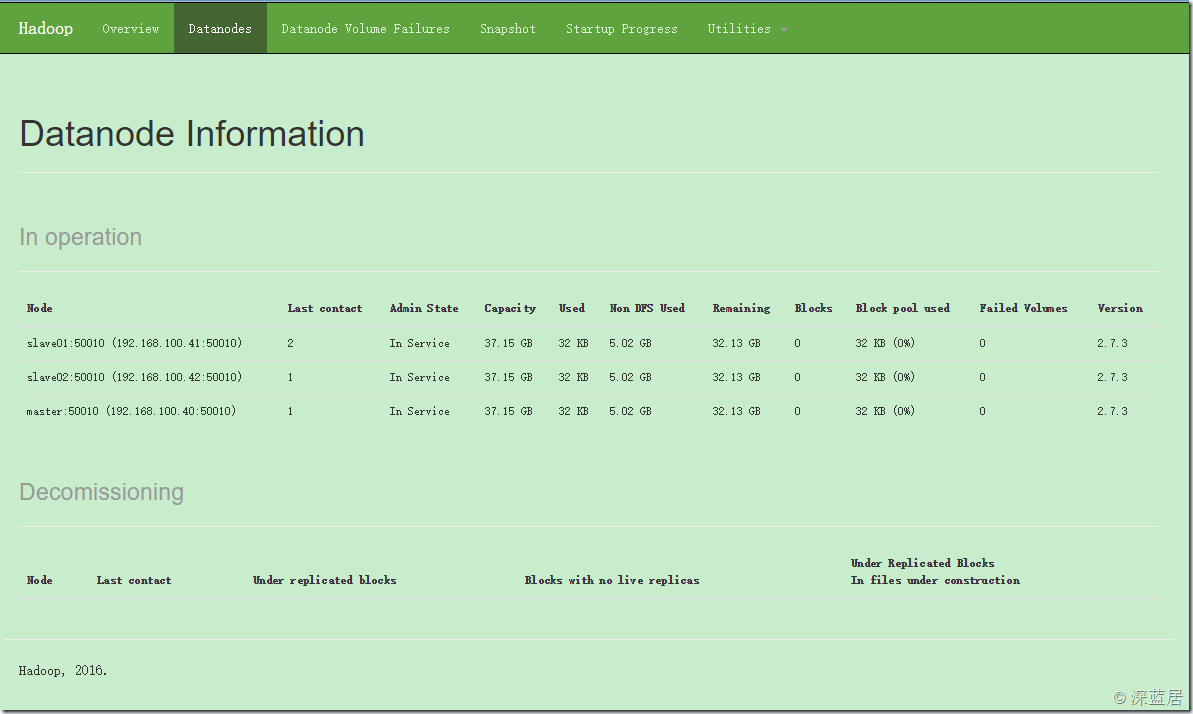

现在我们在浏览器中访问:

应该可以看到Hadoop服务已经启动,切换到Datanodes可以看到我们启动的3台数据节点:

在Ubuntu上搭建Hadoop群集的更多相关文章

- Ubuntu上搭建Hadoop环境(单机模式+伪分布模式)

首先要了解一下Hadoop的运行模式: 单机模式(standalone) 单机模式是Hadoop的默认模式.当首次解压Hadoop的源码包时,Hadoop无法了解硬件安装环境,便保守地选 ...

- Ubuntu上搭建Hadoop环境(单机模式+伪分布模式) (转载)

Hadoop在处理海量数据分析方面具有独天优势.今天花了在自己的Linux上搭建了伪分布模式,期间经历很多曲折,现在将经验总结如下. 首先,了解Hadoop的三种安装模式: 1. 单机模式. 单机模式 ...

- Ubuntu上搭建Hadoop环境(单机模式+伪分布模式)【转】

[转自:]http://blog.csdn.net/hitwengqi/article/details/8008203 最近一直在自学Hadoop,今天花点时间搭建一个开发环境,并整理成文. 首先要了 ...

- 在 Ubuntu 上搭建 Hadoop 分布式集群 Eclipse 开发环境

一直在忙Android FrameWork,终于闲了一点,利用空余时间研究了一下Hadoop,并且在自己和同事的电脑上搭建了分布式集群,现在更新一下blog,分享自己的成果. 一 .环境 1.操作系统 ...

- Ubuntu上搭建Watir-Webdriver与Cucumber环境

本文主要演示如何在Ubuntu上搭建Watir-Webdriver与Cucumber环境,用于自动化测试. 1. Ubuntu环境 A. 安装 因为我的工作机是Windows,所以采用虚拟机的方式使用 ...

- Ubuntu上搭建Git服务器

下面我们就看看,如何在Ubuntu上搭建Git服务器.我们使用VMware虚拟机安装两台Ubantu系统,分别命名为gitServer和gitClient_01. 1.安装OpenSSH并配置SSH无 ...

- 在ubuntu上搭建交叉编译环境---arm-none-eabi-gcc

最近要开始搞新项目,基于arm的高通方案的项目. 那么,如何在ubuntu上搭建这个编译环境呢? 1.找到相关的安装包:http://download.csdn.net/download/storea ...

- 在Ubuntu上搭建kindle gtk开发环境

某个角度上说,kindle很类似android,同样的Linux内核,同样的Java用户层.不过kindle更注重简单.节能.稳定.Amazon一向认为,功能过多会分散人们阅读时候的注意力. Kind ...

- Ubuntu上搭建GPU服务器

1.安装显卡驱动 2.安装CUDA 3.安装cuDNN 下载: 根据显卡类型以及操作系统,选定CUDA版本和语言设置,下载对应的显卡驱动. 驱动下载地址 安装 $ sudo ./NVIDIA-Linu ...

随机推荐

- 在网上摘录一段对于IOC的解析,比较直观,大家观摩观摩

其实IoC非常简单,基本思想就是面向接口的编程,只是老外给起了个名字名充分利用之. 简单的说,传统模式下,如果你要用钱,你需要去银行取,IoC模式下,银联在你家安了一个取款机,你直接找取款机要钱就可以 ...

- JavaScript随笔2

JavaScript的组成:ECMA.DOM.BOM闭包,子函数可以使用父函数的局部变量 函数:arguments是个参数数组oDiv.style.width:只能操作行间的样式.在IE下oDiv.c ...

- AOP概述

了解AOP之前,先大概讲述一下SOC: Soc:Separation of concerns 关注分离点, 在不同的场景SOC有着不同的含义 Soc是一个过程:Soc是一个将功能点分解以尽量减小功能交 ...

- Storm介绍及与Spark Streaming对比

Storm介绍 Storm是由Twitter开源的分布式.高容错的实时处理系统,它的出现令持续不断的流计算变得容易,弥补了Hadoop批处理所不能满足的实时要求.Storm常用于在实时分析.在线机器学 ...

- 1.C#WinForm基础制作简单计算器

利用c#语言编写简单计算器: 核心知识点: MessageBox.Show(Convert.ToString(comboBox1.SelectedIndex));//下拉序号 MessageBox.S ...

- CentOS7下mysql5.6修改默认编码

参考原文教程:Centos7下修改mysql5.6编码方式 解决网站中文显示问号 解决办法: 修改MySQL数据库字符编码为UTF-8,UTF-8包含全世界所有国家需要用到的字符,是国际编码. 具体操 ...

- C++异常处理:try,catch,throw,finally的用法

写在前面 所谓异常处理,即让一个程序运行时遇到自己无法处理的错误时抛出一个异常,希望调用者可以发现处理问题. 异常处理的基本思想是简化程序的错误代码,为程序键壮性提供一个标准检测机制. 也许我们已经使 ...

- WPF入门:数据绑定

上一篇我们将XAML大概做了个了解 ,这篇将继续学习WPF数据绑定的相关内容 数据源与控件的Binding Binding作为数据传送UI的通道,通过INotityPropertyChanged接口的 ...

- 通过向页面写html代码导出excel

//excel文件名 string filename = "考勤汇总"; StringBuilder ExcelHtml = new StringBuilder(); ExcelH ...

- bootstrap(关于栅格布局)

栅格系统是通过行(.row)与列(column)的组合一起来创建页面布局的,所以只有列(column)可以作为行(row)的直接子元素,我们所要写的内容可以放在列里(column),不过在行的外层还需 ...