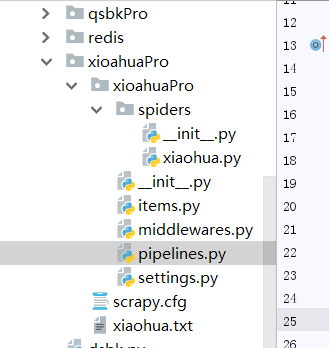

利用scrapy爬取文件后并基于管道化的持久化存储

我们在pycharm上爬取

首先我们可以在本文件打开命令框或在Terminal下创建

scrapy startproject xiaohuaPro ------------创建文件

scrapy genspider xiaohua www.xxx.com ----------创建执行文件

一.首先我们要进行数据的爬取

import scrapy

from xioahuaPro.items import XioahuaproItem class XiaohuaSpider(scrapy.Spider):

name = 'xiaohua'

start_urls=['http://www.521609.com/daxuemeinv/']

#生成一个通用的url模板

url = 'http://www.521609.com/daxuemeinv/list8%d.html'

pageNum =1 def parse(self, response):

li_list=response.xpath('//div[@class="index_img list_center"]/ul/li')

for li in li_list:

name = li.xpath('./a[2]/text() | ./a[2]/b/text()').extract_first()

img_url = 'http://www.521609.com'+li.xpath('./a[1]/img/@src').extract_first()

#实例化一个item类型的对象

item = XioahuaproItem()

item['name'] = name

item['img_url'] = img_url

#item提交给管道

yield item

# 对其他页码的url进行手动i请求的发送

if self.pageNum <= 24: ------爬取的页数

self.pageNum += 1

new_url = format(self.url%self.pageNum)

yield scrapy.Request(url=new_url,callback=self.parse)

之后再items.py文件下为item对象设置属性

将爬取到的所有信息全部设置为item的属性

# -*- coding: utf-8 -*- # Define here the models for your scraped items

#

# See documentation in:

# https://doc.scrapy.org/en/latest/topics/items.html import scrapy class XioahuaproItem(scrapy.Item):

# define the fields for your item here like:

name = scrapy.Field()

img_url = scrapy.Field()

二.写入pipelines.py内容

首先写入到自定义的文件里去

作用:将解析到的数据存储到某一个平台中。

import pymysql

from redis import Redis

class XioahuaproPipeline(object):

fp = None

def open_spider(self,spider):

print('开始爬虫!')

self.fp = open('./xiaohua.txt','w',encoding='utf-8')

#作用:实现持久化存储的操作

#该方法的item参数就可以接收爬虫文件提交过来的item对象

#该方法每接收一个item就会被调用一次(调用多次)

def process_item(self, item, spider):

name = item['name']

img_url = item['img_url']

self.fp.write(name+':'+img_url+'\n')

#返回值的作用:就是将item传递给下一个即将被执行的管道类

return item

#

def close_spider(self,spider):

print('结束爬虫!')

self.fp.close()

#

写到数据库里面,我们要在数据库里面创建个表(将mysql和redis都启动)

class MysqlPipeline(object):

conn = None

cursor = None

def open_spider(self, spider):

#解决数据库字段无法存储中文处理:alter table tableName convert to charset utf8;

self.conn = pymysql.Connect(host='127.0.0.1',port=3306,user='root',password='',db='test',charset='utf8')

print(self.conn)

def process_item(self, item, spider):

self.cursor = self.conn.cursor()

try:

self.cursor.execute('insert into xiaohua values ("%s","%s")'%(item['name'],item['img_url']))

self.conn.commit()

except Exception as e:

print(e)

self.conn.rollback()

return item

def close_spider(self, spider):

self.cursor.close()

self.conn.close()

在相同的文件下创建redis类写入数据

class RedisPipeline(object):

conn = None

def open_spider(self, spider):

self.conn = Redis(host='127.0.0.1',port=6379)

print(self.conn)

def process_item(self, item, spider):

dic = {

'name':item['name'],

'img_url':item['img_url']

}

print(str(dic))

self.conn.lpush('xiaohua',str(dic))

return item

def close_spider(self, spider):

pass

三.更改配置文件,在settings.py里面

#添加上这行代码

USER_AGENT = 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.86 Safari/537.36' # Obey robots.txt rules

ROBOTSTXT_OBEY = False -----改成False

ITEM_PIPELINES = {

'xioahuaPro.pipelines.XioahuaproPipeline': 300, ---对应文件

# 'xioahuaPro.pipelines.MysqlPipeline': 301, ----对应数据库

# 'xioahuaPro.pipelines.RedisPipeline': 302, -----对应redis

}

LOG_LEVEL = 'ERROR'

# CRITICAL --严重错误

#ERROR ---一般错误

#WARNING ---警告信息

#INFO ---一般信息

#DEBUG --调试信息

然后我们在终端去指定爬虫程序

scrapy crawl 名字(name对应的值)

利用scrapy爬取文件后并基于管道化的持久化存储的更多相关文章

- 利用Scrapy爬取所有知乎用户详细信息并存至MongoDB

欢迎大家关注腾讯云技术社区-博客园官方主页,我们将持续在博客园为大家推荐技术精品文章哦~ 作者 :崔庆才 本节分享一下爬取知乎用户所有用户信息的 Scrapy 爬虫实战. 本节目标 本节要实现的内容有 ...

- 利用scrapy爬取腾讯的招聘信息

利用scrapy框架抓取腾讯的招聘信息,爬取地址为:https://hr.tencent.com/position.php 抓取字段包括:招聘岗位,人数,工作地点,发布时间,及具体的工作要求和工作任务 ...

- 利用 Scrapy 爬取知乎用户信息

思路:通过获取知乎某个大V的关注列表和被关注列表,查看该大V和其关注用户和被关注用户的详细信息,然后通过层层递归调用,实现获取关注用户和被关注用户的关注列表和被关注列表,最终实现获取大量用户信息. 一 ...

- 爬虫实战--利用Scrapy爬取知乎用户信息

思路: 主要逻辑图:

- 以豌豆荚为例,用 Scrapy 爬取分类多级页面

本文转载自以下网站:以豌豆荚为例,用 Scrapy 爬取分类多级页面 https://www.makcyun.top/web_scraping_withpython17.html 需要学习的地方: 1 ...

- python scrapy爬取HBS 汉堡南美航运公司柜号信息

下面分享个scrapy的例子 利用scrapy爬取HBS 船公司柜号信息 1.前期准备 查询提单号下的柜号有哪些,主要是在下面的网站上,输入提单号,然后点击查询 https://www.hamburg ...

- 【转载】教你分分钟学会用python爬虫框架Scrapy爬取心目中的女神

原文:教你分分钟学会用python爬虫框架Scrapy爬取心目中的女神 本博文将带领你从入门到精通爬虫框架Scrapy,最终具备爬取任何网页的数据的能力.本文以校花网为例进行爬取,校花网:http:/ ...

- Scrapy爬取小说简单逻辑

Scrapy爬取小说简单逻辑 一 准备工作 1)安装Python 2)安装PIP 3)安装scrapy 4)安装pywin32 5)安装VCForPython27.exe ........... 具体 ...

- Scrapy爬取Ajax(异步加载)网页实例——简书付费连载

这两天学习了Scrapy爬虫框架的基本使用,练习的例子爬取的都是传统的直接加载完网页的内容,就想试试爬取用Ajax技术加载的网页. 这里以简书里的优选连载网页为例分享一下我的爬取过程. 网址为: ht ...

随机推荐

- web前端学习(三)css学习笔记部分(6)-- 选择器详解

9.选择器详解 9.1 属性选择器 CSS3 属性选择器,在 CSS3 中,追加了三个属性选择器分别为:[att*=val].[att^=val]和[att$=val],使得属性选择器有了通配符的概 ...

- hdu 1251 统计难题(trie树入门)

统计难题 Time Limit: 4000/2000 MS (Java/Others) Memory Limit: 131070/65535 K (Java/Others)Total Submi ...

- nginx反项代理的简单配置

在ubuntu 16.04下安装nginx, apt-get install nginx就可以了. 然后安装了node, npm, 写了个简单的main.js,启动了一个http,并监听 8888 然 ...

- yii常用操作数据

yii常用操作数据.php <?php defined('YII_DEBUG') or define('YII_DEBUG', true); //当在调试模式下,应用会保留更多日志信息,如果抛出 ...

- 2018-5-4-WPF-获得触摸精度和触摸点

title author date CreateTime categories WPF 获得触摸精度和触摸点 lindexi 2018-05-04 21:11:51 +0800 2018-5-4 21 ...

- Dubbo+JStorm

Dubbo,是阿里巴巴服务化治理的核心框架,并被广泛应用于阿里巴巴集团的各成员站点.阿里巴巴近几年对开源社区的贡献不论在国内还是国外都是引人注目的,比如:JStorm捐赠给Apache并加入Apach ...

- 盘点Apache毕业的11个顶级项目

自1999年成立至今,Apache 软件基金会已成功建立起自己强大的生态圈.其社区涌现了非常多优秀的开源项目,同时有越来越多国内外项目走向这个国际开源社区进行孵化.据悉,目前所有的 Apache 项目 ...

- iOS将image转90,180,270度的方法

http://blog.sina.com.cn/s/blog_6602ffbc0101ckx3.html 这里要分享的是将image旋转,而不是将imageView旋转,原理就是使用quartz2D来 ...

- Person Re-identification 系列论文笔记(七):PCB+RPP

Beyond Part Models: Person Retrieval with Refined Part Pooling Sun Y, Zheng L, Yang Y, et al. Beyond ...

- TCPThree_C杯 Day2

T1 我已经被拉格朗日插值蒙蔽了双眼,变得智障无比. 第一反应就是拉格朗日插值,然后就先放下了它. 模数那么小,指数那么大,这是一套noip模拟题,拉格朗日,你脑袋秀逗了? 无脑暴力20分贼开心. 正 ...