TensorFlow笔记-03-张量,计算图,会话

TensorFlow笔记-03-张量,计算图,会话

- 搭建你的第一个神经网络,总结搭建八股

- 基于TensorFlow的NN:用张量表示数据,用计算图搭建神经网络,用会话执行计算图,优化线上的权重(参数),得到模型

- 张量(tensor):多维数组(列表)

- 阶:表示张量的维数

·· 维 数 ···· 阶 ········· 名 字 ········· 例 子 ············

·· 0-D ······ 0 ····· 标量 scalar ···· s=1 2 3

·· 1-D ······ 0 ····· 向量 vector ···· s=[1,2,3]

·· 2-D ······ 0 ····· 矩阵 matrix ···· s=[ [1,2,3], [4,5,6],[7,8,9] ]

·· n-D ······ 0 ····· 标量 tensor ···· s=[[[[[....n个

- 张量可以表示0阶到n阶的数组(列表)

- **数据类型:Tensorflow 的数据类型有 tf.float32,tf.int32 等

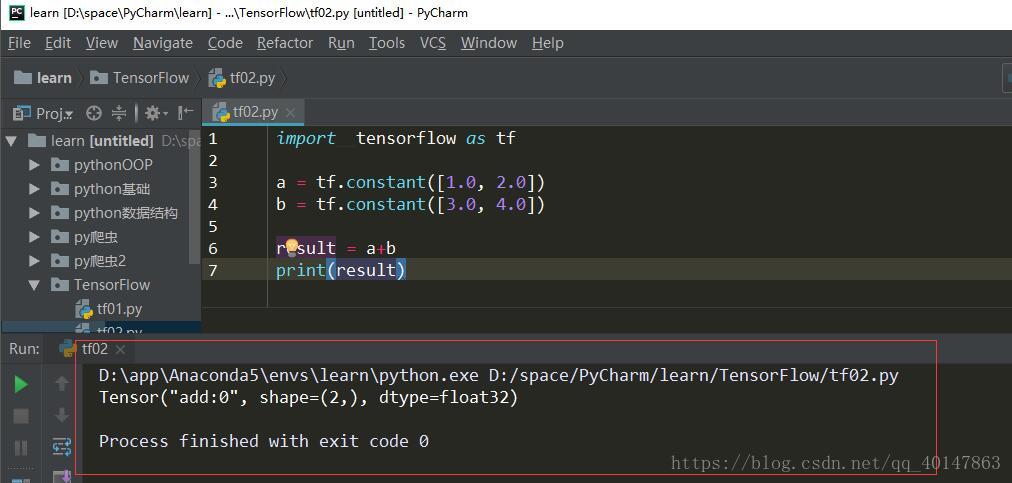

案例:两个张量的加法

# 两个张量的加法

import tensorflow as tf

a = tf.constant([1.0, 2.0])

b = tf.constant([3.0, 4.0])

result = a+b

print(result)

运行结果:

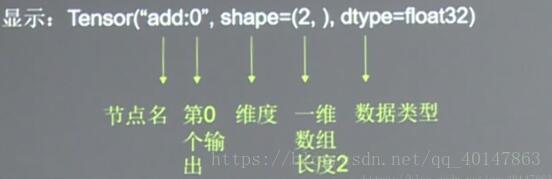

- 结果分析:

计算图

计算图(Graph):搭建神经网络的计算过程,是承载一个或多个计算机结点的一张图,只搭建网络,不运算

这里要提到另一个概念:神经元 (不是很好理解,慢慢就懂了)

神经网络的基本模型的神经元,神经元的基本模型其实就是数学中的乘加运算

我们搭建如下计算图:

X1,X2 表示输入,W1,W2分别是X1到X2的权重

该计算图表示:y = X1W1 + X2W2

(不能理解就记住,该计算图表示上面的这种含义)

# 两个张量的加法

import tensorflow as tf

# x 是一个一行两列的张量

x = tf.constant([[1.0, 2.0]])

# x 是一个两行一列的张量

w = tf.constant([[3.0], [4.0]])

'''

构建计算图,但不运算

y = XW

= x1*w1 + x2*w2

'''

# 矩阵相乘

y = tf.matmul(x, w)

print(y)

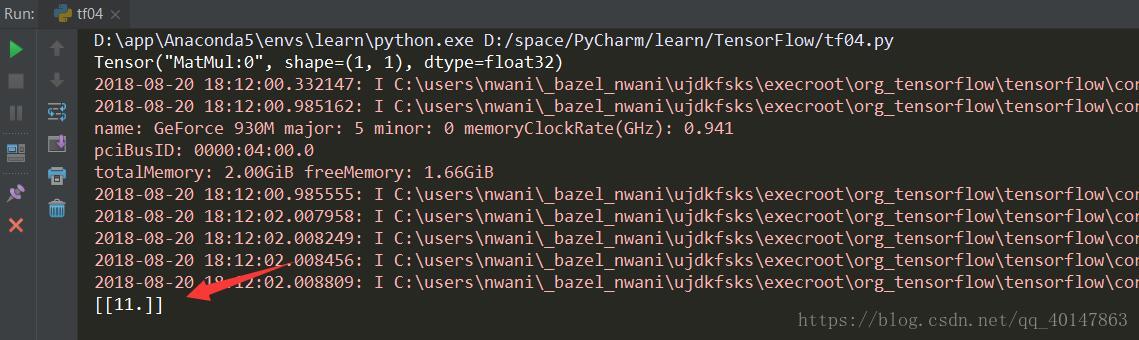

运行结果

Tensor("MatMul:0", shape=(1, 1), dtype=float32)

会话

- 会话(Session):执行计算图中的结点运算

- 我们用 with 结构实现,语法如下:

with tf.Session() as sess :

print(sess.run(y))

意思是:将 tf.Session 记为 sess,调用 tf.Session 下的 run 方法执行 y,y 也就是上面的计算图,也就是那个表达式

# 两个张量的加法

import tensorflow as tf

# x 是一个一行两列的张量

x = tf.constant([[1.0, 2.0]])

# x 是一个两行一列的张量

w = tf.constant([[3.0], [4.0]])

'''

构建计算图,但不运算

y = XW

= x1*w1 + x2*w2

'''

# 矩阵相乘

y = tf.matmul(x, w)

print(y)

# 会话:执行节点运算

with tf.Session() as sess:

print(sess.run(y))

运行结果

- y = 1.03.0 + 2.04.0 = 11

- 我们可以看到打印出了运算结果

更多文章:Tensorflow 笔记

- 本笔记不允许任何个人和组织转载

TensorFlow笔记-03-张量,计算图,会话的更多相关文章

- 吴裕雄 python 神经网络——TensorFlow 图、张量及会话

import tensorflow as tf g1 = tf.Graph() with g1.as_default(): v = tf.get_variable("v", [1] ...

- 20180929 北京大学 人工智能实践:Tensorflow笔记03

更改的程序部分如下: 另: 难?????????????见链接: https://www.bilibili.com/video/av22530538/?p=17 + (完)

- Tensorflow 笔记

TensorFlow笔记-08-过拟合,正则化,matplotlib 区分红蓝点 TensorFlow笔记-07-神经网络优化-学习率,滑动平均 TensorFlow笔记-06-神经网络优化-损失函数 ...

- 20180929 北京大学 人工智能实践:Tensorflow笔记04

20180929 北京大学 人工智能实践:Tensorflow笔记03(2018-09-30 00:01)

- TensorFlow 中的张量,图,会话

tensor的含义是张量,张量是什么,听起来很高深的样子,其实我们对于张量一点都不陌生,因为像标量,向量,矩阵这些都可以被认为是特殊的张量.如下图所示: 在TensorFlow中,tensor实际上就 ...

- TensorFlow笔记-06-神经网络优化-损失函数,自定义损失函数,交叉熵

TensorFlow笔记-06-神经网络优化-损失函数,自定义损失函数,交叉熵 神经元模型:用数学公式比表示为:f(Σi xi*wi + b), f为激活函数 神经网络 是以神经元为基本单位构成的 激 ...

- TensorFlow笔记-04-神经网络的实现过程,前向传播

TensorFlow笔记-04-神经网络的实现过程,前向传播 基于TensorFlow的NN:用张量表示数据,用计算图搭建神经网络,用会话执行计算图,优化线上的权重(参数),得到模型 张量(tenso ...

- TensorFlow笔记-01-开篇概述

人工智能实践:TensorFlow笔记-01-开篇概述 从今天开始,从零开始学习TensorFlow,有相同兴趣的同志,可以互相学习笔记,本篇是开篇介绍 Tensorflow,已经人工智能领域的一些名 ...

- TensorFlow笔记-05-反向传播,搭建神经网络的八股

TensorFlow笔记-05-反向传播,搭建神经网络的八股 反向传播 反向传播: 训练模型参数,在所有参数上用梯度下降,使用神经网络模型在训练数据上的损失函数最小 损失函数:(loss) 计算得到的 ...

随机推荐

- unittest参数化

我们在写case的时候,如果用例的操作是一样的,就是参数不同,比如说要测一个登陆的接口,要测正常登陆的.黑名单用户登陆的.账号密码错误的等等,在unittest里面就要写多个case来测试. 这样的情 ...

- hdu-6319-单调队列

Problem A. Ascending Rating Time Limit: 10000/5000 MS (Java/Others) Memory Limit: 524288/524288 K ...

- Oracle性能诊断艺术-读书笔记

create table test0605 as select * from dba_objects; select t1.owner,t1.object_name,t1.object_id from ...

- dp入门:最长不下降序列

#include "bits/stdc++.h" using namespace std; ],dp[]; int main() { int n; cin >> n; ...

- 第 6 章 —— 依赖项注入(DI)容器 —— Ninject

有些读者只想理解 MVC 框架所提供的特性,而不想介入开发理念与开发方法学.笔者不打算让你改变 —— 这属于个人取向,而且你知道交付优质项目需要的是什么. 建议你至少粗略第看一看本章的内容,以明白哪些 ...

- length,lengthb,substr,substrb,instr小用

--字符串的字符长度 select length('wm.dfw.士农工商.sda.人马ss.dfw.4.sdf.332.sf.qq.sd') from dual; --字符串的字节长度 select ...

- POJ 1442 treap

裸treap. 只需增加一个size记录其儿子个数便可找到第k大数. #include <cstdio> #include <cstring> #include <cti ...

- 杜伦大学提出GANomaly:无需负例样本实现异常检测

杜伦大学提出GANomaly:无需负例样本实现异常检测 本期推荐的论文笔记来自 PaperWeekly 社区用户 @TwistedW.在异常检测模块下,如果没有异常(负例样本)来训练模型,应该如何实现 ...

- dbvis的使用

Dbvise的使用

- learning scala 操作符

scala 操作符: 算术运算符: + - * / % 关系统运算符: > , < ,= ,!= ,>=,<=, 逻辑运算符: && . || , ! 位 ...