Spark学习笔记3——RDD(下)

Spark学习笔记3——RDD(下)

笔记摘抄自 [美] Holden Karau 等著的《Spark快速大数据分析》

向Spark传递函数

大部分 Spark 的转化操作和一部分行动操作,都需要传递函数后进行计算。如何传递函数下文将用 Java 展示。

Java 向 Spark 传递函数需要实现 Spark 的 org.apache.spark.api.java.function 包中的接口。一些基本的接口如下表:

| 函数名 | 实现的方法 | 用途 |

|---|---|---|

| Function<T, R> | R call(T) | 接收一个输入值并返回一个输出值,用于类似map() 和 filter() 等操作中 |

| Function2<T1, T2, R> | R call(T1, T2) | 接收两个输入值并返回一个输出值,用于类似aggregate() 和fold() 等操作中 |

| FlatMapFunction<T, R> | Iterable call(T) | 接收一个输入值并返回任意个输出,用于类似flatMap() 这样的操作中 |

通过匿名内部类

见上篇笔记例程。

通过具名类传递

class ContainsError implements Function<String, Boolean>() {public Boolean call(String x) { return x.contains("error"); }}...RDD<String> errors = lines.filter(new ContainsError());

- 使用具名类在程序组织比较庞大是显得比较清晰

- 可以使用构造函数如“通过带参数的 Java 函数类传递”中所示

通过带参数的 Java 函数类传递

例程

import org.apache.spark.SparkConf;import org.apache.spark.api.java.JavaRDD;import org.apache.spark.api.java.JavaSparkContext;import org.apache.spark.api.java.function.Function;import java.util.List;public class Contains implements Function<String, Boolean> {private String query;public Contains(String query) {this.query = query;}public Boolean call(String x) {return x.contains(query);}public static void main(String[] args) {SparkConf sc = new SparkConf().setAppName("Contains");JavaSparkContext javaSparkContext = new JavaSparkContext(sc);JavaRDD<String> log = javaSparkContext.textFile(args[0]);JavaRDD<String> content = log.filter(new Contains(args[1]));List<String> contentList = content.collect();for (String output : contentList) {System.out.println(output);}javaSparkContext.stop();}}

测试文本 test.txt

this is a testthis is a simple testthis is a simple test about RDDlet us check it out

测试结果

[root@server1 spark-2.4.4-bin-hadoop2.7]# bin/spark-submit --class Contains ~/RDDFuncNamedClass.jar ~/test.txt RDD...19/09/16 15:06:50 INFO DAGScheduler: Job 0 finished: collect at Contains.java:24, took 0.445049 sthis is a simple test about RDD...

通过 lambda 表达式传递(仅限于 Java 8 及以上)

例程

import org.apache.spark.SparkConf;import org.apache.spark.api.java.JavaRDD;import org.apache.spark.api.java.JavaSparkContext;import java.util.List;public class LambdaTest {public static void main(final String[] args) {SparkConf sc = new SparkConf().setAppName("Contains");JavaSparkContext javaSparkContext = new JavaSparkContext(sc);JavaRDD<String> log = javaSparkContext.textFile(args[0]);JavaRDD<String> content = log.filter(s -> s.contains(args[1]));List<String> contentList = content.collect();for (String output : contentList) {System.out.println(output);}javaSparkContext.stop();}}

测试文本

使用上文同一个文本

运行结果

[root@server1 spark-2.4.4-bin-hadoop2.7]# bin/spark-submit --class Contains ~/RDDFuncNamedClass.jar ~/test.txt check...19/09/16 15:27:10 INFO DAGScheduler: Job 0 finished: collect at Contains.java:24, took 0.440515 slet us check it out...

常见的转化操作和行动操作

Spark 中有不同类型的 RDD,不同的 RDD 可以支持不同的操作。

除了基本的RDD外,还有数字类型的 RDD 支持统计型函数操作、键值对形式的 RDD 支持聚合数据的键值对操作等等。

基本RDD

针对各个元素的转化操作

为了方便,代码在 pyspark 中展示:

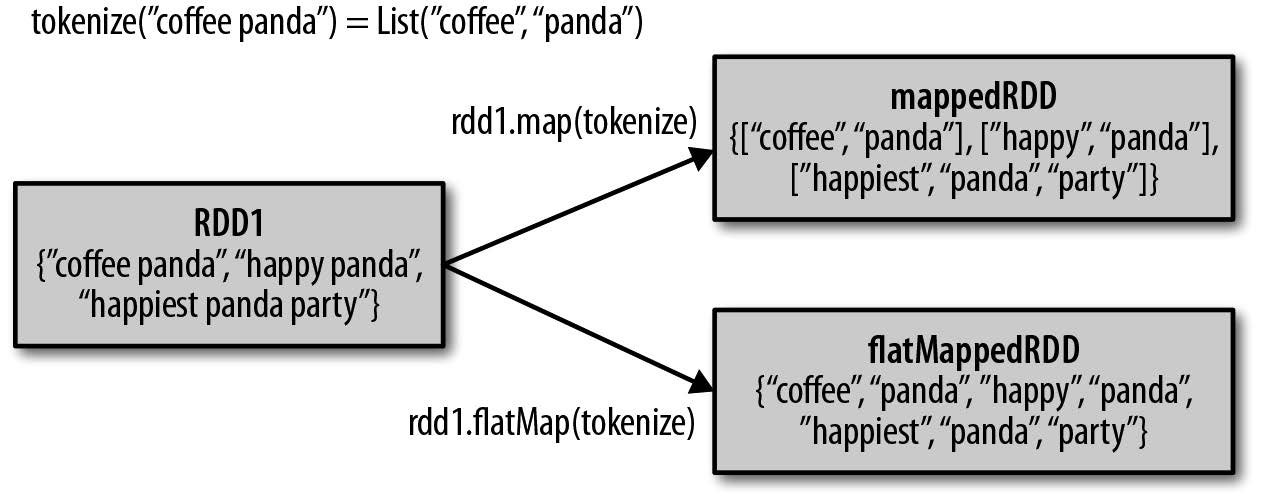

# map()# map() 的返回值类型不需要和输入类型一样>>> nums = sc.parallelize([1, 2, 3, 4])>>> squared = nums.map(lambda x: x * x).collect()>>> for num in squared:... print "%i " % (num)...14916# flatMap()# 给flatMap() 的函数被分别应用到了输入RDD 的每个元素上。# 返回的是一个返回值序列的迭代器。#>>> lines = sc.parallelize(["hello world", "hi"])>>> words = lines.flatMap(lambda line: line.split(" "))>>> words.first()'hello'

map() 和 flatmap() 区别如下:

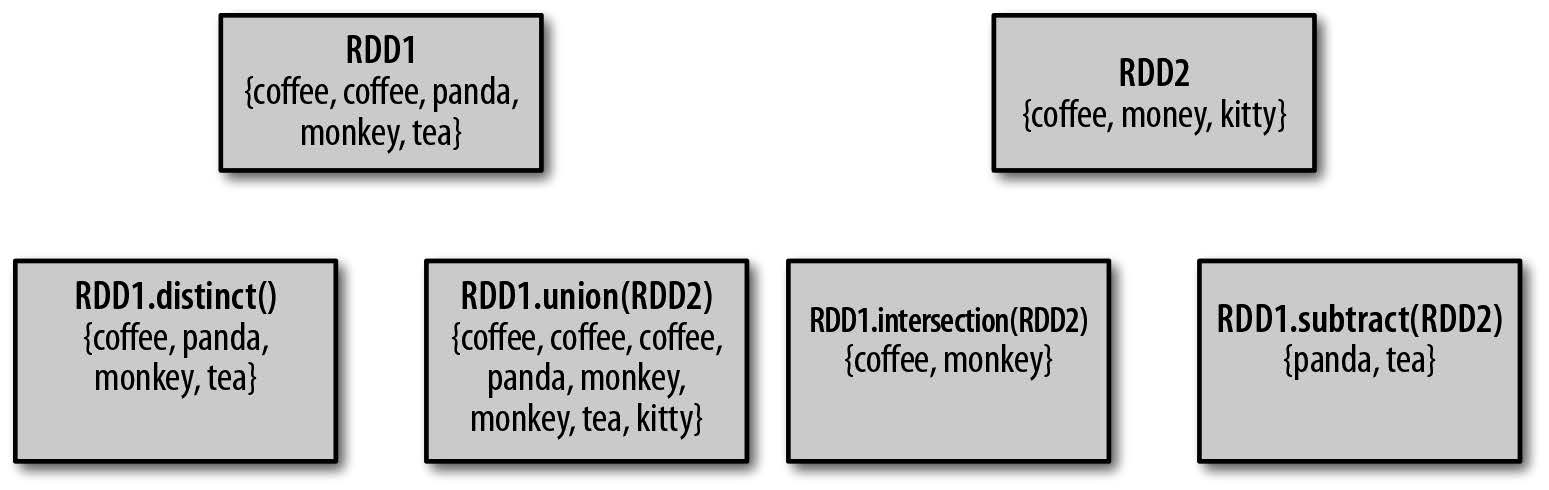

伪集合操作

RDD 不算是严格意义上的集合,但是一些类似集合的属性让它能够支持许多集合操作,下图展示了常见的集合操作:

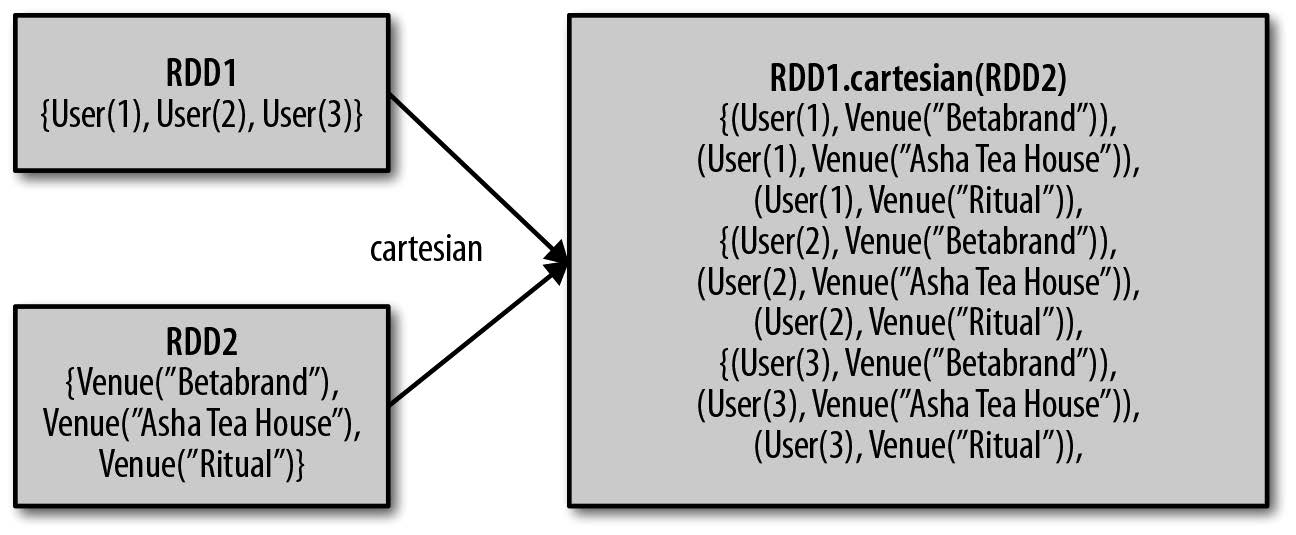

此外,RDD 还支持笛卡尔积的操作:

以下对基本 RDD 的转化操作进行梳理:

- 单个 RDD {1,2,3,3} 的转化操作

| 函数名 | 目的 | 示例 | 结果 |

|---|---|---|---|

| map() | 将函数应用于RDD 中的每个元 素,将返回值构成新的RDD |

rdd.map(x => x + 1) | {2, 3, 4, 4} |

| flatMap() | 将函数应用于RDD 中的每个元 素,将返回的迭代器的所有内 容构成新的RDD。通常用来切 分单词 |

rdd.flatMap(x => x.to(3)) | {1, 2, 3, 2, 3, 3, 3} |

| filter() | 返回一个由通过传给filter() 的函数的元素组成的RDD |

rdd.filter(x => x != 1) | {2, 3, 3} |

| distinct() | 去重 | rdd.distinct() | {1, 2, 3} |

| sample(withReplacement, fraction, [seed]) | 对RDD 采样,以及是否替换 | rdd.sample(false, 0.5) | 非确定的 |

- 两个 RDD {1,2,3},{3,4,5}的 RDD 的转化操作

| 函数名 | 目的 | 示例 | 结果 |

|---|---|---|---|

| union() | 生成一个包含两个RDD 中所有元 素的RDD |

rdd.union(other) | {1, 2, 3, 3, 4, 5} |

| intersection() | 求两个RDD 共同的元素的RDD | rdd.intersection(other) | {3} |

| subtract() | 移除一个RDD 中的内容(例如移 除训练数据) |

rdd.subtract(other) | {1, 2} |

| cartesian() | 与另一个RDD 的笛卡儿积 | rdd.cartesian(other) | {(1, 3), (1, 4), ... (3, 5)} |

行动操作

reduce() 与 reduceByKey()

例程[1]

import org.apache.spark.SparkConf;import org.apache.spark.api.java.JavaPairRDD;import org.apache.spark.api.java.JavaRDD;import org.apache.spark.api.java.JavaSparkContext;import scala.Tuple2;import java.util.Arrays;import java.util.List;public class SimpleReduce {public static void main(String[] args) {SparkConf sc = new SparkConf().setAppName("Contains");JavaSparkContext javaSparkContext = new JavaSparkContext(sc);List<Integer> data = Arrays.asList(1, 2, 3, 4, 5);JavaRDD<Integer> originRDD = javaSparkContext.parallelize(data);Integer sum = originRDD.reduce((a, b) -> a + b);System.out.println(sum);//reduceByKey,按照相同的key进行reduce操作List<String> list = Arrays.asList("key1", "key1", "key2", "key2", "key3");JavaRDD<String> stringRDD = javaSparkContext.parallelize(list);//转为key-value形式JavaPairRDD<String, Integer> pairRDD = stringRDD.mapToPair(k -> new Tuple2<>(k, 1));List list1 = pairRDD.reduceByKey((x, y) -> x + y).collect();System.out.println(list1);}}

运行结果

...19/09/17 17:08:37 INFO DAGScheduler: Job 0 finished: reduce at SimpleReduce.java:21, took 0.480038 s15...19/09/17 17:08:38 INFO DAGScheduler: Job 1 finished: collect at SimpleReduce.java:29, took 0.237601 s[(key3,1), (key1,2), (key2,2)]...

aggregate()[2]

例程

import org.apache.spark.SparkConf;import org.apache.spark.api.java.JavaRDD;import org.apache.spark.api.java.JavaSparkContext;import org.apache.spark.api.java.function.Function2;import java.io.Serializable;import java.util.Arrays;import java.util.List;public class AvgCount implements Serializable {private AvgCount(int total, int num) {this.total = total;this.num = num;}private int total;private int num;private double avg() {return total / (double) num;}public static void main(String[] args) {SparkConf sc = new SparkConf().setAppName("Contains");JavaSparkContext javaSparkContext = new JavaSparkContext(sc);List<Integer> data = Arrays.asList(1, 2, 3, 4, 5);JavaRDD<Integer> rdd = javaSparkContext.parallelize(data);AvgCount initial = new AvgCount(0, 0);Function2<AvgCount, Integer, AvgCount> addAndCount =new Function2<AvgCount, Integer, AvgCount>() {public AvgCount call(AvgCount a, Integer x) {a.total += x;a.num += 1;return a;}};Function2<AvgCount, AvgCount, AvgCount> combine =new Function2<AvgCount, AvgCount, AvgCount>() {public AvgCount call(AvgCount a, AvgCount b) {a.total += b.total;a.num += b.num;return a;}};AvgCount result = rdd.aggregate(initial, addAndCount, combine);System.out.println(result.avg());}}

运行结果

[root@server1 spark-2.4.4-bin-hadoop2.7]# bin/spark-submit --class AvgCount ~/Spark_RDD_Aggregate.jar...19/09/18 15:28:19 INFO DAGScheduler: Job 0 finished: aggregate at AvgCount.java:43, took 0.517385 s3.0...

常用的行动操作整理

| 函数名 | 目的 | 示例 | 结果 |

|---|---|---|---|

| collect() | 返回RDD 中的所有元素 | rdd.collect() | {1, 2, 3, 3} |

| count() | RDD 中的元素个数 | rdd.count() | 4 |

| countByValue() | 各元素在RDD 中出现的次数 | rdd.countByValue() | {(1, 1), (2, 1), (3, 2)} |

| take(num) | 从RDD 中返回num 个元素 | rdd.take(2) | {1, 2} |

| top(num) | 从RDD 中返回最前面的num 个元素 |

rdd.top(2) | {3, 3} |

| takeOrdered(num) (ordering) |

从RDD 中按照提供的顺序返 回最前面的num 个元素 |

rdd.takeOrdered(2)(myOrdering) | {3, 3} |

| takeSample(withReplace ment, num, [seed]) |

从RDD 中返回任意一些元素 | rdd.takeSample(false, 1) | 非确定的 |

| reduce(func) | 并行整合RDD 中所有数据 (例如sum) |

rdd.reduce((x, y) => x + y) | 9 |

| fold(zero)(func) | 和reduce() 一样, 但是需要 提供初始值 |

rdd.fold(0)((x, y) => x + y) | 9 |

| aggregate(zeroValue) (seqOp, combOp) |

和reduce() 相似, 但是通常 返回不同类型的函数 |

rdd.aggregate((0, 0)) ((x, y) => (x._1 + y, x._2 + 1), (x, y) => (x._1 + y._1, x._2 + y._2)) |

(9,4) |

| foreach(func) | 对RDD 中的每个元素使用给 定的函数 |

rdd.foreach(func) | 无 |

不同 RDD 的类型转换

Spark 中有些函数只能作用于特定类型的 RDD。例如 mean() 和 variance() 只能处理数值 RDD,join() 只能用于处理键值对 RDD。在 Scala 和 Java 中都没有与之对应的标准 RDD 类,故使用这些函数时必须要确保获得了正确的专用 RDD 类。(Scala 为隐式转换)

下表为 Java 中针对专门类型的函数接口:

| 函数名 | 等价函数 | 用途 |

|---|---|---|

| DoubleFlatMapFunction | Function<T, Iterable> | 用于flatMapToDouble,以 生成DoubleRDD |

| DoubleFunction | Function<T, Double> | 用于mapToDouble,以生成 DoubleRDD |

| PairFlatMapFunction<T, K, V> | Function<T, Iterable<Tuple2<K, V>>> | 用于flatMapToPair,以生 成PairRDD<K, V> |

| PairFunction<T, K, V> | Function<T, Tuple2<K, V>> | 用于mapToPair, 以生成 PairRDD<K, V> |

例程

以 DoubleFunction 为例:

import org.apache.spark.SparkConf;import org.apache.spark.api.java.JavaDoubleRDD;import org.apache.spark.api.java.JavaRDD;import org.apache.spark.api.java.JavaSparkContext;import org.apache.spark.api.java.function.DoubleFunction;import java.util.Arrays;public class DoubleRDD {public static void main(String[] args) {SparkConf sparkConf=new SparkConf().setAppName("DoubleRDD");JavaSparkContext javaSparkContext=new JavaSparkContext(sparkConf);JavaRDD<Integer> rdd = javaSparkContext.parallelize(Arrays.asList(1, 2, 3, 4));JavaDoubleRDD result = rdd.mapToDouble(new DoubleFunction<Integer>() {public double call(Integer x) {return (double) x * x;}});System.out.println(result.mean());}}

运行结果

[root@server1 spark-2.4.4-bin-hadoop2.7]# bin/spark-submit --class DoubleRDD ~/Spark_RDD_DoubleRDD.jar...19/09/18 16:09:38 INFO DAGScheduler: Job 0 finished: mean at DoubleRDD.java:20, took 0.500705 s7.5...

持久化

为了避免多次计算同一个 RDD,我们常常对数据进行持久化处理。具体操作可以参见上一节例程。

Tips:

- 在Scala 和Java 中,默认情况下 persist() 会把数据以序列化的形式缓存在JVM 的堆空间中

- 在Python 中,我们会始终序列化要持久化存储的数据,所以持久化级别默认值就是以序列化后的对象存储在JVM 堆空间中

- 当我们把数据写到磁盘或者堆外存储上时,也总是使用序列化后的数据

- 缓存的数据太多,内存中放不下,Spark 会自动利用最近最少使用(LRU)的缓存策略把最老的分区从内存中移除

- unpersist() 可以手动把持久化的RDD 从缓存中移除

持久化级别

| 级 别 | 使用的 空间 |

CPU 时间 |

是否在 内存中 |

是否在 磁盘上 |

备注 |

|---|---|---|---|---|---|

| MEMORY_ONLY | 高 | 低 | 是 | 否 | |

| MEMORY_ONLY_SER | 低 | 高 | 是 | 否 | |

| MEMORY_AND_DISK | 高 | 中等 | 部分 | 部分 | 如果数据在内存中放不下,则溢写到磁盘上 |

| MEMORY_AND_DISK_SER | 低 | 高 | 部分 | 部分 | 如果数据在内存中放不下,则溢写到磁盘上。在内存中存放序列化后的数据 |

| DISK_ONLY | 低 | 高 | 否 | 是 |

P.s.

可以通过在存储级别的末尾加上“_2”来把持久化数据存为两份

Spark学习笔记3——RDD(下)的更多相关文章

- Spark学习笔记2——RDD(上)

目录 Spark学习笔记2--RDD(上) RDD是什么? 例子 创建 RDD 并行化方式 读取外部数据集方式 RDD 操作 转化操作 行动操作 惰性求值 Spark学习笔记2--RDD(上) 笔记摘 ...

- Spark学习笔记之RDD中的Transformation和Action函数

总算可以开始写第一篇技术博客了,就从学习Spark开始吧.之前阅读了很多关于Spark的文章,对Spark的工作机制及编程模型有了一定了解,下面把Spark中对RDD的常用操作函数做一下总结,以pys ...

- spark学习笔记总结-spark入门资料精化

Spark学习笔记 Spark简介 spark 可以很容易和yarn结合,直接调用HDFS.Hbase上面的数据,和hadoop结合.配置很容易. spark发展迅猛,框架比hadoop更加灵活实用. ...

- Spark学习笔记-GraphX-1

Spark学习笔记-GraphX-1 标签: SparkGraphGraphX图计算 2014-09-29 13:04 2339人阅读 评论(0) 收藏 举报 分类: Spark(8) 版权声明: ...

- Spark学习笔记1——第一个Spark程序:单词数统计

Spark学习笔记1--第一个Spark程序:单词数统计 笔记摘抄自 [美] Holden Karau 等著的<Spark快速大数据分析> 添加依赖 通过 Maven 添加 Spark-c ...

- Spark学习笔记之SparkRDD

Spark学习笔记之SparkRDD 一. 基本概念 RDD(resilient distributed datasets)弹性分布式数据集. 来自于两方面 ① 内存集合和外部存储系统 ② ...

- Spark学习笔记2(spark所需环境配置

Spark学习笔记2 配置spark所需环境 1.首先先把本地的maven的压缩包解压到本地文件夹中,安装好本地的maven客户端程序,版本没有什么要求 不需要最新版的maven客户端. 解压完成之后 ...

- Spark学习笔记3(IDEA编写scala代码并打包上传集群运行)

Spark学习笔记3 IDEA编写scala代码并打包上传集群运行 我们在IDEA上的maven项目已经搭建完成了,现在可以写一个简单的spark代码并且打成jar包 上传至集群,来检验一下我们的sp ...

- Spark学习笔记0——简单了解和技术架构

目录 Spark学习笔记0--简单了解和技术架构 什么是Spark 技术架构和软件栈 Spark Core Spark SQL Spark Streaming MLlib GraphX 集群管理器 受 ...

随机推荐

- Linux strace追踪命令详解

strace介绍 strace命令是一个集诊断.调试.统计与一体的工具,我们可以使用strace对应用的系统调用和信号传递的跟踪结果来对应用进行分析,以达到解决问题或者是了解应用工作过程的目的.当然s ...

- CNN中计算量FLOPs的计算

1.FLOPs的概念:全称是floating point operations per second,意指每秒浮点运算次数,即用来衡量硬件的计算性能:在CNN中用来指浮点运算次数: 2.计算过程: 如 ...

- 比较两个数组的键名,并返回交集:array_intersect_key

$a1=array("a"=>"red","b"=>"green","c"=>&q ...

- 【计算机视觉】OpenCV篇(6) - 平滑图像(卷积/滤波/模糊/降噪)

平滑滤波 平滑滤波是低频增强的空间域滤波技术.空间域滤波技术即不经由傅立叶转换,直接处理影像中的像素,它的目的有两类:一类是模糊:另一类是消除噪音.空间域的平滑滤波一般采用简单平均法进行,就是求邻近像 ...

- AWS 架构最佳实践(十二)

可靠性 基本概念 可靠性 系统从基础设施或服务故障中恢复.动态获取计算资源以满足需求减少中断的能力 系统为最坏情况做好准备,对不同组件实施缓解措施,对恢复程序进行提前测试并且自动执行. 可靠性实践 测 ...

- beego框架(golang)学习过滤器(实现restful请求)

过滤器 在用beego做restful路由的时候,遇到了除了GTE.POST之外的HTTP请求,比如 PUT.PATCH.delete请求无法通过路由认证,报错误:405 METHOD NOT ALL ...

- 推荐linux运维必备的几本书

首先,<鸟哥的linux私房菜> 鸟哥 其次,<linux就该这么学> 刘瑞版 然后,<CentOS linux系统运维> 张祥琳版 最后,<CentOS运维 ...

- mousedown、mouseup、click事件之间的关系及执行顺序

三个事件的触发时机 mousedown 当鼠标指针移动到元素上方,并按下鼠标按键(左.右键均可)时,会发生 mousedown 事件.与 click 事件不同,mousedown 事件仅需要按键被 ...

- mysql order by rand() 优化方法

mysql order by rand() 优化方法 适用于领取奖品等项目<pre>mysql> select * from user order by rand() limit 1 ...

- ps -ef|grep详解 、kill与kill -9的区别

ps -ef|grep详解 ps命令将某个进程显示出来 grep命令是查找 中间的|是管道命令 是指ps命令与grep同时执行 PS是LINUX下最常用的也是非常强大的进程查看命令 grep命令是查找 ...