GO学习-(35) Go实现日志收集系统4

Go实现日志收集系统4

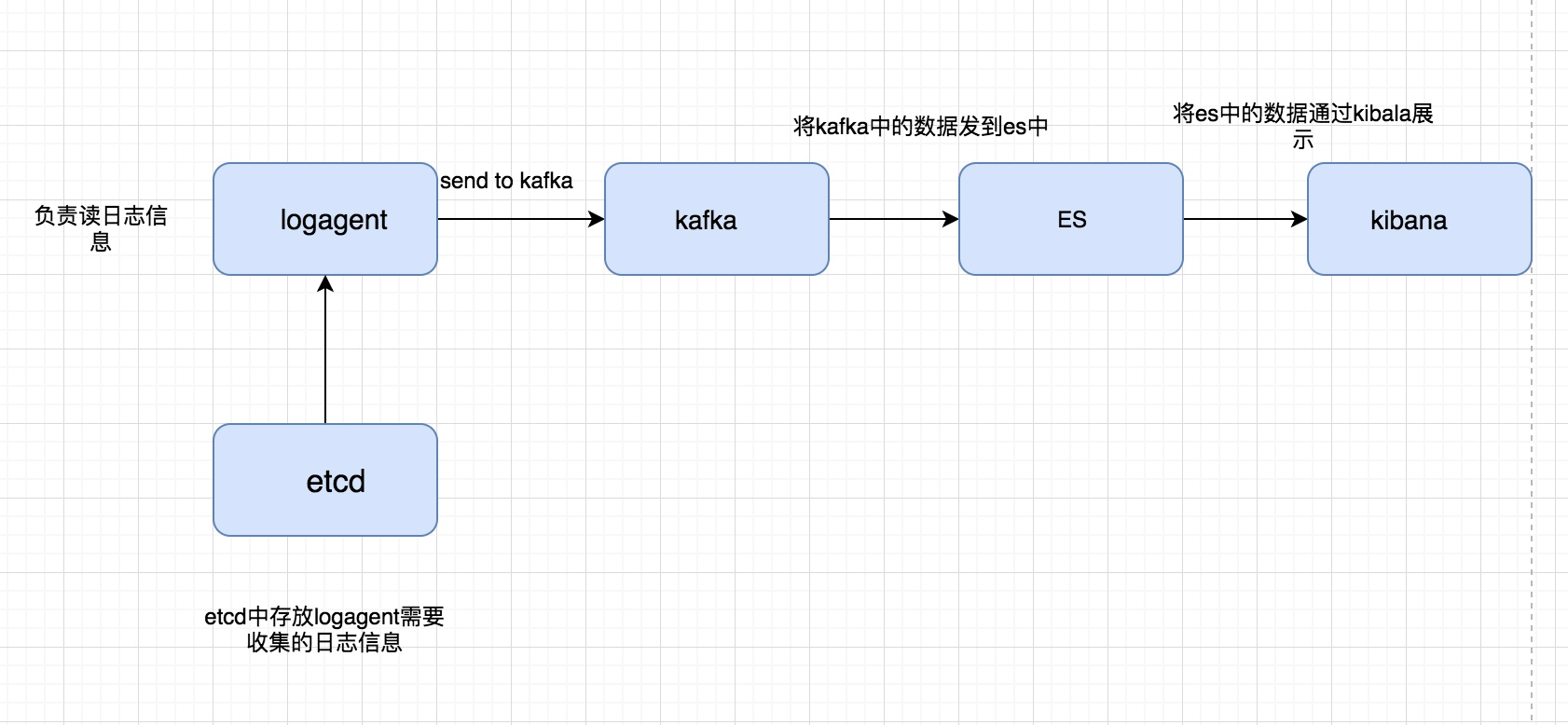

到这一步,我的收集系统就已经完成很大一部分工作,我们重新看一下我们之前画的图:

我们已经完成前面的部分,剩下是要完成后半部分,将kafka中的数据扔到ElasticSearch,并且最终通过kibana展现出来

ElasticSearch

官网地址这里介绍了非常详细的安装方法:

https://www.elastic.co/downloads/elasticsearch

但是其实这里是需要配置一些东西的,要不然直接启动是会悲剧的,在网上找了一个地址,如果出现类似的错误直接处理就行,我自己已经验证了:

https://blog.csdn.net/liangzhao_jay/article/details/56840941

如下图所示就表示已经安装完成:

通过go写一个简单的调用ElasticSearch的例子:

package main import (

"fmt"

elastic "gopkg.in/olivere/elastic.v2"

) type Tweet struct{

User string

Message string

} func main(){

client,err := elastic.NewClient(elastic.SetSniff(false),elastic.SetURL("http://192.168.0.118:9200/"))

if err != nil{

fmt.Println("connect es error",err)

return

}

fmt.Println("conn es succ")

tweet := Tweet{User:"olivere name",Message:"Take Five"}

_, err = client.Index().Index("twitter").Type("tweet").Id("1").BodyJson(tweet).Do()

if err != nil {

panic(err)

return

}

fmt.Println("insert succ")

}

logtransfer

logtransfer主要负责从 kafka队列中读取日志信息,并且添加到ElasticSearch中

看那一下logtransfer 目录结构如下:

├── conf

│ └── app.conf

├── es.go

├── etcd.go

├── ip.go

├── kafka.go

├── logs

│ └── transfer.log

└── main.go

conf:存放配置文件

es.go:主要是连接ElasticSearch的部分以及用于将消息放到ElasticSearch中

etcd.go:主要用于做动态的配置更改,当我们需要将kafka中的哪些topic日志内容扔到ElasticSearch中

ip.go: 用于获取当前服务器的ip地址

kafka.go: 主要是kafka的处理逻辑,包括连接kafka以及从kafka中读日志内容

main.go:代码的入口函数

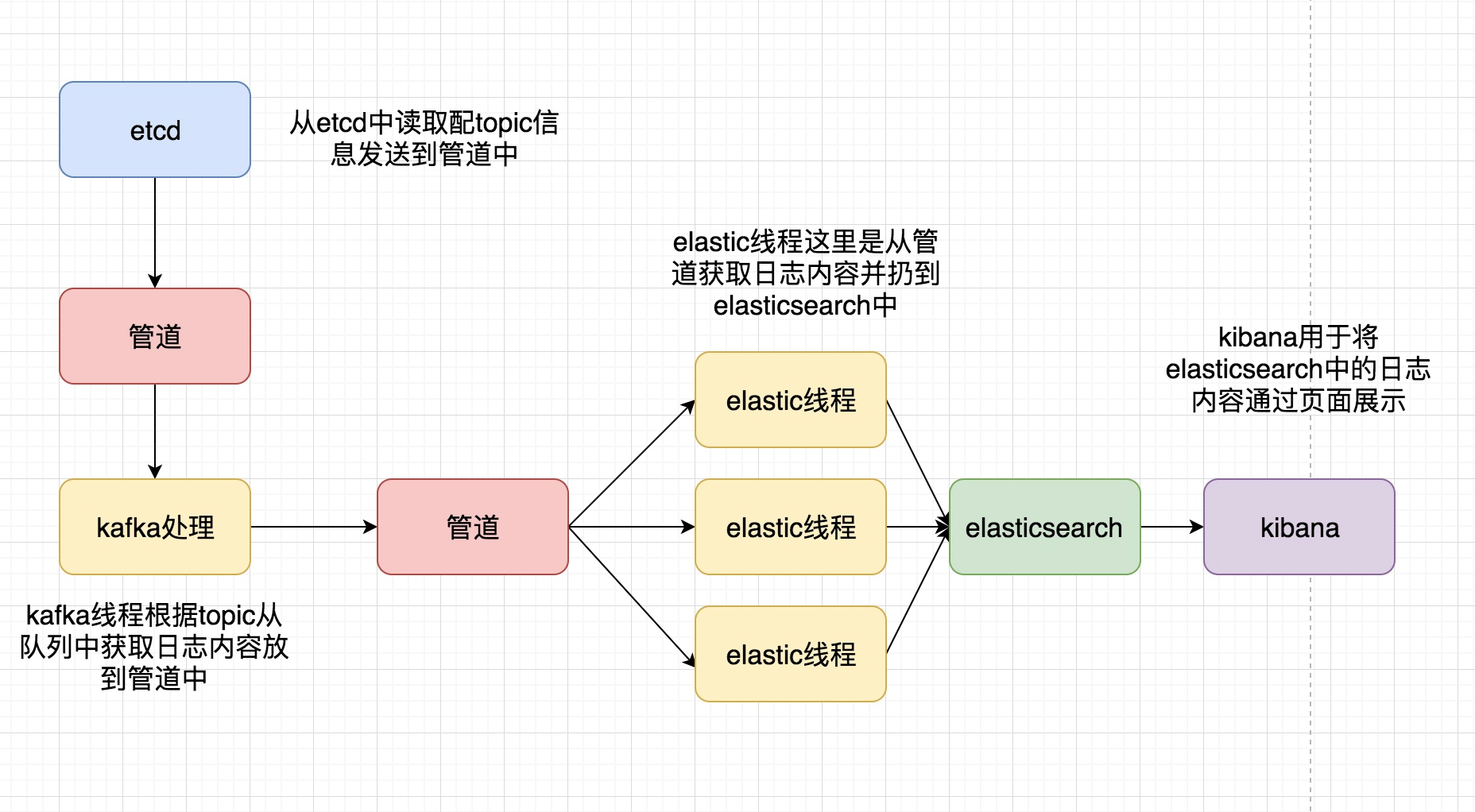

整体大代码框架,通过如图展示:

和之前的logagent中的代码有很多启示是可以复用的或者稍作更改,就可以了,其中es之心的,主要是连接ElasticSearch并将日志内容放进去

es.go的代码内容为:

package main import (

"gopkg.in/olivere/elastic.v2"

"github.com/astaxie/beego/logs"

"sync"

"encoding/json"

) var waitGroup sync.WaitGroup var client *elastic.Client func initEs(addr string,) (err error){

client,err = elastic.NewClient(elastic.SetSniff(false),elastic.SetURL(addr))

if err != nil{

logs.Error("connect to es error:%v",err)

return

}

logs.Debug("conn to es success")

return

} func reloadKafka(topicArray []string) {

for _, topic := range topicArray{

kafkaMgr.AddTopic(topic)

}

} func reload(){

//GetLogConf() 从channel中获topic信息,而这部分信息是从etcd放进去的

for conf := range GetLogConf(){

var topicArray []string

err := json.Unmarshal([]byte(conf),&topicArray)

if err != nil {

logs.Error("unmarshal failed,err:%v conf:%v",err,conf)

continue

}

reloadKafka(topicArray)

}

} func Run(esThreadNum int) (err error) {

go reload()

for i:=0;i<esThreadNum;i++{

waitGroup.Add(1)

go sendToEs()

}

waitGroup.Wait()

return

} type EsMessage struct {

Message string

} func sendToEs(){

// 从msgChan中读取日志内容并扔到elasticsearch中

for msg:= range GetMessage() {

var esMsg EsMessage

esMsg.Message = msg.line

_,err := client.Index().Index(msg.topic).Type(msg.topic).BodyJson(esMsg).Do()

if err != nil {

logs.Error("send to es failed,err:%v",err)

continue

}

logs.Debug("send to es success")

}

waitGroup.Done()

}

最终我将logagnet以及logtransfer部署到虚拟机上进行测试的效果是:

这样当我再次查日志的时候就可以不用登陆每台服务器去查日志,只需要通过页面根据关键字迅速看到相关日志,当然目前实现的功能还是有点粗糙,etcd的更改程序,是自己写的发送程序,其实更好的解决方法是通过页面,让用户点来点去,来控制自己要收集哪些日志,以及自己要将哪些topic的日志从kafka中放到ElasticSearch (本人是做后端开发,不擅长前端的开发,不过后面可以试着写个页面试试,估计会很丑哈哈)

同时这里关于各个部分的安装并没有做过多的介绍,以及维护,当然我们的目标是是通过这些开源的软件以及包来实现我们想要的功能,后期的维护,肯定需要对各个组件部分都进行深入了解

这里附赠一下那个etcd客户端代码:

package main import (

"github.com/coreos/etcd/clientv3"

"time"

"fmt"

"golang.org/x/net/context"

) var logconf = `

[

{

"topic":"eslservice_log",

"log_path":"/opt/pbx/log/eslservice.log",

"service":"eslservice",

"send_rate":50000

}

]

` var test111 = `

[

{

"topic":"test_log",

"log_path":"D:/a.log",

"service":"test",

"send_rate":50000

}

]

` var transconf = `

[

"eslservice_log"

]

` func main() {

cli, err := clientv3.New(clientv3.Config{

Endpoints:[]string{"192.168.90.78:2371"},

DialTimeout:5*time.Second,

})

if err != nil {

fmt.Println("connect failed,err:",err)

return

}

fmt.Println("connect success")

defer cli.Close()

ctx,cancel := context.WithTimeout(context.Background(),time.Second)

//_,err = cli.Put(ctx,"/logagent/192.168.90.11/log_config",logconf)

//_,err = cli.Put(ctx,"/logagent/192.168.90.61/log_config",test111)

_, err = cli.Put(ctx,"/logtransfer/192.168.90.11/log_config",transconf)

cancel()

if err != nil {

fmt.Println("put failed ,err:",err)

return

}

ctx,cancel = context.WithTimeout(context.Background(),time.Second)

resp,err := cli.Get(ctx,"/logtransfer/",clientv3.WithPrefix())

cancel()

if err != nil {

fmt.Println("get failed,err:",err)

return

}

for _,ev:=range resp.Kvs{

fmt.Printf("%s:%s\n",ev.Key,ev.Value)

}

}

GO学习-(35) Go实现日志收集系统4的更多相关文章

- GO学习-(34) Go实现日志收集系统3

Go实现日志收集系统3 再次整理了一下这个日志收集系统的框,如下图 这次要实现的代码的整体逻辑为: 完整代码地址为: etcd介绍 高可用的分布式key-value存储,可以用于配置共享和服务发现 ...

- GO学习-(33) Go实现日志收集系统2

Go实现日志收集系统2 一篇文章主要是关于整体架构以及用到的软件的一些介绍,这一篇文章是对各个软件的使用介绍,当然这里主要是关于架构中我们agent的实现用到的内容 关于zookeeper+kaf ...

- GO学习-(32) Go实现日志收集系统1

Go实现日志收集系统1 项目背景 每个系统都有日志,当系统出现问题时,需要通过日志解决问题 当系统机器比较少时,登陆到服务器上查看即可满足 当系统机器规模巨大,登陆到机器上查看几乎不现实 当然即使是机 ...

- Go语言学习之11 日志收集系统kafka库实战

本节主要内容: 1. 日志收集系统设计2. 日志客户端开发 1. 项目背景 a. 每个系统都有日志,当系统出现问题时,需要通过日志解决问题 b. 当系统机器比较少时,登陆到服务器上查看即可 ...

- ELK+kafka构建日志收集系统

ELK+kafka构建日志收集系统 原文 http://lx.wxqrcode.com/index.php/post/101.html 背景: 最近线上上了ELK,但是只用了一台Redis在 ...

- 基于Flume的美团日志收集系统 架构和设计 改进和优化

3种解决办法 https://tech.meituan.com/mt-log-system-arch.html 基于Flume的美团日志收集系统(一)架构和设计 - https://tech.meit ...

- 容器云平台No.9~kubernetes日志收集系统EFK

EFK介绍 EFK,全称Elasticsearch Fluentd Kibana ,是kubernetes中比较常用的日志收集方案,也是官方比较推荐的方案. 通过EFK,可以把集群的所有日志收集到El ...

- Flume -- 开源分布式日志收集系统

Flume是Cloudera提供的一个高可用的.高可靠的开源分布式海量日志收集系统,日志数据可以经过Flume流向需要存储终端目的地.这里的日志是一个统称,泛指文件.操作记录等许多数据. 一.Flum ...

- [转载] 一共81个,开源大数据处理工具汇总(下),包括日志收集系统/集群管理/RPC等

原文: http://www.36dsj.com/archives/25042 接上一部分:一共81个,开源大数据处理工具汇总(上),第二部分主要收集整理的内容主要有日志收集系统.消息系统.分布式服务 ...

随机推荐

- SpringAOP_构造注入实现

SpringAOP_构造注入实现 AOP_面向切面编程初步了解 让我们先想象一个场景,你正在编写一个项目,在开发过程中的多个模块都有某段重复的代码,于是你选择将其抽象成一个方法,然后在需要的地方调用这 ...

- POJ3233不错的矩阵(矩阵套矩阵)

题意: 给一个n*n的矩阵A,然后求S=A + A^2 + A^3 + ..+ A^k. 思路: 矩阵快速幂,这个题目挺新颖的,以往的矩阵快速幂都是退出公式,然后构造矩阵,这 ...

- Windows 签名伪造工具的使用,Python,签名

#!/usr/bin/env python3 # LICENSE: BSD-3 # Copyright: Josh Pitts @midnite_runr import sys import stru ...

- 分解uber依赖注入库dig-源码分析

上一篇帖子 分解uber依赖注入库dig-使用篇 把如何使用dig进行代码示例说明,这篇帖子分析dig的源码,看他是如何实现依赖注入的. dig实现的中心思想:所有传入Provide的函数必须要有除e ...

- ERROR: Pool overlaps with other one on this address space

出现问题 配置了两个不同的docker-compose.yml,使用了相同的网段,导致了在运行第二个yml文件时命令行报错目标网段已存在,报错如下: Creating network "v2 ...

- js实现倒计时函数

function updateEndTime() { //当前时间,距1970年1月1日的秒数 var date = new Date(); var time = (date.getTime())/1 ...

- 如何实现一个 System Services?

<Android 系统开发做什么?>写到 Android System Services 是专注于特定功能的模块化组件,应用框架 API 所提供的功能可与系统服务通信,以访问底层硬件.An ...

- 2021.02.21cf补题

B. National Project 题意:总长度为n的公路进行维修,天气是有规律性的,连续g天的好天气,连续b天的坏天气,必须在好天气进行维护,问至少维护n的一半,那么至少需要多少天 思路:必须是 ...

- C++ primer plus读书笔记——第16章 string类和标准模板库

第16章 string类和标准模板库 1. string容易被忽略的构造函数: string(size_type n, char c)长度为n,每个字母都为c string(const string ...

- 大数据开发-Flink-1.13新特性

介绍 大概4月,Flink1.13就发布了,参加 了Flink1.13 的Meetup,收获还是挺多,从大的方面讲就是FlingSql的改进和优化,资源调度管理方面的优化,以及流批一体Flink在运行 ...