【Machine Learning·机器学习】决策树之ID3算法(Iterative Dichotomiser 3)

@

1、什么是决策树

决策树,就是一种把决策节点画成树的辅助决策工具,一种寻找最优方案的画图法。

如下图所示,从左图到右图就是一个简单的,利用决策树,辅助决策的过程。

2、如何构造一棵决策树?

2.1、基本方法

通过对不同特征的优先级区分判断后,优先选择优先级高的特征作为划分的特征。(如上图所示,假设优先级:学历>院校>工作经验。因此我们优先选择了学历作为分类依据,次而选择了院校作为分类依据,最后才选择了项目经验作为分类依据)。

那么,下一个问题来了,我们是怎样判断一个特征的优先级的?具体来说,就是我们在评价一个特征优先级时候的评价标准是什么。这个评价标准,在决策树中非常重要,一个合适评价标准,可以将不同的特征按照非常合理的方式进行优先级排序,从而能够构建出一颗比较完美的决策树。而一个不合适的评价标准则会导致最终构造的决策树出现种种问题。

2.2、评价标准是什么/如何量化评价一个特征的好坏?

在不同的决策树算法中,这个特征好坏的评价标准略有不同。比如,在问哦们今天讲的ID3算法中,评价标准是一个叫做 信息增益(Information Gain) 的东西。而在另一个决策树算法C4.5中,评判标准则进一步变为信息增益比(Information Gain Ration或Gain Ratio)。另外一个比较主流的决策树算法CART算法则是采用 基尼系数(Gini Index) 作为评判标准。这些东西,我们会在后面的几篇文章中一一涉及到,在本文中,我们将关注的重点放在信息增益上。

在进入正题之前,我们需要先了解一些简单的概念。第一个需要我们了解的概念叫做熵/entropy。学过中学物理的朋友们可能会有一些印象:熵,热力学中表征物质状态的参量之一,用符号S表示,其物理意义是体系混乱程度的度量。

熵这个概念最初源自于热力学中,1948年,香农引入了信息熵,将其定义为离散随机事件出现的概率。在信息学里面,熵是对不确定性的度量。 一个系统越是有序,信息熵就越低,反之一个系统越是混乱,它的信息熵就越高。 所以信息熵可以被认为是系统有序化程度的一个度量。其本质与热力学中的熵的概念是相同的。

可这又和我们今天要讲的信息增益这个评判标准有什么关系呢?我们不妨这样想,当我们得到一组信息,一组类似于上图左半部分的信息。该组信息有多个特征(如学历、学校等),同时有一组综合每一个特征得到的结论。上图展示的这组信息只有A、B、C、D四个实例,倘若我们有成千上万个实例,但看这成千上万实例构成的表格,我们的第一感受可能是混乱。没错,如此多的实例,粗鲁地被凭借在同一个表格中,实在是太混乱了。将混乱换成我们刚刚提到过的说法:这组信息的信息熵太高了。 这样的场景,尤其是当我们想要通过这张表去查询某些东西,更是非常不便。我们希望可以有某种方法,在降低系统混乱程度/降低系统熵值的同时,不损害信息的完整性。那么有没有这么一种方法呢?当然有的,就是我们今天讲到的决策树算法。

从上图的左边,到上图右边的转变,我们可以非常直观感受到,这组信息不仅变得不那么混乱,而且这种树形的表示方式,比较符合我们人类的思维习惯。为什么会出现这样感受上的差异呢?其实很简单,因为我们从右图的根节点开始,每做一次特征的划分,整个系统的熵值就得到了一次降低。 这个信息系统给我们的感受也就越来越规范。进而,我们很容易地引出信息增益地概念:信息增益就是我们以某一个特征划分某个信息系统后,这个系统整体信息熵降的数值。

接下来,我们很容易可以回答如何去判断一个特征的好坏:如果一个特征,相较于其他所有特征,在将一个信息系统按照该特征划分前后,可以将整个数据系统的信息熵降到最低(信息增益最大),这个特征就是一个好的特征。我们应该优先使用该特征进行系统的划分。

2.3、信息熵、信息增益的计算

在此,我们先给出信息熵的计算公式:

知道了信息熵的计算公式后,信息增益的计算公式也很容易理解,就是当前系统的信息熵S,减去按照某个特征划分整个系统后,每个子系统的信息熵乘以每个子系统在整个系统所占比例(Si X Pi),最后相加得到的值。也即:信息增益 InfoGain = S-Σ(SixPi)。

举个例子,我们得到如下图所示的一个信息系统(该系统前四列为不同的四个特征,最后一列为结果。),那么要如何计算整个系统的信息熵,以及该系统对应某个特征的信息增益呢?

首先,可以看出,结果列中一共有14个样例,其中包括9个正例和5个负例。那么当前信息的熵计算

上面,我们计算出了整个系统的信息熵,也就是未对数据进行划分时的信息熵。那么下面我们计算使用某个特征对系统进行划分后,整个系统的信息熵,以及划分前后系统信息熵的差值(信息增益)比如,我们根据第一个特征Outlook进行划分:

划分后,数据被分为三部分了,那么各个分支的信息熵(子系统信息熵)计算如下:

我们将每个子系统的信息熵,乘以该子系统在整个系统中所占比例,依次相加后,得到划分后系统的整体信息熵。如下图所示:

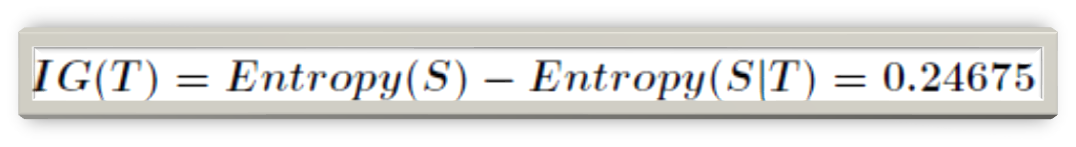

最后,终于来到我们最激动人心的一步了,计算信息增益,如下图所示:

2.4、决策树构建方法

在上一步中,我们计算出每个特征所对应地信息增益,选取信息增益最大的特征优先划分整个系统(将系统划分为一个个子数据集/子树/子系统)。

在每个子系统中,我们再 重新计算 未被使用过的特征的优先级,并选择优先级最大的特征继续划分数据集构造子树。知道,该递归构造子树的过程因为某些原因终止为止。

2.4、构造终止的条件/何时停止构造子树?

1、当我们发现一个子树中,结果完全相同,如结果全部为YES的时候,就没有在该子树中继续构造下去的必要了(其他子树中的构造过程未必终止)。此时我们得到该子树最终的结果为YES。

2、当我们发现一个子树中,虽然其结果没有完全相同,但已经没有可以支撑我们继续构造子树的特征了(简而言之就是所有特征都已经用过了),这个时候就可以停止在该子树中继续构造了。此时,该子树的最终结果为该子树集合的结果列中,出现次数最多的哪个属性值。

3、算法总结

1、判断每一个子树中的每个例子结果是否一致或是否特征已用尽

是:该子树构造完成,返回该子树对应的最终结果。

否:继续递归构造子树

若1中结果为否,则:

1.1、计算当前子系统信息熵

1.2、计算未被使用过的特征的信息增益

1.3、选取最大的信息增益的特征进行划分,并从特征集合中删除该特征

1.4、根据3中划分构造子树,并转向步骤1。

【Machine Learning·机器学习】决策树之ID3算法(Iterative Dichotomiser 3)的更多相关文章

- 【Machine Learning】决策树之ID3算法 (2)

决策树之ID3算法 Content 1.ID3概念 2.信息熵 3.信息增益 Information Gain 4. ID3 bias 5. Python算法实现(待定) 一.ID3概念 ID3算法最 ...

- 机器学习-决策树之ID3算法

概述 决策树(Decision Tree)是一种非参数的有监督学习方法,它是一种树形结构,所以叫决策树.它能够从一系列有特征和标签的数据中总结出决策规则,并用树状图的结构来呈现这些规则,以解决分类和回 ...

- 【Machine Learning】决策树案例:基于python的商品购买能力预测系统

决策树在商品购买能力预测案例中的算法实现 作者:白宁超 2016年12月24日22:05:42 摘要:随着机器学习和深度学习的热潮,各种图书层出不穷.然而多数是基础理论知识介绍,缺乏实现的深入理解.本 ...

- Portal:Machine learning机器学习:门户

Machine learning Machine learning is a scientific discipline that explores the construction and stud ...

- 决策树之ID3算法

一.决策树之ID3算法简述 1976年-1986年,J.R.Quinlan给出ID3算法原型并进行了总结,确定了决策树学习的理论.这可以看做是决策树算法的起点.1993,Quinlan将ID3算法改进 ...

- [原创]Machine Learning/机器学习 文章合集

转载请注明出处:https://www.codelast.com/ ➤ 用人话解释机器学习中的Logistic Regression(逻辑回归) ➤ 如何防止softmax函数上溢出(overflow ...

- [Machine Learning] 机器学习常见算法分类汇总

声明:本篇博文根据http://www.ctocio.com/hotnews/15919.html整理,原作者张萌,尊重原创. 机器学习无疑是当前数据分析领域的一个热点内容.很多人在平时的工作中都或多 ...

- Machine Learning:机器学习算法

原文链接:https://riboseyim.github.io/2018/02/10/Machine-Learning-Algorithms/ 摘要 机器学习算法分类:监督学习.半监督学习.无监督学 ...

- 简单易学的机器学习算法——决策树之ID3算法

一.决策树分类算法概述 决策树算法是从数据的属性(或者特征)出发,以属性作为基础,划分不同的类.例如对于如下数据集 (数据集) 其中,第一列和第二列为属性(特征),最后一列为类别标签,1表示是 ...

随机推荐

- Spring Bean的3种装配方式

Bean常用的装配方式有3种: 基于xml的装配 基于Annotation(注解)的装配 基于Java类的装配 基于xml的装配 在xml文件中配置Bean. 如果依赖很多,xml配置文件会很臃肿,后 ...

- 解读TIME_WAIT--你在网上看到的大多数帖子可能都是错误的

由于TCP协议整个机制也非常复杂我只能尽可能的在某一条线上来说,不可能面面俱到,如果有疏漏或者对于内容有异议可以留言.谢谢大家. 查看服务器上各个状态的统计数量: netstat -ant | awk ...

- gRPC入坑记

概要 由于gRPC主要是谷歌开发的,由于一些已知的原因,gRPC跑demo还是不那么顺利的.单独写这一篇,主要是gRPC安装过程中的坑太多了,记录下来让大家少走弯路. 主要的坑: 如果使用PHP.Py ...

- 【koa2基础框架封装】基于Proxy路由按需加载器和初始加载器

我们在使用koa2做路由拦截后一般都习惯于直接将查找对应处理函数的过程映射到项目的文件夹目录,如: router.get('/test', app.controller.index.test); ap ...

- cat more less 命令混用

在Linux系统中有三种命令可以用来查阅全部的文件,分别是cat.more和less命令.它们查阅文件的使用方法也比较简单都是 命令 文件名 ,但是三者又有着区别. 1.cat命令可以一次显示整个文件 ...

- 如何安装xenserver

xenserver安装 选择键盘 是否同意协议 清理磁盘 选择本地磁盘安装 选择本地镜像文件 输入管理密码 配置IP地址 配置DNS服务器地址 选择地点 配置NTP服务器地址 开始安装 安装完成

- POJ 2679:Adventurous Driving(SPFA+DFS)

http://poj.org/problem?id=2679 Adventurous Driving Time Limit: 1000MS Memory Limit: 65536K Total S ...

- JavaSE核心知识

一:Java简介 1. Java语言的介绍:Java是一门面向对象编程语言,具有功能强大和简单易用两个特征. 2. Java语言的特点:简单性.面向对象.分布式.健壮性.安全性.平台独立与可移植性.多 ...

- 实现socket的服务和客户端通信

对学习过程中自己敲的一些关于socket有关的代码做了个简单总结,在这分享一下,给有需要的同学借鉴一下. 什么是socket? 网络上的两个程序通过一个双向的通信连接实现数据的交换,这个连接的一端称为 ...

- C++学习书籍推荐《C++ Primer 第四版》下载

百度云及其他网盘下载地址:点我 编辑推荐 <C++ Primer中文版(第4版)>对C++基本概念和技术全面而且权威的阐述,对现代C++编程风格的强调,使<C++ Primer中文版 ...