Python html.parser库学习小结

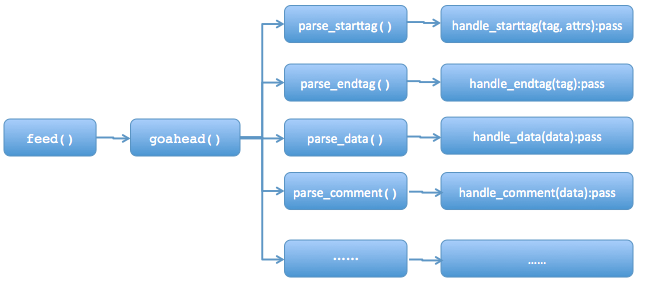

- feed(data):主要用于接受带html标签的str,当调用这个方法时并提供相应的data时,整个实例(instance)开始执行,结束执行close()。

- handle_starttag(tag, attrs): 这个方法接收Parse_starttag返回的tag和attrs,并进行处理,处理方式通常由使用者进行覆盖,本身为空。例如,连接的start tag是<a>,那么对应的参数tag=’a’(小写)。attrs是start tag <>中的属性,以元组形式(name, value)返回(所有这些内容都是小写)。例如,对于<A HREF="http://www.baidu.com“>,那么内部调用形式为:handle_starttag(’a’,[(‘href’,’http://www.baidu.com)]).

- handle_endtag(tag):跟上述一样,只是处理的是结束标签,也就是以</开头的标签。

- handle_data(data):处理的是网页的数据,也就是开始标签和结束标签之间的内容。例如:<script>...</script>的省略号内容

- reset():将实例重置,包括作为参数输入的数据进行清空。

</h3>

<p class="tb-subtitle">

【购机即送布丁套+高清贴膜+线控耳机+剪卡器+电影支架等等,套餐更多豪礼更优惠】 【购机即送布丁套+高清贴膜+线控耳机+剪卡器+电影支架等等,套餐更多豪礼更优惠】 【金冠信誉+顺丰包邮+全国联保---多重保障】

</p>

<div id="J_TEditItem" class="tb-editor-menu"></div>

【现货增强/标准】MIUI/小米 红米手机2红米2移动联通电信4G双卡

</h3>

<p class="tb-subtitle">

[红米手机2代颜色版本较多,请亲们阅读购买说明按需选购---感谢光临] 【金皇冠信誉小米手机集市销量第一】【购买套餐送高清钢化膜+线控通话耳机+ 剪卡器(含还原卡托)+ 防辐射贴+专用高清贴膜+ 擦机布+ 耳机绕线器+手机电影支架+ 一年延保服务+ 默认享受顺丰包邮 !

</p>

<div id="J_TEditItem" class="tb-editor-menu"></div>

- #定义一个MyParser继承自HTMLParser

- class MyParser(HTMLParser):

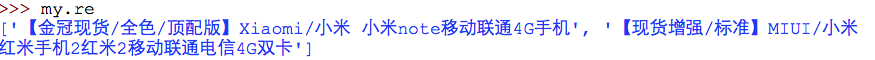

- re=[]#放置结果

- flg=0#标志,用以标记是否找到我们需要的标签

- def handle_starttag(self, tag, attrs):

- if tag=='h3':#目标标签

- for attr in attrs:

- if attr[0]=='class' and attr[1]=='tb-main-title':#目标标签具有的属性

- self.flg=1#符合条件则将标志设置为1

- break

- else:

- pass

- def handle_data(self, data):

- if self.flg==1:

- self.re.append(data.strip())#如果标志为我们需要的标志,则将数据添加到列表中

- self.flg=0#重置标志,进行下次迭代

- else:

- pass

- my=MyParser()

- my.feed(html)

Python html.parser库学习小结的更多相关文章

- PYTHON HTML.PARSER库学习小结--转载

前段时间,一朋友让我做个小脚本,抓一下某C2C商城上竞争对手的销售/价格数据,好让他可以实时调整自己的营销策略.自己之前也有过写爬虫抓某宝数据的经历,实现的问题不大,于是就答应了.初步想法是利用pyh ...

- python爬虫解析库学习

一.xpath库使用: 1.基本规则: 2.将文件转为HTML对象: html = etree.parse('./test.html', etree.HTMLParser()) result = et ...

- Python之matplotlib库学习

matplotlib 是python最著名的绘图库,它提供了一整套和matlab相似的命令API,十分适合交互式地进行制图.而且也可以方便地将它作为绘图控件,嵌入GUI应用程序中. 它的文档相当完备, ...

- python 之Requests库学习笔记

1. Requests库安装 Windows平台安装说明: 直接以管理员身份打开cmd运行界面,使用pip管理工具进行requests库的安装. 具体安装命令如下: >pip instal ...

- Python之matplotlib库学习:实现数据可视化

1. 安装和文档 pip install matplotlib 官方文档 为了方便显示图像,还使用了ipython qtconsole方便显示.具体怎么弄网上搜一下就很多教程了. pyplot模块是提 ...

- 基于Windows平台的Python多线程及多进程学习小结

python多线程及多进程对于不同平台有不同的工具(platform-specific tools),如os.fork仅在Unix上可用,而windows不可用,该文仅针对windows平台可用的工具 ...

- Python之Pandas库学习(二):数据读写

1. I/O API工具 读取函数 写入函数 read_csv to_csv read_excel to_excel read_hdf to_hdf read_sql to_sql read_json ...

- Python之Pandas库学习(一):简介

官方文档 1. 安装Pandas windos下cmd:pip install pandas 导入pandas包:import pandas as pd 2. Series对象 带索引的一维数组 创建 ...

- python的pandas库学习笔记

导入: import pandas as pd from pandas import Series,DataFrame 1.两个主要数据结构:Series和DataFrame (1)Series是一种 ...

随机推荐

- Java基础常见英语词汇

Java基础常见英语词汇(共70个) ['ɔbdʒekt] ['ɔ:rientid]导向的 ['prəʊɡræmɪŋ]编程 OO: object ...

- (转)javascript异步编程的四种方法

本文转自:http://www.ruanyifeng.com/blog/2012/12/asynchronous%EF%BC%BFjavascript.html 作者:阮一峰 本文仅仅作为个人mark ...

- Linux常用命令1

jps(Java Virtual Machine Process Status Tool)是JDK 1.5提供的一个显示当前所有Java进程pid的命令. jps [ options ] [ host ...

- http://bbs.ednchina.com/BLOG_345002072_2001308.HTM

http://bbs.ednchina.com/BLOG_345002072_2001308.HTM

- 【英语魔法俱乐部——读书笔记】 2 中级句型-复句&合句(Complex Sentences、Compound Sentences)

[英语魔法俱乐部——读书笔记] 2 中级句型-复句&合句(Complex Sentences.Compound Sentences):(2.1)名词从句.(2.2)副词从句.(2.3)关系从句 ...

- CSS实现DIV水平自适应居中

DIV水平自适应居中 <!DOCTYPE html> <html lang="cn"> <head> <meta charset=&quo ...

- Native wifi API使用

写于博客园,自己迁过来: 一.WlanOpenHandle打开一个客户端句柄 DWORD WINAPI WlanOpenHandle( __in DWORD dwClientVersion, __re ...

- 发现IE7的一个问题,不能用索引取字符串中的单个字符

如下javascript: var testValue="hello,world"; alert(testValue[]); 在IE7上运行该代码,竟然提示值为"unde ...

- python爬虫——黑板客老师课程学习

程序: 目标url 内容提取 表现形式 为什么: 大数据——数据膨胀,信息太多了,不知道哪些信息适合你,例如谷歌搜索引擎. 垂直行业搜索——某一个行业的搜索,与搜索引擎最大的区别:搜索引擎是告诉你哪些 ...

- spring mvc学习笔记二:@RequestMapping

@RequestMapping RequestMapping是一个用来处理请求地址映射的注解,可用于类或方法上.用于类上,表示类中的所有响应请求的方法都是以该地址作为父路径. @RequestMapp ...