Flume(二)【入门】

一.安装部署

下载安装包,解压,分发多节点

1.安装地址

(1) Flume官网:http://flume.apache.org/

(2)文档查看:http://flume.apache.org/FlumeUserGuide.html

(3)下载:http://archive.apache.org/dist/flume/

2.安装步骤

(1)将apache-flume-1.9.0-bin.tar.gz上传到linux的/opt/software目录下

(2)解压apache-flume-1.9.0-bin.tar.gz到/opt/module/目录下

tar -zxf /opt/software/apache-flume-1.9.0-bin.tar.gz -C /opt/module/

(3)修改apache-flume-1.9.0-bin的名称为flume

mv /opt/module/apache-flume-1.9.0-bin /opt/module/flume

(4)将lib文件夹下的guava-11.0.2.jar删除以兼容Hadoop 3.1.3,否则报错

rm /opt/module/flume/lib/guava-11.0.2.jar

二.入门案例

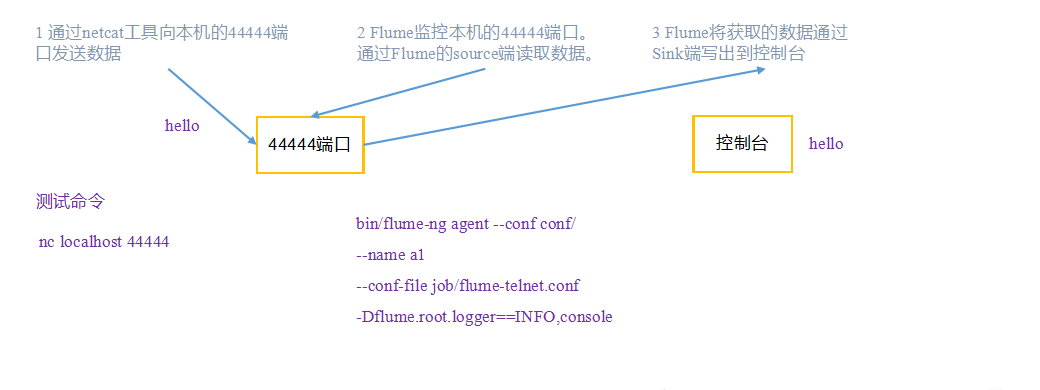

1.官方案例(nestat->logger)

需求:使用Flume监听一个端口,收集该端口数据,并打印到控制台。

需求分析

步骤

1)安装netcat工具

[atguigu@hadoop102 software]$ sudo yum install -y nc

2)判断44444端口是否被占用

[atguigu@hadoop102 flume-telnet]$ sudo netstat -tunlp | grep 44444

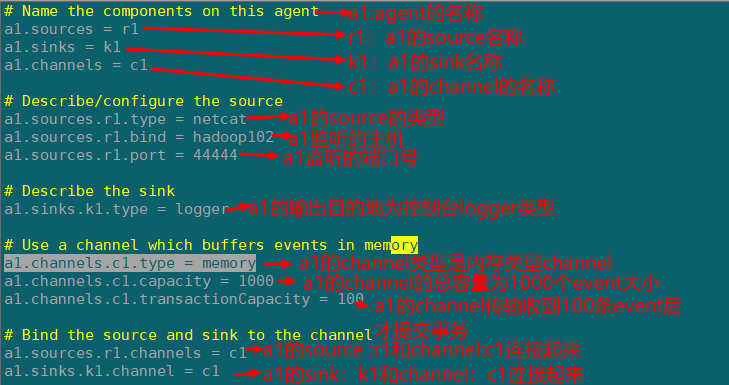

3)创建Flume Agent配置文件flume-netcat-logger.conf

在opt/modult/flume目录下创建job目录用来存放flume agent的配置文件,在job文件夹下创建flume-netcat-logger.conf。

[atguigu@hadoop102 flume]$ mkdir job

[atguigu@hadoop102 flume]$ cd job/

[atguigu@hadoop102 job]$ vim flume-netcat-logger.conf

在flume-netcat-logger.conf添加如下内容

添加内容如下:

# Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# Describe the sink

a1.sinks.k1.type = logger

# Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

注:配置文件来源于官方手册http://flume.apache.org/FlumeUserGuide.html

配置文件解析

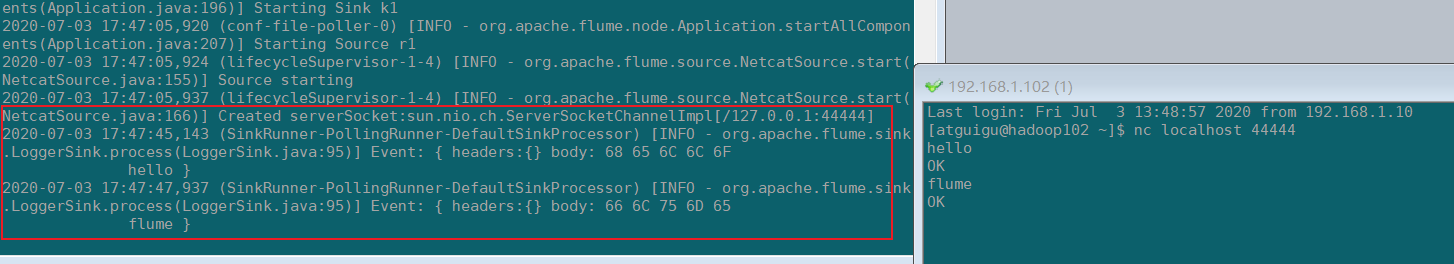

4)先开启flume监听端口

[atguigu@hadoop102 flume]$ bin/flume-ng agent --conf conf/ --name a1 --conf-file job/flume-netcat-logger.conf -Dflume.root.logger=INFO,console

缩写形式

[atguigu@hadoop102 flume]$ bin/flume-ng agent -c conf/ -n a1 -f job/flume-netcat-logger.conf -Dflume.root.logger=INFO,console

参数说明

--conf/-c:表示配置文件存储在conf/目录

--name/-n:表示给agent起名为a1

--conf-file/-f:flume本次启动读取的配置文件是在job文件夹下的flume-telnet.conf文件。

-Dflume.root.logger=INFO,console :-D表示flume运行时动态修改flume.root.logger参数属性值,并将控制台日志打印级别设置为INFO级别。日志级别包括:log、info、warn、error。

5)使用netcat工具向本机的44444端口发送内容

[atguigu@hadoop102 ~]$ nc localhost 44444

hello

flume

6)在Flume监听页面观察数据接收情况

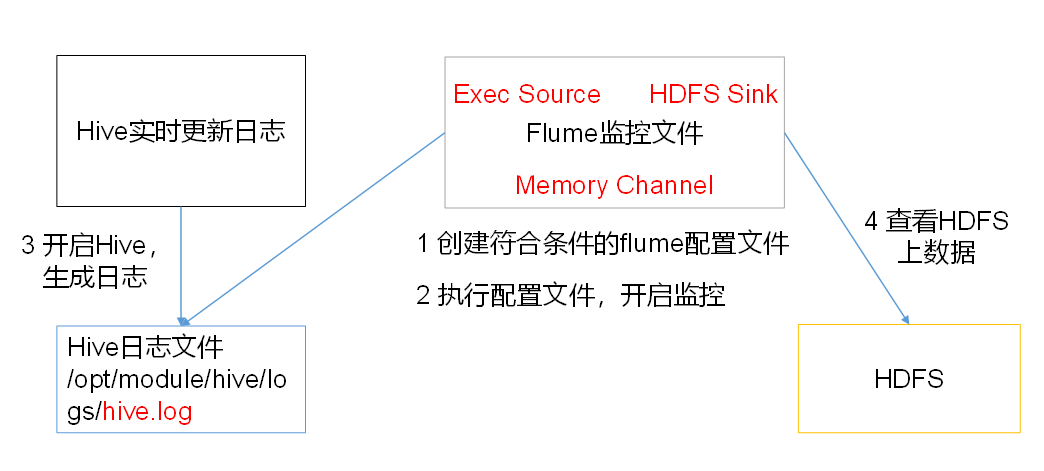

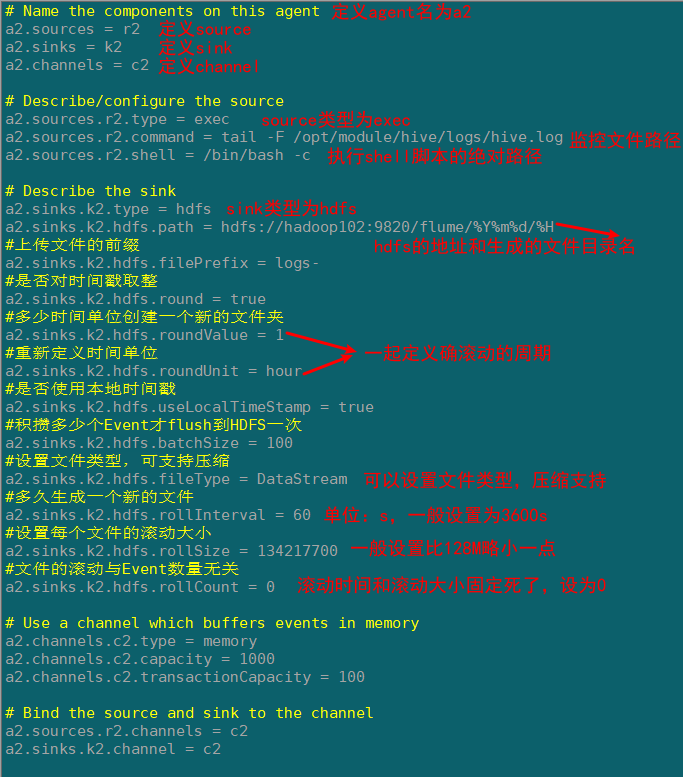

2.实时监控单个追加文件(exec->hdfs)

需求:实时监控Hive日志,并上传到HDFS中

需求分析

步骤

1)创建flume-file-hdfs.conf文件

注:要想读取Linux系统中的文件,就得按照Linux命令的规则执行命令。由于Hive日志在Linux系统中所以读取文件的类型选择:exec即execute执行的意思。表示执行Linux命令来读取文件。

添加一下内容:

# Name the components on this agent

a2.sources = r2

a2.sinks = k2

a2.channels = c2

# Describe/configure the source

a2.sources.r2.type = exec

a2.sources.r2.command = tail -F /opt/module/hive/logs/hive.log

a2.sources.r2.shell = /bin/bash -c

# Describe the sink

a2.sinks.k2.type = hdfs

a2.sinks.k2.hdfs.path = hdfs://hadoop102:9820/flume/%Y%m%d/%H

#上传文件的前缀

a2.sinks.k2.hdfs.filePrefix = logs-

#是否对时间戳取整

a2.sinks.k2.hdfs.round = true

#多少时间单位创建一个新的文件夹

a2.sinks.k2.hdfs.roundValue = 1

#重新定义时间单位

a2.sinks.k2.hdfs.roundUnit = hour

#是否使用本地时间戳

a2.sinks.k2.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a2.sinks.k2.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a2.sinks.k2.hdfs.fileType = DataStream

#多久生成一个新的文件

a2.sinks.k2.hdfs.rollInterval = 60

#设置每个文件的滚动大小

a2.sinks.k2.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a2.sinks.k2.hdfs.rollCount = 0

# Use a channel which buffers events in memory

a2.channels.c2.type = memory

a2.channels.c2.capacity = 1000

a2.channels.c2.transactionCapacity = 100

# Bind the source and sink to the channel

a2.sources.r2.channels = c2

a2.sinks.k2.channel = c2

配置文件解析

2)运行Flume agent

[atguigu@hadoop102 flume]$ bin/flume-ng agent -c conf/ --n a2 -f job/flume-file-hdfs.conf

3)启动hdfs集群和hive

[atguigu@hadoop102 hadoop-2.7.2]$ sbin/start-dfs.sh

[atguigu@hadoop103 hadoop-2.7.2]$ sbin/start-yarn.sh

[atguigu@hadoop102 hive]$ bin/hive

hive (default)>

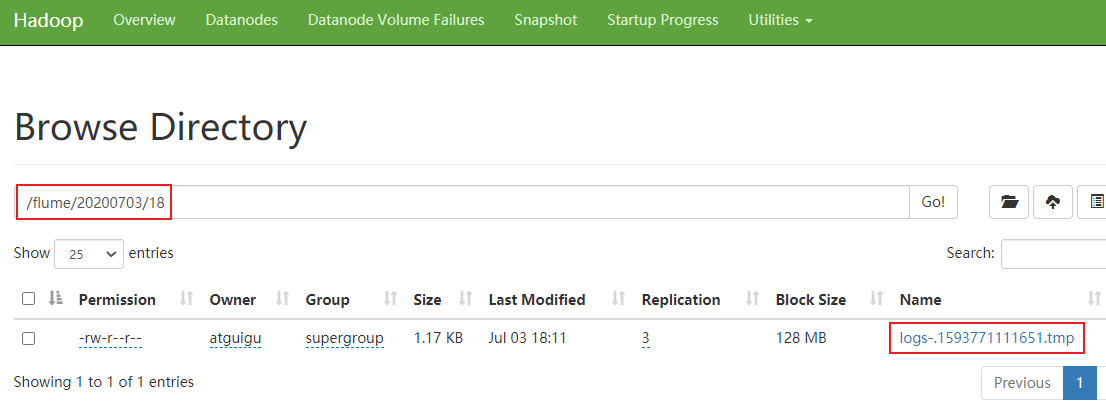

4)查看hdfs的上文件

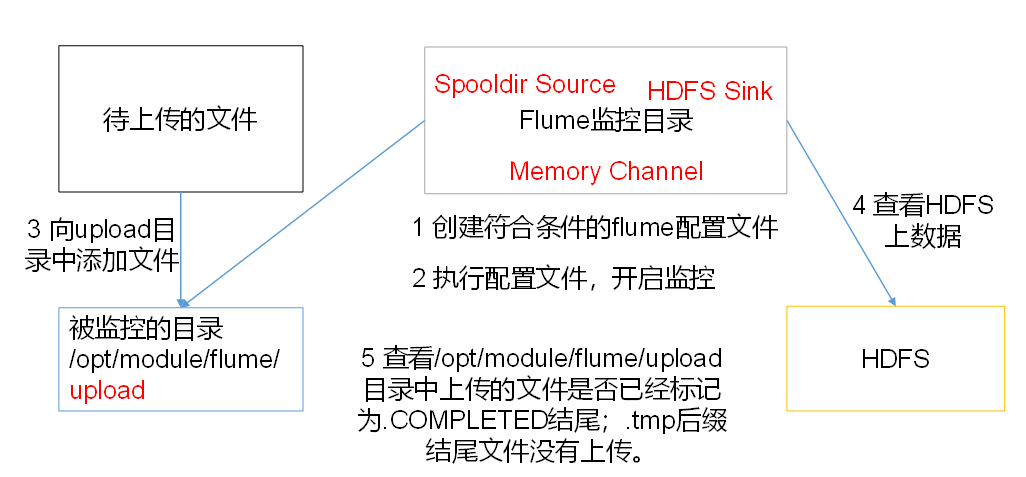

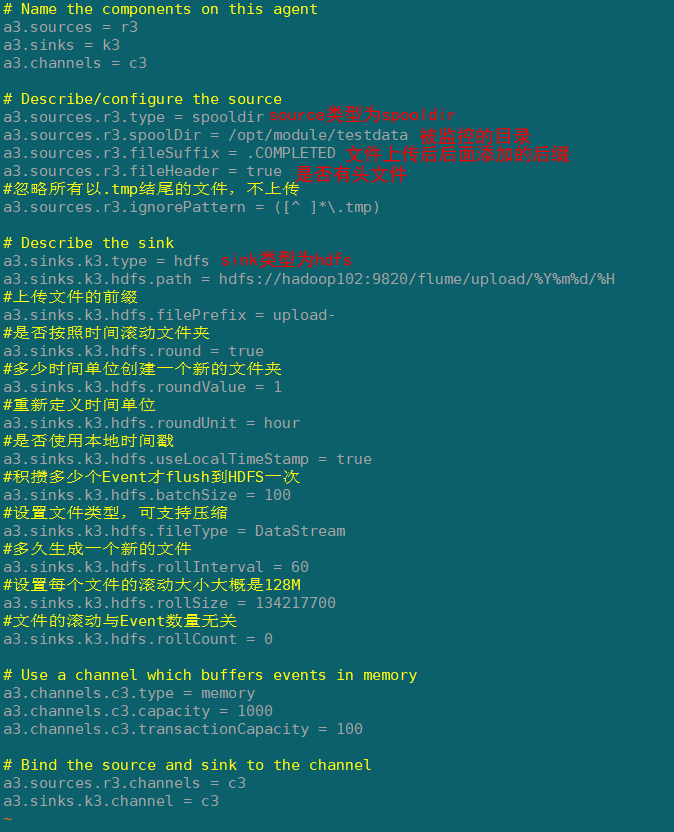

3.实时监控目录下多个新文件(spooldir->hdfs)

案例需求:使用Flume监听整个目录的文件,并上传至HDFS

需求分析

步骤

1)创建配置文件flume-dir-hdfs.conf

添加一下内容

a3.sources = r3

a3.sinks = k3

a3.channels = c3

# Describe/configure the source

a3.sources.r3.type = spooldir

a3.sources.r3.spoolDir = /opt/module/testdata

a3.sources.r3.fileSuffix = .COMPLETED

a3.sources.r3.fileHeader = true

#忽略所有以.tmp结尾的文件,不上传

a3.sources.r3.ignorePattern = ([^ ]*\.tmp)

# Describe the sink

a3.sinks.k3.type = hdfs

a3.sinks.k3.hdfs.path = hdfs://hadoop102:9820/flume/upload/%Y%m%d/%H

#上传文件的前缀

a3.sinks.k3.hdfs.filePrefix = upload-

#是否按照时间滚动文件夹

a3.sinks.k3.hdfs.round = true

#多少时间单位创建一个新的文件夹

a3.sinks.k3.hdfs.roundValue = 1

#重新定义时间单位

a3.sinks.k3.hdfs.roundUnit = hour

#是否使用本地时间戳

a3.sinks.k3.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a3.sinks.k3.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a3.sinks.k3.hdfs.fileType = DataStream

#多久生成一个新的文件

a3.sinks.k3.hdfs.rollInterval = 60

#设置每个文件的滚动大小大概是128M

a3.sinks.k3.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a3.sinks.k3.hdfs.rollCount = 0

# Use a channel which buffers events in memory

a3.channels.c3.type = memory

a3.channels.c3.capacity = 1000

a3.channels.c3.transactionCapacity = 100

# Bind the source and sink to the channel

a3.sources.r3.channels = c3

a3.sinks.k3.channel = c3

配置文件解析

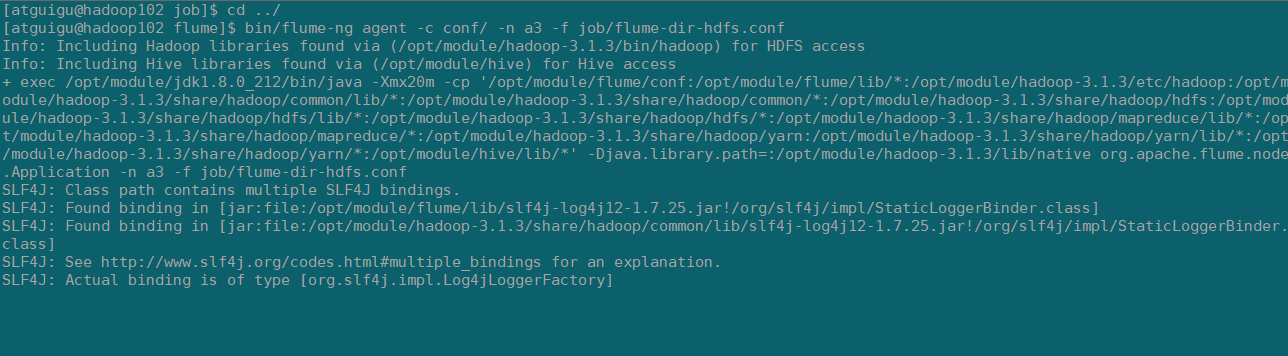

2)启动监控文件夹命令

[atguigu@hadoop102 flume]$ bin/flume-ng agent -c conf/ -n a3 -f job/flume-dir-hdfs.conf

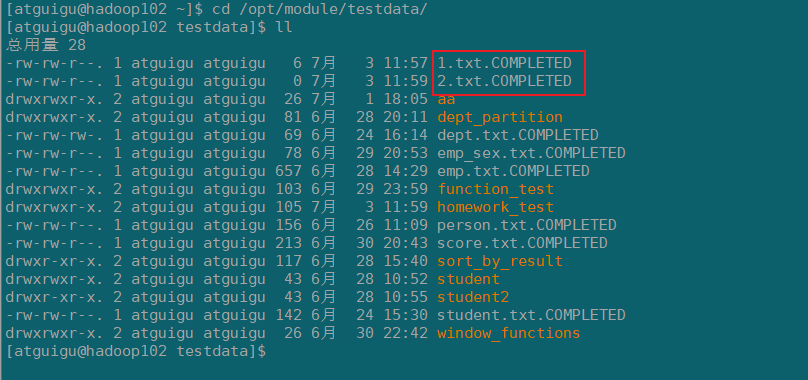

3)向testdata文件夹中添加文件

观察文件名

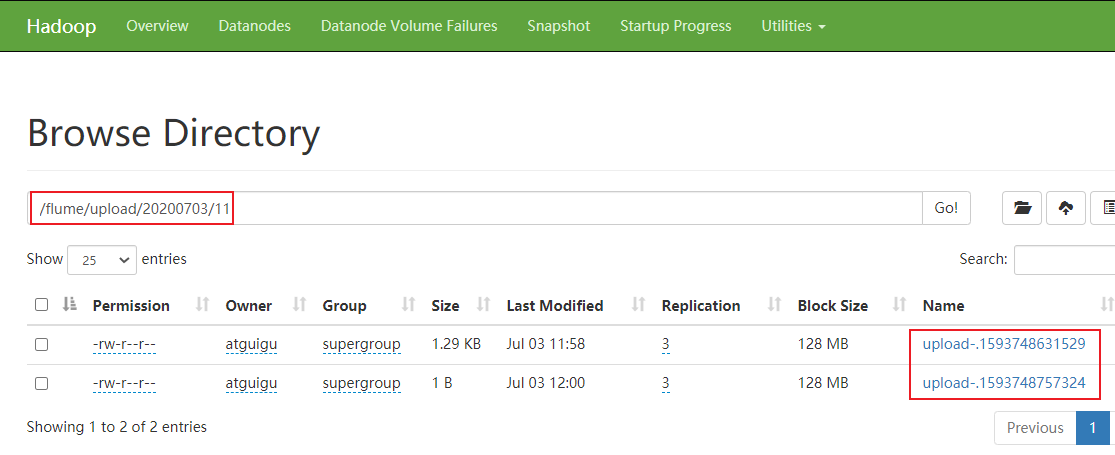

4)查看hdfs上数据

注意

- 在监控目录下的文件修改文件名的会,会再次上传,所以不要持续改动

2)上传成功后文件会以.complted结尾,

3)同名文件上传两次会导致任务挂掉,第二次的文件不会上传,需要删除第二次的同名文件

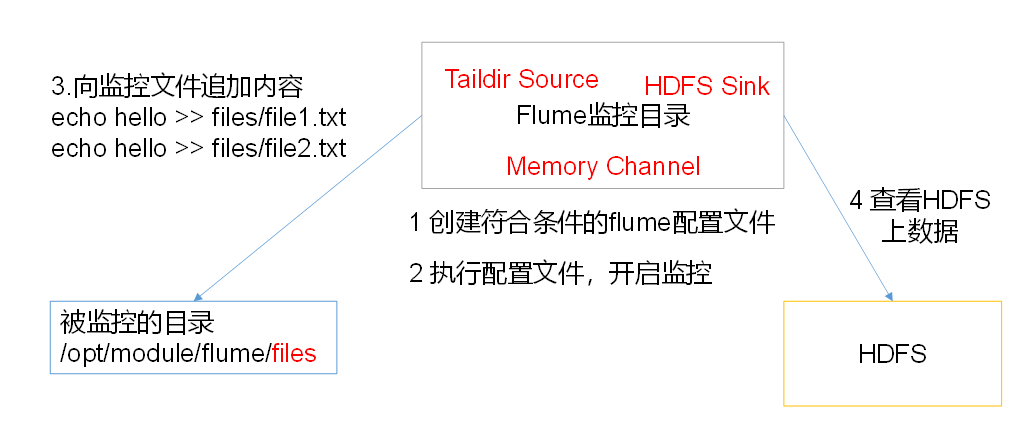

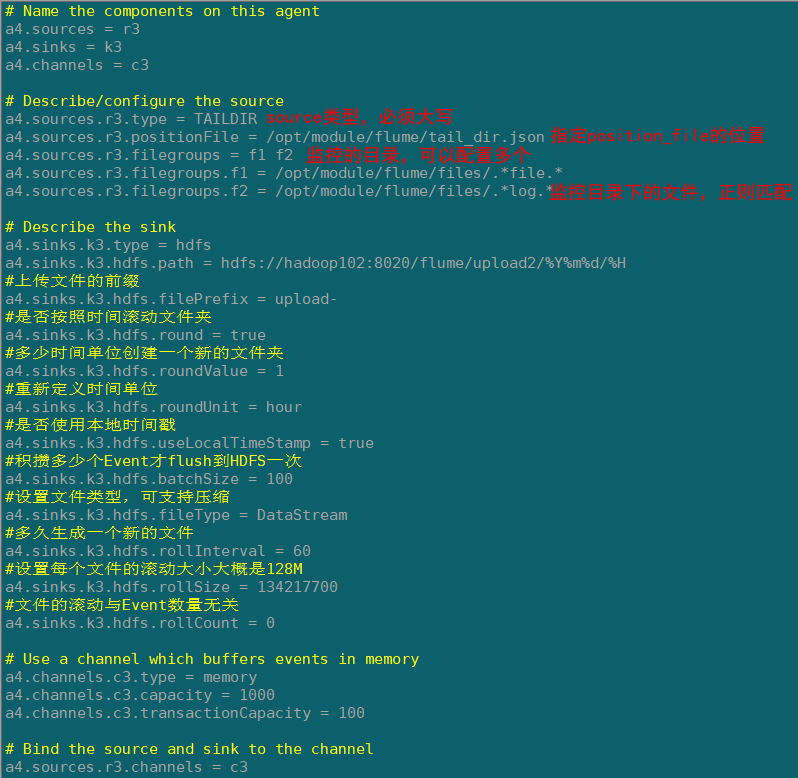

4.实时监控目录下的多个追加文件(Taildir->hdfs)

Exec source适用于监控一个实时追加的文件,不能实现断点续传;Spooldir Source适合用于同步新文件,但不适合对实时追加日志的文件进行监听并同步;而Taildir Source适合用于监听多个实时追加的文件,并且能够实现断点续传。

案例需求:使用Flume监听整个目录的实时追加文件,并上传至HDFS

需求分析

步骤

1)创建配置文件flume-taildir-hdfs.conf

添加一下内容:

# Name the components on this agent

a4.sources = r3

a4.sinks = k3

a4.channels = c3

# Describe/configure the source

a4.sources.r3.type = TAILDIR

a4.sources.r3.positionFile = /opt/module/flume/tail_dir.json

a4.sources.r3.filegroups = f1 f2

a4.sources.r3.filegroups.f1 = /opt/module/flume/files/.*file.*

a4.sources.r3.filegroups.f2 = /opt/module/flume/files/.*log.*

# Describe the sink

a4.sinks.k3.type = hdfs

a4.sinks.k3.hdfs.path = hdfs://hadoop102:9820/flume/upload2/%Y%m%d/%H

#上传文件的前缀

a4.sinks.k3.hdfs.filePrefix = upload-

#是否按照时间滚动文件夹

a4.sinks.k3.hdfs.round = true

#多少时间单位创建一个新的文件夹

a4.sinks.k3.hdfs.roundValue = 1

#重新定义时间单位

a4.sinks.k3.hdfs.roundUnit = hour

#是否使用本地时间戳

a4.sinks.k3.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a4.sinks.k3.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a4.sinks.k3.hdfs.fileType = DataStream

#多久生成一个新的文件

a4.sinks.k3.hdfs.rollInterval = 60

#设置每个文件的滚动大小大概是128M

a4.sinks.k3.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a4.sinks.k3.hdfs.rollCount = 0

# Use a channel which buffers events in memory

a4.channels.c3.type = memory

a4.channels.c3.capacity = 1000

a4.channels.c3.transactionCapacity = 100

# Bind the source and sink to the channel

a4.sources.r3.channels = c3

a4.sinks.k3.channel = c3

配置文件解析

2)启动监控文件夹命令

[atguigu@hadoop102 flume]$ bin/flume-ng agent --conf conf/ --name a3 --conf-file job/flume-taildir-hdfs.conf

3)向files文件夹追加内容

在opt/module/flume创建files文件夹,添加文件

[atguigu@hadoop102 flume]$ mkdir files

[atguigu@hadoop102 files]$ echo hello >> file1.txt

[atguigu@hadoop102 files]$ echo atguigu >> file2.txt

4)查看hdfs

Taildir

Taildir Source维护了一个json格式的position File,其会定期的往position File中更新每个文件读取到的最新的位置,因此能够实现断点续传。Position File的格式如下:

{"inode":2496272,"pos":12,"file":"/opt/module/flume/files/file1.txt"}

{"inode":2496275,"pos":12,"file":"/opt/module/flume/files/file2.txt"}

注:Linux中储存文件元数据的区域就叫做inode,每个inode都有一个号码,操作系统用inode号码来识别不同的文件,Unix/Linux系统内部不使用文件名,而使用inode号码来识别文件。

三.FAQ

1.注意hdfs的端口,ip别配置错误否则导致连接异常

2.注意flume1.9的lib包的guava包可能和hadoop中的冲突,以高版本的为准

Flume(二)【入门】的更多相关文章

- Android(Lollipop/5.0) Material Design(二) 入门指南

Material Design系列 Android(Lollipop/5.0)Material Design(一) 简介 Android(Lollipop/5.0)Material Design(二) ...

- 大数据技术之_09_Flume学习_Flume概述+Flume快速入门+Flume企业开发案例+Flume监控之Ganglia+Flume高级之自定义MySQLSource+Flume企业真实面试题(重点)

第1章 Flume概述1.1 Flume定义1.2 Flume组成架构1.2.1 Agent1.2.2 Source1.2.3 Channel1.2.4 Sink1.2.5 Event1.3 Flum ...

- Flume初入门简单配置与使用

1.Flume在集群中扮演的角色 Flume.Kafka用来实时进行数据收集,Spark.Storm用来实时处理数据,impala用来实时查询. 2.Flume框架简介 1.1 Flume提供一个分布 ...

- Flume 中文入门手冊

原文:https://cwiki.apache.org/confluence/display/FLUME/Getting+Started 什么是 Flume NG? Flume NG 旨在比起 Flu ...

- 《Java从入门到放弃》JavaSE入门篇:面向对象语法二(入门版)

想了半天,发现单独的封装和多态没什么好讲的,我们就简单说说Java里面对应的语法吧. 相关内容如下: 一.访问修饰符 二.getter/setter方法 三.构造方法 四.super和this 五.s ...

- Mybatis(二)入门程序-通过id查找用户、模糊查找用户、添加用户、删除用户

根据下图myBatis的架构,创建一个使用MyBatis的工程. 一.配置MyBatis 环境(如图) 1.sqlMapConfig.xml 首先,导入jar包(上图右边)并加载路径,然后 ...

- go微服务框架go-micro深度学习(二) 入门例子

上一篇帖子简单介绍了go-micro的整体框架结构,这一篇主要写go-micro使用方式的例子,中间会穿插一些go-micro的源码,和调用流程图,帮大家更好的理解go-micro的底层.更详细更具体 ...

- Flume - 快速入门

关于Flume,官方定义如下: Apache Flume is a distributed, reliable, and available system for efficiently collec ...

- 第1节 flume:6、flume的入门测试案例

案例:使用网络telent命令向一台机器发送一些网络数据,然后通过flume采集网络端口数据. 1.2.1 Flume的安装部署 第一步:下载解压修改配置文件 Flume的安装非常简单,只需要解压即可 ...

随机推荐

- coreseek使用心得

基本使用方法: D:\coreseek-4.1\bin\searchd -c D:\coreseek-4.1\etc\article.conf --stop 停止服务 D:\coreseek-4.1\ ...

- pycharm的基本使用 、 Python的注释语法,变量,常量,垃圾回收机制,数据类型

1.文件路径要注意 我把文件放在了D盘,如下图:你们可以根据自身情况设置 2.python环境要选择本地下载好的 如下图: 点击本机存在的环境,如果提示NO interpr,就点击第二步 如果还是没有 ...

- 云主机新增swap分区

云主机内存不够用,如何新增swap 分区. 如何启用swap分区? 步骤如下: 1.查看当前系统中是否已经启用swap分区 1 2 cat /proc/swaps top 2.如果没有启用swa ...

- 【Go语言学习笔记】Go的函数

函数还是这几块: 参数 返回值 作用域 执行顺序 参数和返回值 func FuncName(/*参数列表*/) (o1 type1, o2 type2/*返回类型*/) { //函数体 return ...

- 倒谱Cepstrum本质的理解

1.理解: 信号叠加时,不是都是线性关系(时域相互+ 频率相加):有的时候是两种信号成分相乘得到的,(时域卷积,频域相乘):比如很多齿轮啮合时振动信号调制现象,电机的轴向与径向的振动耦合时采集到的振动 ...

- 修改记事本PE结构弹计算器Shellcode

目录 修改记事本PE结构弹计算器Shellcode 0x00 前言 0x01 添加新节 修改节数量 节表位置 添加新节表信息 0x02 添加弹计算器Shellcode 修改代码 0x03 修改入口点 ...

- Oracle的主要组件和基本概念

oracle 简介 oracle(甲骨文)公司 1977年,三人合伙创办(Software Development Laboratories,SDL) 1979年,更名为Relational Soft ...

- Spring Boot 快速整合Swagger

一.前言 Spring Boot作为当前最为流行的Java web开发脚手架,越来越多的开发者选择用其来构建企业级的RESTFul API接口.这些接口不但会服务于传统的web端(b/s),也会服务于 ...

- 在 Node.js 中处理大 JSON 文件

在 Node.js 中处理大 JSON 文件 场景描述 问题一: 假设现在有一个场景,有一个大的 JSON 文件,需要读取每一条数据经过处理之后输出到一个文件或生成报表数据,怎么能够流式的每次读取一条 ...

- 常用的package.json以及React相关

常用的package.json以及React相关 前言 package.json 的简单介绍 简单版的 package.json 必备属性(name & version) name 字段 ve ...