tensorflow2.0 学习(二)

线性回归问题

# encoding: utf-8 import numpy as np

import matplotlib.pyplot as plt data = []

for i in range(100):

x = np.random.uniform(-10., 10.) #均匀分布产生x

eps = np.random.normal(0., 0.01) #高斯分布产生一个误差值

y = 1.477*x + 0.089 +eps #计算得到y值

data.append([x, y]) #保存到data中 data = np.array(data) #转成数组的方式方便处理

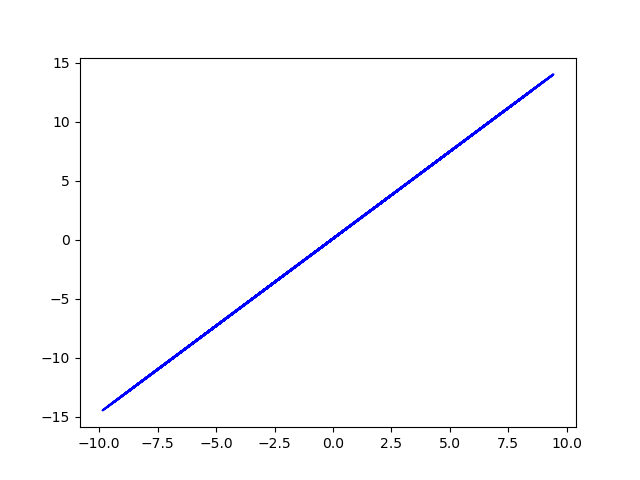

plt.plot(data[:,0], data[:,1], 'b') #自己引入用于观察原始数据

#plt.show()

plt.savefig('original data.png') def mse(b, w, points): #计算所有点的预测值和真实值之间的均方误差

totalError = 0

for i in range(0, len(points)):

x = points[i, 0]

y = points[i, 1]

totalError += (y -(w*x + b))**2 #真实值减预测值的平方

return totalError/float(len(points)) #返回平均误差值 def step_gradient(b_current, w_current, points, lr): #预测模型中梯度下降方式优化b和w

b_gradient = 0

w_gradient = 0

M = float(len(points))

for i in range(0, len(points)):

x = points[i, 0]

y = points[i, 1]

b_gradient += (2/M) * ((w_current*x + b_current) - y) #求偏导数的公式可知

w_gradient += (2/M)*x*((w_current*x + b_current) - y) #求偏导数的公式可知

new_b = b_current - (lr*b_gradient) #更新参数,使用了梯度下降法

new_w = w_current - (lr*w_gradient) #更新参数,使用了梯度下降法

return [new_b, new_w] def gradient_descent(points, starting_b, starting_w, lr, num_iterations): #循环更新w,b多次

b = starting_b

w = starting_w

loss_data = []

for step in range(num_iterations): #计算并更新一次

b, w = step_gradient(b, w, np.array(points), lr) #更新了这一次的b,w

loss = mse(b, w, points)

loss_data.append([step+1, loss])

if step % 50 == 0: #每50次输出一回

print(f"iteration:{step}, loss{loss}, w:{w}, b:{b}")

return [b, w, loss_data] def main():

lr = 0.01 #学习率,梯度下降算法中的参数

initial_b = 0 #初值

initial_w = 0

num_iterations = 1000 #学习100轮

[b, w, loss_data] = gradient_descent(data, initial_b, initial_w, lr, num_iterations)

loss = mse(b, w, data)

print(f'Final loss:{loss}, w:{w}, b:{b}') plt.figure() #观察loss每一步情况

loss_data = np.array(loss_data)

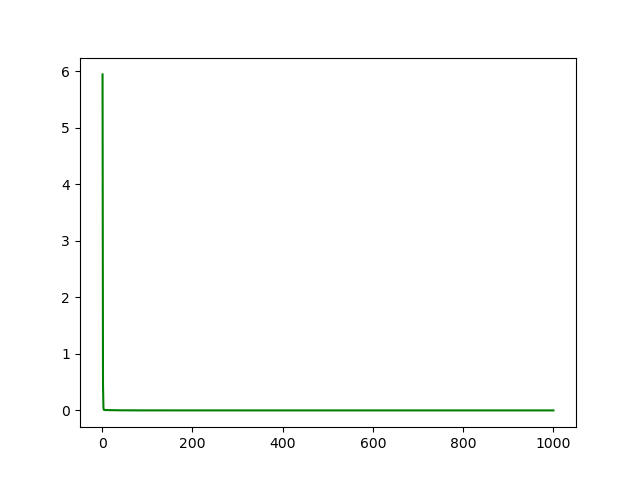

plt.plot(loss_data[:,0], loss_data[:,1], 'g')

plt.savefig('loss.png')

#plt.show() plt.figure() #观察最终的拟合效果

y_fin = w*data[:,0] + b + eps

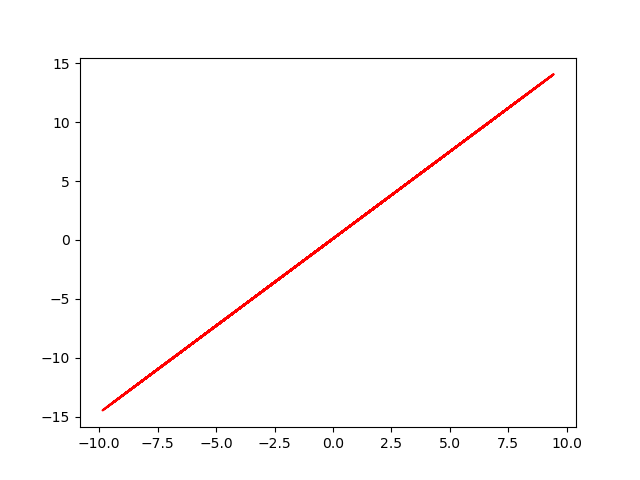

plt.plot(data[:,0], y_fin, 'r')

#plt.show()

plt.savefig('final data.png') if __name__ == '__main__':

main()

original data (y = w*x + b +eps)

loss rate

final data (y' = w' *x + b' + eps )

最终loss趋近9.17*10^-5, w趋近1.4768, b趋近0.0900

真实的w值1.477, b为0.089

对于线性回归问题,适用性挺好!

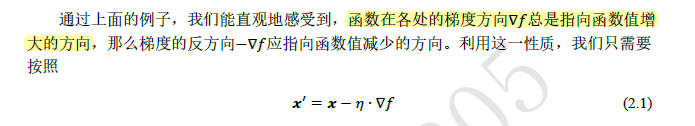

主要的数学代码能理解,唯有取梯度的反方向更新参数,不是很能理解!

这里还没有用到tensorflow,下一次更新基础知识!

tensorflow2.0 学习(二)的更多相关文章

- tensorflow2.0 学习(三)

用tensorflow2.0 版回顾了一下mnist的学习 代码如下,感觉这个版本下的mnist学习更简洁,更方便 关于tensorflow的基础知识,这里就不更新了,用到什么就到网上取搜索相关的知识 ...

- tensorflow2.0 学习(一)

虽说是按<TensorFlow深度学习>这本书来学习的,但是总会碰到新的问题!记录下这些问题,有利于巩固知新. 之前学过一些tensorflow1.0的知识,到RNN这章节,后面没有再继续 ...

- Tensorflow2.0学习(一)

站长资讯平台:今天学习一下Tensorflow2.0 的基础 核心库,@tf.function ,可以方便的将动态图的语言,变成静态图,在某种程度上进行计算加速 TensorFlow Lite Ten ...

- tensorflow2.0学习笔记

今天我们开始学习tensorflow2.0,用一种简单和循循渐进的方式,带领大家亲身体验深度学习.学习的目录如下图所示: 1.简单的神经网络学习过程 1.1张量生成 1.2常用函数 1.3鸢尾花数据读 ...

- TensorFlow2.0(二):数学运算

1 基本运算:加(+).减(-).点乘(*).除(/).地板除法(//).取余(%) 基本运算中所有实例都以下面的张量a.b为例进行: >>> a = tf.random.unifo ...

- tensorflow2.0学习笔记第一章第二节

1.2常用函数 本节目标:掌握在建立和操作神经网络过程中常用的函数 # 常用函数 import tensorflow as tf import numpy as np # 强制Tensor的数据类型转 ...

- tensorflow2.0学习笔记第二章第四节

2.4损失函数损失函数(loss):预测值(y)与已知答案(y_)的差距 nn优化目标:loss最小->-mse -自定义 -ce(cross entropy)均方误差mse:MSE(y_,y) ...

- tensorflow2.0学习笔记第二章第一节

2.1预备知识 # 条件判断tf.where(条件语句,真返回A,假返回B) import tensorflow as tf a = tf.constant([1,2,3,1,1]) b = tf.c ...

- tensorflow2.0学习笔记第一章第一节

一.简单的神经网络实现过程 1.1张量的生成 # 创建一个张量 #tf.constant(张量内容,dtpye=数据类型(可选)) import tensorflow as tf import num ...

随机推荐

- Python之路【第十九篇】:前端CSS

CSS 一.CSS概述 CSS是Cascading Style Sheets的简称,中文称为层叠式样式表,用来控制网页数据的表现,可以使网页的表现与数据内容分离. 学CSS后我们需要掌握的技能: 1. ...

- T100 GR 报表常见知识点 (含套版制作)

轉載至赫非域 > T100 GR 报表常见知识点 前端操作 bron1984 7小时前 5浏览 0评论 8.9.1 注意事项 字体: 如果字型没选对,会造成没设对字型的数据汇出 PDF 格式乱掉 ...

- JAVA十六进制数据接收与传输

一.十六进制转换工具类 主要包含十六进制字符串转ASCII,ASCII转十六进制字符串以及十六进制字符串转Byte数组等方法: /** * Created by wly on 2018/4/17. * ...

- vue-cli中轮播图vue-awesome-swiper使用方法

1 npm 安装 npm install vue-awesome-swiper --save 2在所用的组件中引入 import 'swiper/dist/css/swiper.css' import ...

- Elasticsearch7.3使用内置的JDK12

汇总:采用最简单的办法,就是在elasticsearch文件开头添加上这一行export JAVA_HOME=/home/vdb1/elastic_cluster/elasticsearch-7.3. ...

- Docker 使用入门 Hello World

结合上一篇的所说的内容:现在安装好了Docker 安装好了就要用嘛,所以,先走一个Hello World docker run ubuntu:15.10 /bin/echo "hello w ...

- 移动端开发rem布局之less+媒体查询布局的原理步骤和心得

rem即是以html文件中font-size的大小的倍数rem布局的原理:通过媒体查询设置不同屏幕宽度下的html的font-size大小,然后在css布局时用rem单位取代px,从而实现页面元素大小 ...

- Linux 7 重置root密码

在运维工作中经常会遇到不知道密码,密码遗忘,密码被他人修改过的情况,使用这种方式扫清你一切烦恼! 1.启动Linux系统,在出现引导界面时,按“e”键,进入内核编辑界面:2.找到有“linux16”的 ...

- Matlab模板模式

在模板模式(Template Pattern)中,一个抽象类公开定义了执行它的方法的方式/模板.它的子类可以按需要重写方法实现,但调用将以抽象类中定义的方式进行.本文以数据库SQL语法为例来阐述模板模 ...

- ubuntu16.04安装openssh中报错解决

在使用apt-get直接进行安装时会报错: sudo apt-get install openssh-server 正在读取软件包列表... 完成 正在分析软件包的依赖关系树 正在读取状态 ...