浅谈HDFS(三)之DataNote

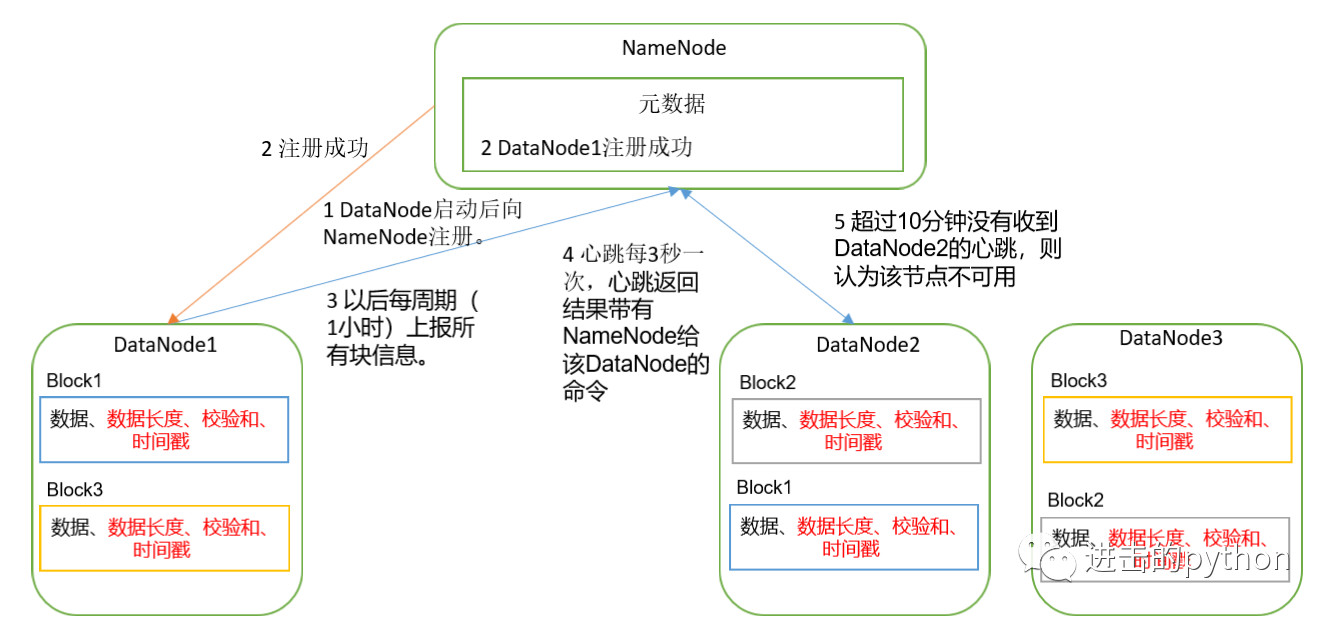

DataNode工作机制

- 一个数据块在DataNode上以文件形式存储在磁盘上,包括两个文件,一个是数据本身,一个是元数据包括数据块的长度,块数据的校验和,以及时间戳。

- DataNode启动后向NameNode注册,通过后,周期性(1小时)的向NameNode上报所有的块信息。

- DataNode与NameNode之间有一个心跳事件,心跳是每3秒一次,心跳返回结果带有NameNode给该DataNode的命令,如果超过10分钟没有收到某个DataNode的心跳,则认为该节点不可用。

- 集群运行中可以安全加入和退出一些机器

数据完整性

思考:如果电脑磁盘里面存储的数据是控制高铁信号灯的红灯信号(1)和绿灯信号(0),但是存储该数据的磁盘坏了,一直显示是绿灯,是否很危险?

同理,DataNode节点上的数据损坏了,却没有发现,是否也很危险,那么如何解决呢?

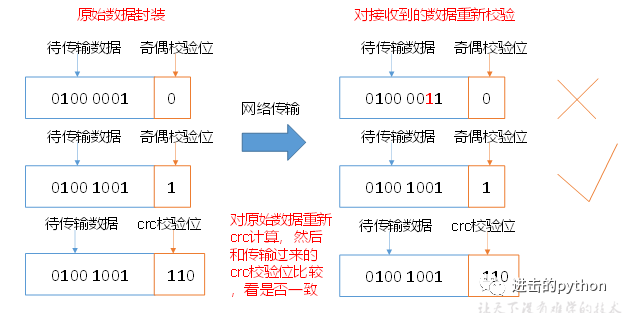

- 保证数据完整性的方法

- 当DataNode读取Block的时候,它会计算CheckSum(校验和)

- 如果计算后的CheckSum,与Block创建时值不一样,说明Block已经损坏

- Client读取其他DataNode上的Block

- DataNode在其文件创建后周期验证CheckSum,如下图:

掉线时参数设置

DataNode进程死亡或者网络故障造成DataNode无法与NameNode通信时的TimeOut参数设置

- NameNode不会立即把该节点判断为死亡,要经过一段时间,这段时间称作超时时长

- HDFS默认的超时时长为10分钟+30秒

- 超时时长的计算公式为:

# dfs.namenode.heartbeat.recheck-interval默认为300000ms,dfs.heartbeat.interval默认为5s

TimeOut = 2 * dfs.namenode.heartbeat.recheck-interval + 10 * dfs.heartbeat.interval

- 实际开发的时候,可以根据自己服务器的情况进行调整,比如服务器性能比较低,那么可以适当的把时间调长;如果服务器性能很好,那么可以适当缩短。

服役新数据节点

需求:随着公司业务的增长或者重大活动(例如双11),数据量越来越大,原有的数据节点的容量已经不能满足存储数据的需求,需要在原有集群基础上动态添加新的数据节点。

- 步骤:

- 克隆一台虚拟机

- 修改IP地址和主机名称

- 删除原来HDFS文件系统中留存的data和logs文件

- 直接单点启动节点即可

退役旧数据节点

退役旧数据节点有两种方式:添加白名单和黑名单退役

添加白名单

- 步骤:

- 在NameNode的

hadoop安装目录/etc/hadoop目录下创建dfs.hosts文件 - 添加白名单主机名称

- 在NameNode的hdfs-site.xml配置文件中增加dfs.hosts属性

<property>

<name>dfs.hosts</name>

# dfs.hosts文件所在路径

<value>/opt/module/hadoop-2.7.2/etc/hadoop/dfs.hosts</value>

</property>

- 配置文件同步到集群其它节点

- 刷新NameNode

[kocdaniel@hadoop102 hadoop-2.7.2]$ hdfs dfsadmin -refreshNodes

Refresh nodes successful

- 更新ResourceManager节点

[kocdaniel@hadoop102 hadoop-2.7.2]$ yarn rmadmin -refreshNodes

- 如果数据不均衡,可以用命令实现集群的再平衡

[kocdaniel@hadoop102 sbin]$ ./start-balancer.sh

黑名单退役

- 步骤:

- 在NameNode的

hadoop安装目录/etc/hadoop目录下创建dfs.hosts.exclude文件 - 添加要退役的主机名称

- 在NameNode的hdfs-site.xml配置文件中增加dfs.hosts.exclude属性

<property>

<name>dfs.hosts.exclude</name>

<value>/opt/module/hadoop-2.7.2/etc/hadoop/dfs.hosts.exclude</value>

</property>

- 配置文件同步到集群其它节点

- 刷新NameNode、刷新ResourceManager

[kocdaniel@hadoop102 hadoop-2.7.2]$ hdfs dfsadmin -refreshNodes

Refresh nodes successful

[kocdaniel@hadoop102 hadoop-2.7.2]$ yarn rmadmin -refreshNodes

- 检查Web浏览器,退役节点的状态为decommission in progress(退役中),说明数据节点正在复制块到其他节点

- 等待退役节点状态为decommissioned(所有块已经复制完成),停止该节点及节点资源管理器。

- 注意:如果副本数是3,服役的节点小于等于3,是不能退役成功的,需要修改副本数后才能退役

- 注意:不允许白名单和黑名单中同时出现同一个主机名称。

两者的不同

- 添加白名单比较暴躁,会直接把要退役的节点服务关掉,不复制数据

- 黑名单退役,会将要退役的节点服务器的数据复制到其它节点上,不会直接关闭节点服务,比较慢

DataNode多目录配置

- DataNode也可以配置成多个目录,每个目录存储的数据不一样。即:数据不是副本,与NameNode多目录不同

- 作用:保证所有磁盘都被利用均衡,类似于windows中的磁盘分区

欢迎关注下方公众号,获取更多文章信息

浅谈HDFS(三)之DataNote的更多相关文章

- 浅谈C++三种传参方式

浅谈C++三种传参方式 C++给函数传参中,主要有三种方式:分别是值传递.指针传递和引用传递. 下面通过讲解和实例来说明三种方式的区别. 值传递 我们都知道,在函数定义括号中的参数是形参,是给函数内专 ...

- 浅谈HDFS(一)

产生背景及定义 HDFS:分布式文件系统,用于存储文件,主要特点在于其分布式,即有很多服务器联合起来实现其功能,集群中的服务器各有各的角色 随着数据量越来越大,一个操作系统存不下所有的数据,那么就分配 ...

- 浅谈HDFS(二)之NameNode与SecondaryNameNode

NN与2NN工作机制 思考:NameNode中的元数据是存储在哪里的? 假设存储在NameNode节点的硬盘中,因为经常需要随机访问和响应客户请求,必然效率太低,所以是存储在内存中的 但是,如果存储在 ...

- 浅谈Servlet(三)

一.三种作用域 作用域:web开发中用于存储和获得数据. 1.request 一次请求有效,在forward跳转时可用request作用域传递数据. 2.session client不变,sessio ...

- 浅谈TCP三次握手和四次挥手

学习三次握手和四次挥手前,先了解下几个基础的概念. Seq:数据段序号,我们都知道TCP是提供有序传输的,有序传输的基础就是数据段序号,接收方在收到发送方乱序包的情况下可以根据Seq进行重新排序,确保 ...

- Linux网络编程——浅谈 TCP 三次握手和四次挥手

一.tcp协议格式 二.三次握手 在 TCP/IP 协议中.TCP 协议提供可靠的连接服务,採用三次握手建立一个连接. 第一次握手:建立连接时,client发送 syn 包(tcp协议中syn位置1. ...

- Salesforce Consumer Goods Cloud 浅谈篇三之 行动计划(Action Plan)相关配置

本篇参考: https://v.qq.com/x/page/f0772toebhd.html https://v.qq.com/x/page/e0772tsmtek.html https://v.qq ...

- Android事件分发机制浅谈(三)--源码分析(View篇)

写事件分发源码分析的时候很纠结,网上的许多博文都是先分析的View,后分析ViewGroup.因为我一开始理解的时候是按我的流程图往下走的,感觉方向很对,单是具体分析的时候总是磕磕绊绊的,老要跳到Vi ...

- 浅谈Spring(三)

一.基础Spring的标准测试 1.导入spring与junit继承的jar 2.引入注解 @RunWith(SpringJUnit4ClassRunner.class) @ContextConfig ...

随机推荐

- less 多行溢出显示省略号无效

.body { font-size:14px; font-weight:400; line-height:22px; /*! autoprefixer: ignore next */ -webkit- ...

- 内存自动清理.sql

--清除存储过程缓存 DBCC FREEPROCCACHE --注:方便记住关键字 FREEPROCCACHE可以拆解成 FREE(割舍,清除) PROC(存储过程关键字简写),CACHE(缓存) - ...

- matlab学习笔记11_3高维数组操作 filp, shiftdim, size, permute, ipermute

一起来学matlab-matlab学习笔记11 11_3 高维数组处理和运算 filp, shiftdim, size, permute, ipermute 觉得有用的话,欢迎一起讨论相互学习~Fol ...

- 阿里云composer 镜像

2019年12月2日13:54:32 https://developer.aliyun.com/composer 阿里云的镜像更新时间比较及时 本镜像与 Packagist 官方实时同步,推荐使用最新 ...

- ETF参数:现金替代标志

表示该股票是否允许用现金进行替代. 0表示沪市股票禁止现金替代(必须有股票) 1表示沪市股票可以进行现金替代(先用股票,股票不足的话用现金替代) 2表示沪市股票必须用现金替代. 对于跨市场ETF,3表 ...

- spark配置文件

spark-env.sh export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoopexport SPARK_DIST_CLASSPATH=$(hadoop clas ...

- DL/T645-2007 及 Modbus-RTU智能电表调试工具

最近在做微信门禁,智能电表采集,智能水表采集项目时,发现网上很多调试工具用起来不顺手,电脑里面起码下了五六个软件. 好不容易弄清楚了,就自己写一个工具,方便自己使用,也顺便造福一下其他人吧

- 【NPDP笔记】第七章 产品生命周期管理

7.1产品生命周期管理 7.1.1 产品生命周期简介 阶段 开发 引入 Introduction 成长 Growth 成熟 Maturity 衰退 Decline 生命周期变短 客户有更多需求 竞 ...

- Linux 就该这么学 CH02新手必须掌握的Linux命令

0 概述 本章内容如下 强大的shell. 帮助文档命令(1) 系统工作命令(10) 系统状态监测命令(8) 工作目录切换命令(3) 文本文件编辑命令(9) 文件目录管理命令(7) 打包压缩或搜索命令 ...

- html遮罩层实现

html文件内容如下 <!--调出子窗口按钮--> <button class="add" onclick="addClick();"> ...