Skip-Gram模型

Stanford CS224n的课程资料关于word2vec的推荐阅读里包含Word2Vec Tutorial - The Skip-Gram Model 这篇文章。这里针对此文章作一个整理。

word2vec做了什么事情

从字面意思上来说就是将单词word转为向量vector,通过词向量来表征语义信息。

word2vec模型

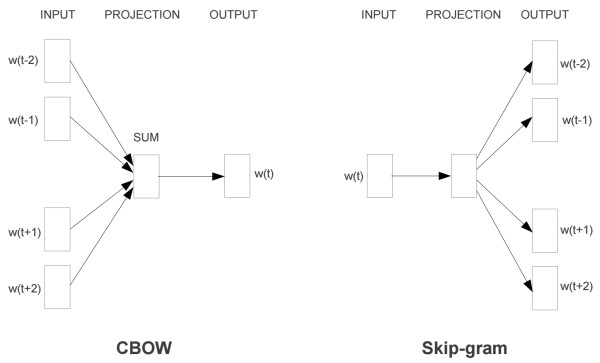

这篇文章主要介绍的是Skip-Gram模型,除此之外word2vec还有CBOW模型。

如上图所示,这两种模型的区别就是

- Skip-Gram是给定输入词来预测上下文

- 而CBOW则是给定上下文来预测输入词

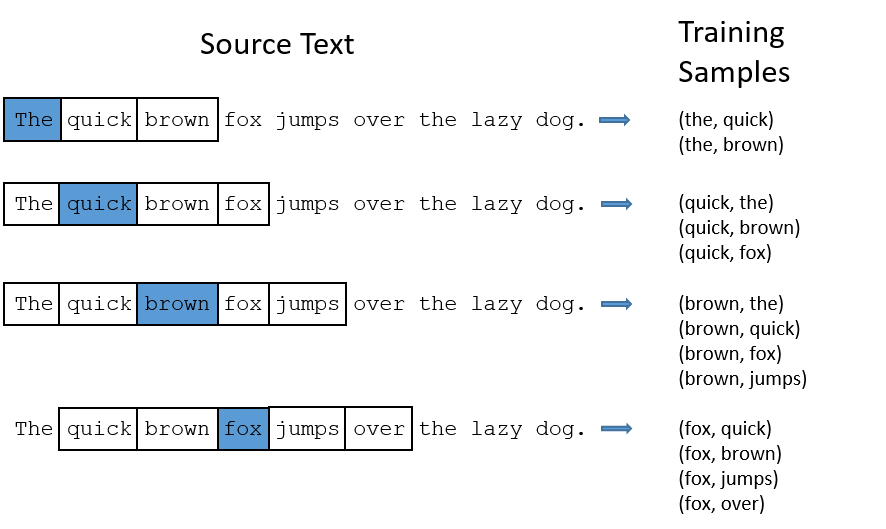

那么如何来训练Skip-Gram模型呢?上面这张图使用的句子是:"The quick brown fox jumps over the lazy dog.",通过逐一选定句子中的单词作为输入词,将与之相邻的词提取出来,进行学习。图中的窗口大小为2,也即每次向前和向后各看2个词(如果存在的话)。

一些细节

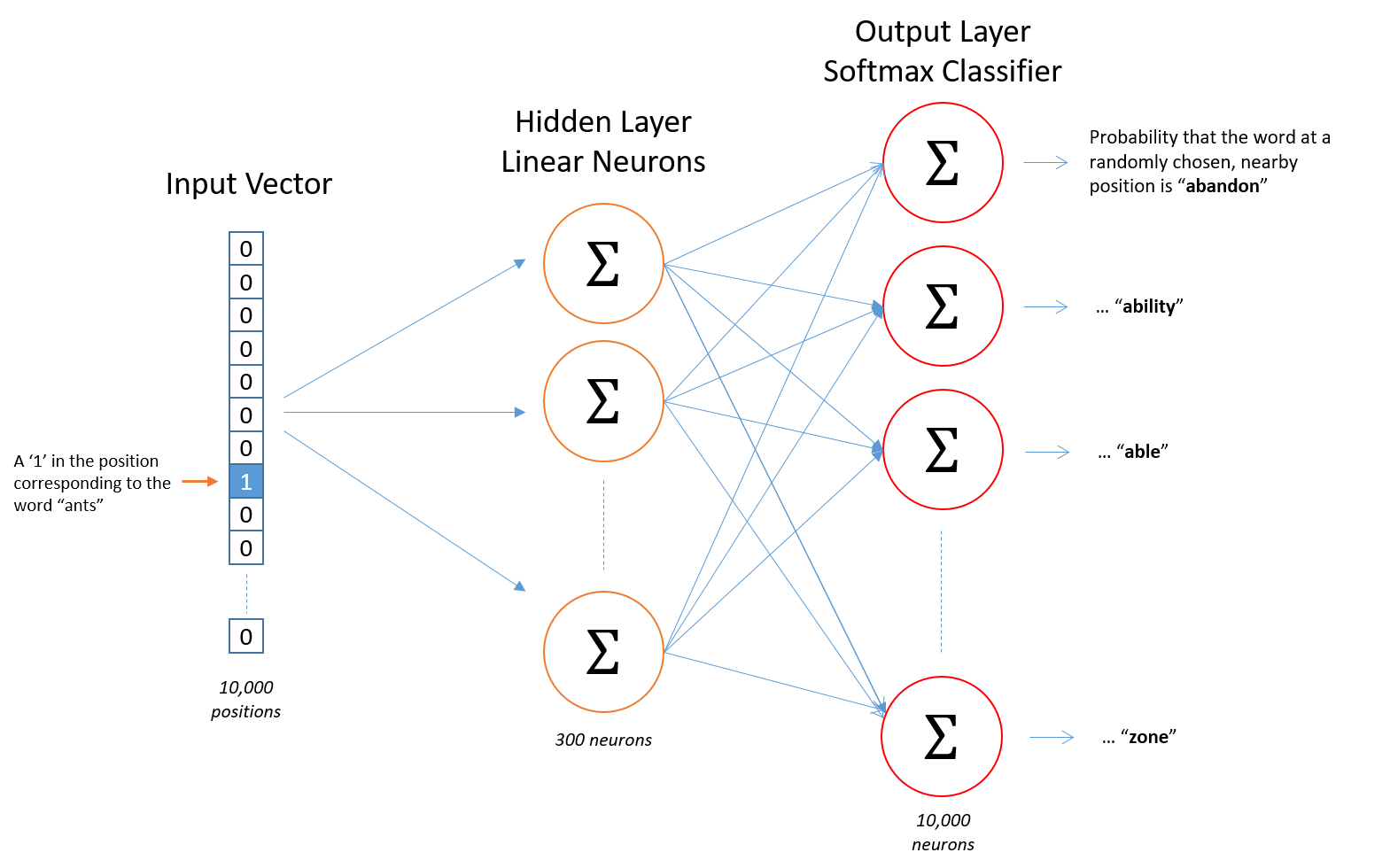

输入参数:通常会将文本中的词进行编码表示,如常见的有将文本库中的单词转换为词汇表,这样可以将每个单词通过one-hot编码表示。比如总共有10000个词,则每个单词最终都可以通过一个10000维向量表示。

如上图所示,网络的输入是一个单词,10000维的one-hot向量,最终输出的结果也是一个10000维的向量,其中的值表示对应的词作为输入词的上下文的概率,也就是说最后输出的是输入词的邻近词的概率分布。

隐藏层

从上面的图也可以看出隐藏层中有300个神经元,也就是说输入词被表示为300维的一个向量。

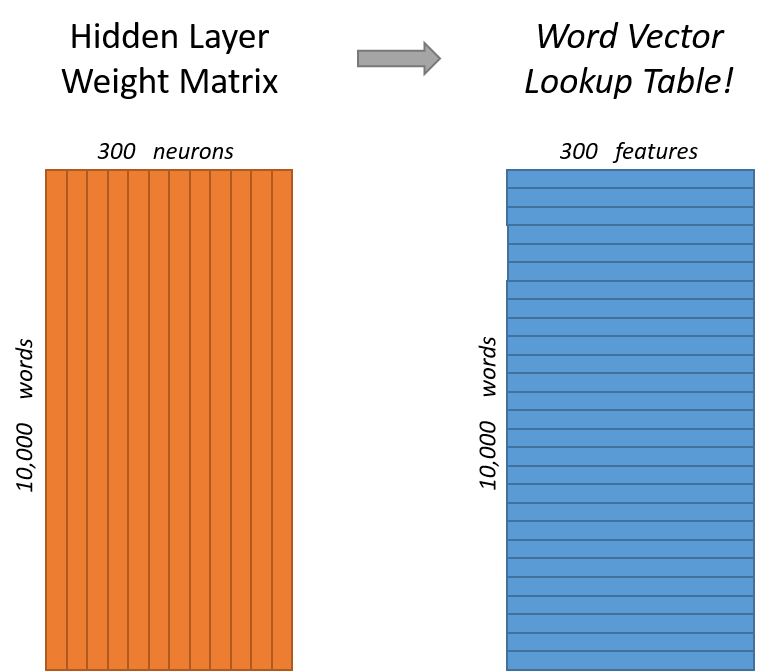

隐藏层中的权重矩阵大小为10000*300,一个10000维的one-hot输入词通过权重矩阵映射到了一个300维的向量,而这个向量正是所谓的word vector,对应于上图中右边的每一行。

另外值得提的是,如果将110000的输入向量与10000300的权重矩阵作乘积的话,其实效率挺低的。因为one-hot向量中只有1个元素是1,所以不难发现其实结果就是权重矩阵中的某一行。

输出层

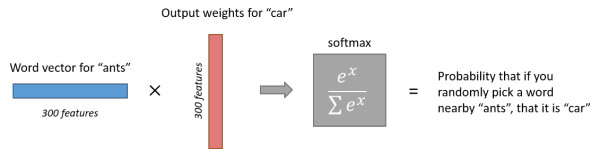

在隐藏层中计算得到的300维的向量最终会再经过输出层变为10000维的向量,这里使用的是softmax回归,最终输出的结果所有概率之和为1。

上图展示了输入词为ants,计算输出词为car的概率。

参考

Word2Vec Tutorial - The Skip-Gram Model

Skip-Gram模型的更多相关文章

- RNN、LSTM、Seq2Seq、Attention、Teacher forcing、Skip thought模型总结

RNN RNN的发源: 单层的神经网络(只有一个细胞,f(wx+b),只有输入,没有输出和hidden state) 多个神经细胞(增加细胞个数和hidden state,hidden是f(wx+b) ...

- Paddle Graph Learning (PGL)图学习之图游走类模型[系列四]

Paddle Graph Learning (PGL)图学习之图游走类模型[系列四] 更多详情参考:Paddle Graph Learning 图学习之图游走类模型[系列四] https://aist ...

- Tensorflow 的Word2vec demo解析

简单demo的代码路径在tensorflow\tensorflow\g3doc\tutorials\word2vec\word2vec_basic.py Sikp gram方式的model思路 htt ...

- word2vec的Java源码【转】

一.核心代码 word2vec.java package com.ansj.vec; import java.io.*; import java.lang.reflect.Array; import ...

- 利用 TensorFlow 入门 Word2Vec

利用 TensorFlow 入门 Word2Vec 原创 2017-10-14 chen_h coderpai 博客地址:http://www.jianshu.com/p/4e16ae0aad25 或 ...

- DeepLearning.ai学习笔记(五)序列模型 -- week2 自然语言处理与词嵌入

一.词汇表征 首先回顾一下之前介绍的单词表示方法,即one hot表示法. 如下图示,"Man"这个单词可以用 \(O_{5391}\) 表示,其中O表示One_hot.其他单词同 ...

- DLNg序列模型第二周NLP与词嵌入

1.使用词嵌入 给了一个命名实体识别的例子,如果两句分别是“orange farmer”和“apple farmer”,由于两种都是比较常见的,那么可以判断主语为人名. 但是如果是榴莲种植员可能就无法 ...

- NLP学习(4)----word2vec模型

一. 原理 哈弗曼树推导: https://www.cnblogs.com/peghoty/p/3857839.html 负采样推导: http://www.hankcs.com/nlp/word2v ...

- tensorflow在文本处理中的使用——CBOW词嵌入模型

代码来源于:tensorflow机器学习实战指南(曾益强 译,2017年9月)——第七章:自然语言处理 代码地址:https://github.com/nfmcclure/tensorflow-coo ...

- tensorflow在文本处理中的使用——skip-gram模型

代码来源于:tensorflow机器学习实战指南(曾益强 译,2017年9月)——第七章:自然语言处理 代码地址:https://github.com/nfmcclure/tensorflow-coo ...

随机推荐

- python的Web框架,Django模型系统二,模型属性,及数据库进阶查询

原始数据接上篇文章来操作.可能需要查看后才能懂.点击这里查看 1.常用的模型字段类型 官方文档:https://docs.djangoproject.com/en/2.1/ref/models/fie ...

- SQL不重复查找数据及把一列多行内容拼成一行

如下表: 表名:Test ID RowID Col1 Col2 1 1 A A 2 1 B A 3 1 A B 4 1 C B 1,查找表中字段重复的只查找一次 select distinct Col ...

- 微信公众号开发--.Net Core实现微信消息加解密

1:准备工作 进入微信公众号后台设置微信服务器配置参数(注意:Token和EncodingAESKey必须和微信服务器验证参数保持一致,不然验证不会通过). 2:基本配置 设置为安全模式 3.代码实现 ...

- sort、sorted高级排序-Python3.7 And 算法<七>

1.sort(*, key=None, reverse=False) sort()接受两个参数,这两个参数只能通过关键字(关键字参数)传递. 参数key:带一个参数的函数(排序时,会依次传入列表的每一 ...

- java连接OPC之——Windows7 With SP1 网络OPC的DCOM配置

由于 OPC(OLE for Process Control)建立在 Microsoft 的 COM(COmponent Model)基础 上,并且 OPC 的远程通讯依赖 Microsoft 的 D ...

- 初学HTML-7

表单中的一些标签 label标签:让文字和输入框进行绑定,即,点击文字,输入框可以开始输入(默认文字和输入框没有关系,不会聚焦) 格式:<form action=""> ...

- setTimeout.js

var cyn = function(){ console.log("我是延时输出的函数") } setTimeout(cyn,5000)

- Python 线程同步锁, 信号量

同步锁 import time, threading def addNum(): global num num -= 1 num = 100 thread_list = [] for i in ran ...

- 原生js 对象深拷贝

经常需要copy一个对象,又怕拷贝有问题,那下面这段就很方便啦,不用担心copy只是一个引用了. /** @ values 需要copy的变量 */ function deepClone(values ...

- HTML5是什么,以及优点和缺点

HTML5是超文本标记语言HTML的第五次重大修改 HTML 5 的第一份正式草案已于2008年1月22日公布 2013年5月6日, HTML 5.1正式草案公布 HTML5的优缺点是什么?作为HTM ...