论文笔记【一】Chinese NER Using Lattice LSTM

论文:Chinese NER Using Lattice LSTM

论文链接:https://arxiv.org/abs/1805.02023

论文作者:Yue Zhang∗and Jie Yang∗

项目链接:https://github.com/jiesutd/LatticeLSTM

论文翻译:转自机器之心 https://www.jiqizhixin.com/articles/ACL2018-Chinese-NER-Using-Lattice-LSTM

一、摘要

该篇论文是基于字符的LSTM,以Lattice嵌入为输入的模型,该模型对输入字符序列和所有匹配词典的潜在词汇进行编码。

优点:

- 与基于字符的方法相比,该模型显性地利用词和词序信息。

- 与基于词的方法相比,lattice LSTM 不会出现分词错误。

- 门控循环单元使得模型能够从句子中选择最相关的字符和词,以生成更好的 NER 结果。

最终的结果是在多个数据集上的实验证明 lattice LSTM 优于基于词和基于字符的 LSTM 基线模型,达到了最优的结果。它在MSRA数据集上实现了93.18%的F1值。

二、研究介绍

在已有的研究中,中文 NER 中,基于字符的方法表现要优于基于词的方法(He and Wang, 2008; Liu et al., 2010; Li et al., 2014),但是基于字符的 NER 的一个缺陷在于无法充分利用显性的词和词序信息。

实验思路:研究者利用 lattice LSTM 来表征句子中的 lexicon word,从而将潜在词信息整合到基于字符的 LSTM-CRF 中。研究者使用一个大型自动获取的词典来匹配句子,进而构建基于词的 lattice。

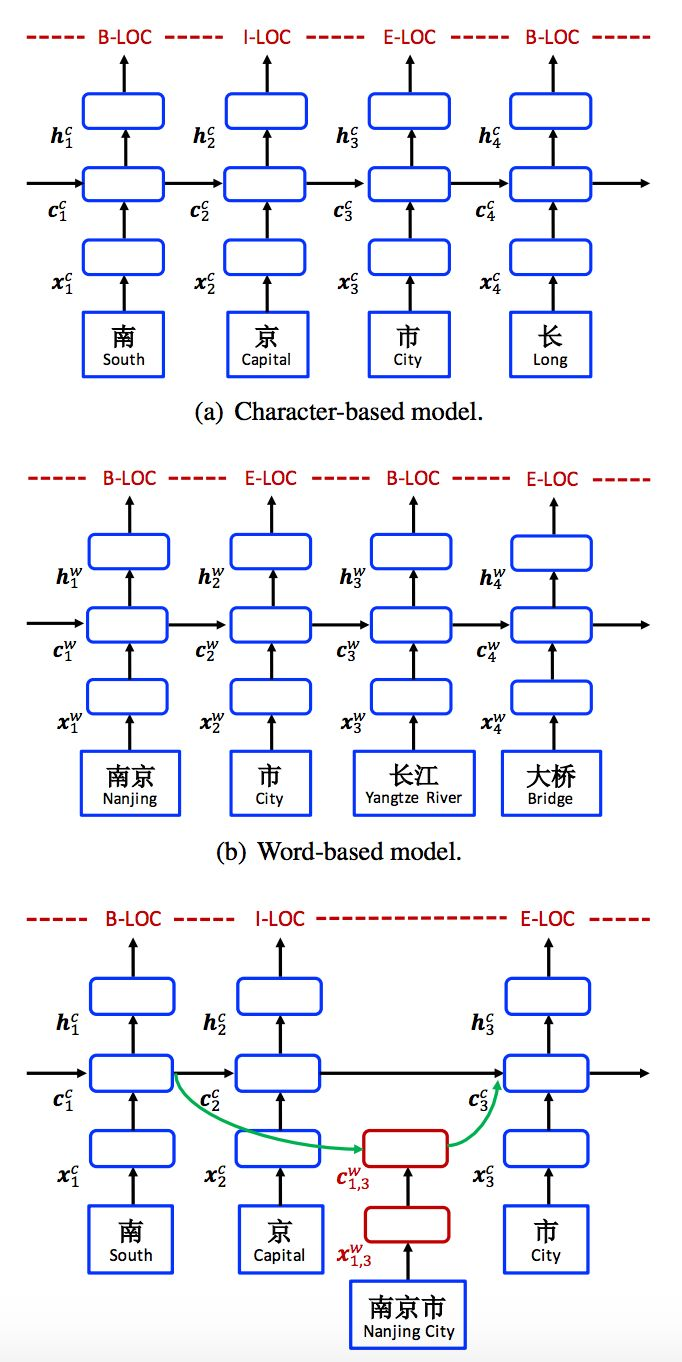

如下图所示,门控单元用于将来自不同路径的信息动态传送到每个字符。在 NER 数据上训练后,lattice LSTM 能够学会从语境中自动找到更有用的词,以取得更好的 NER 性能。

三、模型

在目前,英文 NER 的最高水准是使用 LSTM-CRF 模型实现的,研究者同样使用了 LSTM-CRF 作为主要网络结构。

形式上,指定输入句子为 s = c_1, c_2, . . . , c_m,其中 c_j 指第 j 个字符。s 还可以作为词序列 s = w_1, w_2, . . . , w_n,其中 w_i 指句子中的第 i 个词,使用中文分词器获得。使用 t(i, k) 来指句子第 i 个词中第 k 个字符的索引 j。

以图 1 中的句子为例。如果分词是「南京市 长江大桥」,索引从 1 开始,则 t(2, 1) = 4 (长),t(1, 3) = 3 (市)。研究者使用 BIOES 标记规则(Ratinov and Roth, 2009)进行基于词和基于字符的 NER 标记。

四、实验

数据集:本文使用了四个数据集,其中包括

- Onto Notes 4(Weischedel等,2011)

- MSRA(Levow,2006)

- 微博NER(Peng和Dredze,2015; He和Sun,2017a)https://www.weibo.com/

- 研究者注释的中文简历数据集。http://finance.sina.com.cn/stock/index.shtml

分词模型: 对于微博和简历,研究者采用杨等人的最佳模型(2017a,https://github.com/jiesutd/Rich Word Segmentor)现成的,使用CTB 6.0训练。

词嵌入:研究者使用word2vec(Mikolov等,2013)对自动分割的中文Giga-Word (https://catalog.ldc.upenn.edu/LDC2011T13),预先训练单词嵌入,在最后一个词典中获得704.4k个单词。 在NER训练期间,可以对字嵌入进行微调。 字符和字符双字母嵌入使用word2vec在中文Giga-word上进行预训练,并在模型训练中进行微调。。

超参数设置:嵌入大小(embedding sizes)设置为50,LSTM模型的隐藏大小(hidden size)设置为200. Dropout(Srivastava等,2014)应用于单词和字符嵌入,速率为0.5。 随机梯度下降(SGD)用于优化,初始学习率(initial learning rate)为0.015,衰减率(decay rate)为0.05。

五、结论

与word + char + bichar和char + bichar + softword相比,lattice模型对句子长度的增加表现出更强的鲁棒性,证明了词语信息的更有效使用。

研究者凭经验研究了中文NER的lattice LSTM-CRF表示,发现它与不同领域的word-based 和 character-based LSTM-CRF相比具有始终如一的优越性能。 由于在NER消歧的上下文中选择词典单词的自由度,lattice方法完全独立于分词,但在使用单词信息方面更有效。

论文笔记【一】Chinese NER Using Lattice LSTM的更多相关文章

- Multimodal —— 看图说话(Image Caption)任务的论文笔记(一)评价指标和NIC模型

看图说话(Image Caption)任务是结合CV和NLP两个领域的一种比较综合的任务,Image Caption模型的输入是一幅图像,输出是对该幅图像进行描述的一段文字.这项任务要求模型可以识别图 ...

- 论文笔记(1):Deep Learning.

论文笔记1:Deep Learning 2015年,深度学习三位大牛(Yann LeCun,Yoshua Bengio & Geoffrey Hinton),合作在Nature ...

- 论文笔记:Towards Diverse and Natural Image Descriptions via a Conditional GAN

论文笔记:Towards Diverse and Natural Image Descriptions via a Conditional GAN ICCV 2017 Paper: http://op ...

- 【论文笔记】Malware Detection with Deep Neural Network Using Process Behavior

[论文笔记]Malware Detection with Deep Neural Network Using Process Behavior 论文基本信息 会议: IEEE(2016 IEEE 40 ...

- Deep Reinforcement Learning for Visual Object Tracking in Videos 论文笔记

Deep Reinforcement Learning for Visual Object Tracking in Videos 论文笔记 arXiv 摘要:本文提出了一种 DRL 算法进行单目标跟踪 ...

- 序列标注(BiLSTM-CRF/Lattice LSTM)

前言 在三大特征提取器中,我们已经接触了LSTM/CNN/Transormer三种特征提取器,这一节我们将介绍如何使用BiLSTM实现序列标注中的命名实体识别任务,以及Lattice-LSTM的模型原 ...

- 【论文笔记】Learning Fashion Compatibility with Bidirectional LSTMs

论文:<Learning Fashion Compatibility with Bidirectional LSTMs> 论文地址:https://arxiv.org/abs/1707.0 ...

- Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现(转)

Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文, ...

- 论文笔记之:Visual Tracking with Fully Convolutional Networks

论文笔记之:Visual Tracking with Fully Convolutional Networks ICCV 2015 CUHK 本文利用 FCN 来做跟踪问题,但开篇就提到并非将其看做 ...

随机推荐

- xdebug php 运行效率分析工具

Xdebug是一个开放源代码的PHP程序调试器(即一个Debug工具),可以用来跟踪,调试和分析PHP程序的运行状况. 官网:https://xdebug.org/index.php 安装方法: ht ...

- Excel数据与DateTable数据的转换

public class ExcelHelper : IDisposable { private string fileName = null; //文件名 private IWorkbook wor ...

- JBPM工作流(四)——管理流程定义

概念: ProcessDefinition,流程定义:一个流程的步骤说明,如一个请假流程.报销流程.是一个规则. ProcessDefinition,流程定义对象,是解析.jpdl.xml文件得到流程 ...

- 已知两点的经度和纬度,计算两点间的距离(php,javascript)

php代码:转载 http://www.cnblogs.com/caichenghui/p/5977431.html /** * 求两个已知经纬度之间的距离,单位为米 * * @param lng1 ...

- 类似于Mimikatz的Linux Hash Dump工具

项目主页 https://github.com/huntergregal/mimipenguin 需要root权限 支持 Kali 4.3.0 (rolling) x64 (gdm3) Ubuntu ...

- xcrun: error: invalid active developer path (/Library/Developer/CommandLineTools), missing xcrun

原文地址 xcrun: error: invalid active developer path (/Library/Developer/CommandLineTools), missing xcru ...

- 再读vue2.0

玩过一段时间后在来读读vue2.0会发现受益良多 概述: vue2.0 是一套构建用户界面的渐进式框架, 使用virtual DOM 提供了响应式和组件化, 允许使用简介的模板语法来声明式的将数据渲 ...

- InnoDB中锁的查看

Ⅰ. show engine innodb status\G 1.1 实力分析一波 锁介绍的那篇中已经提到了这个命令,现在我们开一个参数,更细致的分析一下这个命令 (root@localhost) [ ...

- openERP笔记 自定义模块开发

##需求描述 输入和查询课程,把信息储存到课程对象里 课程包含以下信息:名称,价格,天数,开始日期,教师,学员 每个课程可以有多个学员,要记录学员的姓名.电话.电子邮件 课程可以添加教材和作业等文档附 ...

- Git服务器配置和基本使用

#git服务器搭建 1. 在系统中增加git用户 useradd -s /usr/bin/git-shell git 2. 在git用户的home目录下新建.ssh目录,做好相关配置 1)生成公私匙: ...