webcollector 2.x 爬取搜狗搜索结果页

/**

* 使用搜狗搜索检索关键字并爬取结果集的标题

* @author tele

*

*/

public class SougouCrawler extends RamCrawler{ public SougouCrawler() { } public SougouCrawler(String keyword,int maxnum) {

for(int i=1;i<=maxnum;i++) {

//拼接url

String url ="https://www.sogou.com/web?query="+keyword+"&s_from=result_up&cid=&page="+ i +"&ie=utf8&p=40040100&dp=1&w=01029901&dr=1";

CrawlDatum crawlDatum = new CrawlDatum(url).meta("pageNum",i);

addSeed(crawlDatum);

addRegex(".*");

}

} @Override

public void visit(Page page, CrawlDatums next) {

String pageNum = page.meta("pageNum");

Elements results = page.doc().select("div.results div[^class] h3 a");

for(int i=0;i<results.size();i++) {

System.out.println("第"+ pageNum +"页第"+ (i+1) +"条结果------" + results.get(i).text());

}

} public static void main(String[] args) throws Exception {

String keyword="淘宝";

SougouCrawler crawler = new SougouCrawler(keyword,3);

crawler.setThreads(8); Configuration conf = Configuration.copyDefault();

conf.setExecuteInterval(3000);

conf.setReadTimeout(5000);

conf.setWaitThreadEndTime(3000); crawler.setConf(conf);

crawler.start(1);//只有一层

}

}

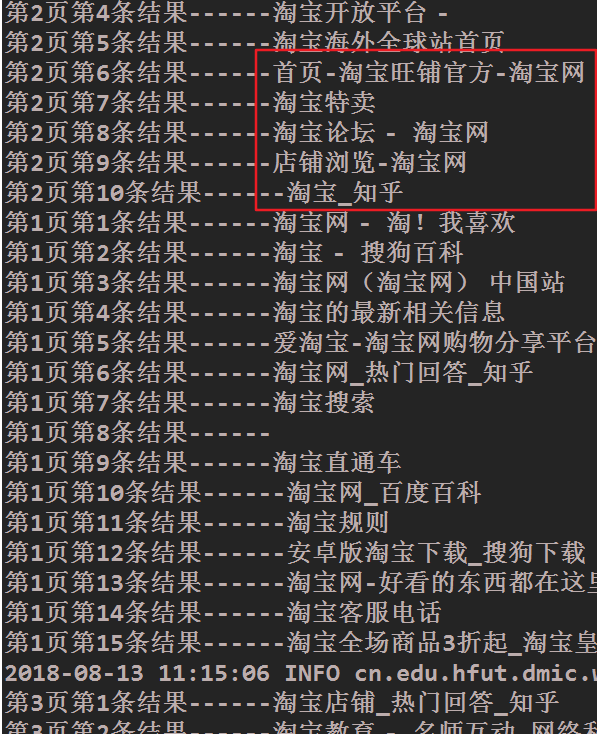

输出截图(部分)

验证第二页数据标题

webcollector 2.x 爬取搜狗搜索结果页的更多相关文章

- 第三百三十节,web爬虫讲解2—urllib库爬虫—实战爬取搜狗微信公众号—抓包软件安装Fiddler4讲解

第三百三十节,web爬虫讲解2—urllib库爬虫—实战爬取搜狗微信公众号—抓包软件安装Fiddler4讲解 封装模块 #!/usr/bin/env python # -*- coding: utf- ...

- 九 web爬虫讲解2—urllib库爬虫—实战爬取搜狗微信公众号—抓包软件安装Fiddler4讲解

封装模块 #!/usr/bin/env python # -*- coding: utf-8 -*- import urllib from urllib import request import j ...

- requests利用selenium,代理Ip,云打码,验证码抠图操作 爬取搜狗微信公众号内容

爬取思路,爬取搜狗微信公众号内容,爬取第一层url时请求太快出现验证码,我这里用的蘑菇云代理,并在程序中我判断什么情况下是否+代理,做到合理运用代理ip.爬取第二层url时验证码出现次数更严重(和第一 ...

- 用scrapy爬取搜狗Lofter图片

用scrapy爬取搜狗Lofter图片 # -*- coding: utf-8 -*- import json import scrapy from scrapy.http import Reques ...

- 用WebCollector制作一个爬取《知乎》并进行问题精准抽取的爬虫(JAVA)

简单介绍: WebCollector是一个无须配置.便于二次开发的JAVA爬虫框架(内核),它提供精简的的API.仅仅需少量代码就可以实现一个功能强大的爬虫. 怎样将WebCollector导入项目请 ...

- python3 爬取搜狗微信的文章

目标地址:http://weixin.sogou.com/weixin? 这个地址是搜狗微信的文章搜索,可以搜索到微信的文章,而我们目标就是这些文章内容 这个url经过测试,当我们没登陆微信只能看到1 ...

- scrapy实战7爬取搜狗微信:

爬取微信热门文章标题,内容,内容地址,微信公众号,公众号地址,发布日期等 如图 源码地址:https://github.com/huwei86/sougouweixin

- 使用php的curl根据关键词爬取百度搜索结果页

http://bbs.csdn.net/wap/topics/390938327 正则表达式匹配Html标签 查找所有的TD区域(最短):<td\s*.*>\s*.*<\/td& ...

- Python爬虫 爬取搜狗搜索到的内容页面

废话不多说,直接上代码 import requests def main(): url='https://www.sogou.com/web' headers={ 'User_Agent':'Mozi ...

随机推荐

- [Angular] Using the Argon 2 Hashing Function In Our Sign Up Backend Service

Which hash algorithom to choose for new application: https://www.owasp.org/index.php/Password_Storag ...

- AndroidActivity跳转动画,让你的APP瞬间绚丽起来

我们都知道绚丽的APP总会给用户耳目一新的感觉,为了抓住用户更大网络公司使出浑身解数让自己的产品更绚丽,而绚丽最简单的效果就是Activity跳转效果,不仅能够让用户看起来舒服,并且实现起来也特别简单 ...

- 适用android的MVP:怎样组织展示层

原文 MVP for Android:How to organize presentation layer http://antonioleiva.com/mvp-android/ 译文 MVP(Mo ...

- TTS-零基础入门之语音模板化

上篇介绍了TTS的一个简单样例http://blog.csdn.net/u010176014/article/details/47326413 本篇咱们进一步聊聊 语音怎样读模板. 比方 公交车上的模 ...

- JSP中多条件判断

<c:if test="${result_map.connNew ne null and result_map.connNew ne 0}"> </c:if> ...

- Web前端--黑客技术揭秘(菜鸟知识)

一,Web安全的关键点 1.同源策略是众多安全策略的一个,是Web层面上的策略.很重要. 2.同源策略规定:不同域的client脚本在没明白授权的情况下.不能读写对方的资源. 3.同域要求两个网站同协 ...

- 分类算法简介 分类: B10_计算机基础 2015-03-09 11:08 257人阅读 评论(0) 收藏

一.决策树 决策树是用于分类和预测的主要技术之一,决策树学习是以实例为基础的归纳学习算法,它着眼于从一组无次序.无规则的实例中 推理出以决策树表示的分类规则.构造决策树的目的是找出属性和类别间的关系, ...

- 数据类型总结——String(字符串类型)

相关文章 简书原文:https://www.jianshu.com/p/546a755c3eb6 数据类型总结——概述:https://www.cnblogs.com/shcrk/p/9266015. ...

- Angular 2 HostListener & HostBinding

原文 https://www.jianshu.com/p/20c2d60802f7 大纲 1.宿主元素(Host Element) 2.HostListener 3.HostListenerDecor ...

- dll = MinGW gcc 生成动态链接库 dll 的一些问题汇总

MinGW gcc 生成动态链接库 dll 的一些问题汇总 https://blog.csdn.net/liyuanbhu/article/details/42612365 网络上关于用 MinGW ...