HDFS连接JAVA,HDFS常用API

先在pom.xml中导入依赖包

<dependencies>

<!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-hdfs -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>2.7.6</version>

</dependency> <!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-common -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>2.7.6</version>

</dependency> <!-- https://mvnrepository.com/artifact/org.apache.hadoop/hadoop-client -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.7.6</version>

</dependency> <!-- https://mvnrepository.com/artifact/junit/junit -->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.3</version>

</dependency> </dependencies>

hdfs连接Java

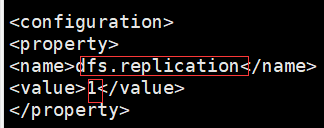

1.先获取配置文件(hdfs-site.xml)

Configuration cg = new Configuration(); 导入的是import org.apache.hadoop.conf.Configuration;

cg.set("dfs.replication","1"); 1是备份数量

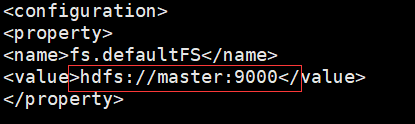

2.获取连接地址(core-site.xml)

URI uri = new URI("hdfs://master:9000");

3.创建(获取)hdfs文件管理系统的对象,同过对象操作hdfs

FileSystem fs = FileSystem.get(uri, cg);

常用HDFSAPi:

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import org.junit.Before;

import org.junit.Test; import java.io.*;

import java.net.URI; public class HdfsApi {

FileSystem fs; @Before

public void main() throws Exception {

Configuration cg = new Configuration();

cg.set("dfs.replication", "1");

URI uri = new URI("hdfs://master:9000");

fs = FileSystem.get(uri, cg); } @Test

public void mk() throws IOException {

boolean mk = fs.mkdirs(new Path("/test"));

} @Test

public void del() throws IOException {

//false表示不迭代删除也可以不加,true可以进行多目录迭代删除

boolean del = fs.delete(new Path("/test"),false);

System.out.println(del); } @Test

public void listStatus() throws IOException { //对比图在下

//查看目录下文件列表

FileStatus[] fileStatuses = fs.listStatus(new Path("/data/data"));

System.out.println(fileStatuses); //[Lorg.apache.hadoop.fs.FileStatus;@106cc338

System.out.println("-------------------------------");

for (FileStatus fileStatus : fileStatuses) {

System.out.println(fileStatus.getLen()); //文件大小 以B字节为单位

System.out.println(fileStatus.getReplication()); //副本个数

System.out.println(fileStatus.getPermission()); //读写状态

System.out.println(fileStatus.getBlockSize()); //固定的一个block大小128MB

System.out.println(fileStatus.getAccessTime()); //创建文件时的时间戳

System.out.println(fileStatus.getPath()); //文件路径

System.out.println("-----------------");

}

/*输出结果

log4j:WARN No appenders could be found for logger (org.apache.hadoop.util.Shell).

log4j:WARN Please initialize the log4j system properly.

log4j:WARN See http://logging.apache.org/log4j/1.2/faq.html#noconfig for more info.

[Lorg.apache.hadoop.fs.FileStatus;@106cc338

-------------------------------

180

1

rw-r--r--

134217728

1631969331482

hdfs://master:9000/data/data/cource.txt

-----------------

138540

1

rw-r--r--

134217728

1631963067585

hdfs://master:9000/data/data/score.txt

-----------------

41998

1

rw-r--r--

134217728

1631963067890

hdfs://master:9000/data/data/students.txt

-----------------

*/ } @Test

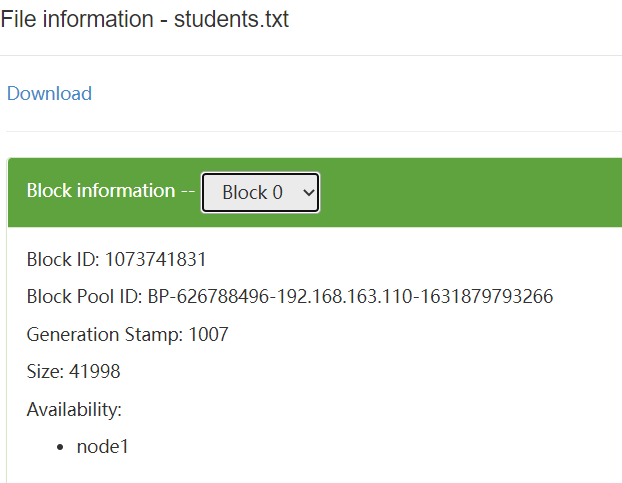

public void listBlockLocation() throws IOException { //对比图在下

BlockLocation[] fbl =

fs.getFileBlockLocations(

new Path("/data/data/students.txt"),0,1000000000);

for (BlockLocation bl : fbl) {

String[] hosts = bl.getHosts();

for (String host : hosts) {

System.out.println(host);

} //node1 表示文件存在node1,因为文件小于一个block,所以这里只存在一个节点 System.out.println(bl.getLength()); //41998 size大小 String[] names = bl.getNames();

for (String name : names) {

System.out.println(name);

} //192.168.163.120:50010 node1的地址 System.out.println(bl.getOffset()); //0 偏移量 String[] topologyPaths = bl.getTopologyPaths();

for (String topologyPath : topologyPaths) {

System.out.println(topologyPath);

} // /default-rack/192.168.163.120:50010 } } @Test

public void open() throws IOException {

FSDataInputStream open = fs.open(new Path("/data/data/students.txt"));

BufferedReader br = new BufferedReader(new InputStreamReader(open)); //因为文件中有中文,所以将字节流转为字符流来读取

String len;

while ((len=br.readLine())!=null){

System.out.println(len);

}

br.close();

} @Test

public void create() throws IOException {

FSDataOutputStream fos = fs.create(new Path("/data/data/test.txt"));

BufferedWriter bw = new BufferedWriter(new OutputStreamWriter(fos));

bw.write("你好");

bw.write("世界");

bw.newLine();

bw.write("我和我的祖国");

bw.flush();

bw.close(); } }

HDFS连接JAVA,HDFS常用API的更多相关文章

- Java 之常用API(一)

常用API 1 API概述 2 Scanner类与String类 3 StringBuilder类 NO.one API概述 1.1 API概述 API(Application Programm ...

- Java之常用API

API概述 什么是API API (Application Programming Interface) :应用程序编程接口 java中的API 指的就是 JDK 中提供的各种功能的 Java类,这些 ...

- Java 基础 常用API (System类,Math类,Arrays, BigInteger,)

基本类型包装类 基本类型包装类概述 在实际程序使用中,程序界面上用户输入的数据都是以字符串类型进行存储的.而程序开发中,我们需要把字符串数据,根据需求转换成指定的基本数据类型,如年龄需要转换成int类 ...

- Java 基础 常用API (Object类,String类,StringBuffer类)

Java API Java 的API(API: Application(应用) Programming(程序) Interface(接口)) Java API就是JDK中提供给我们使用的类,这些类将底 ...

- Java 之常用API(二)

Object类 & System类 日期相关类 包装类 & 正则表达式 Object类 & System类 1.1 Object类 1.1.1 概述 Object类是Java语 ...

- java selenium常用API(WebElement、iFrame、select、alert、浏览器窗口、事件、js) 一

WebElement相关方法 1.点击操作 WebElement button = driver.findElement(By.id("login")); button.clic ...

- java自学-常用api

API(Application Programming Interface),应用程序编程接口.Java API是JDK中提供给我们使用的类的说明文档.即jdk包里边写好的类,这些类将底层的代码实现封 ...

- Java的常用API

Object类 1.toString方法在我们直接使用输出语句输出对象的时候,其实通过该对象调用了其toString()方法. 2.equals方法方法摘要:类默认继承了Object类,所以可以使用O ...

- Java的常用API之System类简介

Syetem类 java.lang.System类中提供了大量的静态方法,可以获取与系统相关的信息或系统级操作,在System类的API文档中,常用的方法有: public static long c ...

随机推荐

- having筛选结果集

题目要求:让你输出有两科及其以上挂科(60分及格)的学生的名单? name subject score 错误的做法: mysql> select name, count(scoure<60 ...

- 获取缓存文件大小并清理 By HL

通常用于删除缓存的时,计算缓存大小 //单个文件的大小 - (long long) fileSizeAtPath:(NSString*) filePath{ NSFileManager* manage ...

- mysql入门基础增删查改

数据查询语法(DQL) DQL就是数据查询语言,数据库执行DQL语句不会对数据进行改变,而是让数据库发送结果集给客户端. 语法: SELECT selection_list /*要查询的列名称*/ F ...

- k8s之Pod基础概念

1. 资源限制 Pod是kubernetes中最小的资源管理组件,Pod也是最小化运行容器化应用的资源对象.一个Pod代表着集群中运行的一个进程.kubernetes中其他大多数组件都是围绕着Pod来 ...

- HashMap自动扩容机制源码详解

一.简介 HashMap的源码我们之前解读过,数组加链表,链表过长时裂变为红黑树.自动扩容机制没细说,今天详细看一下 往期回顾: Java1.7的HashMap源码分析-面试必备技能 Java1.8的 ...

- ☆☆如何学习MATLAB☆☆

大多数朋友第一次接触MATLAB一般都是在大学里面开设的MATLAB课程,第一次真正使用MATLAB是在自己的毕业论文中用到.所以对于MATLAB可以说是既爱又恨.爱,是因为使用MATLAB几乎可以实 ...

- Process Doppelgänging

进程注入:Process Doppelgänging 攻击者可以通过Process Doppelgänging将恶意代码注入到进程中,从而逃避基于进程的防护,并且进行可能的特权提升.Process ...

- CentOS 7 下升级OpenSSH 7.4p1到OpenSSH 8.4p1

文章目录 一.环境介绍 二.安装配置telnet 2.1.安装telnet-server 2.2.配置telnet 2.3.配置telnet登录的终端类型 2.4.启动telnet服务 三.切换登录方 ...

- 阿里云服务器ECS挂载数据盘—linux系统

参考阿里云官网帮助文档:https://help.aliyun.com/document_detail/25426.html 里面有些步骤说的不是很清楚,初学者可能操作时会遇到问题.通过这篇文档进行进 ...

- 《深度探索C++对象模型》第一章 | 关于对象

C++对象模式 非静态数据成员放置在每个类对象内,静态数据成员则被放置在所有类对象之外.静态和非静态的成员函数也被放置在所有类对象之外.每个类产生一堆指向虚函数的指针,放在虚表(vtbl)中.每个类对 ...