hive从入门到放弃(二)——DDL数据定义

前一篇文章,介绍了什么是 hive,以及 hive 的架构、数据类型,没看的可以点击阅读:hive从入门到放弃(一)——初识hive

今天讲一下 hive 的 DDL 数据定义

创建数据库

CREATE DATABASE [IF NOT EXISTS]① database_name

[COMMENT database_comment]②

[LOCATION hdfs_path]③

[WITH DBPROPERTIES (property_name=property_value, ...)]④;

①若存在则不创建,不存在则创建

②数据库注释

③数据库映射到HDFS的数据路径

④可以增加其它数据库配置

查询数据库

show databases --显示数据库

desc database db_name --查看数据库信息

desc database extended db_name --查看数据库详细信息

修改数据库属性

alter database db_hive

set dbproperties('createtime'='20170830');

用户可以使用 ALTER DATABASE 命令为某个数据库的 DBPROPERTIES 设置键-值对属性值,

来描述这个数据库的属性信息。

删除数据库

drop database [if exists] database_name [cascade]

cascade 命令表示强制删除

创建表

CREATE [EXTERNAL]① TABLE [IF NOT EXISTS] table_name

[(col_name data_type [COMMENT col_comment], ...)]

[COMMENT table_comment]

[PARTITIONED BY② (col_name data_type [COMMENT col_comment], ...)]

[CLUSTERED BY③ (col_name, col_name, ...)

[SORTED BY④ (col_name [ASC|DESC], ...)] INTO num_buckets BUCKETS]

[ROW FORMAT⑤ row_format]

[STORED AS⑥ file_format]

[LOCATION⑦ hdfs_path]

[TBLPROPERTIES⑧ (property_name=property_value, ...)]

[AS⑨ select_statement | like⑩ table_name]

① EXTERNAL关键字可以创建一个外部表,当删除表的时候,只删除描述表的元数据,不删除存在于 HDFS 上的数据;

与之相反的是内部表,或者叫管理表,管理表在删除的时候会把 HDFS 上的数据一起删除;

这两者可以互相转换:

alter table table_name set tblproperties('EXTERNAL'='TRUE');

② PARTITIONED BY 用以创建分区表,需要指定列用于分区,一个分区对应一个目录,可以提高效率;

③ CLUSTERED BY 创建分桶表,分桶将整个数据按照某列属性值的 hash 值进行区分;

④ SORTED BY 对桶中的一个或多个列另外排序;

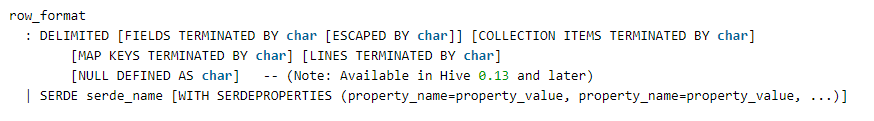

⑤ ROW FORMAT 用于指定数据切分格式;官方的用法:

⑥ STORED AS 用以指定存储文件类型,比如 parquet、textfile 等;

⑦ LOCATION 指定文件存储在 HDFS 上的路径;

⑧ TBLPROPERTIES 可用于添加表的其它属性,一般是键值对形式;

⑨ AS 后面接的是查询语句,根据查询结果创建表;

⑩ LIKE 后接表名,复制表结构,但不复制数据。

修改表

-- 更新列

ALTER TABLE table_name CHANGE [COLUMN] col_old_name col_new_name

column_type [COMMENT col_comment] [FIRST|AFTER column_name]

-- 增加和替换列

ALTER TABLE table_name ADD|REPLACE COLUMNS (col_name data_type [COMMENT

col_comment], ...)

ADD 是代表新增一字段,字段位置在所有列后面(partition 列前);REPLACE 则是表示替换表中所有字段。

删除表

drop table table_name;

小结

本文主要展示了 hive 的 DDL 用法,包括数据库和表的语法。实际上这里面有部分内容是简单概括,比如分区分桶表的含义作用以及用法,这些后面的文章我会展开描述,可以持续关注【大数据的奇妙冒险】,获取更多知识!

hive从入门到放弃(二)——DDL数据定义的更多相关文章

- hive从入门到放弃(三)——DML数据操作

上一篇给大家介绍了 hive 的 DDL 数据定义语言,这篇来介绍一下 DML 数据操作语言. 没看过的可以点击跳转阅读: hive从入门到放弃(一)--初识hive hive从入门到放弃(二)--D ...

- hive从入门到放弃(四)——分区与分桶

今天讲讲分区表和分桶表,前面的文章还没看的可以点击链接: hive从入门到放弃(一)--初识hive hive从入门到放弃(二)--DDL数据定义 hive从入门到放弃(三)--DML数据操作 分区 ...

- Hive 官方手册翻译 -- Hive DDL(数据定义语言)

Hive DDL(数据定义语言) Confluence Administrator创建, Janaki Lahorani修改于 2018年9月19日 原文链接 https://cwiki.apache ...

- Hive(三)【DDL 数据定义】

目录 一.DDL数据定义 1.库的DDL 1.1创建数据库 1.2查询数据库 1.3查看数据库详情 1.4切换数据库 1.5修改数据库 1.6删除数据库 2.表的DDL 2.1创建表 2.2管理表(内 ...

- hive从入门到放弃(一)——初识hive

之前更完了<Kafka从入门到放弃>系列文章,本人决定开新坑--hive从入门到放弃,今天先认识一下hive. 没看过 Kafka 系列的朋友可以点此传送阅读: <Kafka从入门到 ...

- 第4章 DDL数据定义

第4章 DDL数据定义 4.1 创建数据库 1)创建一个数据库,数据库在HDFS上的默认存储路径是/user/hive/warehouse/*.db. hive (default)> creat ...

- oracle学习笔记(三) DCL 数据控制语言与 DDL 数据定义语言

DCL 数据控制语言 Data control language 之前说过的授权和收权利语句 grant, revoke DDL 数据定义语言 Data define language create ...

- DDL数据定义语言

DDL数据定义语言 (一)概述 DDL(Data Definition Language):数据定义语言,用来定义数据库对象,库.表.列等:创建.删除.修改 库,表结构.主要分为操作数据库的DDL和操 ...

- sql 两大类 DDL数据定义语言 和DCL数据控制语言

SQL分为五大类: DDL:数据定义语言 DCL:数据控制语言 DML:数据的操纵语言 DTL:数据事务语言 DQL:数据查询语言. DDL (date definition lang ...

随机推荐

- IPV4地址学习笔记

IP地址由网络号和主机号组成.IPV4由32位正整数来表示. A类IP:8位网络号+24主机号,网络号以0开头,网络号范围0~127 B类IP:16位网络号+16主机号,网络号以10开头,网络号范围1 ...

- push自定义动画

// // ViewController.m // ViewControllerAnimation // // Created by mac on 15/5/26. // Copyright ...

- Python—高级函数

Python-高级函数 一.闭包 Python函数是支持嵌套的.如果在一个内部函数中对外部函数作用域(非全局作用域)的变量进行引用,那么内部函数就会被称为闭包.闭包需要满足如下3个条件: 存在于两个嵌 ...

- kubectl详解

kubectl详解 目录 kubectl详解 一.陈述式管理 1. 陈述式资源管理方法 2. k8s相关信息查看 2.1 查看版本信息 2.2 查看资源对象简写 2.3 查看集群信息 2.4 配置ku ...

- Redis 源码简洁剖析 10 - aeEventLoop 及事件

aeEventLoop IO 事件处理 IO 事件创建 读事件处理 写事件处理 时间事件处理 时间事件定义 时间事件创建 时间事件回调函数 时间事件的触发处理 参考链接 Redis 源码简洁剖析系列 ...

- Centos 系统目录概述

Linux目录一切从根目录开始,即"/",根下面的目录是一个有层次的树状结构.并且分区或磁盘是必须挂载在根目录才可以正常访问.做一个形象的比喻:目录类似一个一个的入口,而根目录则是 ...

- Solution -「HDU 6875」Yajilin

\(\mathcal{Description}\) Link.(HDU 裂开了先放个私链 awa.) 在一个 \(n\times n\) 的方格图中,格子 \((i,j)\) 有权值 \(w_ ...

- Dubbo源码剖析六之SPI扩展点的实现之getExtension

上文Dubbo源码剖析六之SPI扩展点的实现之getExtensionLoader - 池塘里洗澡的鸭子 - 博客园 (cnblogs.com)中分析了getExtensionLoader,本文继续分 ...

- Spring扩展之五:Aware接口等

ApplicationContextAwareProcessor 1.介绍 ApplicationContextAwareProcessor是一个Spring内部工具,它实现了接口BeanPostPr ...

- 防世界之NaNNaNNaNNaN-Batman

题目: 只有一个附件,下载解压放到桌面. web应该是个html文件,改下后缀打开看看 发现就一个框和按钮,测试发现也没注入点,应该不是考sql.打开源码查看一下,发现是个js脚本,但是,代码是乱码, ...