Hive详解(03) - hive基础使用

Hive详解(03) - hive基础使用

Hive数据类型

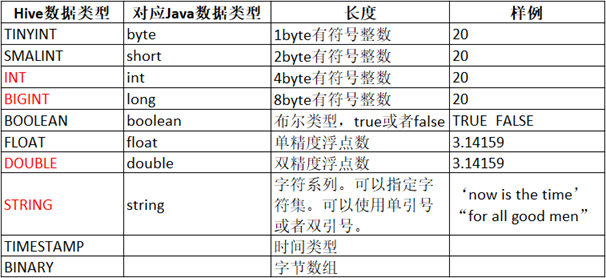

基本数据类型

对于Hive的String类型相当于数据库的varchar类型,该类型是一个可变的字符串,不过它不能声明其中最多能存储多少个字符,理论上它可以存储2GB的字符数。

集合数据类型

数据类型:STRUCT:

描述:和c语言中的struct类似,都可以通过"点"符号访问元素内容。

例如,如果某个列的数据类型是STRUCT{first STRING, last STRING},那么第1个元素可以通过字段.first来引用。

语法示例: struct<street:string, city:string>

数据类型:MAP

描述:MAP是一组键--值对元组集合,使用数组表示法可以访问数据。

例如,如果某个列的数据类型是MAP,其中键->值对是'first'->'John'和'last'->'Doe',那么可以通过字段名['last']获取最后一个元素

语法示例:map<string, int>

数据类型:ARRAY

描述:数组是一组具有相同类型和名称的变量的集合。这些变量称为数组的元素,每个数组元素都有一个编号,编号从零开始。例如,数组值为['John', 'Doe'],那么第2个元素可以通过数组名[1]进行引用。

语法示例:array<string>

类型转化

Hive的原子数据类型是可以进行隐式转换的,类似于Java的类型转换,例如某表达式使用INT类型,TINYINT会自动转换为INT类型,但是Hive不会进行反向转化,例如,某表达式使用TINYINT类型,INT不会自动转换为TINYINT类型,它会返回错误,除非使用CAST操作。

隐式类型转换规则如下

(1)任何整数类型都可以隐式地转换为一个范围更广的类型,如TINYINT可以转换成INT,INT可以转换成BIGINT。

(2)所有整数类型、FLOAT和STRING类型都可以隐式地转换成DOUBLE。

(3)TINYINT、SMALLINT、INT都可以转换为FLOAT。

(4)BOOLEAN类型不可以转换为任何其它的类型。

可以使用CAST操作显示进行数据类型转换

例如CAST('1' AS INT)将把字符串'1' 转换成整数1;如果强制类型转换失败,如执行CAST('X' AS INT),表达式返回空值 NULL。

0: jdbc:hive2://hadoop102:10000> select '1'+2, cast('1'as int) + 2;

+------+------+--+

| _c0 | _c1 |

+------+------+--+

| 3.0 | 3 |

+------+------+--+

DDL数据定义(数据库和表的操作)

数据库操作

创建数据库

创建数据库语法:

CREATE DATABASE [IF NOT EXISTS] database_name

[WITH DBPROPERTIES (property_name=property_value, ...)];

1)创建一个数据库,数据库在HDFS上的默认存储路径是/user/hive/warehouse/*.db。

hive (default)> create database db_hive;

2)避免要创建的数据库已经存在错误,增加if not exists判断。(标准写法)

hive (default)> create database if not exists db_hive;

hive (default)> create database db_hive2 location '/db_hive2.db';

查询数据库

hive> show databases like 'db_hive*';

db_hive hdfs://hadoop102:9000/user/hive/warehouse/db_hive.db atguiguUSER

hive> desc database extended db_hive;

db_hive hdfs://hadoop102:9000/user/hive/warehouse/db_hive.db atguiguUSER

修改数据库

用户可以使用ALTER DATABASE命令为某个数据库的DBPROPERTIES设置键-值对属性值,来描述这个数据库的属性信息。

hive (default)> alter database db_hive set dbproperties('createtime'='20170830');

hive> desc database extended db_hive;

db_name comment location owner_name owner_type parameters

db_hive hdfs://hadoop102:8020/user/hive/warehouse/db_hive.db atguigu USER {createtime=20170830}

删除数据库

表操作

创建表

-

CREATE [EXTERNAL] TABLE [IF NOT EXISTS] table_name

[(col_name data_type [COMMENT col_comment], ...)]

[PARTITIONED BY (col_name data_type [COMMENT col_comment], ...)]

[CLUSTERED BY (col_name, col_name, ...)

[SORTED BY (col_name [ASC|DESC], ...)] INTO num_buckets BUCKETS]

- 字段解释说明

(1)CREATE TABLE 创建一个指定名字的表。如果相同名字的表已经存在,则抛出异常;用户可以用 IF NOT EXISTS 选项来忽略这个异常。

(2)EXTERNAL关键字可以让用户创建一个外部表,在建表的同时可以指定一个指向实际数据的路径(LOCATION),

在删除表的时候,内部表的元数据和数据会被一起删除,而外部表只删除元数据,不删除数据。

(6)SORTED BY不常用,对桶中的一个或多个列另外排序

SerDe是Serialize/Deserilize的简称,

hive使用Serde进行行对象的序列与反序列化。

常用的存储文件类型:SEQUENCEFILE(二进制序列文件)、TEXTFILE(文本)、RCFILE(列式存储格式文件)

如果文件数据是纯文本,可以使用STORED AS TEXTFILE。如果数据需要压缩,使用 STORED AS SEQUENCEFILE。

create table if not exists student(

row format delimited fields terminated by '\t'

location '/user/hive/warehouse/student';

create table if not exists student2 as select id, name from student;

create table if not exists student3 like student;

hive (default)> desc formatted student2;

因为表是外部表,所以Hive并非认为其完全拥有这份数据。删除该表并不会删除掉这份数据,不过描述表的元数据信息会被删除掉。

每天将收集到的网站日志定期流入HDFS文本文件。在外部表(原始日志表)的基础上做大量的统计分析,用到的中间表、结果表使用内部表存储,数据通过SELECT+INSERT进入内部表。

7369 SMITH CLERK 7902 1980-12-17 800.00 20

7499 ALLEN SALESMAN 7698 1981-2-20 1600.00 300.00 30

7521 WARD SALESMAN 7698 1981-2-22 1250.00 500.00 30

7566 JONES MANAGER 7839 1981-4-2 2975.00 20

7654 MARTIN SALESMAN 7698 1981-9-28 1250.00 1400.00 30

7698 BLAKE MANAGER 7839 1981-5-1 2850.00 30

7782 CLARK MANAGER 7839 1981-6-9 2450.00 10

7788 SCOTT ANALYST 7566 1987-4-19 3000.00 20

7839 KING PRESIDENT 1981-11-17 5000.00 10

7844 TURNER SALESMAN 7698 1981-9-8 1500.00 0.00 30

7876 ADAMS CLERK 7788 1987-5-23 1100.00 20

7900 JAMES CLERK 7698 1981-12-3 950.00 30

7902 FORD ANALYST 7566 1981-12-3 3000.00 20

7934 MILLER CLERK 7782 1982-1-23 1300.00 10

hive (default)> dfs -mkdir /student;

hive (default)> dfs -put /opt/module/datas/student.txt /student;

create external table if not exists dept(

row format delimited fields terminated by '\t';

create external table if not exists emp(

row format delimited fields terminated by '\t';

hive (default)> desc formatted dept;

hive (default)> drop table dept;

外部表删除后,hdfs中的数据还在,但是metadata中dept的元数据已被删除

hive (default)> desc formatted student2;

alter table student2 set tblproperties('EXTERNAL'='TRUE');

hive (default)> desc formatted student2;

alter table student2 set tblproperties('EXTERNAL'='FALSE');

hive (default)> desc formatted student2;

注意:('EXTERNAL'='TRUE')和('EXTERNAL'='FALSE')为固定写法,区分大小写!

修改表

ALTER TABLE table_name RENAME TO new_table_name

hive (default)> alter table dept_partition2 rename to dept_partition3;

ALTER TABLE table_name ADD|REPLACE COLUMNS (col_name data_type [COMMENT col_comment], ...)

注:ADD是代表新增一字段,字段位置在所有列后面(partition列前),REPLACE则是表示替换表中所有字段。

hive (default)> alter table dept add columns(deptdesc string);

hive (default)> alter table dept change column deptdesc desc string;

hive (default)> alter table dept replace columns(deptno string, dname string, loc string);

删除表

hive (default)> drop table dept;

DML数据操作

数据导入

(2)local:表示从本地加载数据到hive表;否则从HDFS加载数据到hive表

(4)overwrite:表示覆盖表中已有数据,否则表示追加

hive (default)> dfs -put /opt/module/hive/datas/student.txt /user/atguigu/hive;

hive (default)> load data inpath '/user/atguigu/hive/student.txt' into table default.student;

hive (default)> dfs -put /opt/module/datas/student.txt /user/atguigu/hive;

hive (default)> insert into table student_par values(1,'wangwu'),(2,'zhaoliu');

hive (default)> insert overwrite table student_par select id, name from student ;

insert into:以追加数据的方式插入到表或分区,原有数据不会删除

insert overwrite table student partition(month='201707')

select id, name where month='201709'

insert overwrite table student partition(month='201706')

select id, name where month='201709';

create table if not exists student3 as select id, name from student;

hive (default)> dfs -mkdir /student;

hive (default)> dfs -put /opt/module/datas/student.txt /student;

hive (default)> create external table if not exists student5(id int, name string)

row format delimited fields terminated by '\t'

hive (default)> select * from student5;

hive (default)> import table student2 from '/user/hive/warehouse/export/student';

数据导出

基本语法:(hive -f/-e 执行语句或者脚本 > file)

export和import主要用于两个Hadoop平台集群之间Hive表迁移。

hive (default)> truncate table student;

基本查询

SELECT [ALL | DISTINCT] select_expr, select_expr, ...

| [DISTRIBUTE BY col_list] [SORT BY col_list]

官网查询手册地址:https://cwiki.apache.org/confluence/display/Hive/LanguageManual+Select

全表和特定列查询

- 数据准备

原始数据

dept:

10 ACCOUNTING 1700

20 RESEARCH 1800

30 SALES 1900

40 OPERATIONS 1700

emp:

7369 SMITH CLERK 7902 1980-12-17 800.00 20

7499 ALLEN SALESMAN 7698 1981-2-20 1600.00 300.00 30

7521 WARD SALESMAN 7698 1981-2-22 1250.00 500.00 30

7566 JONES MANAGER 7839 1981-4-2 2975.00 20

7654 MARTIN SALESMAN 7698 1981-9-28 1250.00 1400.00 30

7698 BLAKE MANAGER 7839 1981-5-1 2850.00 30

7782 CLARK MANAGER 7839 1981-6-9 2450.00 10

7788 SCOTT ANALYST 7566 1987-4-19 3000.00 20

7839 KING PRESIDENT 1981-11-17 5000.00 10

7844 TURNER SALESMAN 7698 1981-9-8 1500.00 0.00 30

7876 ADAMS CLERK 7788 1987-5-23 1100.00 20

7900 JAMES CLERK 7698 1981-12-3 950.00 30

7902 FORD ANALYST 7566 1981-12-3 3000.00 20

7934 MILLER CLERK 7782 1982-1-23 1300.00 10

(1)创建部门表

create table if not exists dept(

deptno int,

dname string,

loc int

)

row format delimited fields terminated by '\t';

(2)创建员工表

create table if not exists emp(

row format delimited fields terminated by '\t';

load data local inpath '/opt/module/datas/dept.txt' into tabledept;

load data local inpath '/opt/module/datas/emp.txt' into table emp;

-

hive (default)> select * from emp;

hive (default)> select empno,ename,job,mgr,hiredate,sal,comm,deptno from emp ;

- 注意:

hive (default)> select ename AS name, deptno dn from emp;

算术运算符

hive (default)> select sal +1 from emp;

常用函数

hive (default)> select count(*) cnt from emp;

hive (default)> select max(sal) max_sal from emp;

hive (default)> select min(sal) min_sal from emp;

hive (default)> select sum(sal) sum_sal from emp;

hive (default)> select avg(sal) avg_sal from emp;

Limit语句

典型的查询会返回多行数据。LIMIT子句用于限制返回的行数。

hive (default)> select * from emp limit 5;

hive (default)> select * from emp limit 2,3;

Where语句

hive (default)> select * from emp where sal >1000;

比较运算符(Between/In/ Is Null)

1)下面描述了谓词操作符,这些操作符同样可以用于JOIN…ON和HAVING语句中。

A=B:基本数据类型:如果A等于B则返回TRUE,反之返回FALSE

A<=>B:基本数据类型:如果A和B都为NULL,则返回TRUE,如果一边为NULL,返回False

A<>B, A!=B:基本数据类型:A或者B为NULL则返回NULL;如果A不等于B,则返回TRUE,反之返回FALSE

A<B:基本数据类型:A或者B为NULL,则返回NULL;如果A小于B,则返回TRUE,反之返回FALSE

A<=B:基本数据类型:A或者B为NULL,则返回NULL;如果A小于等于B,则返回TRUE,反之返回FALSE

A>B:基本数据类型:A或者B为NULL,则返回NULL;如果A大于B,则返回TRUE,反之返回FALSE

A>=B:基本数据类型:A或者B为NULL,则返回NULL;如果A大于等于B,则返回TRUE,反之返回FALSE

A IS NULL:所有数据类型:如果A等于NULL,则返回TRUE,反之返回FALSE

A IS NOT NULL:所有数据类型:如果A不等于NULL,则返回TRUE,反之返回FALSE

IN(数值1, 数值2):所有数据类型:使用 IN运算显示列表中的值

hive (default)> select * from emp where sal =5000;

hive (default)> select * from emp where sal between 500 and 1000;

hive (default)> select * from emp where comm is null;

hive (default)> select * from emp where sal IN (1500, 5000);

Like和RLike

RLIKE子句是Hive中这个功能的一个扩展,其可以通过Java的正则表达式这个更强大的语言来指定匹配条件。

hive (default)> select * from emp where ename LIKE 'A%';

hive (default)> select * from emp where ename LIKE '_A%';

hive (default)> select * from emp where ename RLIKE '[A]';

逻辑运算符(And/Or/Not)

hive (default)> select * from emp where sal>1000 and deptno=30;

hive (default)> select * from emp where sal>1000 or deptno=30;

hive (default)> select * from emp where deptno not IN(30, 20);

分组

Group By语句

GROUP BY语句通常会和聚合函数一起使用,按照一个或者多个列队结果进行分组,然后对每个组执行聚合操作。

hive (default)> select t.deptno, avg(t.sal) avg_sal from emp t group by t.deptno;

hive (default)> select t.deptno, t.job, max(t.sal) max_sal from emp t group by t.deptno, t.job;

Having语句

(1)where后面不能写分组函数,而having后面可以使用分组函数。

hive (default)> select deptno, avg(sal) from emp group by deptno;

hive (default)> select deptno, avg(sal) avg_sal from emp group by deptno having avg_sal > 2000;

关联查询Join语句

等值Join

(1)根据员工表和部门表中的部门编号相等,查询员工编号、员工名称和部门名称;

表的别名

hive (default)> select e.empno, e.ename, d.deptno from emp e join dept d on e.deptno = d.deptno;

内连接

内连接:只有进行连接的两个表中都存在与连接条件相匹配的数据才会被保留下来。

hive (default)> select e.empno, e.ename, d.deptno from emp e join dept d on e.deptno = d.deptno;

左外连接

左外连接:JOIN操作符左边表中符合WHERE子句的所有记录将会被返回。

右外连接

右外连接:JOIN操作符右边表中符合WHERE子句的所有记录将会被返回。

满外连接

满外连接:将会返回所有表中符合WHERE语句条件的所有记录。如果任一表的指定字段没有符合条件的值的话,那么就使用NULL值替代。

多表连接

注意:连接 n个表,至少需要n-1个连接条件。例如:连接三个表,至少需要两个连接条件。

create table if not exists location(

row format delimited fields terminated by '\t';

hive (default)> load data local inpath '/opt/module/datas/location.txt' into table location;

hive (default)>SELECT e.ename, d.dname, l.loc_name FROM emp e

JOIN dept d ON d.deptno = e.deptno

JOIN location l ON d.loc = l.loc;

注意:为什么不是表d和表l先进行连接操作呢?这是因为Hive总是按照从左到右的顺序执行的。

优化:当对3个或者更多表进行join连接时,如果每个on子句都使用相同的连接键的话,那么只会产生一个MapReduce job。

笛卡尔积

hive (default)> select empno, dname from emp, dept;

排序

全局排序(Order By)

hive (default)> select * from emp order by sal;

hive (default)> select * from emp order by sal desc;

按照别名排序

hive (default)> select ename, sal*2 twosal from emp order by twosal;

多个列排序

hive (default)> select ename, deptno, sal from emp order by deptno, sal ;

每个Reduce内部排序(Sort By)

Sort By:对于大规模的数据集order by的效率非常低。在很多情况下,并不需要全局排序,此时可以使用sort by。

Sort by为每个reducer产生一个排序文件。每个Reducer内部进行排序,对全局结果集来说不是排序。

hive (default)> set mapreduce.job.reduces=3;

hive (default)> set mapreduce.job.reduces;

hive (default)> select * from emp sort by deptno desc;

分区(Distribute By)

Distribute By: 在有些情况下,需要控制某个特定行应该到哪个reducer,通常是为了进行后续的聚集操作。distribute by子句可以做这件事。distribute by类似MR中partition(自定义分区),进行分区,结合sort by使用。

对于distribute by进行测试,一定要分配多reduce进行处理,否则无法看到distribute by的效果。

hive (default)> set mapreduce.job.reduces=3;

distribute by的分区规则是根据分区字段的hash码与reduce的个数进行模除后,余数相同的分到一个区。

Hive要求DISTRIBUTE BY语句要写在SORT BY语句之前。

Cluster By

当distribute by和sort by字段相同时,可以使用cluster by方式。

cluster by除了具有distribute by的功能外还兼具sort by的功能。但是排序只能是升序排序,不能指定排序规则为ASC或者DESC。

hive (default)> select * from emp cluster by deptno;

hive (default)> select * from emp distribute by deptno sort by deptno;

注意:按照部门编号分区,不一定就是固定死的数值,可以是20号和30号部门分到一个分区里面去。

分区表和分桶表

分区表

引入分区表(需要根据日期对日志进行管理, 通过部门信息模拟)

|

注意:分区字段不能是表中已经存在的数据,可以将分区字段看作表的伪列。 |

hive (default)> select * from dept_partition where day='20200401';

hive (default)> select * from dept_partition where day='20200401'

union select * from dept_partition where day='20200402'

union select * from dept_partition where day='20200403';

hive (default)> alter table dept_partition add partition(day='20200404') ;

hive (default)> alter table dept_partition add partition(day='20200405') partition(day='20200406');

hive (default)> alter table dept_partition drop partition (day='20200406');

二级分区

-

hive (default)> create table dept_partition2(

deptno int, dname string, loc string

)

partitioned by (day string, hour string)

row format delimited fields terminated by '\t';

- 正常的加载数据

hive (default)> select * from dept_partition2 where day='20200401' and hour='12';

hive (default)> dfs -mkdir –p /user/hive/warehouse/mydb.db/dept_partition2/day=20200401/hour=13;

hive (default)> select * from dept_partition2 where day='20200401' and hour='13';

hive> msck repair table dept_partition2;

hive (default)> select * from dept_partition2 where day='20200401' and hour='13';

hive (default)> dfs -mkdir –p /user/hive/warehouse/mydb.db/dept_partition2/day=20200401/hour=14;

hive (default)> alter table dept_partition2 add partition(day='201709',hour='14');

hive (default)> select * from dept_partition2 where day='20200401' and hour='14';

hive (default)> dfs -mkdir –p /user/hive/warehouse/mydb.db/dept_partition2/day=20200401/hour=15;

hive (default)> select * from dept_partition2 where day='20200401' and hour='15';

动态分区

hive.exec.dynamic.partition=true

(2)设置为非严格模式(动态分区的模式,默认strict,表示必须指定至少一个分区为静态分区,nonstrict模式表示允许所有的分区字段都可以使用动态分区。)

hive.exec.dynamic.partition.mode=nonstrict

(3)在所有执行MR的节点上,最大一共可以创建多少个动态分区。默认1000

hive.exec.max.dynamic.partitions=1000

hive.exec.max.dynamic.partitions.pernode=100

(5)整个MR Job中,最大可以创建多少个HDFS文件。默认100000

hive.exec.max.created.files=100000

(6)当有空分区生成时,是否抛出异常。一般不需要设置。默认false

hive.error.on.empty.partition=false

需求:将dept表中的数据按照地区(loc字段),插入到目标表dept_partition的相应分区中。

set hive.exec.dynamic.partition.mode = nonstrict;

hive (default)> show partitions dept_partition;

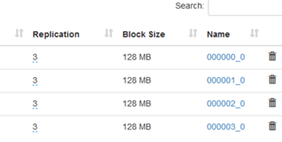

分桶表

分区提供一个隔离数据和优化查询的便利方式。不过,并非所有的数据集都可形成合理的分区。对于一张表或者分区,Hive 可以进一步组织成桶,也就是更为细粒度的数据范围划分。

create table stu_bucket(id int, name string)

row format delimited fields terminated by '\t';

hive (default)> desc formatted stu_bucket;

hive (default)> load data inpath '/student.txt' into table stu_bucket;

hive(default)> select * from stu_buck;

根据结果可知:Hive的分桶采用对分桶字段的值进行哈希,然后除以桶的个数求余的方 式决定该条记录存放在哪个桶当中

(1)reduce的个数设置为-1,让Job自行决定需要用多少个reduce或者将reduce的个数设置为大于等于分桶表的桶数

(2)从hdfs中load数据到分桶表中,避免本地文件找不到问题

抽样查询

对于非常大的数据集,有时用户需要使用的是一个具有代表性的查询结果而不是全部结果。Hive可以通过对表进行抽样来满足这个需求。

语法: TABLESAMPLE(BUCKET x OUT OF y)

hive (default)> select * from stu_buck tablesample(bucket 1 out of 4 on id);

Hive详解(03) - hive基础使用的更多相关文章

- Hive详解(06) - Hive调优实战

Hive详解(06) - Hive调优实战 执行计划(Explain) 基本语法 EXPLAIN [EXTENDED | DEPENDENCY | AUTHORIZATION] query 案例实操 ...

- Hive详解(04) - hive函数的使用

Hive详解(04) - hive函数的使用 系统内置函数 查看系统自带的函数 hive> show functions; 显示自带的函数的用法 hive> desc function u ...

- Hive详解(02) - Hive 3.1.2安装

Hive详解(02) - Hive 3.1.2安装 安装准备 Hive下载地址 Hive官网地址:http://hive.apache.org/ 官方文档查看地址:https://cwiki.apac ...

- Hive详解(05) - 压缩和存储

Hive详解(05) - 压缩和存储 Hadoop压缩配置 MR支持的压缩编码 压缩格式 算法 文件扩展名 是否可切分 DEFLATE DEFLATE .deflate 否 Gzip DEFLATE ...

- Hive详解(01) - 概念

Hive详解(01) - 概念 hive简介 Hive:由Facebook开源用于解决海量结构化日志的数据统计工具,是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张表,并提供类S ...

- Spark详解(03) - Spark3.0.0运行环境安装

Spark详解(03) - Spark3.0.0运行环境安装 Spark运行模式 Spark常见部署模式: Local模式:在本地部署单个Spark服务 所谓的Local模式,就是不需要其他任何节点资 ...

- Zookeeper详解(03) - zookeeper的使用

Zookeeper详解(03) - zookeeper的使用 ZK客户端命令行操作 命令基本语法 help:显示所有操作命令 ls path:使用 ls 命令来查看当前znode的子节点 -w 监听子 ...

- JAVASCRIPT事件详解-------原生事件基础....

javaScirpt事件详解-原生事件基础(一) 事件 JavaScript与HTML之间的交互是通过事件实现的.事件,就是文档或浏览器窗口中发生的一些特定的交互瞬间,通过监听特定事件的发生,你能 ...

- kafka详解(03) - kafka JAVA API

kafka详解(03) - kafka JAVA API Producer (生产者)API 消息发送流程 Kafka的Producer发送消息采用的是异步发送的方式.在消息发送的过程中,涉及到了两个 ...

随机推荐

- .NET周报【10月第2期 2022-10-17】

主题 宣布 .NET 7 发布候选版本 2 - .NET Blog https://devblogs.microsoft.com/dotnet/announcing-dotnet-7-rc-2/ .N ...

- LeetCode------移动零(5)【数组】

来源:力扣(LeetCode) 链接:https://leetcode-cn.com/problems/move-zeroes 1.题目 给定一个数组 nums,编写一个函数将所有 0 移动到数组的末 ...

- 「MySQL高级篇」explain分析SQL,索引失效&&常见优化场景

大家好,我是melo,一名大三后台练习生 专栏回顾 索引的原理&&设计原则 欢迎关注本专栏:MySQL高级篇 本篇速览 在我们上一篇文章中,讲到了索引的原理&&设计原则 ...

- 状态估计和KalmanFilter公式的推导与应用

状态估计的概率解释 运动和观测方程: \[\left\lbrace \begin{array}{l} x_k = f(x_{k_1}, u_k) + w_k \\ z_k = h(y_j, x_k) ...

- 解决头部使用 position:fixed; 固定定位后遮住下方内容的问题

1.在头部下面给一个空的 div 给这个div设置高度,把页面撑开,这种方法是让头部刚好遮住的是这个空div,把内容放出来. 但是这种方法需要一点点调试高度,所以不推荐. 2.把整个要使用 posit ...

- zk,kafka,redis哨兵,mysql容器化

1. zookeeper,kafka容器化 1.1 zookeeper+kafka单机docker模式 docker pull bitnami/zookeeper:3.6.3-debian-11-r4 ...

- 视频服务HDR Vivid 还原色彩,让所见成“真”

如今,视频正在以一种前所未有的方式渗入日常生活,是当下人们记录生活最热门的方式.所以,用户对视频的画质要求越来越高,App想要吸引更多的用户,拥有视频画质新技术的强力支撑很关键. HDR(High-D ...

- API 如何选择 REST,GraphQL还是gRPC

关于API的演进 CORBA RDA XML-RPC SOAP REST JSON-RPC ODATA GraphQL gRPC gRPC是什么?

- 我的第一个项目(二):使用Vue做一个登录注册界面

好家伙, 顶不住了,太多的bug, 本来是想把背景用canvas做成动态的,但是,出现了各种问题 为了不耽误进度,我们先把一个简单的登录注册界面做出来 来看看效果: (看上去还不错) 本界面使用 ...

- PHY驱动调试之 --- MDIO/MDC接口22号和45号条款(一)

最近在调试一款Phy的驱动,从没有任何头绪到略有了解经历了太多的痛苦,于是决定写这个系列篇记录一下.特别感谢无数优秀的博主无私奉献很多优秀的博文给予了我很大的帮助.在这个系列篇中,我也会转载部分优秀的 ...