第三节 pandas续集

import pandas as pd

from pandas import Series

from pandas import DataFrame

import numpy as np

一 创建多层DataFrame

- 取得列:df['col'] df[[c1,c2]] df.loc[:,col]

- 取行:df.loc['index'] df[index1:inde2]

1.1 隐式构造

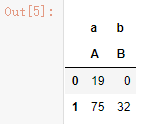

最常见的方法是给DataFrame构造函数的index或者columns参数传递两个或更多的数组

DataFrame(data=np.random.randint(0,100,size=(2,2)),columns=[['a','b'],['A','B']])

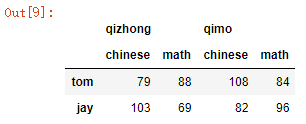

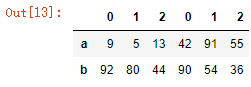

1.2 显示构造pd.MultiIndex.from_product

col=pd.MultiIndex.from_product([['qizhong','qimo'],

['chinese','math']]) #创建DF对象

df = DataFrame(data=np.random.randint(60,120,size=(2,4)),index=['tom','jay'],

columns=col)

二 多层行索引

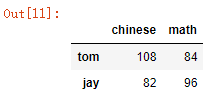

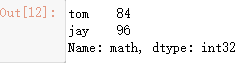

逐级降层

df['qimo']

df['qimo']['math']

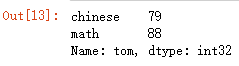

# 获取tom期中所有科目的考试成绩 df['qizhong'].loc['tom']

注意

在对行索引的时候,若一级行索引还有多个,对二级行索引会遇到问题!也就是说,无法直接对二级索引进行索引,必须让

二级索引变成一级索引后才能对其进行索引!

总结:

访问一列或多列 直接用中括号[columnname] [[columname1,columnname2...]]

访问一行或多行 .loc[indexname]

访问某一个元素 .loc[indexname,columnname] 获取李四期中的php成绩

行切片 .[index1:index2] 获取张三李四的期中成绩

列切片 .loc[:,column1:column2] 获取张三李四期中的php和c++成绩

三 聚合操作

所谓的聚合操作:平均数,方差,最大值,最小值……

df.sum(axis=0) df.mean()

四 使用pd.concat()级联

pandas使用pd.concat函数,与np.concatenate函数类似,只是多了一些参数:

objs

axis=0

keys

join='outer' / 'inner':表示的是级联的方式,outer会将所有的项进行级联(忽略匹配和不匹配),

而inner只会将匹配的项级联到一起,不匹配的不级联

ignore_index=False

4.1 匹配级联

匹配的索引能完全对上,不多也不少.

df1 = DataFrame(data=np.random.randint(0,100,size=(3,3)),index=['a','b','c'])

df2 = DataFrame(data=np.random.randint(0,100,size=(3,3)),index=['a','b','d'])

pd.concat([df1,df1],axis=0)

4.2 不匹配级联

不匹配指的是级联的维度的索引不一致。例如纵向级联时列索引不一致,横向级联时行索引不一致

有2种连接方式:

- 外连接:补NaN(默认模式)outer

- 内连接:只连接匹配的项 inner

pd.concat([df1,df2],axis=1,join='inner') #内连接

4.3 使用df.append()函数添加

由于在后面级联的使用非常普遍,因此有一个函数append专门用于在后面添加

df1.append(df2) #列索引必须一致

五 使用pd.merge()合并

merge与concat的区别在于,merge需要依据某一共同的列来进行合并

使用pd.merge()合并时,会自动根据两者相同column名称的那一列,作为key来进行合并。

注意每一列元素的顺序不要求一致

参数:

- how:out取并集 inner取交集

- on:当有多列相同的时候,可以使用on来指定使用那一列进行合并,on的值为一个列表

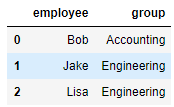

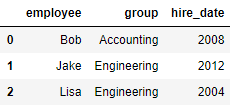

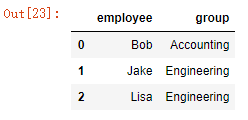

5.1 一对一合并

df1 = DataFrame({'employee':['Bob','Jake','Lisa'],

'group':['Accounting','Engineering','Engineering'],

})

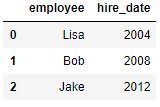

df2 = DataFrame({'employee':['Lisa','Bob','Jake'],

'hire_date':[2004,2008,2012],

})

pd.merge(df1,df2) #自动找相同的,列进行合并

left: right:

right:  merge后:

merge后:

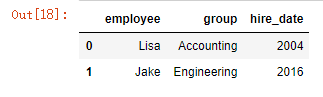

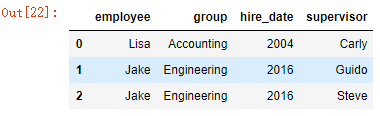

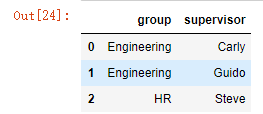

5.2 多对一合并

df3 = DataFrame({

'employee':['Lisa','Jake'],

'group':['Accounting','Engineering'],

'hire_date':[2004,2016]})

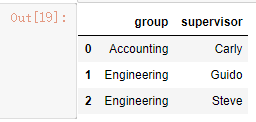

df4 = DataFrame({'group':['Accounting','Engineering','Engineering'],

'supervisor':['Carly','Guido','Steve']

})

pd.merge(df3,df4,how='outer')

left: right:

right:

merge:

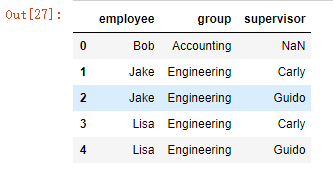

5.3 多对多合并

df1 = DataFrame({'employee':['Bob','Jake','Lisa'],

'group':['Accounting','Engineering','Engineering']})

df5 = DataFrame({'group':['Engineering','Engineering','HR'],

'supervisor':['Carly','Guido','Steve']

})

pd.merge(df1,df5,how='left')

left: right:

right:

merge:

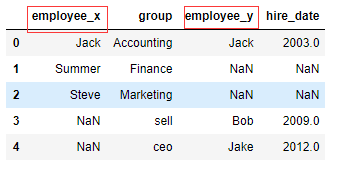

5.4 key的规范化

- 当列冲突时,即有多个列名称相同时,需要使用on=来指定哪一个列作为key,配合suffixes指定冲突列名

df1 = DataFrame({'employee':['Jack',"Summer","Steve"],

'group':['Accounting','Finance','Marketing']})

df2 = DataFrame({'employee':['Jack','Bob',"Jake"],

'hire_date':[2003,2009,2012],

'group':['Accounting','sell','ceo']})

pd.merge(df1,df2,on='group',how='outer')

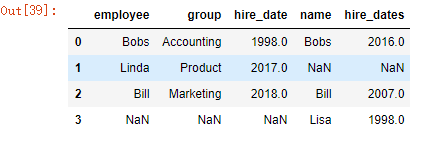

- 当两张表没有可进行连接的列时,可使用left_on和right_on手动指定merge中左右两边的哪一列列作为连接的列

df1 = DataFrame({'employee':['Bobs','Linda','Bill'],

'group':['Accounting','Product','Marketing'],

'hire_date':[1998,2017,2018]})

df5 = DataFrame({'name':['Lisa','Bobs','Bill'],

'hire_dates':[1998,2016,2007]})

pd.merge(df1,df5,left_on='employee',right_on='name',how='outer') #指定左右表相关联的列

5.5 内合并与外合并:out取并集 inner取交集

- 内合并:只保留两者都有的key(默认模式)

df6 = DataFrame({'name':['Peter','Paul','Mary'],

'food':['fish','beans','bread']}

)

df7 = DataFrame({'name':['Mary','Joseph'],

'drink':['wine','beer']})

- 外合并 how='outer':补NaN

df6 = DataFrame({'name':['Peter','Paul','Mary'],

'food':['fish','beans','bread']}

)

df7 = DataFrame({'name':['Mary','Joseph'],

'drink':['wine','beer']})

六 数据处理

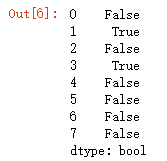

6.1 删除重复元素 duplicated()

使用duplicated()函数检测重复的行,返回元素为布尔类型的Series对象,每个元素对应一行,如果该行不是第一次出现,则元素为True

- keep参数:指定保留哪一重复的行数据

#数据准备

#创建一个df

np.random.seed(1)

df = DataFrame(np.random.randint(0,100,size=(8,6))) #手动将df的某几行设置成相同的内容

df.iloc[1] = [6,6,6,6,6,6]

df.iloc[3] = [6,6,6,6,6,6]

df.iloc[4] = [6,6,6,6,6,6]

方式一

df.duplicated(keep='last')

indexs = df[df.duplicated(keep='last')].index #获取需要删除行的索引

df.drop(labels=indexs,axis=0) #删除重复行

方式二:

使用drop_duplicates()函数删除重复的行

- drop_duplicates(keep='first/last'/False)

df.drop_duplicates() #一步到位

6.2 映射

(1)replace( )函数:替换元素

使用replace()函数,对values进行映射操作

Series替换操作

- 单值替换

- 普通替换

- 字典替换(推荐)

- 多值替换

- 列表替换

- 字典替换(推荐)

- 参数

- to_replace:被替换的元素

replace参数说明:

- method:对指定的值使用相邻的值填充替换

- limit:设定填充次数

DataFrame替换操作

- 单值替换

- 普通替换: 替换所有符合要求的元素:to_replace=15,value='e'

- 按列指定单值替换: to_replace={列标签:替换值} value='value'

- 多值替换

- 列表替换: to_replace=[] value=[]

- 字典替换(推荐) to_replace={to_replace:value,to_replace:value}

注意:DataFrame中,无法使用method和limit参数

df.replace(to_replace=6,value='six') #用'six'代替df中的'6'

df.replace(to_replace={3:6},value='six') #用'six'代替df中第4列的'6'

df.replace(to_replace={1:'one'}) #用'one'代替df中的''1'

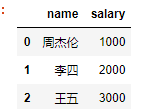

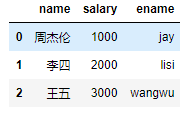

6.3 map()函数:新建一列 , map函数并不是df的方法,而是series的方法

- map()可以映射新一列数据

- map()中可以使用lambd表达式

map()中可以使用方法,可以是自定义的方法

eg:map({to_replace:value})

注意 map()中不能使用sum之类的函数,for循环

dic = {

'name':['周杰伦','李四','王五'],

'salary':[1000,2000,3000]

}

df = DataFrame(data=dic)

#新增一列:给df中,添加一列,该列的值为中文名对应的英文名 #封装一个映射关系表

dic = {

'周杰伦':'jay',

'王五':'wangwu',

'李四':'lisi'

}

df['ename'] = df['name'].map(dic)

df

map当做一种运算工具,至于执行何种运算,是由map函数的参数决定的(参数:lambda,函数)

- 使用自定义函数

#自定义函数

def after_salary(s):

if s <= 500:

return s

else:

return s - (s-500)*0.5 #超过500部分的钱缴纳50%的税

after_sal = df['salary'].map(after_salary)

df['after_salary'] = after_sal

df

- 使用lambda表达式

#员工的薪资集体提高500

df['salary'].map(lambda x:x+500)

6.4 数据重排 --- 使用.take()函数排序

- take()函数接受一个索引列表,用数字表示,使得df根据列表中索引的顺序进行排序

- eg:df.take([1,3,4,2,5])- np.random.permutation(x)可以生成x个从0-(x-1)的随机数列

df.take(np.random.permutation(1000),axis=0).take(np.random.permutation(3),axis=1) #np.random.permutation(1000) :把0,1000随机排列成列表

当DataFrame规模足够大时,直接使用np.random.permutation(x)函数,就配合take()函数实现随机抽样

6.5 数据分类处理【重点】

数据聚合是数据处理的最后一步,通常是要使每一个数组生成一个单一的数值。

数据分类处理:

- 分组:先把数据分为几组

- 用函数处理:为不同组的数据应用不同的函数以转换数据

- 合并:把不同组得到的结果合并起来

数据分类处理的核心:

- groupby()函数

- groups属性查看分组情况

- eg: df.groupby(by='item').groups6.5.1 分组

#数据源

df = DataFrame({'item':['Apple','Banana','Orange','Banana','Orange','Apple'],

'price':[4,3,3,2.5,4,2],

'color':['red','yellow','yellow','green','green','green'],

'weight':[12,20,50,30,20,44]}) #分组

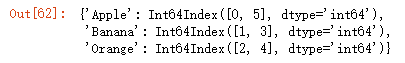

df.groupby(by='item') #查看分组情况

df.groupby(by='item').groups

分组后可以聚合:.sum,.mean

#计算出苹果的平均价格

dic = {

'Apple':3,

'Banana':2.75,

'Orange':3.5

}

df['mean_price'] = df['item'].map(dic)

df.groupby(by='item')['price'].mean()['Apple'] #按颜色查看各种颜色的水果的平均价格

df.groupby(by='color')['price'].mean()

dic={

'green':2.83,

'red':4,

'yellow':3

}

df['color_mean_price'] = df['color'].map(dic)

df

6.6 高级数据聚合

使用groupby分组后,也可以使用transform和apply提供自定义函数实现更多的运算

- df.groupby('item')['price'].sum() <==> df.groupby('item')['price'].apply(sum)

- transform和apply都会进行运算,在transform或者apply中传入函数即可

- transform和apply也可以传入一个lambda表达式

#求出各种水果价格的平均值

df.groupby(by='item')['price'].mean()

apply和transform

#定义执行方法

def fun(s):

sum = 0

for i in s:

sum+=s

return sum/s.size

#使用apply函数求出水果的平均价格

df.groupby(by='item')['price'].apply(fun) #给fun传入的参数是一个列表 #使用transform函数求出水果的平均价格

df.groupby(by='item')['price'].transform(fun) #给fun传入的参数是一个列表

第三节 pandas续集的更多相关文章

- 第三节:初识pandas之DataFrame(上)

DataFrame是Python中Pandas库中的一种数据结构,它类似excel,是一种二维表.

- 第十三节:pandas之groupby()分组

1.Series()对象分组 1.1.单级索引 1.2.多级索引 2.DataFrame()对象分组 3.获取一个分组,遍历分组,filter过滤.

- Python Pandas的使用 !!!!!详解

Pandas是一个基于python中Numpy模块的一个模块 Python在数据处理和准备⽅⾯⼀直做得很好,但在数据分析和建模⽅⾯就差⼀些.pandas帮助填补了这⼀空⽩,使您能够在Python中执 ...

- pandas基础-Python3

未完 for examples: example 1: # Code based on Python 3.x # _*_ coding: utf-8 _*_ # __Author: "LEM ...

- android内部培训视频_第三节(3)_常用控件(ViewPager、日期时间相关、ListView)

第三节(2):常用控件之ViewPager.日期时间相关.ListView 一.ViewPager 实例:结合PagerAdapter滑动切换图片 二.日期时间相关:AnalogClock\Dig ...

- 10 Minutes to pandas

摘要 一.创建对象 二.查看数据 三.选择和设置 四.缺失值处理 五.相关操作 六.聚合 七.重排(Reshaping) 八.时间序列 九.Categorical类型 十.画图 十一 ...

- SignalR系列续集[系列6:使用自己的连接ID]

目录 SignalR系列目录 前言 老规矩,前言~,在此先道个歉,之前的1-5对很多细节问题都讲的不是很详细,也有很多人在QQ或者博客问我一些问题 所以,特开了这个续集.. - -, 讲一些大家在开发 ...

- 利用Python进行数据分析(15) pandas基础: 字符串操作

字符串对象方法 split()方法拆分字符串: strip()方法去掉空白符和换行符: split()结合strip()使用: "+"符号可以将多个字符串连接起来: join( ...

- 利用Python进行数据分析(10) pandas基础: 处理缺失数据

数据不完整在数据分析的过程中很常见. pandas使用浮点值NaN表示浮点和非浮点数组里的缺失数据. pandas使用isnull()和notnull()函数来判断缺失情况. 对于缺失数据一般处理 ...

随机推荐

- Recursion之Demo

Model: public class PerSon { [DisplayName("标识id")] public string id { get; set; } [Display ...

- 仓储模式Repository的选择与设计

首次接触仓储的概念来自Eric Evans 的经典著作<领域驱动设计-软件核心复杂性应对之道>,但书中没有具体实现.如何实现仓储模式,在我这几年的使用过程中也积累了一些具体的实施经验.根据 ...

- leetcode — valid-palindrome

/** * Source : https://oj.leetcode.com/problems/valid-palindrome/ * * * Given a string, determine if ...

- Docker系列04—Docker的网络模式详解

本文收录在容器技术学习系列文章总目录 1.Docker的四种网络模式 (1)docker四种网络模式如下: Bridge contauner 桥接式网络模式 Host(open) containe ...

- DSAPI 添加删除程序到Windows启动

使用DSAPI.dll中文件类里现成的功能,将使你可以快速高效地实现将程序加入Windows启动项或从启动项中删除. 简单也是非常地简单,但由于是比较独立的功能,所以单独发表为整个篇幅. DSAPI ...

- js报错:Uncaught SyntaxError: Unexpected string

一.问题 今天在写jsp页面时,发现加上某段代码后,页面的其它js就失效了,死活出不来,然后打开谷歌浏览器发现,页面js报如下错误: Uncaught SyntaxError: Unexpected ...

- Linux文件系统的基本结构

Linux文件系统结构 通过下面两张图片来认识一下Linux文件系统的结构. 当前工作目录 实践: 文件名称 这些规则不仅适用于文件,也适用于文件夹. 实践: ls命令 ls命令表示列出当前工作目录的 ...

- 免费开源ERP Odoo实施指南 连载二:POSTGRESQL概述

PostgreSQL是Odoo支持的数据库.PostgreSQL是起源于大学的一个历史很长的开源数据库系统.包括美国航天局NASA.德国证券交易中心.中国的平安.腾讯的微信支付.阿里巴巴的阿里云都在用 ...

- 驰骋工作流引擎JFlow与activiti的对比之2种结构化模式

1. 任意循环(Arbitrary Cycles) ACTIVITI : 某一个或多个活动可以反复执行. 例子:用户买了瓶汽水,拿到汽水后,中了一瓶,又去兑换了一瓶汽水,如果又中了,再去兑换一瓶汽水- ...

- 卷烟厂生产管理系统基于ASP.NET

VS.Net 2003开发的一个非常老的生产信息管理系统运行10多年依旧稳定,这几天来南昌做维保工作,看到了曾经开发的信息系统.该系统在我眼里老到几点,可却依然在厂里大面积使用,抛开技术上的落后,从新 ...