CS231n 2016 通关 第六章 Training NN Part2

本章节讲解 参数更新 dropout

=========================================================================================

上节内容回顾与总结:

模型过程:

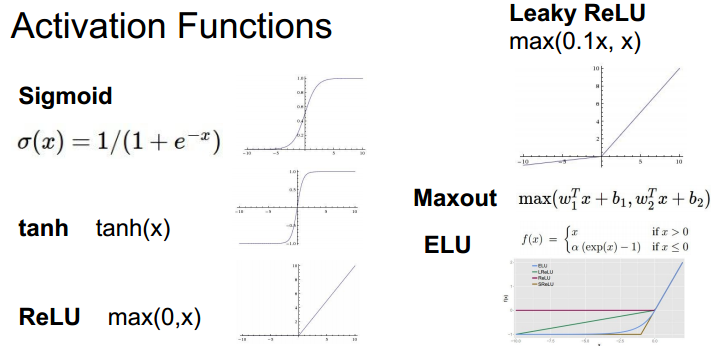

激活函数:注意理解各个函数的优缺点

数据预处理:

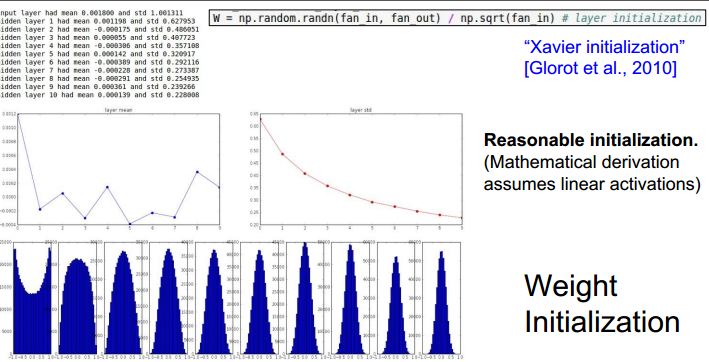

权重参数初始化:Xavier方法,使用较多。

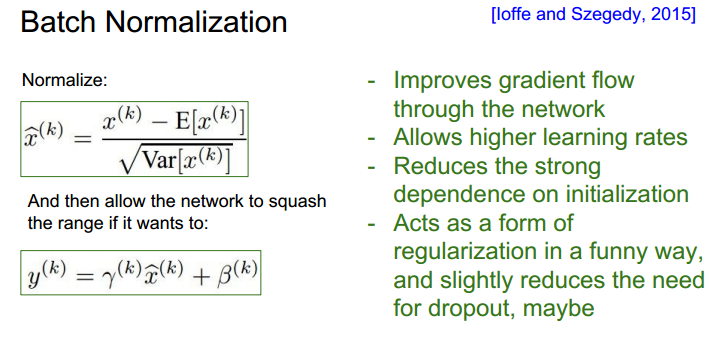

batch normalization :

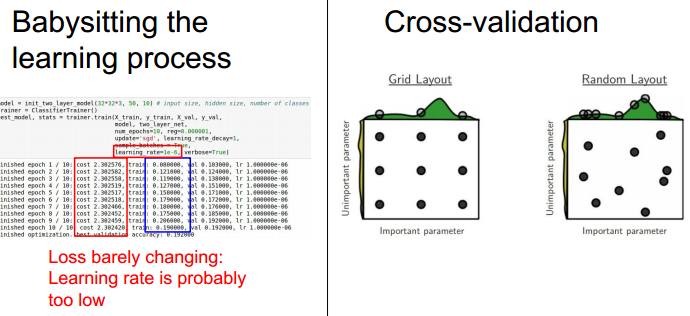

cross validation :比较loss 结果,选择合适学习率

=========================================================================================

本章知识点:

=========================================================================================

Parameter Update :

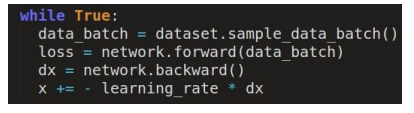

训练NN的代码结构:

最后一行即为参数更新。

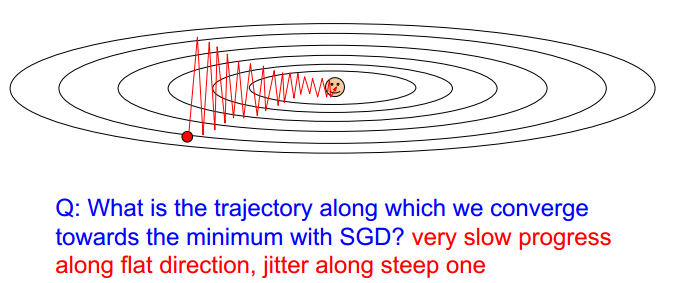

sgd的轨迹:

因为minibatch的原因,在波动中收敛。

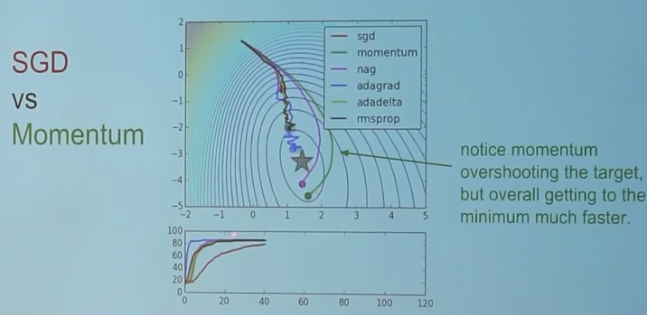

Momentum update

加入了动量,加速收敛。

SGD vs Momentum

Momentum 直观解释:

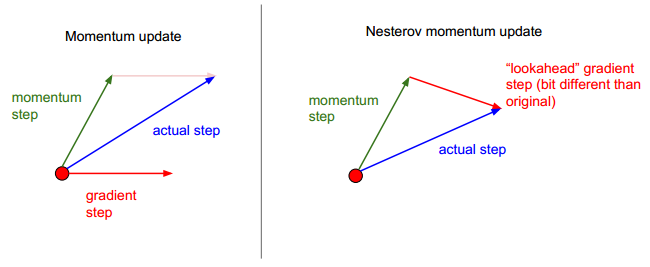

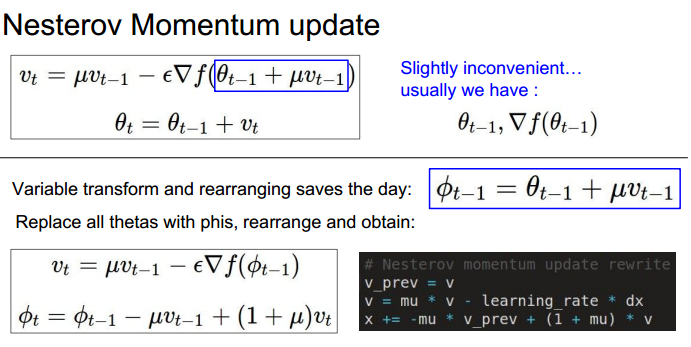

Nesterov Momentum :

更新公式比较:

AdaGrad update : 前两种是在更新方式上的算法,接着总结学习率更新的算法

自适应梯度,根据误差项来调整学习率。

显然,在误差较大时学习率低,当误差减小时,学习率升高。

RMSProp update :

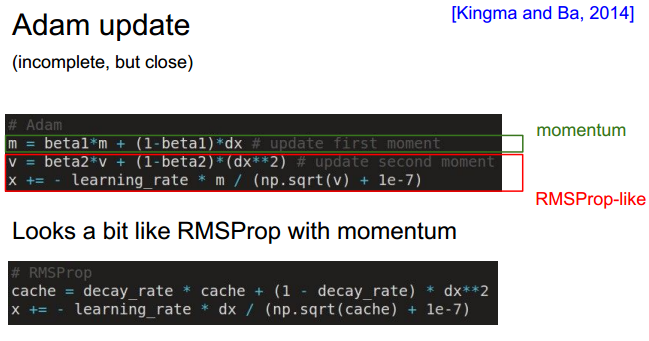

Adam update :

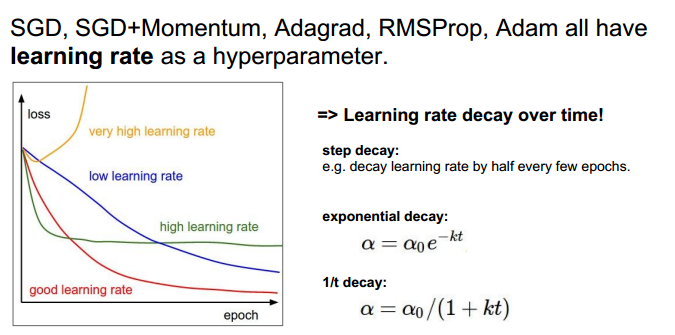

Learning rate :

可以使用开始时较大的学习率,之后逐步衰减的方法。

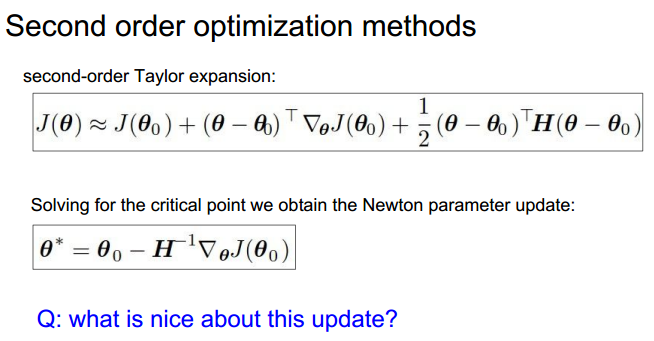

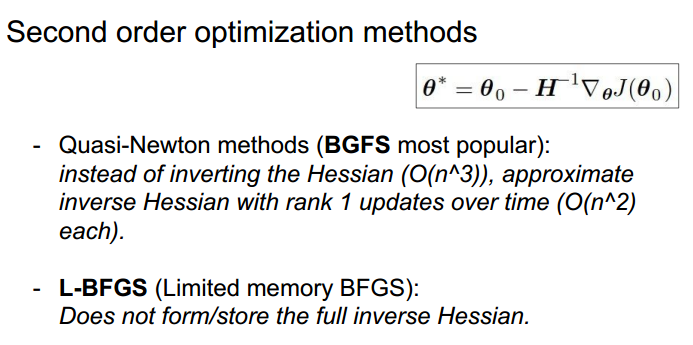

第二种优化方法:

损失函数泰勒展开:

这种方法,不需要超参数,学习率等。但是不实用,因为需要计算H-1,即海森矩阵。其比较庞大。

拟牛顿法:

实际应用:

=========================================================================================

model ensemble :在测试的时候,使用多个模型,对结果做平均值。

一些技巧:

=========================================================================================

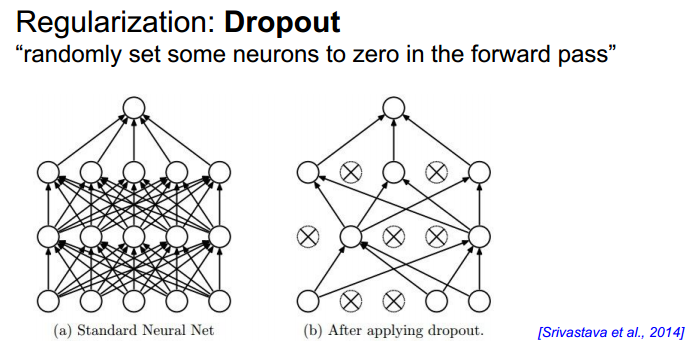

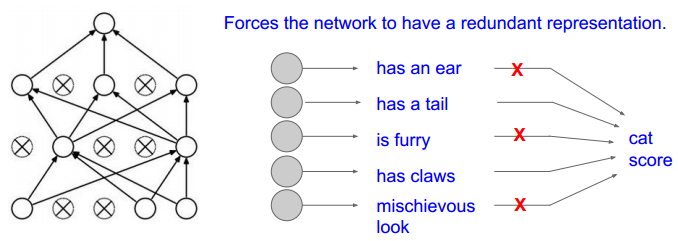

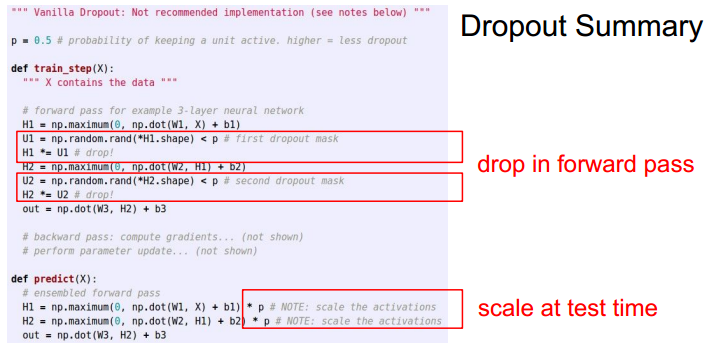

Dropout :

示意图:

代码结构:

模型实例:

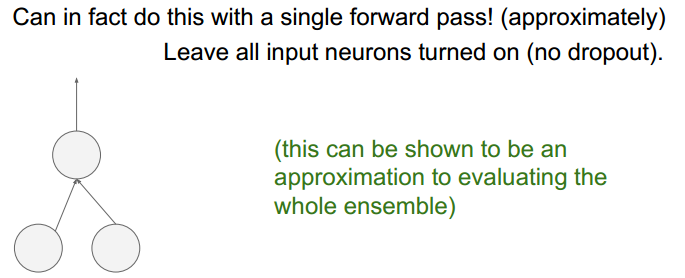

测试阶段:没有dropout

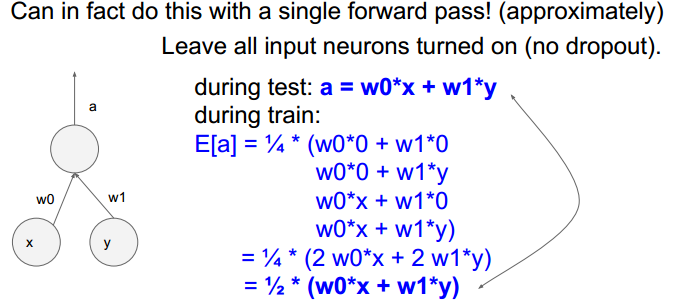

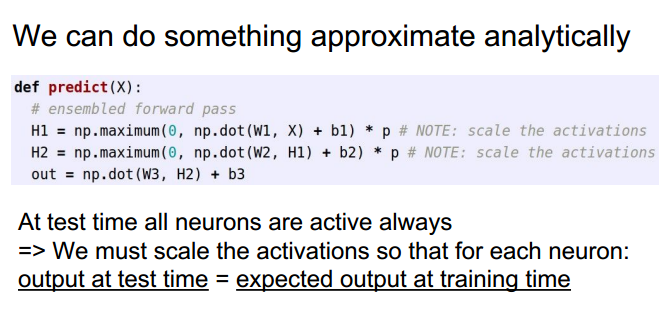

在training 阶段做出一些调整:

修改后:

两种方式:

=========================================================================================

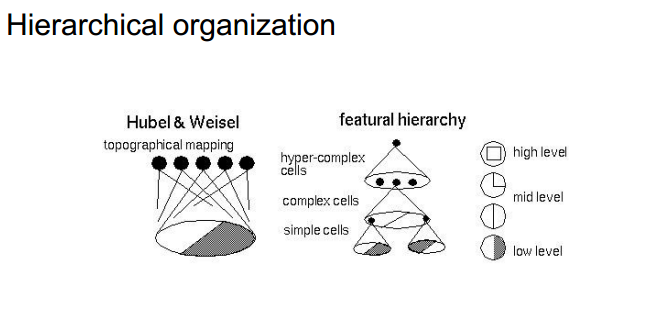

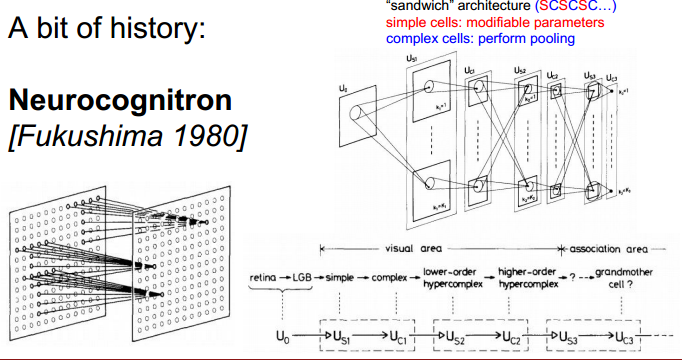

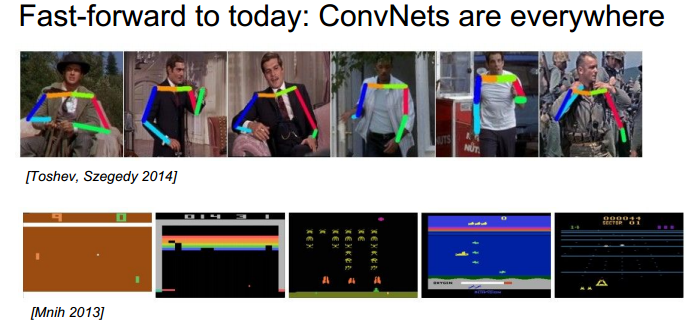

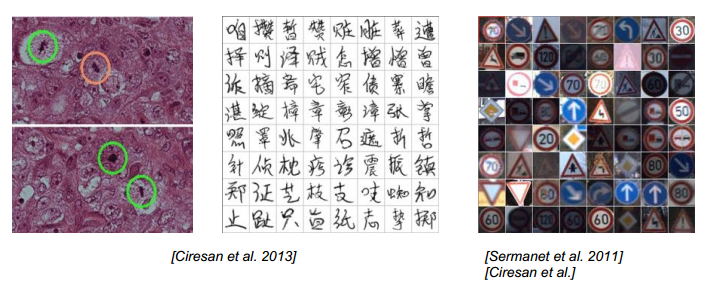

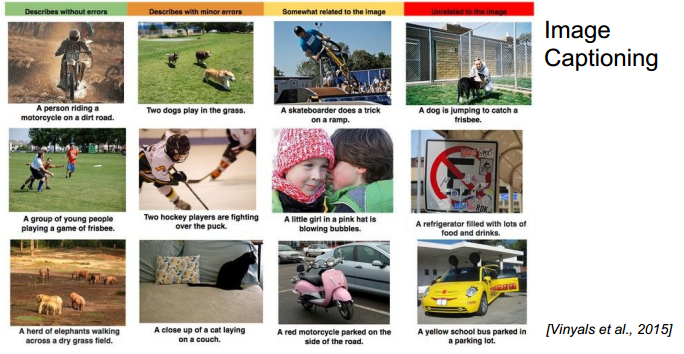

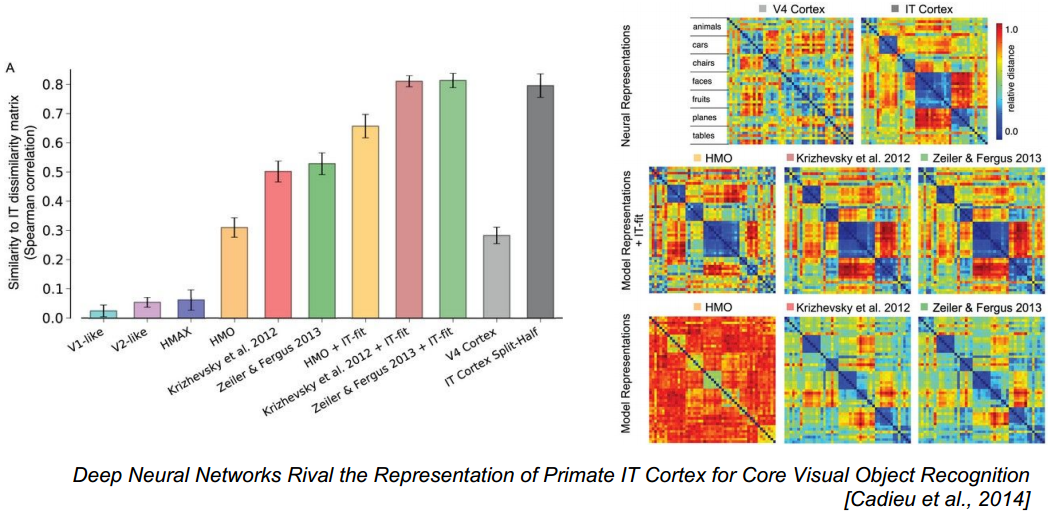

CNN 发展过程

视觉系统是由简单结构到复杂结构,信号的抽象过程。

拟生视觉网络。

现阶段:分类、复原、识别应用广。

附:通关CS231n企鹅群:578975100 validation:DL-CS231n

CS231n 2016 通关 第六章 Training NN Part2的更多相关文章

- CS231n 2016 通关 第五章 Training NN Part1

在上一次总结中,总结了NN的基本结构. 接下来的几次课,对一些具体细节进行讲解. 比如激活函数.参数初始化.参数更新等等. ====================================== ...

- CS231n 2016 通关 第四章-NN 作业

cell 1 显示设置初始化 # A bit of setup import numpy as np import matplotlib.pyplot as plt from cs231n.class ...

- CS231n 2016 通关 第四章-反向传播与神经网络(第一部分)

在上次的分享中,介绍了模型建立与使用梯度下降法优化参数.梯度校验,以及一些超参数的经验. 本节课的主要内容: 1==链式法则 2==深度学习框架中链式法则 3==全连接神经网络 =========== ...

- CS231n 2016 通关 第三章-Softmax 作业

在完成SVM作业的基础上,Softmax的作业相对比较轻松. 完成本作业需要熟悉与掌握的知识: cell 1 设置绘图默认参数 mport random import numpy as np from ...

- CS231n 2016 通关 第三章-SVM 作业分析

作业内容,完成作业便可熟悉如下内容: cell 1 设置绘图默认参数 # Run some setup code for this notebook. import random import nu ...

- CS231n 2016 通关 第三章-SVM与Softmax

1===本节课对应视频内容的第三讲,对应PPT是Lecture3 2===本节课的收获 ===熟悉SVM及其多分类问题 ===熟悉softmax分类问题 ===了解优化思想 由上节课即KNN的分析步骤 ...

- CS231n 2016 通关 第五、六章 Fully-Connected Neural Nets 作业

要求:实现任意层数的NN. 每一层结构包含: 1.前向传播和反向传播函数:2.每一层计算的相关数值 cell 1 依旧是显示的初始设置 # As usual, a bit of setup impor ...

- CS231n 2016 通关 第五、六章 Dropout 作业

Dropout的作用: cell 1 - cell 2 依旧 cell 3 Dropout层的前向传播 核心代码: train 时: if mode == 'train': ############ ...

- CS231n 2016 通关 第五、六章 Batch Normalization 作业

BN层在实际中应用广泛. 上一次总结了使得训练变得简单的方法,比如SGD+momentum RMSProp Adam,BN是另外的方法. cell 1 依旧是初始化设置 cell 2 读取cifar- ...

随机推荐

- WEB消息推送-comet4j

一.comet简介: comet :基于 HTTP长连接的“服务器推”技术,是一种新的 Web 应用架构.基于这种架构开发的应用中,服务器端会主动以异步的方式向客户端程序推送数据,而不需要客户端显式的 ...

- 最新精品 强势来袭 XP,32/64位Win7,32/64位Win10系统【电脑城版】

随着Windows 10Build 10074 Insider Preview版发布,有理由相信,Win10离最终RTM阶段已经不远了.看来稍早前传闻的合作伙伴透露微软将在7月底正式发布Win10的消 ...

- android Bluetooth-蓝牙

bluetooth 一.开启蓝牙 1.获取BluetoothAdapter BluetoothAdapter.getDefaultAdapter() 2.判断手机设备是否 有蓝牙模块 3.开启蓝牙设备 ...

- Java 基础系列之volatile变量(一)

一.锁 两种特性:互斥性(mutual exclusion).可见性(visibility).原子性(atomic) 互斥性就是一次只有一个线程可以访问该共享数据,可见性就是释放锁之前,对共享数据的修 ...

- AWK命令使用

前言 文本处理三剑客中,grep强在文本查找,sed强在文本处理,现awk强在文本查找后的输出处理.awk可以在处理文本的过程中使用编程结构(变量.条件判断.循环)以及其内置的变量,这就是它强大的地方 ...

- win10+UEFI下u盘安装ubuntu16.04

本人电脑是华硕,由于要求使用linux所以安装: 1.首先给linux划出一个大分区,感觉最少50G: win10下磁盘管理,在最后的分区中压缩出50g,空间,其他的不用问了,也不用继续分区,一个大的 ...

- Grasswire"草根连线":Pinterest图片流+Reddit众包新闻门户

移动互联网技术对新闻媒体行业带来的变化是惊人的. 从专业的综合门户到维基.博客.微博.自媒体,新闻越来越散户化,众包化,也更具实时性和社交属性. Grasswire:姑且翻译为"草根连线&q ...

- DAICO模式到底是什么?

自从V神提出DAICO以来,已经有项目围绕DAICO模式落地,但是DAICO到底是什么呢? 所谓DAIC0,其实就是DAO+IC0. DAO是DistributedAutonomous Organiz ...

- Android Weekly Notes Issue #257

Android Weekly Issue #257 May 14th, 2017 Android Weekly Issue #257 本期内容包括: Gradle中关于项目的一些设置; Android ...

- 架构设计:系统间通信(34)——被神化的ESB(上)

1.概述 从本篇文章开始,我们将花一到两篇的篇幅介绍ESB(企业服务总线)技术的基本概念,为读者们理清多个和ESB技术有关名词.我们还将在其中为读者阐述什么情况下应该使用ESB技术.接下来,为了加深读 ...