Hadoop学习------Hadoop安装方式之(一):单机部署

Hadoop 默认模式为单机(非分布式模式),无需进行其他配置即可运行。非分布式即单 Java 进程,方便进行调试。

1、创建用户

1.1创建hadoop用户组和用户

一般我们不会经常使用root用户运行hadoop,所以需要创建一个平常运行和管理hadoop的用户;

有2种方式,选择任意一种即可

方法1:先创建hadoop用户组 (不同Linux系统命令不同)

sudo groupadd(或者addgroup) hadoop

再创建hadoop用户

sudo useradd(或者 adduser) –g hadoop hadoop

前一个hadoop是用户组,后一个hadoop是用户

修改 hadoop用户的密码

passwd hadoop

方法2:先创建hadoop 用户

sudo useradd(或者 adduser)

passwd hadoop

在创建hadoop用户的同时也创建了hadoop用户组,下面我们把hadoop用户加入到hadoop用户组输入

sudo usermod -a -G hadoop hadoop

1.2给hadoop用户赋予root权限

vi /etc/sudoers

在文件中找到一行文字如下:

# User privilege specification

root ALL=(ALL) ALL

在root下面加上一行

hadoop ALL=(ALL) ALL

然后 保存退出,这样hadoop用户就有了root权限。

2 安装JDK并配置好环境变量

这里不再过多说明,详情见 Linux系统上安装、卸载JAVA、TOMCAT的方法

3 修改机器名

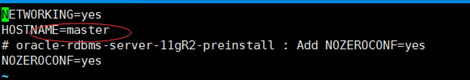

进入/etc/sysconfig/network (ubuntu系统修要修改/etc/hostname)

vi /etc/sysconfig/network 修改主机名为master

4.安装SSH 服务,建立SSH无密码登录本机

4.1 如果本机没有安装SSH

sudo apt-get install ssh

4.2设置本机无密码登录

具体步骤如下:

第一步:产生密钥

$ ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

第二部:导入authorized_keys

$ cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

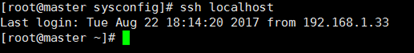

第二部导入的目的是为了无密码等,这样输入如下命令:

ssh localhost 无需密码直接进入

5安装Hadoop

5.1从官网下载Hadoop最新版2.7.0

进入到 /usr/loca cd /usr/local

wget http://mirror.bit.edu.cn/apache/hadoop/common/hadoop-2.7.0/hadoop-2.7.0.tar.gz

然后解压缩 tar zxvf /root/hadoop-2.7.0.tar.gz

然后将解压后的文件重命名为hadoop mv hadoop-2.7.0 hadoop

5.2设置环境变量

vi /etc/profile

找到PATH 在最后面添加 :/usr/local/hadoop/bin 或者

export PATH=/usr/local/hadoop-2.7.0/bin:$PATH

使配置生效 source /etc/profile

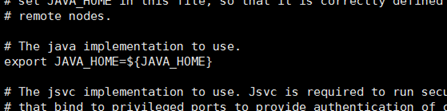

设置Hadoop的JAVA_HOME

cd /usr/local/hadoop

vi etc/hadoop/hadoop-env.sh

找到#export JAVA_HOME=...,去掉#,然后加上本机jdk的路径

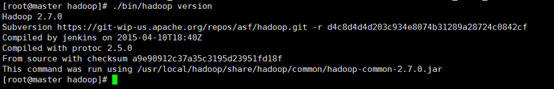

5.3测试是否安装成功 单机模式

cd /usr/local/hadoop

./bin/hadoop version 可以查看hadoop版本信息

现在我们可以执行一些例子来感受下 Hadoop 的运行。Hadoop 附带了丰富的例子(运行 ./bin/hadoop jar ./share/hadoo/mapreduce/hadoop-mapreduce-examples-2.6.0.jar 可以看到所有例子),包括 wordcount、terasort、join、grep 等。

在此我们选择运行 grep 例子,我们将 input 文件夹中的所有文件作为输入,筛选当中符合正则表达式 dfs[a-z.]+ 的单词并统计出现的次数,最后输出结果到 output 文件夹中。

cd /usr/local/hadoop

mkdir ./input 创建目录

cp ./etc/hadoop/*.xml ./input # 将配置文件作为输入文件

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar grep ./input ./output 'dfs[a-z.]+'

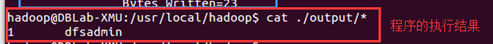

然后我们可以查看运行结果 cat ./output/*

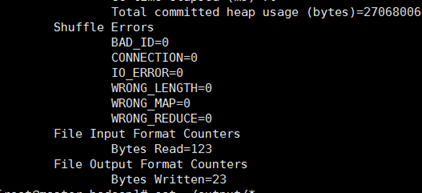

执行成功后如下所示,输出了作业的相关信息,输出的结果是符合正则的单词 dfsadmin 出现了1次

注意,Hadoop 默认不会覆盖结果文件,因此再次运行上面实例会提示出错,需要先将 ./output 删除。 rm -r ./output

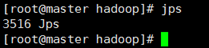

cd /usr/local/hadoop jps

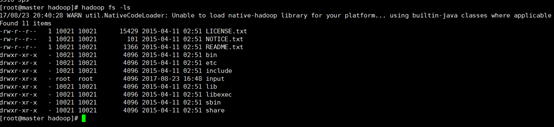

执行 hadoop fs –ls

至此 单机模式已经部署完成。

Hadoop学习------Hadoop安装方式之(一):单机部署的更多相关文章

- Hadoop学习------Hadoop安装方式之(二):伪分布部署

要想发挥Hadoop分布式.并行处理的优势,还须以分布式模式来部署运行Hadoop.单机模式是指Hadoop在单个节点上以单个进程的方式运行,伪分布模式是指在单个节点上运行NameNode.DataN ...

- Hadoop学习------Hadoop安装方式之(三):分布式部署

这里为了方便直接将单机部署过的虚拟机直接克隆,当然也可以不这样做,一个个手工部署. 创建完整克隆——>下一步——>安装位置.等待一段时间即可. 我这边用了三台虚拟机,分别起名master, ...

- Hadoop学习笔记——安装Hadoop

sudo mv /home/common/下载/hadoop-2.7.2.tar.gz /usr/local sudo tar -xzvf hadoop-2.7.2.tar.gz sudo mv ha ...

- Hadoop学习---Hadoop的深入学习

Hadoop生态圈 存储数据HDFS(Hadoop Distributed File System),运行在通用硬件上的分布式文件系统.具有高度容错性.高吞吐量的的特点. 处理数据MapReduce, ...

- hadoop学习;安装jdk,workstation虚拟机v2v迁移;虚拟机之间和跨物理机之间ping网络通信;virtualbox的centos中关闭防火墙和检查服务启动

JDK 在Ubuntu下的安装 与 环境变量的配置 前期准备工作: 找到 JDK 和 配置TXT文件 并拷贝到桌面下 不是目录 而是文件拷贝到桌面下 以下的命令部分就直接复制粘贴就能够了 1.配 ...

- Hadoop学习-hdfs安装及其一些操作

hdfs:分布式文件系统 有目录结构,顶层目录是: /,存的是文件,把文件存入hdfs后,会把这个文件进行切块并且进行备份,切块大小和备份的数量有客户决定. 存文件的叫datanode,记录文件的切 ...

- Hadoop学习---Hadoop的HBase的学习

Hbase Hbase的特点: Hbase是bigtable的开源的仿制版本 建立在HDFS之上 可靠性,靠性能 大:一个表可以有上亿行,上百万列 面向列:面向列(族)的存储和权限控制,列(族)独立检 ...

- Hadoop学习---Hadoop的MapReduce的原理

MapReduce的原理 MapReduce的原理 NameNode:存放文件的元数据信息 DataNode:存放文件的具体内容 ResourceManager:资源管理,管理内存.CPU等 Node ...

- Hadoop2-认识Hadoop大数据处理架构-单机部署

一.Hadoop原理介绍 1.请参考原理篇:Hadoop1-认识Hadoop大数据处理架构 二.centos7单机部署hadoop 前期准备 1.创建用户 [root@web3 ~]# useradd ...

随机推荐

- Delphi【异常捕获以及Exe调用方法方法】

通过测试.exe程序调用dll外部方法,通过dll调用主程序.exe方法实现. Showmessage('进入方法?这里是dll里LoginElecReq'); try ShellExecute( ...

- python两个列表合并为字典,一个作为key,一个作为value

两个列表合并为一个字典函数list_dic(list1,list2)可以直接复制拿走 传入的参数为两个列表,list1准备作为key,list2准备作为value,key和value位置一一对应. d ...

- C#高级编程(第九版) 知识点梳理

---恢复内容开始--- 第二章 核心C# 2.7 命名空间可以使用别名,但是这样做有什么好处? 2.12 C#预处理器指令 #define DEBUG #if DEBUG Console.Write ...

- Adobe Photoshop安装

Photoshop cc2018安装 Adobe 软件套装已不再以 (Creative Suite) CS命名,而是改成 (Creative Cloud) CC,主推云服务!Adobe CC 套装中总 ...

- vue2 作用域插槽slot-scope详解

插槽分为单个插槽,具名插槽,还有作用域插槽,前两种比较简单这里就不赘述了,今天的重点是讨论作用域插槽. 简单来说,前两种插槽的内容和样式皆由父组件决定,也就是说显示什么内容和怎样显示都由父组件决定: ...

- python内置函数详细描述与实例演示

python有许多内置函数,列出表格如下 内置函数 abs() delattr() hash() memoryview() set() all() dict() help() min() setatt ...

- VS中无法打开Qt资源文件qrc

问题:双击项目中的qrc文件没反应. 解决方法: 网上搜索的方法说是要,右击->打开方式,添加qrceditor编辑器 但我的项目中Qt Resource Editor已经是默认的了. 那就是q ...

- Charles在Mac、iPhone、Android上抓http/https协议的包

1.我使用的版本是4.0.2,下载和破解网上方法很多,不做说明 2.Charles在Mac上抓http/https协议的包 2.1先把这三个都给装上,装完后会自动跳转到钥匙串中 2.2如果装完后提示证 ...

- SharePoint附加内容数据库时报错

今天遇到一个很奇怪的问题,在sharepoint管理中心中给web application添加内容数据库时报错:The SharePoint database named WSS Content al ...

- 使用HUI-admin过程中,返回上级页面并刷新

非常简单的js self.location=document.referrer;