基于scrapy源码实现的自定义微型异步爬虫框架

一、scrapy原理

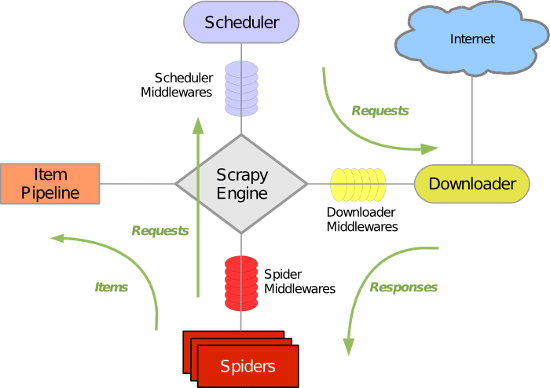

Scrapy 使用了 Twisted异步网络库来处理网络通讯。整体架构大致如下

Scrapy主要包括了以下组件:

- 引擎(Scrapy)

用来处理整个系统的数据流处理, 触发事务(框架核心) - 调度器(Scheduler)

用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL(抓取网页的网址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址 - 下载器(Downloader)

用于下载网页内容, 并将网页内容返回给蜘蛛(Scrapy下载器是建立在twisted这个高效的异步模型上的) - 爬虫(Spiders)

爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。用户也可以从中提取出链接,让Scrapy继续抓取下一个页面 - 项目管道(Pipeline)

负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。 - 下载器中间件(Downloader Middlewares)

位于Scrapy引擎和下载器之间的框架,主要是处理Scrapy引擎与下载器之间的请求及响应。 - 爬虫中间件(Spider Middlewares)

介于Scrapy引擎和爬虫之间的框架,主要工作是处理蜘蛛的响应输入和请求输出。 - 调度中间件(Scheduler Middewares)

介于Scrapy引擎和调度之间的中间件,从Scrapy引擎发送到调度的请求和响应。

Scrapy运行流程大概如下:

- 引擎从调度器中取出一个链接(URL)用于接下来的抓取

- 引擎把URL封装成一个请求(Request)传给下载器

- 下载器把资源下载下来,并封装成应答包(Response)

- 爬虫解析Response

- 解析出实体(Item),则交给实体管道进行进一步的处理

- 解析出的是链接(URL),则把URL交给调度器等待抓取

二、自定义scrapy框架

所用到的三个对象:

getpage:内封装socket对象,帮下载url的html页面,可自动回调

defer:内包装socket对象,不调用,所以不会自己回调,需手动终止,用于整个爬虫的任务终止

reactor:封装io多路复用,开启循环

通过DeferredList控制所有爬虫任务,结束时stop终止reactor的监听

运行流程大概如下:

1.crawl将spider中的start_requests中返回的的起始url生成器转化为迭代器,将请求添加到调度器。

2.通过reactor调用_next_request方法,即从调度器取出request对象并发送请求

3.页面下载完成,回调get_response_callback,调用用户spider中定义的parse方法,如果parse有yield request对象,将新请求添加到调度器。

如未达到最大并发数,可以再去调度器中获取Request。

4.当调度器的request对象没有了,即是爬虫任务结束,此时可关闭Deferred和reactor。

代码如下:

from twisted.internet import defer

from twisted.internet import reactor

from twisted.web.client import getPage class Request(object):

def __init__(self, url, callback):

self.url = url

self.callback = callback class HttpResponse(object): def __init__(self,content,request):

self.content = content

self.request = request

self.url = request.url

self.text = str(content,encoding='utf-8') class ChoutiSpider(object):

name = "chouti" def start_requests(self):

start_urls = ['http://dig.chouti.com']

for url in start_urls:

yield Request(url, callback=self.parse) def parse(self, response):

# yield Request("http://cn.bing.com",callback=self.parse)

print(response) import queue Q = queue.Queue() class Engine(object):

def __init__(self):

self._close = None

self.max = 5

self.crawling = [] def get_response_callback(self,content,request):

self.crawling.remove(request)

rep = HttpResponse(content, request)

result = request.callback(rep) #调用parse方法 如果parse中有yield 则result是一个生成器

import types

if isinstance(result, types.GeneratorType):

for req in result:

Q.put(req) def _next_request(self):

#取request对象,并发送请求

if Q.qsize() == 0 and len(self.crawling) == 0:

self._close.callback(None)

return if len(self.crawling) >= self.max:

return while len(self.crawling) < self.max:

try:

req = Q.get(block=False)

self.crawling.append(req)

d = getPage(req.url.encode("utf-8"))

# 页面下载完成,get_response_callback,调用用户spider中定义的parse方法,并且将新请求添加到调度器

d.addCallback(self.get_response_callback, req)

# 未达到最大并发数,可以再去调度器中获取Request

d.addCallback(lambda _: reactor.callLater(0, self._next_request))

except Exception as e:

return @defer.inlineCallbacks

def crawl(self, spider):

start_requests = iter(spider.start_requests())

#将请求添加到调度器

while True:

try:

request = next(start_requests)

Q.put(request)

except StopIteration as e:

break # 去调度器中取request,并发送请求

# self._next_request()

reactor.callLater(0, self._next_request) self._close = defer.Deferred()

yield self._close spider = ChoutiSpider()

_active = set()

engine = Engine()

d = engine.crawl(spider) _active.add(d)

dd = defer.DeferredList(_active)

dd.addBoth(lambda a:reactor.stop()) reactor.run()

基于scrapy源码实现的自定义微型异步爬虫框架的更多相关文章

- MVC系列——MVC源码学习:打造自己的MVC框架(三:自定义路由规则)

前言:上篇介绍了下自己的MVC框架前两个版本,经过两天的整理,版本三基本已经完成,今天还是发出来供大家参考和学习.虽然微软的Routing功能已经非常强大,完全没有必要再“重复造轮子”了,但博主还是觉 ...

- Scrapy源码学习(一)

用Scrapy已经有一段时间了,觉得该是看一下源码的时候了.最开始用的时候还是0.16的版本,现在稳定版已经到了0.18.结合使用Scrapy的过程,先从Scrapy的命令行看起. 一.准备 下载源代 ...

- asp.net mvc源码分析-DefaultModelBinder 自定义的普通数据类型的绑定和验证

原文:asp.net mvc源码分析-DefaultModelBinder 自定义的普通数据类型的绑定和验证 在前面的文章中我们曾经涉及到ControllerActionInvoker类GetPara ...

- scrapy源码分析(转)

记录一下两个讲解scrapy源码的博客: 1.http://kaito-kidd.com/2016/11/21/scrapy-code-analyze-component-initialization ...

- 通过更改scrapy源码进行spider分发实现一个综合爬虫

最近我正写一个项目,项目的需求如下一,要爬取大约100种几百个网页的类容,并且这些网页的爬取频率不一样,有些一天爬取一次,有些一周爬取一次,二,网页爬取内容有变化,也就是说要爬取的内容会根据需求进行改 ...

- rest-framework源码解析和自定义组件----版本

版本 url中通过GET传参自定义的版本 12345678910111213141516171819202122 from django.http import HttpResponsefrom dj ...

- Spring源码-IOC部分-自定义IOC容器及Bean解析注册【4】

实验环境:spring-framework-5.0.2.jdk8.gradle4.3.1 Spring源码-IOC部分-容器简介[1] Spring源码-IOC部分-容器初始化过程[2] Spring ...

- MVC系列——MVC源码学习:打造自己的MVC框架(四:了解神奇的视图引擎)

前言:通过之前的三篇介绍,我们基本上完成了从请求发出到路由匹配.再到控制器的激活,再到Action的执行这些个过程.今天还是趁热打铁,将我们的View也来完善下,也让整个系列相对完整,博主不希望烂尾. ...

- MVC系列——MVC源码学习:打造自己的MVC框架(二:附源码)

前言:上篇介绍了下 MVC5 的核心原理,整篇文章比较偏理论,所以相对比较枯燥.今天就来根据上篇的理论一步一步进行实践,通过自己写的一个简易MVC框架逐步理解,相信通过这一篇的实践,你会对MVC有一个 ...

随机推荐

- selenium的三种等待方式

selenium有三种等待方式 1.time.sleep() 设置等待最简单的方法就是强制等待,但一般不建议使用,可以在调试的时候进行使用 2.隐性等待 driver.implictily_wait( ...

- EditPlus软件自动补全文档htmlbar.acp设置 及 模板文件格式

1.在htmlbar.acp文件末尾添加如下内容,可自动补全: #T=HTML <html> ^! </html> #T=HEAD <head> ^ ...

- gulp的使用(一)之gulp的基础了解

Gulp是一个工具.用于项目构建. Gulp简介: 多个开发者共同开发一个项目,每位开发者负责不同的模块,这就会造成一个完整的项目实际上是由许多的“代码版段”组成的: 使用less.sass等一些预处 ...

- 洛谷题解 P1315 【观光公交】

这道题很多人都用的模拟(或者暴力),今天我就写一个"标准"的贪心发给大家.(我这段代码差点超时···也差点超内存···) 主要思路:通过贪心求得最小值即可,把加速器用到乘客最多的两 ...

- Java学习笔记(2)

int 和 booleam 不能直接转换,如下语法是不能通过的: boolean b = true; int i = (int) b; int j = 1; boolean a = (boolean) ...

- Always an Integer 数论和字符串处理

题意:判断一个整系数多项式除以一个常数结果是否一定是一个整数 大白p123例题.可以随机代入一些n的值,判断一下.不过只要代入1到k+1(k为多项式最高项的次数)即可.通过数学归纳法证明,先讨论k为0 ...

- 实际操作中遇到的问题--Django中查看已安装的包的相关命令

pip freeze --------查看已经安装的包 pip uninstall 安装包名 ---------卸载已安装的包 pip install 安装包名--------安装包

- outlook2010设置失败后重新设置

1.WIN+R ,然后在弹出框中输入outlook /importprf .\.prf 2.重新设置.

- Ubuntu如何百度云盘下载

我使用Firefox浏览器下载. (1)先为浏览器下载一个插件:网盘助手 (2)通过终端安装aria2: sudo apt-get install python-apt sudo apt-get in ...

- sync.Pool的使用

一定要搞明白sync.Pool的正确用法,避免出现以下问题: kline := this.pool.Get() defer this.pool.Put(kline) kline.UnMarshal(d ...