Spark:java api读取hdfs目录下多个文件

需求:

由于一个大文件,在spark中加载性能比较差。于是把一个大文件拆分为多个小文件后上传到hdfs,然而在spark2.2下如何加载某个目录下多个文件呢?

public class SparkJob {

public static void main(String[] args) {

String filePath = args[0];

// initialize spark session

String appName = "Streaming-MRO-Load-Multiple-CSV-Files-Test";

SparkSession sparkSession = SparkHelper.getInstance().getAndConfigureSparkSession(appName);

// reader multiple csv files.

try {

Dataset<Row> rows = sparkSession.read().option("delimiter", "|").option("header", false)

.csv(filePath).toDF(getNCellSchema());

rows.show(10);

} catch (Exception ex) {

ex.printStackTrace();

}

try {

Dataset<String> rows = sparkSession.read().textFile(filePath);

rows.show(10);

} catch (Exception ex) {

ex.printStackTrace();

}

SparkHelper.getInstance().dispose();

}

private static Seq<String> getNCellSchema() {

List<String> ncellColumns = "m_id,m_eid,m_int_id,.....";

List<String> columns = new ArrayList<String>();

for (String column : ncellColumns) {

columns.add(column);

}

Seq<String> columnsSet = JavaConversions.asScalaBuffer(columns);

return columnsSet;

}

}

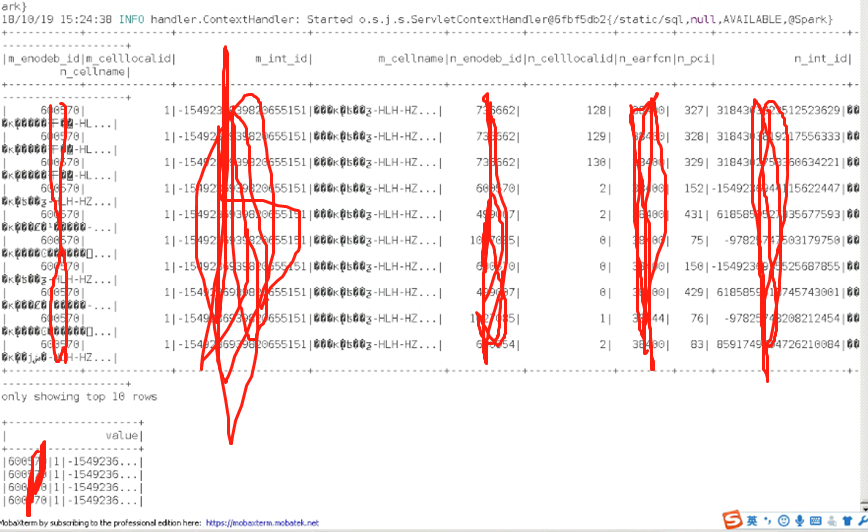

测试结果:

Spark:java api读取hdfs目录下多个文件的更多相关文章

- Java中读取某个目录下的所有文件和文件夹

import java.io.File; public class Test1 { public static void main(String[] args) { String path=" ...

- 使用JAVA API读取HDFS的文件数据出现乱码的解决方案

使用JAVA api读取HDFS文件乱码踩坑 想写一个读取HFDS上的部分文件数据做预览的接口,根据网上的博客实现后,发现有时读取信息会出现乱码,例如读取一个csv时,字符串之间被逗号分割 英文字符串 ...

- [转]读取assets目录下的数据库文件

在做Android应用的时候,不可避免要用到数据库.但是当我们把应用的apk部署到真机上的时候,已经创建好的数据库及其里边的数据是不能随着apk一起安装到真机上的. (PS:这篇博客解决了我前面博客中 ...

- java获取ubuntu某个目录下的所有文件信息

java获取ubuntu某个目录下的所有文件信息 public List<VCFile> getAllFiles(String basicDirName) { List<VCFile ...

- Python读取指定目录下指定后缀文件并保存为docx

最近有个奇葩要求 要项目中的N行代码 申请专利啥的 然后作为程序员当然不能复制粘贴 用代码解决.. 使用python-docx读写docx文件 环境使用python3.6.0 首先pip安装pytho ...

- 遍历并读取指定目录下的所有文件内容,写入Map集合然后输出在控制台和本地文件

public class FileWrite { public static void main(String[] args) throws Exception { //封装数据源目录 File sr ...

- Python读取一个目录下的所有文件

#!/usr/bin/python # -*- coding:utf8 -*- import os allFileNum = 0 def printPath(level, path): global ...

- Java API 读取HDFS的单文件

HDFS上的单文件: -bash-3.2$ hadoop fs -ls /user/pms/ouyangyewei/data/input/combineorder/repeat_rec_categor ...

- java 实现读取某个目录下指定类型的文件

我这里是读取txt类型的文件,在指定的目录下有不同类型的文件 实现代码,读取txt类型的文件并打印出该文件的绝对路径 package com.SBgong.test; import java.io.F ...

随机推荐

- AlexNet

AlexNet学习笔记 目录 AlexNet整体结构 CNN 全连接 TensorFlow实现 AlexNet是2012年ImageNet竞赛冠军获得者Hinton和他的学生Alex Krizhevs ...

- 并发之线程封闭与ThreadLocal解析

并发之线程封闭与ThreadLocal解析 什么是线程封闭 实现一个好的并发并非易事,最好的并发代码就是尽量避免并发.而避免并发的最好办法就是线程封闭,那什么是线程封闭呢? 线程封闭(thread c ...

- MVC开发中的常见错误-05-无法将类型“System.Data.Entity.Infrastructure.DbQuery<BBFJ.OA.Model.RoleInfo>”转换为“System.Collections.Generic.List<BBFJ.OA.Model.RoleInfo>”

List<RoleInfo> roleInfoList = (List<RoleInfo>)ViewBag.AllRoles; 错误原因很明确了 ViewBag.AllRole ...

- Ubuntu 安装 OpenMPI

1. 下载OpenMPI 在官网上下载最新版本的安装包,如:openmpi-1.8.4.tar.gz 2. 解压并进行配置 tar -zxvf openmpi-3.0.0.tar.gz cd open ...

- Jedis入门

一:介绍 1.Jedis的官网 2.使用 这个可以从上面的连接进入github. https://github.com/xetorthio/jedis 3.使用方式 或者使用jar包,不过这里我使用官 ...

- java中函数传值和传地址的问题

记录一下这个难过的双休,2019.3.16-2019.3.17,16号上午字节跳动笔试,四道题只做出1道半,输入输出搞的半死,第三题类似于leetcode上的分糖问题,数组初始化的时候全部赋为0了,要 ...

- P1799 数列_NOI导刊2010提高(06)

P1799 数列_NOI导刊2010提高(06)f[i][j]表示前i个数删去j个数得到的最大价值.if(i-j==x) f[i][j]=max(f[i][j],f[i-1][j]+1); else ...

- Python + Selenium操作一:截图详解

在做测试的时候,空口无凭都是白掐,特别是自动化测试的时候,更需要图片来佐证自己发现的问题 话不多说,直接进入主题,技术就是这么直白 Webdriver自带截图功能,get_screenshot_as_ ...

- 用js来实现那些数据结构01(数组篇01-数组的增删)

在开始正式的内容之前,不得不说说js中的数据类型和数据结构,以及一些比较容易让人混淆的概念.那么为什么要从数组说起?数组在js中是最常见的内存数据结构,数组数据结构在js中拥有很多的方法,很多初学者记 ...

- spring aop简单理解

aop原理是spring帮我们封装了动态代理,然后我们只管写具体的业务,我们将公共业务也写到具体的一个类中并实现spring为我们提供的对应要连接切入哪个位置的接口,然后再xml中配置它们的关系即可. ...