02.Scrapy-Demo

Scrapy入门实战

采集目标:采集西祠网的IP代理 包括 IP PORT

1. 新建项目

scrapy startproject xicidailiSpider

# scrapy 新建项目 项目名

2. 创建爬虫

scrapy genspider xicidaili xicidaili.com

# scrapy 产生爬虫 爬虫名字 网站域名

# 注意:爬虫名字一定不能与项目名字一致!

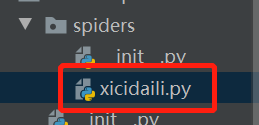

可以看到,在项目的spiders下得到了一个爬虫文件

解释爬虫文件

import scrapy # 导入scrapy

# 创建爬虫类 并且继承自scrapy.Spider --> 爬虫最基础的类

# 另外几个类都是继承自这个类

class XicidailiSpider(scrapy.Spider):

#爬虫名字 --> 必须唯一

name = 'xicidaili'

# 允许采集的域名

allowed_domains = ['xicidaili.com']

# 开始采集的网站

start_urls = ['http://xicidaili.com/']

# 解析响应数据 提取数据 或者网址等 response就是网页源码

def parse(self, response):

pass

3. 分析网址

提取数据

- 正则表达式(基础 必回 难掌握)

- XPath --> 从HTML中国提取数据语法

- CSS --> 从HTML中国提取数据语法

response.xpath("xpath语法").get()

get() 是得到一个元素

getall() 是多个元素

class XicidailiSpider(scrapy.Spider):

name = 'xicidaili'

allowed_domains = ['xicidaili.com']

start_urls = ['https://www.xicidaili.com/nn/']

# start_urls = [f'https://www.xicidaili.com/nn/{page}' for page in range(1,3685)] def parse(self, response):

# 提取数据

# response.xpath("//tr/td[2]/text()")

selectors = response.xpath("//tr")

for selector in selectors:

ip = selector.xpath("./td[2]/text()").get() # . 在当前节点下继续选择

port = selector.xpath("./td[3]/text()").get() # ip = selector.xpath("./td[2]/text()").extract_first() # 与get等价

# port = selector.xpath("./td[3]/text()").extract_first()

print(ip,port)

4. 运行爬虫

scrapy crawl 爬虫名字

# 翻页操作

next_page = response.xpath('//a[@class="next_page"]/@href').get()

if next_page:

print(next_page)

# 拼接网址

next_url = response.urljoin(next_page)

yield scrapy.Request(next_url,callback=self.parse) # yield 生成器

# Request() 发送请求 类似requests.get()

# callback 是回调函数 将发出去的请求得到的响应还交给自己(self.parse)处理

# 注意:回调函数不要写() 只写方法名字

02.Scrapy-Demo的更多相关文章

- c#&.NET3.0高级程序设计-02 Enum Demo

Enum 实例 using System; using System.Collections.Generic; public class MyClass { enum EmpType ...

- scrapy爬取58同城二手房问题与对策

测试环境: win10,单机爬取,scrapy1.5.0,python3.6.4,mongodb,Robo 3T 其他准备: 代理池:测试环境就没有用搭建的flask抓代理,因为我找到的几个免费网站有 ...

- 爬虫——scrapy框架

Scrapy是一个异步处理框架,是纯Python实现的爬虫框架,其架构清晰,模块之间的耦合程度低,可拓展性强,可以灵活完成各种需求.我们只需要定制几个模块就可以轻松实现一个爬虫. 1.架构 Scra ...

- 05 爬虫之scrapy

一 scrapy框架简介 01 什么是scrapy: Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架,非常出名,非常强悍.所谓的框架就是一个已经被集成了各种功能(高性能异步下载,队 ...

- py库: scrapy (深坑未填)

scrapy 一个快速高级的屏幕爬取及网页采集框架 http://scrapy.org/ 官网 https://docs.scrapy.org/en/latest/ Scrapy1.4文档 http: ...

- 萌新学习Python爬取B站弹幕+R语言分词demo说明

代码地址如下:http://www.demodashi.com/demo/11578.html 一.写在前面 之前在简书首页看到了Python爬虫的介绍,于是就想着爬取B站弹幕并绘制词云,因此有了这样 ...

- Scrapy 概览笔记

本项目代码可参考 imzhizi/myspider: a scrapy demo with elasticsearch 虚拟环境的创建 建议爬虫项目都创建虚拟环境 虚拟环境在 Python 项目中真的 ...

- Python Scrapy 实战

Python Scrapy 什么是爬虫? 网络爬虫(英语:web crawler),也叫网络蜘蛛(spider),是一种用来自动浏览万维网的网络机器人.其目的一般为编纂网络索引. Python 爬虫 ...

- Scrapy--1安装和运行

1.Scrapy安装问题 一开始是按照官方文档上直接用pip安装的,创建项目的时候并没有报错, 然而在运行 scrapy crawl dmoz 的时候错误百粗/(ㄒoㄒ)/~~比如: ImportEr ...

- python3高级编程

1. SMTP发送邮件 internet相关协议: http:网页访问相关,httplib,urllib,xmlrpclib ftp:文件传输相关, ftplib, urllib nntp:新闻和帖子 ...

随机推荐

- fastjson漏洞利用备忘

预备知识: 起rmi服务 用marshalsec-0.0.3-SNAPSHOT-all.jar起一个rmi服务. java -cp marshalsec-0.0.3-SNAPSHOT-all.jar ...

- Linux题目

1.删除某目录下所有文件,只保留指定文件. 例:假设/abc文件夹下有a1.a2....a10文件,保留a5和a6文件,其他全部删除 [root@localhost abc]# touch a{1.. ...

- jQuery-显示与隐藏

1.显示与隐藏 show([speed,easing,function]) speed:毫秒单位的时间值 hide([speed,easing,function]) 用法:元素.show()/元素.h ...

- maven工程打胖瘦jar包插件

<plugins> <plugin> <artifactId>maven-compiler-plugin</artifactId> <versio ...

- Java实现 LeetCode 787 K 站中转内最便宜的航班(两种DP)

787. K 站中转内最便宜的航班 有 n 个城市通过 m 个航班连接.每个航班都从城市 u 开始,以价格 w 抵达 v. 现在给定所有的城市和航班,以及出发城市 src 和目的地 dst,你的任务是 ...

- Java实现蓝桥杯有歧义的号码

描述 小Hi参加了一场大型马拉松运动会,他突然发现面前有一位参赛者背后的号码竟然和自己一样,也是666.仔细一看,原来那位参赛者把自己号码帖反(旋转180度)了,结果号码999看上去变成了号码666. ...

- Java实现 洛谷 P1424 小鱼的航程(改进版)

import java.util.Scanner; public class Main{ private static Scanner cin; public static int DISTENCE ...

- java实现第七届蓝桥杯平方圈怪

平方圈怪 题目描述 如果把一个正整数的每一位都平方后再求和,得到一个新的正整数. 对新产生的正整数再做同样的处理. 如此一来,你会发现,不管开始取的是什么数字, 最终如果不是落入1,就是落入同一个循环 ...

- MMDVM中继板测试软件MMDVMCal

运行方法: 只支持windows 64位系统 32位下载:https://share.weiyun.com/52uHAO5 64位下载:https://share.weiyun.com/5IgdqvL ...

- mysql基础之-mysql查询缓存(九)

0x01 MySQL查询缓存 用于保存MySQL查询语句返回的完整结果,被命中时,MySQL会立即返回结果,省去解析.优化和执行等操作 如何检查缓存?? MySQL保存结果与缓存中: 把select语 ...