试用最强Spark IDE--IDEA

1、安装IntelliJ IDEA

IDEA 全称 IntelliJ IDEA,是java语言开发的集成环境,IntelliJ在业界被公认为最好的java开发工具之一,尤其在智能代码助手、代码自动提示、重构、J2EE支持、Ant、JUnit、CVS整合、代码审查、创新的GUI设计等方面的功能可以说是超常的。IDEA是JetBrains公司的产品,这家公司总部位于捷克共和国的首都布拉格,开发人员以严谨著称的东欧程序员为主。

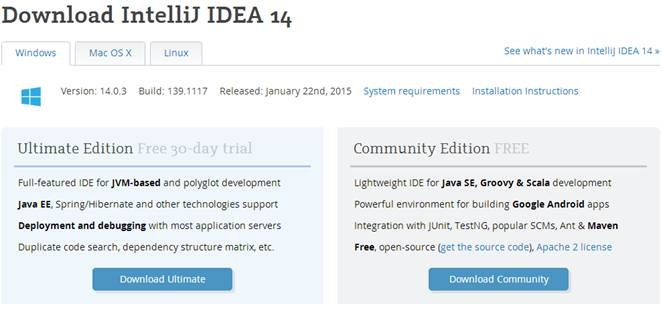

IDEA每个版本提供Community和Ultimate两个版本,如下图所示,其中Community是完全免费的,而Ultimate版本可以使用30天,过这段时间后需要收费。从安装后使用对比来看,下载一个Community版本足够了。

1.1 安装软件

1.1.1 下载IDEA安装文件

可以到Jetbrains官网http://www.jetbrains.com/idea/download/,选择最新的安装文件。由于以后的练习需要在Linux开发Scala应用程序,选择Linux系统IntelliJ IDEA14,如下图所示:

【注】在该系列配套资源的install目录下分别提供了ideaIC-14.0.2.tar.gz(社区版)和ideaIU-14.0.2.tar.gz(正式版)安装文件,对于Scala开发来说两个版本区别不大

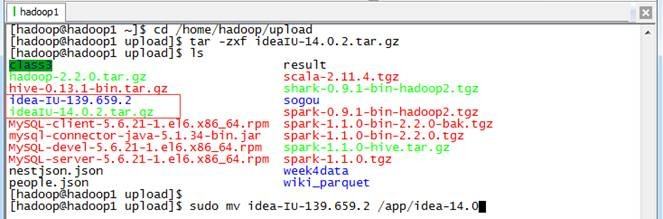

1.1.2 解压缩并移动目录

把下载的安装文件上传到目标机器,用如下命令解压缩IntelliJ IDEA安装文件,并迁移到/app目录下:

cd /home/hadoop/upload tar -zxf ideaIU-14.0.2.tar.gz sudo mv idea-IU-139.659.2 /app/idea-IU

1.1.3配置/etc/profile环境变量

使用如下命令打开/etc/profile文件:

sudo vi /etc/profile

确认JDK配置变量正确配置(参见第2节《Spark编译与部署》中关于基础环境搭建介绍):

export JAVA_HOME=/usr/lib/java/jdk1.7.0_55 export PATH=$PATH:$JAVA_HOME

1.2 配置Scala环境

1.2.1 启动IntelliJ IDEA

可以通过两种方式启动IntelliJ IDEA:

- 到IntelliJ IDEA安装所在目录下,进入bin目录双击idea.sh启动IntelliJ IDEA;

- 在命令行终端中,进入$IDEA_HOME/bin目录,输入./idea.sh进行启动

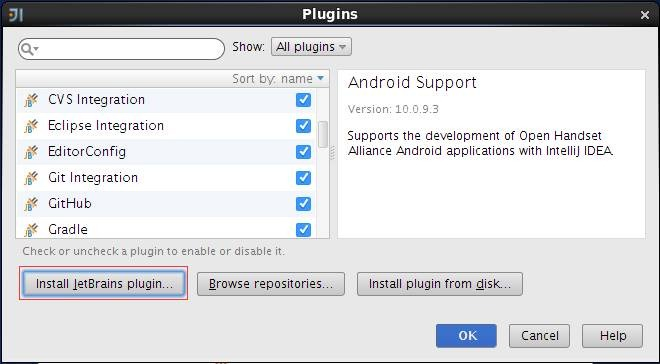

IDEA初始启动目录如下,IDEA默认情况下并没有安装Scala插件,需要手动进行安装,安装过程并不复杂,下面将演示如何进行安装。

1.2.2 下载Scala插件

参见上图,在启动界面上选择“Configure-->Plugins"选项,然后弹出插件管理界面,在该界面上列出了所有安装好的插件,由于Scala插件没有安装,需要点击”Install JetBrains plugins"进行安装,如下图所示:

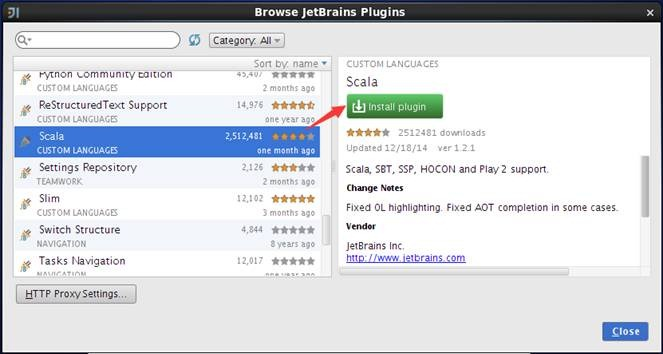

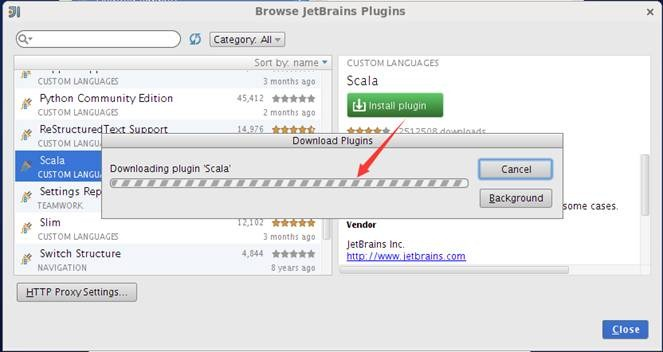

待安装的插件很多,可以通过查询或者字母顺序找到Scala插件,选择插件后在界面的右侧出现该插件的详细信息,点击绿色按钮"Install plugin”安装插件,如下图所示:

安装过程将出现安装进度界面,通过该界面了解插件安装进度,如下图所示:

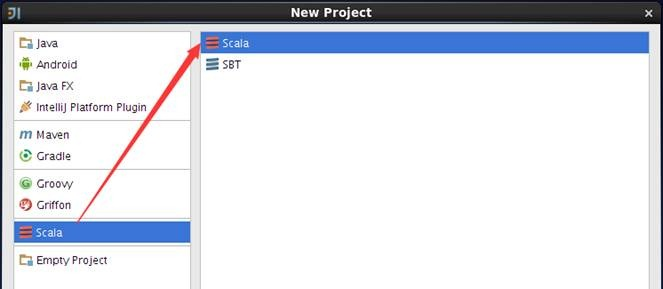

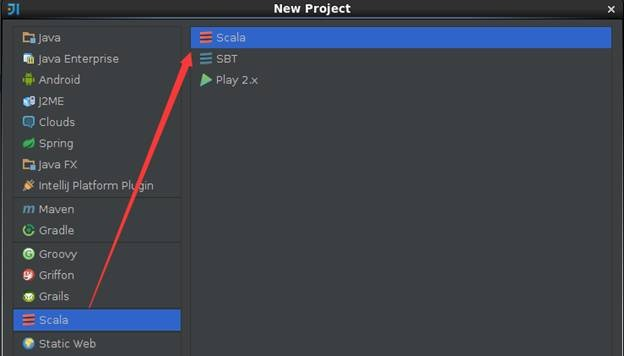

安装插件后,在启动界面中选择创建新项目,弹出的界面中将会出现"Scala"类型项目,选择后将出现提示创建的项目是仅Scala代码项目还是SBT代码项目,如下图所示:

1.2.3 设置界面主题

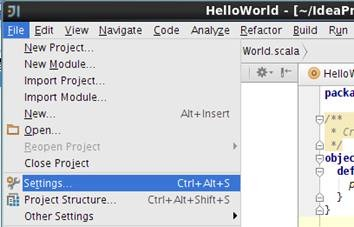

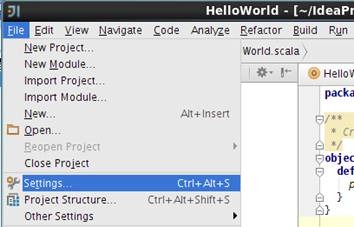

从IntelliJ IDEA12开始起推出了Darcula 主题的全新用户界面,该界面以黑色为主题风格得到很多开发人员的喜爱,下面我们将介绍如何进行配置。在主界面中选择File菜单,然后选择Setting子菜单,如下图所示:

在弹出的界面中选择Appearance &Behavior中Appearance,其中Theme中选择Darcula主题,如下图所示:

保存该主题重新进入,可以看到如下图样式的开发工具,是不是很酷!

2 使用IDEA编写例子

2.1 创建项目

2.1.1 设置项目基本信息

在IDEA菜单栏选择File->New Project,出现如下界面,选择创建Scala项目:

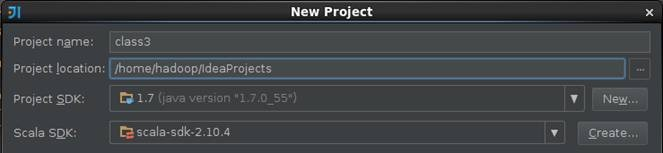

在项目的基本信息填写项目名称、项目所在位置、Project SDK和Scala SDK,在这里设置项目名称为class3,关于Scala SDK的安装参见第2节《Spark编译与部署》下Spark编译安装介绍:

2.1.2 设置Modules

创建该项目后,可以看到现在还没有源文件,只有一个存放源文件的目录src以及存放工程其他信息的杂项。通过双击src目录或者点击菜单上的项目结构图标打开项目配置界面,如下图所示:

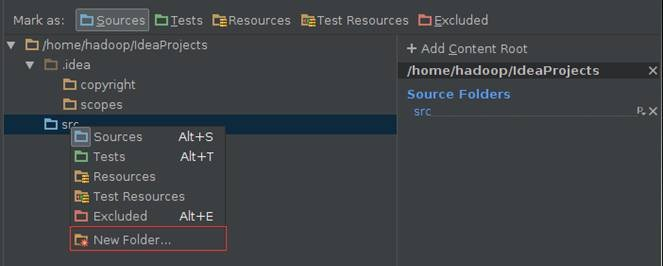

在Modules设置界面中,src点击右键选择“新加文件夹”添加src->main->scala目录:

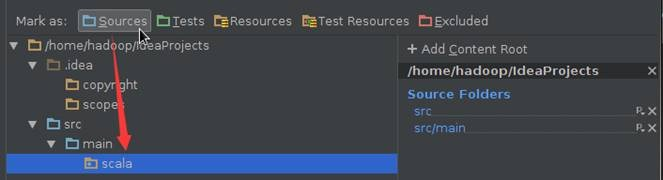

在Modules设置界面中,分别设置main->scala目录为Sources类型:

2.1.3 配置Library

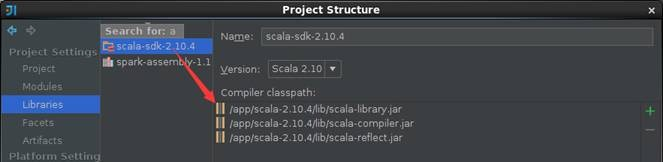

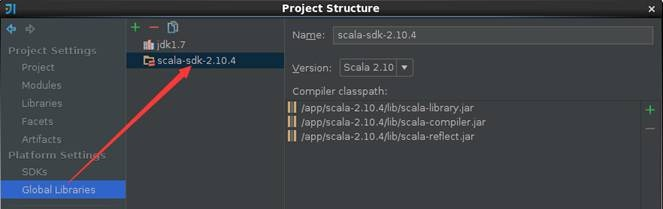

选择Library目录,添加Scala SDK Library,这里选择scala-2.10.4版本

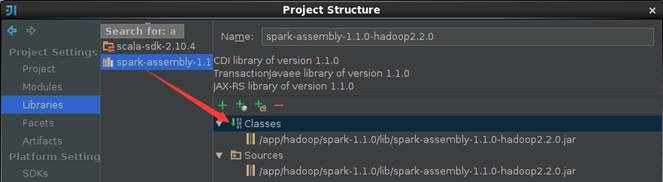

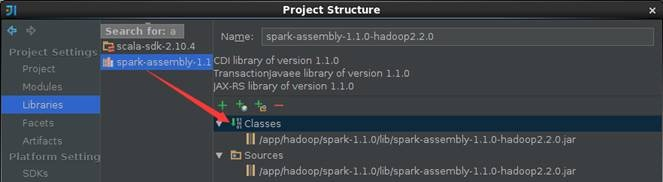

添加Java Library,这里选择的是在$SPARK_HOME/lib/spark-assembly-1.1.0-hadoop2.2.0.jar文件,添加完成的界面如下:

2.2 例子1:直接运行

《Spark编程模型(上)--概念及Shell试验》中使用Spark-Shell进行了搜狗日志的查询,在这里我们使用IDEA对Session查询次数排行榜进行重新练习,可以发现借助专业的开发工具可以方便快捷许多。

2.2.1 编写代码

在src->main->scala下创建class3包,在该包中添加SogouResult对象文件,具体代码如下:

1 package class3

2

3 import org.apache.spark.SparkContext._

4 import org.apache.spark.{SparkConf, SparkContext}

5

6 object SogouResult{

7 def main(args: Array[String]) {

8 if (args.length == 0) {

9 System.err.println("Usage: SogouResult <file1> <file2>")

10 System.exit(1)

11 }

12

13 val conf = new SparkConf().setAppName("SogouResult").setMaster("local")

14 val sc = new SparkContext(conf)

15

16 //session查询次数排行榜

17 val rdd1 = sc.textFile(args(0)).map(_.split("\t")).filter(_.length==6)

18 val rdd2=rdd1.map(x=>(x(1),1)).reduceByKey(_+_).map(x=>(x._2,x._1)).sortByKey(false).map(x=>(x._2,x._1))

19 rdd2.saveAsTextFile(args(1))

20 sc.stop()

21 }

22 }

2.2.2 编译代码

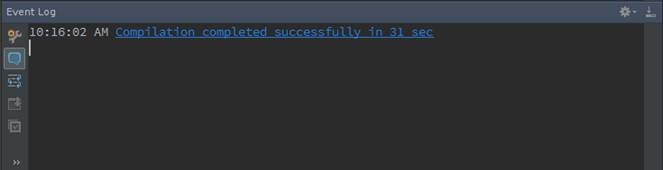

代码在运行之前需要进行编译,可以点击菜单Build->Make Project或者Ctrl+F9对代码进行编译,编译结果会在Event Log进行提示,如果出现异常可以根据提示进行修改

2.2.3 运行环境配置

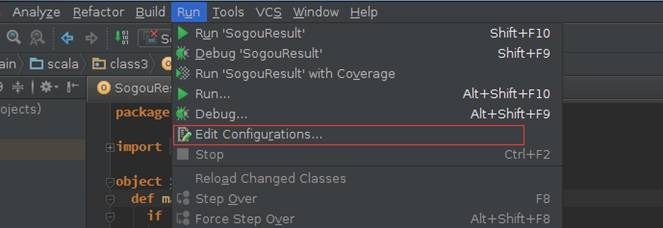

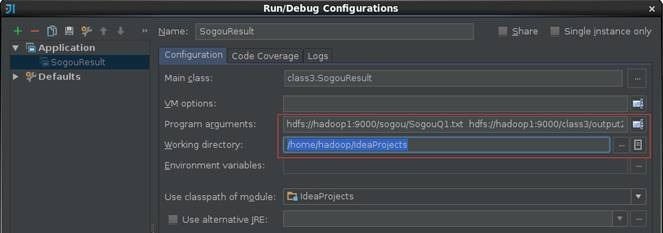

SogouResult首次运行或点击菜单Run->Edit Configurations打开"运行/调试 配置界面"

运行SogouResult时需要输入搜狗日志文件路径和输出结果路径两个参数,需要注意的是HDFS的路径参数路径需要全路径,否则运行会报错:

- 搜狗日志文件路径:使用上节上传的搜狗查询日志文件hdfs://hadoop1:9000/sogou/SogouQ1.txt

- 输出结果路径:hdfs://hadoop1:9000/class3/output2

2.2.4 运行结果查看

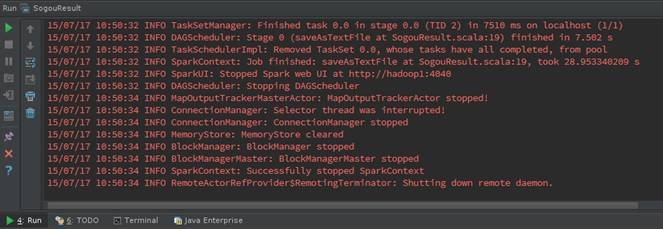

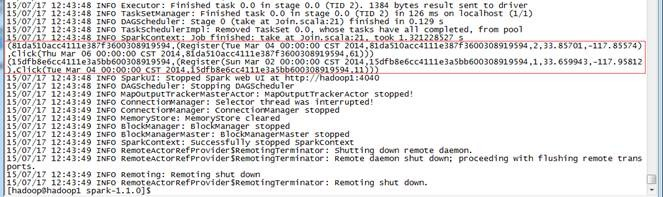

启动Spark集群,点击菜单Run->Run或者Shift+F10运行SogouResult,在运行结果窗口可以运行情况。当然了如果需要观察程序运行的详细过程,可以加入断点,使用调试模式根据程序运行过程。

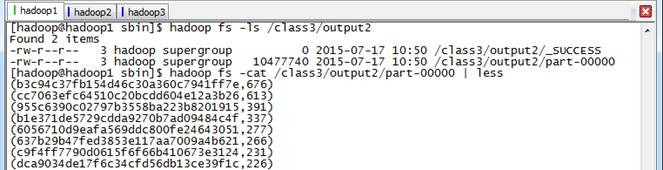

使用如下命令查看运行结果,该结果和上节运行的结果一致

hadoop fs -ls /class3/output2 hadoop fs -cat /class3/output2/part-00000 | less

2.3 例子2:打包运行

上个例子使用了IDEA直接运行结果,在该例子中将使用IDEA打包程序进行执行

2.3.1 编写代码

在class3包中添加Join对象文件,具体代码如下:

1 package class3

2

3 import org.apache.spark.SparkContext._

4 import org.apache.spark.{SparkConf, SparkContext}

5

6 object Join{

7 def main(args: Array[String]) {

8 if (args.length == 0) {

9 System.err.println("Usage: Join <file1> <file2>")

10 System.exit(1)

11 }

12

13 val conf = new SparkConf().setAppName("Join").setMaster("local")

14 val sc = new SparkContext(conf)

15

16 val format = new java.text.SimpleDateFormat("yyyy-MM-dd")

17 case class Register (d: java.util.Date, uuid: String, cust_id: String, lat: Float,lng: Float)

18 case class Click (d: java.util.Date, uuid: String, landing_page: Int)

19 val reg = sc.textFile(args(0)).map(_.split("\t")).map(r => (r(1), Register(format.parse(r(0)), r(1), r(2), r(3).toFloat, r(4).toFloat)))

20 val clk = sc.textFile(args(1)).map(_.split("\t")).map(c => (c(1), Click(format.parse(c(0)), c(1), c(2).trim.toInt)))

21 reg.join(clk).take(2).foreach(println)

22

23 sc.stop()

24 }

25 }

2.3.2 生成打包文件

第一步 配置打包信息

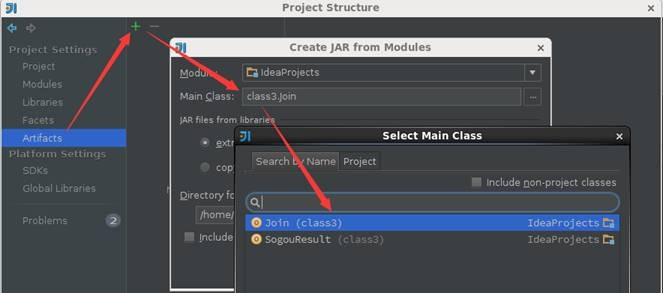

在项目结构界面中选择"Artifacts",在右边操作界面选择绿色"+"号,选择添加JAR包的"From modules with dependencies"方式,出现如下界面,在该界面中选择主函数入口为Join:

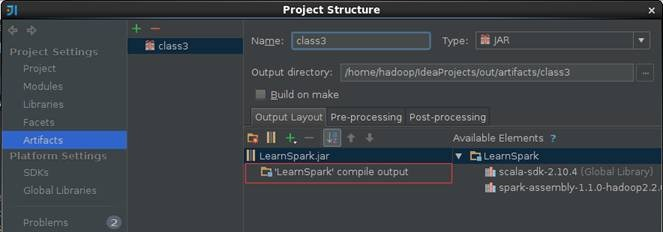

第二步 填写该JAR包名称和调整输出内容

【注意】的是默认情况下"Output Layout"会附带Scala相关的类包,由于运行环境已经有Scala相关类包,所以在这里去除这些包只保留项目的输出内容

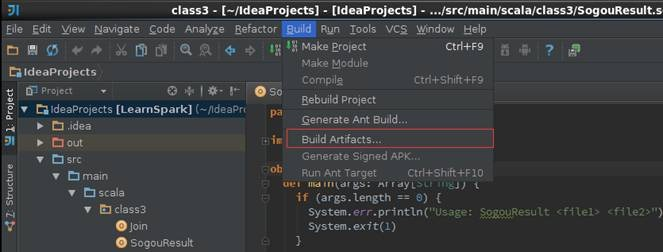

第三步 输出打包文件

点击菜单Build->Build Artifacts,弹出选择动作,选择Build或者Rebuild动作

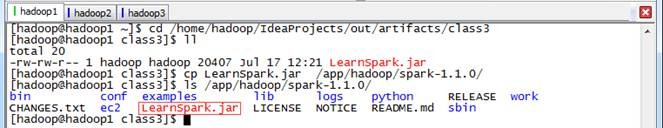

第四步 复制打包文件到Spark根目录下

cd /home/hadoop/IdeaProjects/out/artifacts/class3 cp LearnSpark.jar /app/hadoop/spark-1.1.0/ ls /app/hadoop/spark-1.1.0/

2.3.3 运行查看结果

通过如下命令调用打包中的Join方法,运行结果如下:

cd /app/hadoop/spark-1.1.0 bin/spark-submit --master spark://hadoop1:7077 --class class3.Join --executor-memory 1g LearnSpark.jar hdfs://hadoop1:9000/class3/join/reg.tsv hdfs://hadoop1:9000/class3/join/clk.tsv

3、问题解决

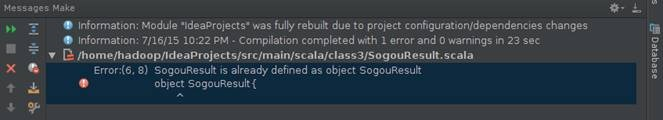

3.1 出现"*** is already defined as object ***"错误

编写好SogouResult后进行编译,出现"Sogou is already as object SogouResult"的错误,

出现这个错误很可能不是程序代码的问题,很可能是使用Scala JDK版本问题,作者在使用scala-2.11.4遇到该问题,换成scala-2.10.4后重新编译该问题得到解决,需要检查两个地方配置:Libraries和Global Libraries分别修改为scala-2.10.4

试用最强Spark IDE--IDEA的更多相关文章

- 安装配置最强Spark IDE--IDEA

1.安装IntelliJ IDEA IDEA 全称 IntelliJ IDEA,是java语言开发的集成环境,IntelliJ在业界被公认为最好的java开发工具之一,尤其在智能代码助手.代码自动提示 ...

- spark-3-macOS配置hadoop+spark+IDE

[教程1]https://blog.csdn.net/shiyutianming/article/details/99946797 + [教程2]http://dblab.xmu.edu.cn/bl ...

- 为宇宙第一强的IDE干一票

背景 在博客园看到很多人说.net在国内已死,很多人在为.net前途担忧,包括一些创业大佬也提及到这些问题,提及到客户指定了说使用php或者java. 那么基本可以确认了,.net 处于风雨漂泊的地位 ...

- Spark入门实战系列--1.Spark及其生态圈简介

[注]该系列文章以及使用到安装包/测试数据 可以在<倾情大奉送--Spark入门实战系列>获取 .简介 1.1 Spark简介 年6月进入Apache成为孵化项目,8个月后成为Apache ...

- Python 开发的 IDE 和代码编辑器,你选择的哪一个?

为了方便,我会分两个大类去说明,一类是适用于软件开发的比较通用的编辑器或 IDE ,我们可以通过插件等形式支持 Python 的开发,另一个是专注于 Python 开发的编辑器或 IDE . 不过在此 ...

- 宇宙最强VisualStudio2017配置pyQt5用于python3.6的UI界面工具(转)

宇宙最强VisualStudio2017配置pyQt5用于python3.6的UI界面工具 转载: https://blog.csdn.net/m0_37606112/article/details/ ...

- ubuntu下hadoop,spark配置

转载来自:http://www.cnblogs.com/spark-china/p/3941878.html 在VMWare 中准备第二.第三台运行Ubuntu系统的机器: 在VMWare中构建第 ...

- Spark之 spark简介、生态圈详解

来源:http://www.cnblogs.com/shishanyuan/p/4700615.html 1.简介 1.1 Spark简介Spark是加州大学伯克利分校AMP实验室(Algorithm ...

- spark生态圈简介

原文引自:http://www.cnblogs.com/shishanyuan/p/4700615.html 1.简介 1.1 Spark简介 Spark是加州大学伯克利分校AMP实验室(Algori ...

随机推荐

- php html5 文件上传 (原创)

今天自己写了一个HTML5+FileReader+php 的文件上传,ajax异步上传也支持 git 下载:git clone https://github.com/jiechengyang/HTML ...

- Docker(六):Docker网络配置进阶

1.Docker集群网络配置之Weave Weave是Github上一个比较热门的Docker容器网络方案,具有非常良好的易用性且功能强大.仓库地址:https://github.com/weavew ...

- lesson - 12 课程笔记

一.w 命令 作用: 用于显示已经登录系统的用户列表, 并显示用户正在执行的指令. 执行这个命令可得知目前登入系统的用户有哪些人, 以及他们正在执行的程序. 单独执行w 命令会显示所有的用户, 您也 ...

- 第五节 suid/ sgid /sbit /which /locate / find /stat / ln / uname -a

复习上节课内容(重点记录)1.chown -R 递归修改目录下包含子目录和子目录下的文件的属组2.chmod -R 递归修改目录下包含子目录和子目录下的文件的权限 ================== ...

- JavaScript的DOM编程--03--读写属性节点

读写属性节点: 1)可以直接通过 cityNode.id 这样的方式来获取和设置属性节点的值 2)通过元素节点的 getAttributeNode 方法来获取属性节点, 然后在通过 nodeValue ...

- 巧用php中的array_filter()函数去掉多维空值

一直一维array_filter() 函数只能去除一维数组,其实这个函数也能去除多维数组: $arr =[ '0'=>array(), '1'=>'false', '2'=>'tes ...

- amaze UI 笔记 - CSS

导航添加依据 http://amazeui.org/css/ 下面内容属学习笔记,如有理解偏差和错误请留言相告,感谢!* =(官网这块写的很详细) 一.基本样式 1.统一样式 说明了为什么使用Nor ...

- spring中Bean后置处理器实现总结

BeanPostProcessor接口 bean的后置处理器实现功能主要是 可以在bean初始化之前和之后做增强处理.自定义MyBeanProcessor实现BeanPostProcessor接口,重 ...

- SSM框架开发web项目系列(六) SpringMVC入门

前言 我们最初的javaSE部分学习后,基本算是入门了,也熟悉了Java的语法和一些常用API,然后再深入到数据库操作.WEB程序开发,渐渐会接触到JDBC.Servlet/Jsp之类的知识,期间可能 ...

- Android异常分析(转)

关于异常 异常? 异常就是一种程序中没有预料到的问题,既然是没有预料到的,就可能不在原有逻辑处理范围内,脱离了代码控制,软件可能会出现各种奇怪的现象.比如:android系统常见异常现象有应用无响应. ...