Hadoop(九)Hadoop IO之Compression和Codecs

前言

前面一篇介绍了Java怎么去查看数据块的相关信息和怎么去查看文件系统。我们只要知道怎么去查看就行了!接下来我分享的是Hadoop的I/O操作。

在Hadoop中为什么要去使用压缩(Compression)呢?接下来我们就知道了。

一、压缩(Compression)概述

1.1、压缩的好处

减少储存文件所需要的磁盘空间,并加速数据在网络和磁盘上的传输。这两个在大数据处理大龄数据时相当重要!

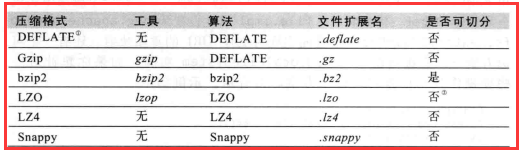

1.2、压缩格式总结

Hadoop对前面三种有默认集成,有就是说Hadoop支持DEFLATE、Gzip、bzip2三种压缩格式。而后面三种Hadoop没有支持,要用的话要自己去官网

下载相应的源码去编译加入到Hadoop才能用。

注意:

1)这里我要说的是“是否分割”,当我们一个文件去压缩即使有非常好的压缩算法,但是它的大小还是超过了一个数据块的大小,这时就涉及到分割了。

所以说在以后的压缩我们大多数情况下会使用bzip2。

2)Gzip和bzip2比较时,bzip2的压缩率(压缩之后的大小除以源文件的大小)要小,所以说bzip2的压缩效果好。而这里就会压缩和解压缩的时候浪费更多的时间。

就是我们常说的“用时间换取空间”。

二、编解码器(Codec)概述

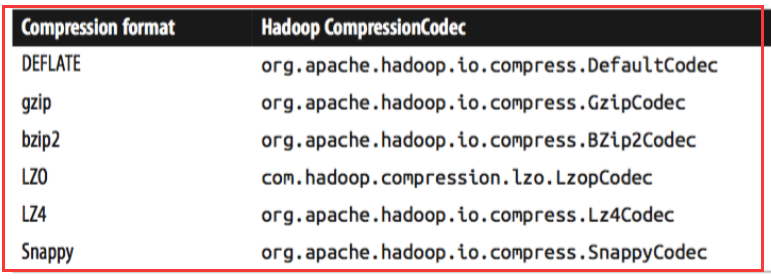

codec实现了一种压缩-加压缩算法(意思就是codec使用相关的算法对数据进行编解码)。在Hadoop中,一个对CompressionCodec接口的实现代表一个codec。

对于不同的压缩算法有不同的编解码器

我们要对一个文件进行压缩需要编码器,对一个压缩文件进行解压需要解码器。那我们怎么样去获取编解码器呢?

有两种方式:

一是:根据扩展名让程序自己去选择相应的编解码器。比如说:我在本地有一个文件是 user.txt我们通过-Dinput=user.txt去上传这个文件到集群,

在集群中我们把它指定到-Doutput=/user.txt.gz.。这是我们程序的相关的类会根据你的扩展名(这里是.gz)获取相应的压缩编解码器。

在Hadoop中有一个CompressionCodecFactory会根据扩展名获取相应的编解码器对象 。

二是:我们自己去指定编解码器。为什么要去指定呢?比如说,我在本地有一个文件是user.txt.gz,其实这个压缩文件是使用的是bzip2的压缩算法压缩的。

(因为我自己去更改了它的扩展名),所以这时候就要自己去指定编解码器。

三、Java编程实现文件的压缩与解压缩

3.1、原理分析

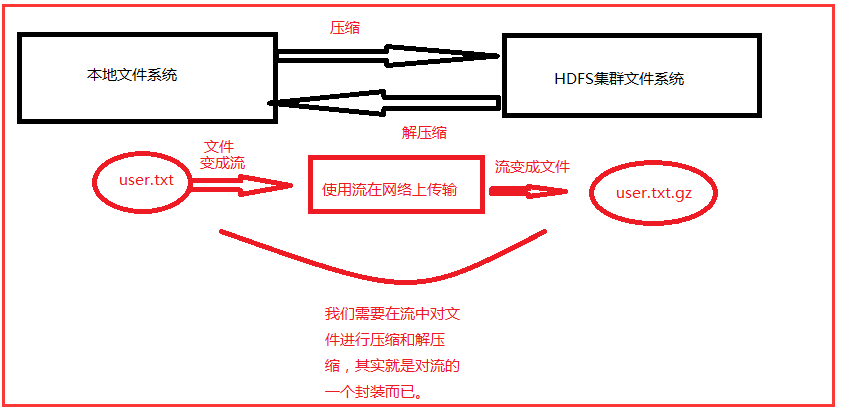

在我们把本地的文件上传的集群的时候,到底是哪里需要压缩,哪里需要解压缩,在哪里压缩?这都是需要明白,下面画一张图给大家理解:

3.2、相关类和方法

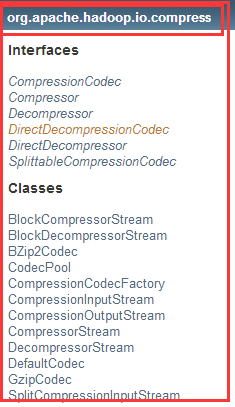

在Hadoop中关于压缩和解压缩的包、接口和类:

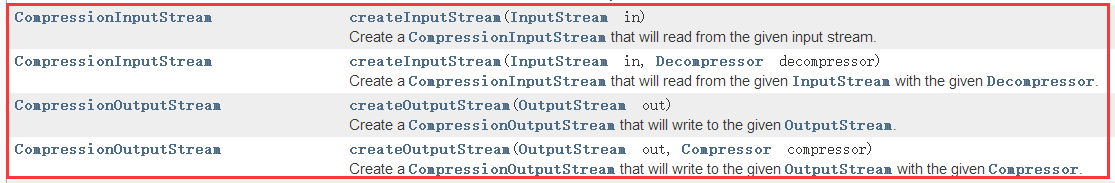

1)CompressionCodec接口中

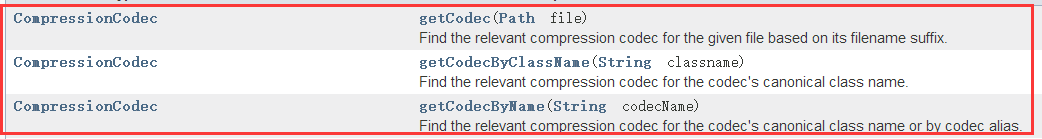

2)CompressionCodecFactory类

第一个是:根据文件的文件名后缀找到相应的压缩编解码器

第二个是:为编解码器的标准类名找到相关的压缩编解码器。

第三个是:为编解码器的标准类名或通过编解码器别名找到相关的压缩编解码器。

3.3、Java将本地文件压缩上传到集群当中

1)核心代码

import java.net.URI;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.LocalFileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.compress.BZip2Codec;

import org.apache.hadoop.io.compress.CompressionCodec;

import org.apache.hadoop.io.compress.CompressionCodecFactory;

import org.apache.hadoop.io.compress.CompressionOutputStream;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner; public class WriteDemo_0010

extends Configured implements Tool{

@Override

public int run(String[] args) throws Exception{

Configuration conf=getConf();

String input=conf.get("input");

String output=conf.get("output");

LocalFileSystem lfs=

FileSystem.getLocal(conf);

FileSystem rfs=

FileSystem.get(

URI.create(output),conf);

FSDataInputStream is=

lfs.open(new Path(input));

FSDataOutputStream os=

rfs.create(new Path(output)); CompressionCodecFactory ccf=

new CompressionCodecFactory(conf);

//把路径传进去,根据指定的后缀名获取编解码器

CompressionCodec codec=

ccf.getCodec(new Path(output));

CompressionOutputStream cos=

codec.createOutputStream(os);

System.out.println(

codec.getClass().getName()); IOUtils.copyBytes(is,cos,,true);

//close

return ;

} public static void main(String[] args) throws Exception{

System.exit(

ToolRunner.run(

new WriteDemo_0010(),args));

}

}

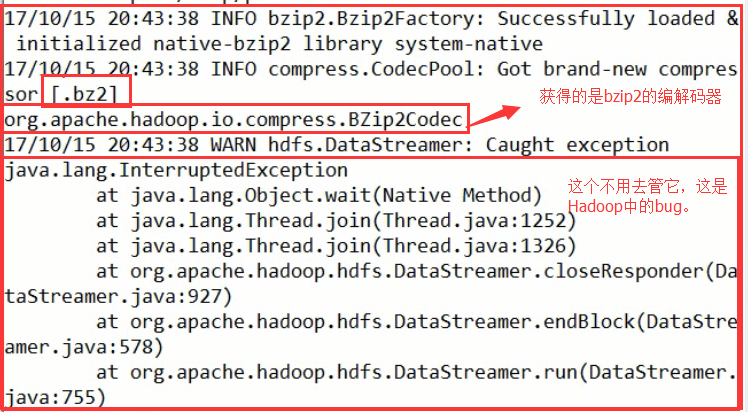

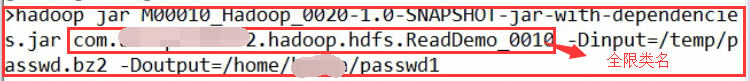

2)测试

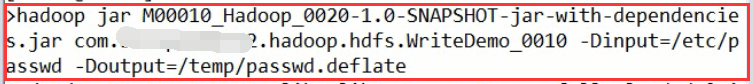

将IEDA中打好的jar包上传到Linux中(安装了HDFS集群的客户端的服务器中)执行:

结果:

我们可以从前面的那种表中可以看的出来,获取到了相应的编解码器。

再次测试:

结果:

3.4、Java将集群文件解压缩到本地

1)核心代码

import java.net.URI;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.LocalFileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.compress.CompressionCodec;

import org.apache.hadoop.io.compress.CompressionCodecFactory;

import org.apache.hadoop.io.compress.CompressionInputStream;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner; public class ReadDemo_0010

extends Configured

implements Tool{

@Override

public int run(String[] args) throws Exception{

Configuration conf=getConf();

String input=conf.get("input");

String output=conf.get("output");

FileSystem rfs=

FileSystem.get(

URI.create(input),conf);

LocalFileSystem lfs=

FileSystem.getLocal(conf); FSDataInputStream is=

rfs.open(new Path(input));

FSDataOutputStream os=

lfs.create(new Path(output)); CompressionCodecFactory factory=

new CompressionCodecFactory(conf);

CompressionCodec codec=

factory.getCodec(new Path(input));

CompressionInputStream cis=

codec.createInputStream(is); IOUtils.copyBytes(cis,os,1024,true);

return ;

} public static void main(String[] args) throws Exception{

System.exit(

ToolRunner.run(

new ReadDemo_0010(),args));

}

}

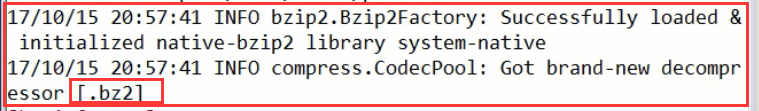

2)测试

结果:

查看结果:

喜欢就点个“推荐”哦!

Hadoop(九)Hadoop IO之Compression和Codecs的更多相关文章

- 【原创】大叔问题定位分享(16)spark写数据到hive外部表报错ClassCastException: org.apache.hadoop.hive.hbase.HiveHBaseTableOutputFormat cannot be cast to org.apache.hadoop.hive.ql.io.HiveOutputFormat

spark 2.1.1 spark在写数据到hive外部表(底层数据在hbase中)时会报错 Caused by: java.lang.ClassCastException: org.apache.h ...

- Hadoop基础-通过IO流操作HDFS

Hadoop基础-通过IO流操作HDFS 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 一.上传文件 /* @author :yinzhengjie Blog:http://www ...

- hive orc压缩数据异常java.lang.ClassCastException: org.apache.hadoop.io.Text cannot be cast to org.apache.hadoop.hive.ql.io.orc.OrcSerde$OrcSerdeRow

hive表在创建时候指定存储格式 STORED AS ORC tblproperties ('orc.compress'='SNAPPY'); 当insert数据到表时抛出异常 Caused by: ...

- hadoop基础----hadoop实战(九)-----hadoop管理工具---CDH的错误排查(持续更新)

在CDH安装完成后或者CDH使用过程中经常会有错误或者警报,需要我们去解决,积累如下: 解决红色警报 时钟偏差 这是因为我们的NTP服务不起作用导致的,几台机子之间有几秒钟的时间偏差. 这种情况下一是 ...

- 五十九.大数据、Hadoop 、 Hadoop安装与配置 、 HDFS

1.安装Hadoop 单机模式安装Hadoop 安装JAVA环境 设置环境变量,启动运行 1.1 环境准备 1)配置主机名为nn01,ip为192.168.1.21,配置yum源(系统源) 备 ...

- hadoop记录-Hadoop参数汇总

Hadoop参数汇总 linux参数 以下参数最好优化一下: 文件描述符ulimit -n 用户最大进程 nproc (hbase需要 hbse book) 关闭swap分区 设置合理的预读取缓冲区 ...

- [Hadoop 周边] Hadoop和大数据:60款顶级大数据开源工具(2015-10-27)【转】

说到处理大数据的工具,普通的开源解决方案(尤其是Apache Hadoop)堪称中流砥柱.弗雷斯特调研公司的分析师Mike Gualtieri最近预测,在接下来几年,“100%的大公司”会采用Hado ...

- hadoop之 hadoop 2.2.X 弃用的配置属性名称及其替换名称对照表

Deprecated Properties 弃用属性 The following table lists the configuration property names that are depr ...

- Hadoop: Hadoop Cluster配置文件

Hadoop配置文件 Hadoop的配置文件: 只读的默认配置文件:core-default.xml, hdfs-default.xml, yarn-default.xml 和 mapred-defa ...

随机推荐

- 【Alpha阶段】第一次Scrum Meeting!

每日任务 1.本次会议为第一次 Meeting会议: 2.本次会议在中午12:30,在第五社区5号楼楼下,召开本次会议为30分钟讨论接下来的任务: 一.今日站立式会议照片 二.每个人的工作 (有wor ...

- 团队作业4——第一次项目冲刺(Alpha版本)4th day

一.Daily Scrum Meeting照片 二.燃尽图 三.项目进展 计时功能已经完成,然后24点的代码如何在游戏界面与界面组件联系上正在进行. 四.困难与问题 1.在安卓框架与java代码的结合 ...

- 201521123052《Java程序设计》第5周学习总结

1. 本周学习总结 1.1 尝试使用思维导图总结有关多态与接口的知识点. 1.2 可选:使用常规方法总结其他上课内容. 学习了更多markdown的知识 参考资料: 百度脑图 XMind 2. 书面作 ...

- 201521123104《JAVA程序设计》第三周学习总结

1. 本周学习总结 2. 书面作业 Q1. 代码阅读 public class Test1 { private int i = 1;//这行不能修改 private static int j = 2; ...

- vue2.0动态绑定图片src属性值初始化时报错

在vue2.0中,经常会使用类似这样的语法 v-bind:src = " imgUrl "(缩写 :src = " imgUrl "),看一个案例 <te ...

- JVM菜鸟进阶高手之路十(基础知识开场白)

转载请注明原创出处,谢谢! 最近没有什么实战,准备把JVM知识梳理一遍,先以开发人员的交流来谈谈jvm这块的知识以及重要性,依稀记得2.3年前用solr的时候老是经常oom,提到oom大家应该都不陌生 ...

- (转)Unity3D中移动物体位置的几种方法

1. 简介 在unity3d中,有多种方式可以改变物体的坐标,实现移动的目的,其本质是每帧修改物体的position. 2. 通过Transform组件移动物体 Transform 组件用于描述物体在 ...

- [AHOI2004]奇怪的字符串

[AHOI2004]奇怪的字符串 题目描述 输入输出格式 输入格式: 输入文件中包含两个字符串X和Y.当中两字符串非0即1.序列长度均小于9999. 输出格式: X和Y的最长公共子序列长度. 输入输出 ...

- day20<IO流>

IO流(IO流概述及其分类) IO流(FileInputStream) IO流(read()方法返回值为什么是int) IO流(FileOutputStream) IO流(FileOutputStre ...

- GCD之信号量机制二

在前面GCD之信号量机制一中介绍了通过信号量设置并行最大线程数,依此信号量还可以防止多线程访问公有变量时数据有误,下面的代码能说明. 1.下面是不采用信号量修改公有变量的值 1 2 3 4 5 6 7 ...