【Python学习】request库

Requests库 (https://www.python-requests.org/) 是一个擅长处理那些复杂的 HTTP 请求、cookie、header(响应头和请求头)等内容的 Python 第三方库。

提交一个最基本的表单

大多数网页表单都是由一些HTML字段、一个提交按钮、一个在表单处理完之后跳转的“执行结果”(表单属性action的值)页面构成。

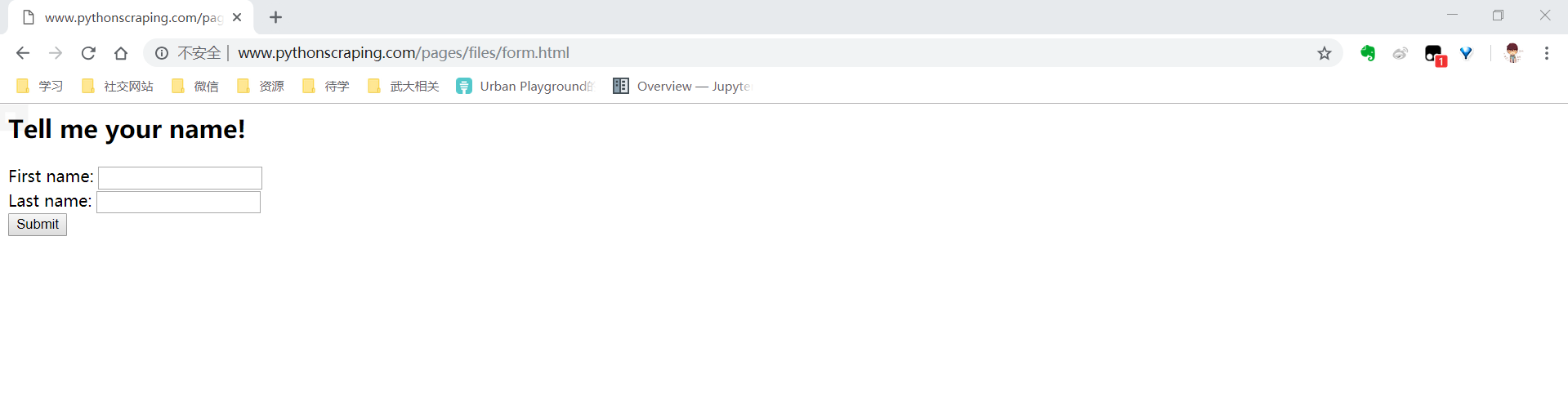

一个最简单的表单(http://www.pythonscraping.com/pages/files/form.html)

这个表单的源码在下面。可以通过chrome的开发者工具(F12)查看。

<form method="post" action="processing.php">

First name: <input type="text" name="firstname"><br>

Last name: <input type="text" name="lastname"><br>

<input type="submit" value="Submit" id="submit">

</form>

有几个要点:

- 两个要输入字段的名称是firstname和lastname。字段的名称决定了表单被确认后要被传送到服务器上的变量名称,要模拟表单提交数据的行为,就要保证变量名称与字段名称是一一对应的。

- 表单的真实行为其实发生在processing.php(绝对路径是http://www.pythonscraping.com/pages/files/processing.php)。表单的任何POST请求其实都发生在这个页面上,并非表单本身所在的页面。HTML表单的目的,知识帮助网站的访问者发送格式合理的请求,向服务器请求没有出现的页面。

那么提交这个最简单的表单,只要四行代码就可以了。

import requests

params = {'firstname': 'Ivy', 'lastname': 'Wong'}

r= requests.post("http://www.pythonscraping.com/pages/files/processing.php", data=params)

print(r.text)

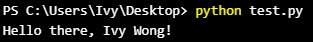

表单提交后,程序应该会返回执行页面的源代码,包括这行内容。

提交文件和图像

在http://www.pythonscraping.com/files/form2.html有一个文件上传表单,表单的源代码是下面这样的。

<form action="../pages/files/processing2.php" method="post" enctype="multipart/form-data">

Submit a jpg, png, or gif: <input type="file" name="uploadFile"><br>

<input type="submit" value="Upload File">

</form>

发现input标签里有一个type属性是file,和文字其实差不多。

import requests

filess = {'uploadFile': open('..files/Python-logo.png','rb')}

r= requests.post("http://www.pythonscraping.com/pages/files/processing2.php", files=files)

print(r.text)

处理登录与cookie

大多数新式的网站都用cookies跟踪用户是否已登录的状态信息。一旦网站验证了你的登录权证,它就会将它们保存在你的浏览器的cookie中,里面通常包含一个服务器生产的令牌、登录有效时限和状态跟踪信息。网站会把这个cookie当作信息验证的证据,在你浏览网站的每个页面时出示给服务器。

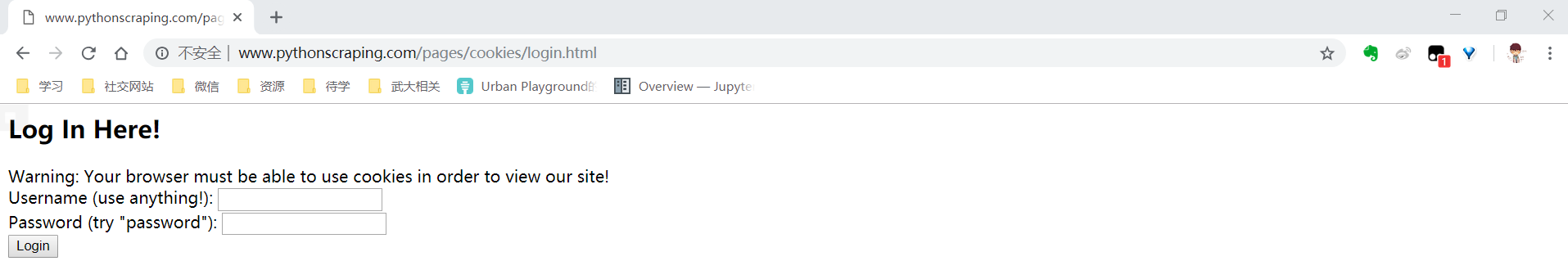

Ryan Mitchell在http://www.pythonscraping.com/pages/cookies/login.html创建了一个简单的登录表单。

用户名可以是任意值,但是密码必须是"password"。

在简介页面,网站会监测浏览器的cookie,看它有没有页面已登录的设置信息。

import requests

params = {'username':'Ryan','password':'password'}

r=requests.post("http://www.pythonscraping.com/pages/cookies/welcome.php",params)

print("Cookie is set to:")

print(r.cookies.get_dict())

print("-----------------------")

print("Going to profile page...")

r=requests.get("http://www.pythonscraping.com/pages/cookies/profile.php",cookies=r.cookies)

print(r.text)

有些网站比较复杂,cookie经常暗自调整。那么可以用session函数。

import requests

session = requests.Session()

params = {'username':'Ryan','password':'password'}

r=session.post("http://www.pythonscraping.com/pages/cookies/welcome.php",params)

print("Cookie is set to:")

print(r.cookies.get_dict())

print("-----------------------")

print("Going to profile page...")

r=session.get("http://www.pythonscraping.com/pages/cookies/profile.php")

print(r.text)

会话(session)对象会持续跟踪会话信息,比如cookie、header,甚至包括运行HTTP协议的信息,比如HTTPAdapter。

修改请求头

HTTP的请求头是在你每次向网络服务器发送请求时,传递的一组属性和配置信息。HTTP定义了十几种古怪的请求头类型,不过大多数都不常用。只有下面的七个字段被大多数浏览器用来初始化所有网络请求。(表内是我的浏览器数据)

| 属性 | 内容 |

|---|---|

| Host | hpd.baidu.com |

| Connection | keep-alive |

| Accept | image/webp,image/apng,image/,/*;q=0.8 |

| User-Agent | Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.110 Safari/537.36 |

| Referrer | https://www.baidu.com/ |

| Accept-Encoding | gzip, deflate, br |

| Accept-Language | zh-CN,zh;q=0.9 |

而经典的Python爬虫在使用urllib标准库时,都会发送如下的请求头:

| 属性 | 内容 |

|---|---|

| Accept-Encoding | indentity |

| User-Agent | Python-urllib/3.4 |

http://www.whatismybrowser.com/网站可以让服务器测试浏览器的属性。用下面的代码来采集这个网站的信息,验证我们浏览器的cookie设置:

import requests

from bs4 import BeautifulSoup

session = requests.Session()

headers = {"User-Agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/70.0.3538.110 Safari/537.36","Accept":"text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,image/apng,*/*;q=0.8"}

url="https://www.whatismybrowser.com/developers/what-http-headers-is-my-browser-sending"

req=session.get(url, headers=headers)

bsObj = BeautifulSoup(req.text, "lxml")

print(bsObj.find("table",{"class":"table-striped"}).get_text)

和Ryan给的代码稍有点不一样,加上了BeautifulSoup要用lxml解析,可能是由于我的header和Ryan不一样。

通常真正重要的参数就是User-Agent。如果在处理一个警觉性非常高的网站,就要注意那些经常用却很少检查的请求头。

请求头还可以让网站改变内容的布局样式。例如,用移动设备浏览网站时,通常会看到一个没有广告、Flash以及其他干扰的简化的网站版本。

Ryan给了一个移动设备的User-Agent如下。

User-Agent:Mozilla/5.0 (iPhone; CPU iPhone OS 7_1_2 like Mac OS X) AppleWebKit/537.51.2 (KHTML, lke Gecko) Version/7.0 Mobile/11D257 Safari/95

37.53

【参考】

[1]《Python网络数据采集》Ryan Mitchell

【Python学习】request库的更多相关文章

- python 学习jieba库遇到的问题及解决方法

昨天在课堂上学习了jieba库,跟着老师写了同样的代码时却遇到了问题: jieba分词报错AttributeError: module 'jieba' has no attribute 'cut' 文 ...

- Python学习第三方库Requests: 让 HTTP 服务人类

转自官方文档:http://cn.python-requests.org/zh_CN/latest/ 快速上手 http://cn.python-requests.org/zh_CN/latest/u ...

- 在Python中用Request库模拟登录(一):字幕库(无加密,无验证码)

字幕库的登录表单如下所示,其中省去了无关紧要的内容: <form class="login-form" action="/User/login.html" ...

- Python 基于request库的get,post,delete,封装

# coding=utf-8 import json import requests class TestApi(object): """ /* @param: @ses ...

- Python学习-第三方库操作

2018-05-04 12:03:19 Python安装模块,更新模块 #显示模块 pip list #显示过期模块 pip list --outdated #安装模块 pip install x ...

- 基于python的request库,模拟登录csdn博客

以前爬虫用urllib2来实现,也用过scrapy的爬虫框架,这次试试requests,刚开始用,用起来确实比urllib2好,封装的更好一些,使用起来简单方便很多. 安装requests库 ...

- [python 学习] requests 库的使用

1.get请求 # -*- coding: utf-8 -*- import requests URL_IP = "http://b.com/index.php" pyload = ...

- 使用Python学习win32库进行内存读写

前言: 上一周,在52的精华帖中,看到有位大佬用Python制作了鬼泣5的修改器,看完才知道,原来Python也可以对内存进行操作,出于对技术的好奇,看完以后,决定自己也尝试一下. 要用到的工具: C ...

- 在Python中用Request库模拟登录(四):哔哩哔哩(有加密,有验证码)

!已失效! 抓包分析 获取验证码 获取加密公钥 其中hash是变化的,公钥key不变 登录 其中用户名没有被加密,密码被加密. 因为在获取公钥的时候同时返回了一个hash值,推测此hash值与密码加密 ...

- 在Python中用Request库模拟登录(三):Discuz论坛(未加密,有验证码,有隐藏验证)

以Discuz的官方站为例.直接点击网页右上角的登录按钮,会弹出一个带验证码的登录窗口.输入验证码之后,会检查验证码是否正确.然后登录.首先,通过抓包分析,这些过程浏览器和服务器交换了哪些数据. 抓包 ...

随机推荐

- Android应用流量测试

工具 GT(中文产品名称:随身调):是腾讯出品的开源调试工具,本次测试中用其进行手机的流量统计和抓包.请在Android手机上安装GT应用(可以通过官网或应用宝下载). Wireshark:抓包的分析 ...

- 学习websocket-SignalR,MVC中使用SignalR打造酷炫实用的即时通讯

http://www.cnblogs.com/Leo_wl/p/4793284.html http://www.fangsi.net/archives/1144.html

- list的迭代器能解决并发问题,collection 的迭代器不能解决并发问题,for可以解决并发问题

list的迭代器能解决并发问题,collection 的迭代器不能解决并发问题 为什么list支持add,collection不支持 例如有两个人同时添加第三个元素 list的迭代器能锁定线程 只有等 ...

- DRM Study

1.DRM是什么? DRM,英文全称Digital Rights Management, 可以翻译为:数字版权管理.指的是出版者用来控制被保护对象的使用权的一些技术,这些技术保护的有数字化内容(例如: ...

- 【明哥报错簿】之json转换报错---net.sf.ezmorph.bean.MorphDynaBean cannot be cast to XXXDO

简单的json和bean转换直接用: public static void main(String[] args) { String s = "{'request': [{'orderCod ...

- BZOJ3637 Query on a tree VI(树链剖分+线段树)

考虑对于每一个点维护子树内与其连通的点的信息.为了换色需要,记录每个点黑白两种情况下子树内连通块的大小. 查询时,找到深度最浅的同色祖先即可,这可以比较简单的树剖+线段树乱搞一下(似乎就是qtree3 ...

- 【比赛】HNOI2018 总结

一将功成万骨枯,我就是给那些队爷做基数的 一.比赛过程 Day1 看完题,暴力好打,然后就打 觉得第三题模型很好建啊,先看第三题吧(结果第三题是最..的) 图建出来,先看树的情况,设dp试一下 结果一 ...

- mysql数据库的存储过程

一. 什么是存储过程: 存储过程是一组可编程的函数,是为了完成特定功能的SQL语句集,经过第一次编译后再次调用不需要再次编译,创建并保存在数据库中,用户可通过指定存储过程的名字并给定参数(需要时)来调 ...

- BZOJ1264 [AHOI2006]基因匹配Match 【LCS转LIS】

题目链接 BZOJ1264 题解 平凡的\(LCS\)是\(O(n^2)\)的 显然我们要根据题目的性质用一些不平凡的\(LCS\)求法 这就很巧妙了,, 我们考虑\(A\)序列的每个位置可能匹配\( ...

- Redis的键值命令、服务器命令

Redis提供了丰富的命令对数据库和各种数据类型进行操作,这些命令可以在Linux 终端使用.在编程时,比如各类语言包,这些命令都有对应的方法. 键值命令 服务器命令 获取数据库中所有键名 >k ...