scrapy-splash抓取动态数据例子十四

一、介绍

本例子用scrapy-splash爬取超级TV网站的资讯信息,输入给定关键字抓取微信资讯信息。

给定关键字:数字;融合;电视

抓取信息内如下:

1、资讯标题

2、资讯链接

3、资讯时间

4、资讯来源

二、网站信息

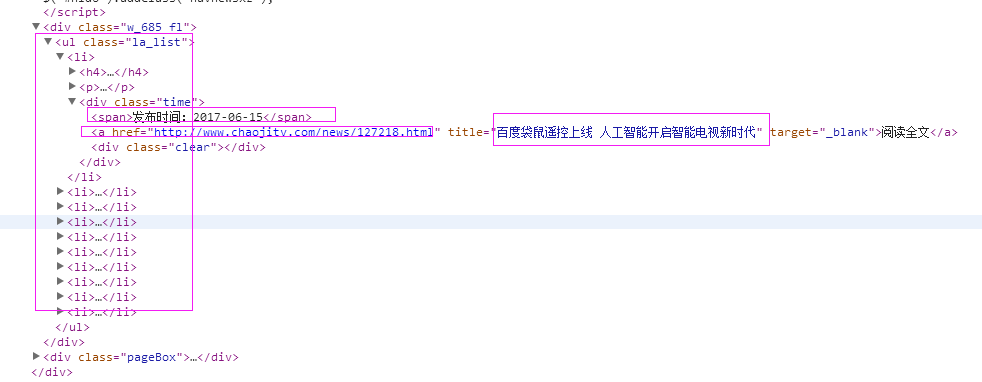

三、数据抓取

针对上面的网站信息,来进行抓取

1、首先抓取信息列表

抓取代码:sels = site.xpath('//ul[@class="la_list"]/li')

2、抓取标题

抓取代码:title = str(sel.xpath('.//h4/a/text()')[0].extract())

3、抓取链接

抓取代码:url = str(sel.xpath('.//h4/a/@href')[0].extract())

4、抓取日期

抓取代码:strdates = sel.xpath('.//div[@class="time"]/span/text()')

5、抓取来源

抓取代码:sources = site.xpath('//span[@class="wzof"]/a/text()');或sources = site.xpath('//span[@class="wzof"]/text()')

四、完整代码

# -*- coding: utf-8 -*-

import scrapy

from scrapy import Request

from scrapy.spiders import Spider

from scrapy_splash import SplashRequest

from scrapy_splash import SplashMiddleware

from scrapy.http import Request, HtmlResponse

from scrapy.selector import Selector

from scrapy_splash import SplashRequest

from scrapy_ott.items import SplashTestItem

from scrapy_ott.mongoDB import mongoDbBase

import scrapy_ott.IniFile

import sys

import os

import re

import time reload(sys)

sys.setdefaultencoding('utf-8') # sys.stdout = open('output.txt', 'w') class chaojitvSpider(Spider):

name = 'chaojitv'

db = mongoDbBase() configfile = os.path.join(os.getcwd(), 'scrapy_ott\setting.conf')

cf = scrapy_ott.IniFile.ConfigFile(configfile)

information_wordlist = cf.GetValue("section", "information_keywords").split(';')

websearchurl_list = cf.GetValue("chaojitv", "websearchurl").split(';')

start_urls = []

for url in websearchurl_list:

start_urls.append(url) # request需要封装成SplashRequest

def start_requests(self):

for url in self.start_urls:

yield SplashRequest(url

, self.parse

, args={'wait': ''}

)

def Comapre_to_days(self,leftdate, rightdate):

'''

比较连个字符串日期,左边日期大于右边日期多少天

:param leftdate: 格式:2017-04-15

:param rightdate: 格式:2017-04-15

:return: 天数

'''

l_time = time.mktime(time.strptime(leftdate, '%Y-%m-%d'))

r_time = time.mktime(time.strptime(rightdate, '%Y-%m-%d'))

result = int(l_time - r_time) / 86400

return result def date_isValid(self, strDateText):

'''

判断日期时间字符串是否合法:如果给定时间大于当前时间是合法,或者说当前时间给定的范围内

:param strDateText: 四种格式 '2小时前'; '2天前' ; '昨天' ;'2017.2.12 '

:return: True:合法;False:不合法

'''

currentDate = time.strftime('%Y-%m-%d')

datePattern = re.compile(r'\d{4}-\d{2}-\d{2}')

strDate = re.findall(datePattern, strDateText)

if len(strDate) == 1:

if self.Comapre_to_days(currentDate, strDate[0]) <= 1:

return True, strDate[0]

return False, '' def parse(self, response):

site = Selector(response)

sels = site.xpath('//ul[@class="la_list"]/li') for sel in sels:

strdates = sel.xpath('.//div[@class="time"]/span/text()')

if len(strdates)>0: flag, date = self.date_isValid(str(strdates[0].extract()))

if flag:

title = str(sel.xpath('.//h4/a/text()')[0].extract())

for keyword in self.information_wordlist:

if title.find(keyword) > -1:

url = str(sel.xpath('.//h4/a/@href')[0].extract())

yield SplashRequest(url

, self.parse_item

, args={'wait': ''},

meta={'date': date, 'url': url,

'keyword': keyword, 'title': title}

) def parse_item(self, response):

site = Selector(response)

it = SplashTestItem()

it['title'] = response.meta['title']

it['url'] = response.meta['url']

it['date'] = response.meta['date']

it['keyword'] = response.meta['keyword']

sources = site.xpath('//span[@class="wzof"]/a/text()')

if len(sources)>0:

it['source'] = sources[0].extract()

else:

#时间:2017-06-15 来源:环球网 编辑:叶子

sources = site.xpath('//span[@class="wzof"]/text()')

if len(sources)>0:

ss= str(sources[0].extract()).split(':')

if len(ss)>2:

it['source']= ss[2].replace(u'编辑: ','').replace(' ','') self.db.SaveInformation(it)

return it

scrapy-splash抓取动态数据例子十四的更多相关文章

- scrapy-splash抓取动态数据例子十六

一.介绍 本例子用scrapy-splash爬取梅花网(http://www.meihua.info/a/list/today)的资讯信息,输入给定关键字抓取微信资讯信息. 给定关键字:数字:融合:电 ...

- scrapy-splash抓取动态数据例子十五

一.介绍 本例子用scrapy-splash爬取电视之家(http://www.tvhome.com/news/)网站的资讯信息,输入给定关键字抓取微信资讯信息. 给定关键字:数字:融合:电视 抓取信 ...

- scrapy-splash抓取动态数据例子十二

一.介绍 本例子用scrapy-splash通过搜狗搜索引擎,输入给定关键字抓取资讯信息. 给定关键字:数字:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二. ...

- scrapy-splash抓取动态数据例子十

一.介绍 本例子用scrapy-splash抓取活动行网站给定关键字抓取活动信息. 给定关键字:数字:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信息 ...

- scrapy-splash抓取动态数据例子一

目前,为了加速页面的加载速度,页面的很多部分都是用JS生成的,而对于用scrapy爬虫来说就是一个很大的问题,因为scrapy没有JS engine,所以爬取的都是静态页面,对于JS生成的动态页面都无 ...

- scrapy-splash抓取动态数据例子八

一.介绍 本例子用scrapy-splash抓取界面网站给定关键字抓取咨询信息. 给定关键字:个性化:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信息 ...

- scrapy-splash抓取动态数据例子七

一.介绍 本例子用scrapy-splash抓取36氪网站给定关键字抓取咨询信息. 给定关键字:个性化:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子六

一.介绍 本例子用scrapy-splash抓取中广互联网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站信 ...

- scrapy-splash抓取动态数据例子五

一.介绍 本例子用scrapy-splash抓取智能电视网网站给定关键字抓取咨询信息. 给定关键字:打通:融合:电视 抓取信息内如下: 1.资讯标题 2.资讯链接 3.资讯时间 4.资讯来源 二.网站 ...

随机推荐

- linux平台从源码安装git【转】

转自:http://blog.csdn.net/lianshaohua/article/details/50571560 版权声明:本文为博主原创文章,未经博主允许不得转载. 如果是ubuntu等能自 ...

- CTP多点触摸协议【转】

转自:http://blog.chinaunix.net/uid-26403844-id-5063920.html linux kernel 2.6.30开始对多点触摸支持,最近高通要求所有CTP器件 ...

- PHPExcel 使用(1)

最近在项目中要用到PHP生成EXCEL,上网找了一下,发现PHPEXCEL挺不错,用了一下,感觉还行,就是设置单元格格式的时候比较麻烦,总体来说功能还是比较强大的,还有生成PDF什么的,发一个实例吧 ...

- Java处理文件BOM头的方式推荐

背景: java普通的文件读取方式对于bom是无法正常识别的. 使用普通的InputStreamReader,如果采用的编码正确,那么可以获得正确的字符,但bom仍然附带在结果中,很容易导致数据处理出 ...

- [BZOJ1227][SDOI2009]虔诚的墓主人 组合数+树状数组

1227: [SDOI2009]虔诚的墓主人 Time Limit: 5 Sec Memory Limit: 259 MBSubmit: 1433 Solved: 672[Submit][Stat ...

- React--基础学习混搭

最近学习一下React,通过 阮一峰<React 入门实例教程> .React 入门教程.菜鸟教程--React 这三个学习基础使用,接下来看慕课网的三个教学视频. React是什么我也 ...

- nodejs使用fetch获取WebAPI

在上一篇<Nodejs获取Azure Active Directory AccessToken>中,已经获取到了accessToken,现时需要获取WebAPI的数据,选择了node-fe ...

- php中parse_url函数的源码及分析

前言 看师傅们的文章时发现,parse_url出现的次数较多,单纯parse_url解析漏洞的考题也有很多,在此研究一下源码(太菜了看不懂,待日后再补充Orz) 源码 PHPAPI php_url * ...

- DP 贪心【p2134】百日旅行

Background 重要的不是去哪里,而是和你在一起.--小红 对小明和小红来说,2014年7月29日是一个美好的日子.这一天是他们相识100天的纪念日. (小明:小红,感谢你2场大考时默默的支持, ...

- POJ1258 Agri-Net(Prim)

Agri-Net Time Limit: 1000MS Memory Limit: 10000K Total Submissions: 51685 Accepted: 21558 Descri ...