node 爬虫 --- 批量下载图片

步骤一:创建项目

npm init

步骤二:安装 request,cheerio,async 三个模块

request

用于请求地址和快速下载图片流。

https://github.com/request/request

cheerio

为服务器特别定制的,快速、灵活、实施的jQuery核心实现.

便于解析html代码。

https://www.npmjs.com/package/cheerio

async

异步调用,防止堵塞。

http://caolan.github.io/async/

npm i request cheerio async -D

步骤三:核心思路

(1)用request 发送一个请求。获取html代码,取得其中的img标签和a标签。

//发送请求

function requestall(url) {

request({

uri: url,

headers: setting.header

}, function (error, response, body) {

if (error) {

// 请求失败

console.log(error);

} else {

console.log(response.statusCode);

if (!error && response.statusCode == 200) {

// 请求成功

}

}

});

}

(2)通过获取的a表情进行递归调用。不断获取img地址和a地址,继续递归

// 递归爬虫

$('a').each(function () {

var murl = $(this).attr('href');

if (IsURL(murl)) {

setTimeout(function () {

fetchre(murl);

}, timeout);

timeout += setting.ajax_timeout;

} else {

setTimeout(function () {

fetchre("http://www.ivsky.com/" + murl);

}, timeout);

timeout += setting.ajax_timeout;

}

})

(3)获取img地址通过request(photo).pipe(fs.createWriteStream(dir + “/” + filename));进行快速下载。

//发送请求

function requestall(url) {

request({

uri: url,

headers: setting.header

}, function (error, response, body) {

if (error) {

console.log(error);

} else {

console.log(response.statusCode);

if (!error && response.statusCode == 200) {

var $ = cheerio.load(body);

var photos = [];

$('img').each(function () {

// 判断地址是否存在

if ($(this).attr('src')) {

var src = $(this).attr('src');

var end = src.substr(-4, 4).toLowerCase();

if (end == '.jpg' || end == '.gif' || end == '.png' || end == '.jpeg') {

if (IsURL(src)) {

photos.push(src);

}

}

}

});

downloadImg(photos, dir, setting.download_v);

// 递归爬虫

$('a').each(function () {

var murl = $(this).attr('href');

if (IsURL(murl)) {

setTimeout(function () {

fetchre(murl);

}, timeout);

timeout += setting.ajax_timeout;

} else {

setTimeout(function () {

fetchre("http://www.ivsky.com/" + murl);

}, timeout);

timeout += setting.ajax_timeout;

}

})

}

}

});

}

步骤四:防坑

(1)在request通过图片地址下载时,绑定error事件防止爬虫异常的中断。

// 防止pipe错误

request(photo)

.on('error', function (err) {

console.log(err);

})

.pipe(fs.createWriteStream(dir + "/" + filename));

(2)通过async的mapLimit限制并发。

async.mapLimit(photos, asyncNum, function (photo, callback) {

// 请求成功

}, function (err, result) {

// 请求失败

})

(3)加入请求报头,防止ip被屏蔽。

setting.js

/**

* 加入请求报头,防止ip被屏蔽

*/

module.exports = {

header : {

'User-Agent': 'request',

"Referer":"http://www.ivsky.com/",

},

// 并发数

ajax_timeout : 2000,

// 下载图片速度

download_v : 5

}

(4)获取一些图片和超链接地址,可能是相对路径(待考虑解决是否有通过方法)。

// 下载图片

function downloadImg(photos, dir, asyncNum) {

console.log("即将异步并发下载图片,当前并发数为:" + asyncNum);

async.mapLimit(photos, asyncNum, function (photo, callback) {

var filename = (new Date().getTime()) + photo.substr(-4, 4);

if (filename) {

console.log('正在下载' + photo);

// 默认

// fs.createWriteStream(dir + "/" + filename)

// 防止pipe错误

request(photo)

.on('error', function (err) {

console.log(err);

})

.pipe(fs.createWriteStream(dir + "/" + filename));

console.log('下载完成');

callback(null, filename);

}

}, function (err, result) {

if (err) {

console.log(err);

} else {

console.log(" all right ! ");

console.log(result);

}

})

}

步骤五:完整代码

app.js

/**

* node 爬虫

*/

var fs = require('fs');

var request = require("request");

var cheerio = require("cheerio");

var async = require('async'); // 目标网址

var url = 'http://www.ivsky.com/tupian/ziranfengguang/'; // 本地存储目录

var dir = './images'; var setting = require('./setting'); var timeout = 100;

// 封装了一层函数

function fetchre(url) {

requestall(url);

}

// 发送请求

function requestall(url) {

request({

uri: url,

headers: setting.header

}, function (error, response, body) {

if (error) {

console.log(error);

} else {

console.log(response.statusCode);

if (!error && response.statusCode == 200) {

var $ = cheerio.load(body);

var photos = [];

$('img').each(function () {

// 判断地址是否存在

if ($(this).attr('src')) {

var src = $(this).attr('src');

var end = src.substr(-4, 4).toLowerCase();

if (end == '.jpg' || end == '.gif' || end == '.png' || end == '.jpeg') {

if (IsURL(src)) {

photos.push(src);

}

}

}

});

downloadImg(photos, dir, setting.download_v);

// 递归爬虫

$('a').each(function () {

var murl = $(this).attr('href');

if (IsURL(murl)) {

setTimeout(function () {

fetchre(murl);

}, timeout);

timeout += setting.ajax_timeout;

} else {

setTimeout(function () {

fetchre("http://www.ivsky.com/" + murl);

}, timeout);

timeout += setting.ajax_timeout;

}

})

}

}

});

} // 下载图片

function downloadImg(photos, dir, asyncNum) {

console.log("即将异步并发下载图片,当前并发数为:" + asyncNum);

async.mapLimit(photos, asyncNum, function (photo, callback) {

var filename = (new Date().getTime()) + photo.substr(-4, 4);

if (filename) {

console.log('正在下载' + photo);

// 默认

// fs.createWriteStream(dir + "/" + filename)

// 防止pipe错误

request(photo)

.on('error', function (err) {

console.log(err);

})

.pipe(fs.createWriteStream(dir + "/" + filename));

console.log('下载完成');

callback(null, filename);

}

}, function (err, result) {

if (err) {

console.log(err);

} else {

console.log(" all right ! ");

console.log(result);

}

})

} // 判断是否为完整地址

function IsURL(str_url) {

var strRegex = '^((https|http|ftp|rtsp|mms)?://)';

var re = new RegExp(strRegex);

if (re.test(str_url)) {

return (true);

} else {

return (false);

}

} requestall(url);

步骤六:执行

(1)在根路径下创建 images 空文件夹,用于存放下载下来的图片

(2)打开终端,执行

node app.js

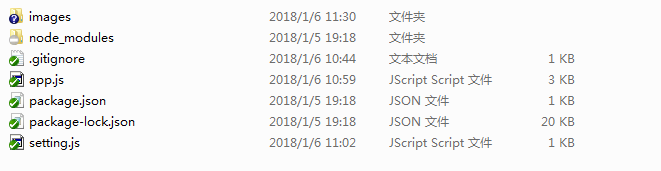

(3)项目目录

node 爬虫 --- 批量下载图片的更多相关文章

- 【Python】nvshens按目录批量下载图片爬虫1.00(单线程版)

# nvshens按目录批量下载图片爬虫1.00(单线程版) from bs4 import BeautifulSoup import requests import datetime import ...

- python图片爬虫 - 批量下载unsplash图片

前言 unslpash绝对是找图的绝佳场所, 但是进网站等待图片加载真的令人捉急, 仿佛是一场拼RP的战争 然后就开始思考用爬虫帮我批量下载, 等下载完再挑选, 操作了一下不算很麻烦, 顺便也给大家提 ...

- scrapy操作mysql/批量下载图片

1.操作mysql items.py meiju.py 3.piplines.py 4.settings.py -------------------------------------------- ...

- Node.js 使用爬虫批量下载网络图片到本地

图片网站往往广告众多,用Node.js写个爬虫下载图片,代码不长,省事不少,比手动一张张保存简直是天与地的区别.以前用Java也做过远程图片下载,但Node.js的下载速度更让人咂舌,这也是非阻塞式变 ...

- 利用Node 搭配uglify-js压缩js文件,批量下载图片到本地

Node的便民技巧-- 压缩代码 下载图片 压缩代码 相信很多前端的同学都会在上线前压缩JS代码,现在的Gulp Webpack Grunt......都能轻松实现.但问题来了,这些都不会,难道就要面 ...

- 用python批量下载图片

一 写爬虫注意事项 网络上有不少有用的资源, 如果需要合理的用爬虫去爬取资源是合法的,但是注意不要越界,前一阶段有个公司因为一个程序员写了个爬虫,导致公司200多个人被抓,所以先进入正题之前了解下什么 ...

- python——批量下载图片

前言 批量下载网页上的图片需要三个步骤: 获取网页的URL 获取网页上图片的URL 下载图片 例子 from html.parser import HTMLParser import urllib.r ...

- 如何用node.js批量给图片加水印

上一篇我们讲了如何用node.js给图片加水印,但是只是给某一张图片加,并没有涉及到批量处理.这一篇,我们学习如果批量进行图片加水印处理. 一.准备工作: 首先,你要阅读完这篇文章:http://ww ...

- javaWeb 批量下载图片

批量下载网页图片 CreateTime--2017年9月26日15:40:43 Author:Marydon 所用技术:javascript.java 测试浏览器:chrome 开发工具:Ecli ...

随机推荐

- Python中正则表达式讲解

正则表达式是匹配字符串的强大武器,它的核心思想是给字符串定义规则,凡是符合规则的字符串就是匹配了,否则就是不合法的.在介绍Python的用法之前,我们先讲解一下正则表达式的规则,然后再介绍在Pytho ...

- PAT Basic 1070

1070 结绳 给定一段一段的绳子,你需要把它们串成一条绳.每次串连的时候,是把两段绳子对折,再如下图所示套接在一起.这样得到的绳子又被当成是另一段绳子,可以再次对折去跟另一段绳子串连.每次串连后,原 ...

- re--模块【转】

为什么要学正则表达式 实际上爬虫一共就四个主要步骤: 明确目标 (要知道你准备在哪个范围或者网站去搜索) 爬 (将所有的网站的内容全部爬下来) 取 (去掉对我们没用处的数据) 处理数据(按照我们想要的 ...

- centos 7 smplayer vlc播放器

centos7安装多媒体播放器SMPlayer 2017-03-13 21:37:14 分类: LINUX 转自:https://wiki.centos.org/TipsAndTricks/Multi ...

- vim使用技巧二 模式

第一部分模式 第2章 普通模式 打开vim的默认状态即为普通模式 普通模式的命令强大 很大程度源于可以把操作符与动作命令结合在一起 技巧7 停顿时请移开画笔 工欲善其事,必先利其器 准 ...

- 【LeetCode】Valid Parentheses(有效的括号)

这道题是LeetCode里的第20道题. 题目要求: 给定一个只包括 '(',')','{','}','[',']' 的字符串,判断字符串是否有效. 有效字符串需满足: 左括号必须用相同类型的右括号闭 ...

- 【LeetCode】Maximize Sum Of Array After K Negations(K 次取反后最大化的数组和)

这道题是LeetCode里的第1005道题. 题目描述: 给定一个整数数组 A,我们只能用以下方法修改该数组:我们选择某个个索引 i 并将 A[i] 替换为 -A[i],然后总共重复这个过程 K 次. ...

- [git 学习篇] git remote add origin错误

http://blog.csdn.net/dengjianqiang2011/article/details/9260435 如果输入$ Git remote add origin git@githu ...

- HDU-4738 Caocao's Bridges,注意重边不是桥!

Caocao's Bridges 题意:曹操赤壁之战后卷土重来,他在n个小岛之间建立了m座桥.现在周瑜只有一颗炮弹,他只能炸毁一座桥使得这些岛屿不再连通.每座桥上都可能会有士兵把手,如果想安放***那 ...

- 刷题总结——蜥蜴(ssoj网络流)

题目: 题目背景 SCOI2007 DAY1 T3 题目描述 在一个 r 行 c 列的网格地图中有一些高度不同的石柱,一些石柱上站着一些蜥蜴,你的任务是让尽量多的蜥蜴逃到边界外.每行每列中相邻石柱的距 ...