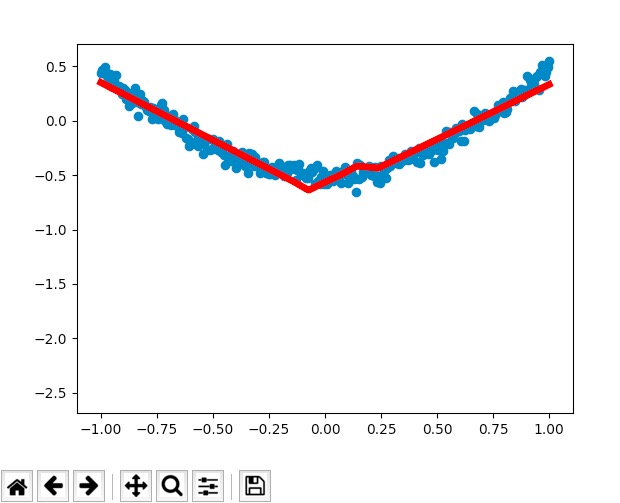

莫烦theano学习自修第七天【回归结果可视化】

1.代码实现

from __future__ import print_function

import theano

import theano.tensor as T

import numpy as np

import matplotlib.pyplot as plt

class Layer(object):

def __init__(self, inputs, in_size, out_size, activation_function=None):

self.W = theano.shared(np.random.normal(0, 1, (in_size, out_size)))

self.b = theano.shared(np.zeros((out_size, )) + 0.1)

self.Wx_plus_b = T.dot(inputs, self.W) + self.b

self.activation_function = activation_function

if activation_function is None:

self.outputs = self.Wx_plus_b

else:

self.outputs = self.activation_function(self.Wx_plus_b)

# Make up some fake data

x_data = np.linspace(-1, 1, 300)[:, np.newaxis]

noise = np.random.normal(0, 0.05, x_data.shape)

y_data = np.square(x_data) - 0.5 + noise # y = x^2 - 0.5

# show the fake data

#plt.scatter(x_data, y_data)

plt.show()

# determine the inputs dtype

x = T.dmatrix("x")

y = T.dmatrix("y")

# add layers

l1 = Layer(x, 1, 10, T.nnet.relu)

l2 = Layer(l1.outputs, 10, 1, None)

# compute the cost

cost = T.mean(T.square(l2.outputs - y))

# compute the gradients

gW1, gb1, gW2, gb2 = T.grad(cost, [l1.W, l1.b, l2.W, l2.b])

# apply gradient descent

learning_rate = 0.05

train = theano.function(

inputs=[x, y],

outputs=[cost],

updates=[(l1.W, l1.W - learning_rate * gW1),

(l1.b, l1.b - learning_rate * gb1),

(l2.W, l2.W - learning_rate * gW2),

(l2.b, l2.b - learning_rate * gb2)])

# prediction

predict = theano.function(inputs=[x], outputs=l2.outputs)

# plot the real data

fig = plt.figure()

ax = fig.add_subplot(1,1,1)

ax.scatter(x_data, y_data)

plt.ion()

plt.show()

for i in range(1000):

# training

err = train(x_data, y_data)

if i % 50 == 0:

# to visualize the result and improvement

try:

ax.lines.remove(lines[0])

except Exception:

pass

prediction_value = predict(x_data)

# plot the prediction

lines = ax.plot(x_data, prediction_value, 'r-', lw=5)

plt.pause(.5)

结果:

莫烦theano学习自修第七天【回归结果可视化】的更多相关文章

- 莫烦theano学习自修第九天【过拟合问题与正规化】

如下图所示(回归的过拟合问题):如果机器学习得到的回归为下图中的直线则是比较好的结果,但是如果进一步控制减少误差,导致机器学习到了下图中的曲线,则100%正确的学习了训练数据,看似较好,但是如果换成另 ...

- 莫烦theano学习自修第十天【保存神经网络及加载神经网络】

1. 为何保存神经网络 保存神经网络指的是保存神经网络的权重W及偏置b,权重W,和偏置b本身是一个列表,将这两个列表的值写到列表或者字典的数据结构中,使用pickle的数据结构将列表或者字典写入到文件 ...

- 莫烦theano学习自修第八天【分类问题】

1. 代码实现 from __future__ import print_function import numpy as np import theano import theano.tensor ...

- 莫烦theano学习自修第六天【回归】

1. 代码实现 from __future__ import print_function import theano import theano.tensor as T import numpy a ...

- 莫烦theano学习自修第五天【定义神经层】

1. 代码如下: #!/usr/bin/env python #! _*_ coding:UTF-8 _*_ import numpy as np import theano.tensor as T ...

- 莫烦theano学习自修第三天【共享变量】

1. 代码实现 #!/usr/bin/env python #! _*_ coding:UTF-8 _*_ import numpy as np import theano.tensor as T i ...

- 莫烦theano学习自修第二天【激励函数】

1. 代码如下: #!/usr/bin/env python #! _*_ coding:UTF-8 _*_ import numpy as np import theano.tensor as T ...

- 莫烦theano学习自修第一天【常量和矩阵的运算】

1. 代码实现如下: #!/usr/bin/env python #! _*_ coding:UTF-8 _*_ # 导入numpy模块,因为numpy是常用的计算模块 import numpy as ...

- 莫烦sklearn学习自修第七天【交叉验证】

1. 什么是交叉验证 所谓交叉验证指的是将样本分为两组,一组为训练样本,一组为测试样本:对于哪些数据分为训练样本,哪些数据分为测试样本,进行多次拆分,每次将整个样本进行不同的拆分,对这些不同的拆分每个 ...

随机推荐

- P1577 切绳子(二分)

思路:先来分析一下数据范围,是1e4个数据,但是,是double类型,结果不超过0.01那么在绳子最大的情况下,单纯的找正确答案暴力的话就是1e7的时间复杂度,再乘上1e4的数据,这样肯定不行.那么很 ...

- 003_webpack 配合babel 将es6转成es5

今天接触了webpack,第一次使用webpack进行转码,竟然稀里糊涂就成功了,哈哈. 下面附上流程 创建个文件夹,初始化一下,首先全局安装webpack npm install webpack - ...

- openvon安装

一.安装环境 1.阿里云centos7 2.关闭防火墙,selinux 临时关闭:setenforce 0 永久关闭:vim /etc/selinux/config 3.修改yum源 1)备份原有的y ...

- python魔法方法、构造函数、序列与映射、迭代器、生成器

在Python中,所有以__双下划线包起来的方法,都统称为"魔术方法".比如我们接触最多的__init__,魔法方法也就是具有特殊功能的方法. 构造函数 构造函数不同于普通方法,将 ...

- [Luogu4916]魔力环[Burnside引理、组合计数、容斥]

题意 题目链接 分析 sπo yyb 代码 #include<bits/stdc++.h> using namespace std; typedef long long LL; #defi ...

- zookeeper核心-zab协议-《每日五分钟搞定大数据》

上篇文章<paxos与一致性>说到zab是在paxos的基础上做了重要的改造,解决了一系列的问题,这一篇我们就来说下这个zab. zab协议的全称是ZooKeeper Atomic Bro ...

- 图解Redis之数据结构篇——简单动态字符串SDS

图解Redis之数据结构篇--简单动态字符串SDS 前言 相信用过Redis的人都知道,Redis提供了一个逻辑上的对象系统构建了一个键值对数据库以供客户端用户使用.这个对象系统包括字符串对象 ...

- 面试 5:手写 Java 的 pow() 实现

我们在处理一道编程面试题的时候,通常除了注意代码规范以外,千万要记得自己心中模拟一个单元测试.主要通过三方面来处理. 功能性测试 边界值测试 负面性测试 不管如何,一定要保证自己代码考虑的全面,而不要 ...

- IIS配置Url重写实现http自动跳转https的重定向方法(100%解决)

引言 本文推荐阅读地址:https://www.52abp.com/BlogDetails/10008 这种文章网上可以说一搜一大把,但是我为什么还要写呢,因为一搜一把没把我气死,都是东抄西挪的东西, ...

- WebClient, HttpClient, HttpWebRequest ,RestSharp之间的区别与抉择

NETCore提供了三种不同类型用于生产的REST API: HttpWebRequest;WebClient;HttpClient,开源社区创建了另一个名为RestSharp的库.如此多的http库 ...