Spark操作parquet文件

package code.parquet import java.net.URI import org.apache.hadoop.conf.Configuration

import org.apache.hadoop.fs.{Path, FileSystem}

import org.apache.spark.sql.{SaveMode, SparkSession} /**

* Created by zhen on 2018/12/11.

*/

object ParquetIO {

// 指定hdfs根节点

private val hdfsRoot = "hdfs://172.20.32.163:8020"

// 获取HDFS路径

def getPath(path: String): Path = {

if (path.toLowerCase().startsWith("hdfs://")) {

new Path(path)

} else {

new Path(hdfsRoot + path)

}

}

def main(args: Array[String]) {

val spark = SparkSession.builder().appName("parquet").master("local[2]").getOrCreate()

spark.sparkContext.setLogLevel("WARN") // 设置日志级别为WARN

val fsUri = new URI(hdfsRoot)

val fs = FileSystem.get(fsUri, new Configuration())

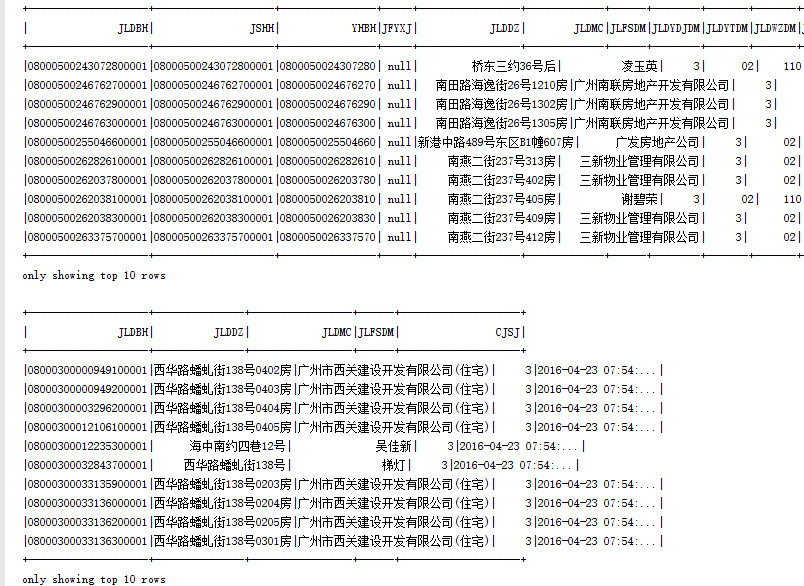

val path = hdfsRoot + "/YXFK/compute/KH_JLD"

val has = fs.exists(getPath(path))

if(has){

// 读取hdfs文件系统parquet数据

val dataFrame = spark.read.parquet(path)

dataFrame.show(10)

// 筛选,过滤数据

val result = dataFrame.select("JLDBH", "JLDDZ", "JLDMC", "JLFSDM", "CJSJ")

.filter("JLDDZ is not null AND JLFSDM = 3")

.sort("JLDBH")

result.show(10)

// 写入部分数据到本地

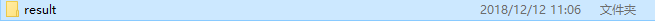

result.write.mode(SaveMode.Overwrite).parquet("E:\\result")

}

// 读取本地parquet数据

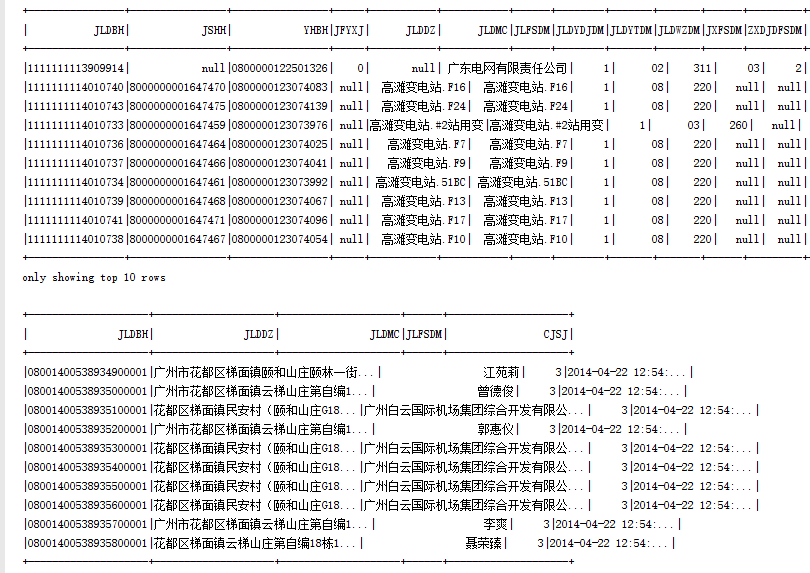

val localDataFrame = spark.read.parquet("E:\\jld.parquet")

localDataFrame.show(10)

// 读取写入数据验证

val resultSpace = spark.read.parquet("E:\\result")

resultSpace.show(10)

}

}

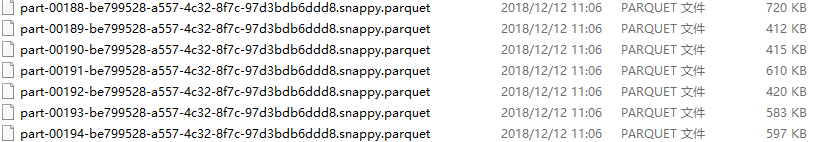

结果:

分析:Spark读取parquet数据默认为目录,因此可以只指定到你要读取的上级目录即可(本地模式除外),当保存为parquet时,会自动拆分,因此只能指定为上级目录。

Spark操作parquet文件的更多相关文章

- python读取hdfs上的parquet文件方式

在使用python做大数据和机器学习处理过程中,首先需要读取hdfs数据,对于常用格式数据一般比较容易读取,parquet略微特殊.从hdfs上使用python获取parquet格式数据的方法(当然也 ...

- Spark SQL读parquet文件及保存

import org.apache.spark.{SparkConf, SparkContext} import org.apache.spark.sql.{Row, SparkSession} im ...

- 大数据:Parquet文件存储格式

一.Parquet的组成 Parquet仅仅是一种存储格式,它是语言.平台无关的,并且不需要和任何一种数据处理框架绑定,目前能够和Parquet适配的组件包括下面这些,可以看出基本上通常使用的查询引擎 ...

- 大数据:Parquet文件存储格式【转】

一.Parquet的组成 Parquet仅仅是一种存储格式,它是语言.平台无关的,并且不需要和任何一种数据处理框架绑定,目前能够和Parquet适配的组件包括下面这些,可以看出基本上通常使用的查询引擎 ...

- Spark SQL 小文件问题处理

在生产中,无论是通过SQL语句或者Scala/Java等代码的方式使用Spark SQL处理数据,在Spark SQL写数据时,往往会遇到生成的小文件过多的问题,而管理这些大量的小文件,是一件非常头疼 ...

- Spark操作hbase

于Spark它是一个计算框架,于Spark环境,不仅支持单个文件操作,HDFS档,同时也可以使用Spark对Hbase操作. 从企业的数据源HBase取出.这涉及阅读hbase数据,在本文中尽快为了尽 ...

- scala读取parquet文件

import org.apache.spark.SparkConfimport org.apache.spark.SparkContextimport org.apache.spark.sql.SQL ...

- Spark操作实战

1. local模式 $SPARK_HOME/bin/spark-shell --master local import org.apache.log4j.{Level,Logger} // 导入ja ...

- 大数据学习day20-----spark03-----RDD编程实战案例(1 计算订单分类成交金额,2 将订单信息关联分类信息,并将这些数据存入Hbase中,3 使用Spark读取日志文件,根据Ip地址,查询地址对应的位置信息

1 RDD编程实战案例一 数据样例 字段说明: 其中cid中1代表手机,2代表家具,3代表服装 1.1 计算订单分类成交金额 需求:在给定的订单数据,根据订单的分类ID进行聚合,然后管理订单分类名称, ...

随机推荐

- sql server 备份与恢复系列三 简单恢复模式下的备份与还原

一.概述 前面讲了备份的一些理论知识,这篇开始讲在简单恢复模式下的备份与还原.在简单模式下是不能做日志备份的,发生灾难后,数据库最后一次备份之后做的数据修改将是全部丢失的,所以在生产环境下,数据又很重 ...

- 使用数组制作简易的用户管理系统【java】

思路: 一.分析用户管理功能模块 - User类型属性值设定 private String username; // 用户id(唯一字段) private String nickname; // 昵称 ...

- 【ASP.NET MVC系列】浅谈ASP.NET 页面之间传值的几种方式

ASP.NET MVC系列文章 [01]浅谈Google Chrome浏览器(理论篇) [02]浅谈Google Chrome浏览器(操作篇)(上) [03]浅谈Google Chrome浏览器(操作 ...

- SpringBoot之RabbitMQ的使用

一 .RabbitMQ的介绍 RabbitMQ是消息中间件的一种,消息中间件即分布式系统中完成消息的发送和接收的基础软件,消息中间件的工作过程可以用生产者消费者模型来表示.即,生产者不断的向消息队列发 ...

- CSRF跨站伪造请求

一.什么是CSRF CSRF(Cross Site Request Forgery) 跨站请求伪造.也被称为One Click Attack和Session Riding,通常缩写为CSRF或XSRF ...

- IIS中注册.net4.0

1.开始-运行: 2.运行框中输入 cmd ; 3.输入命令 %windir%\Microsoft.NET\Framework\v4.0.30319\aspnet_regiis.exe -i 4.回车 ...

- 从零开始学安全(二十二)●PHP日期date参数表

$date=new DateTime(); echo $date->format("Y-m-d h:i:s");

- 【学习笔记】sklearn数据集与估计器

数据集划分 机器学习一般的数据集会划分为两个部分: 训练数据:用于训练,构建模型 测试数据:在模型检验时使用,用于评估模型是否有效 训练数据和测试数据常用的比例一般为:70%: 30%, 80%: 2 ...

- Linux 系统的安装 (最全收集)

在几年前,我曾经多次萌生抛弃Win系统,从而使用Linux系统-----(Ubuntu),但是我每次都会遇到同一个问题,TM怎么安装啊. 不是安装奇慢就是不知道安装的方法. 怎样安装Ubuntu操作系 ...

- Myeclipse 添加插件

配置方式添加插件,添加一个反编译插件示例 1.官网下载(http://java-decompiler.github.io/) 2.下载到本地之后,删除多余的文件(其他的插件也是如此,例如SVN) 3. ...