Golang 网络爬虫框架gocolly/colly 四

Golang 网络爬虫框架gocolly/colly 四

爬虫靠演技,表演得越像浏览器,抓取数据越容易,这是我多年爬虫经验的感悟。回顾下个人的爬虫经历,共分三个阶段:第一阶段,09年左右开始接触爬虫,那时由于项目需要,要访问各大国际社交网站,Facebook,myspace,filcker,youtube等等,国际上叫得上名字的社交网站都爬过,大部分网站提供restful api,有些功能没有api,就只能用http抓包工具分析协议,自己爬;国内的优酷、土豆、校内网、web版qq、网页邮箱等等也都爬过;那时候先用C#写demo,项目是C++的,所以还要转换成托管C++的代码。第一阶段的主要心得是cookie管理,比较难搞的cookie就借助于webbrowser控件。

第二阶段是13年左右,做的是金融数据分析类软件和网络机器人,爬虫编程语言依然借助于C# ,发包收包全靠HttpWebRequest和HttpWebResponse,cookie管理靠CookieContainer,HTML分析靠HtmlAgilityPack,验证码识别靠自己预处理封装过的tesseract,协议分析靠fiddler,元素选择靠浏览器调试器,这套功夫在手基本可以畅游网络,实现的机器人随意游走于博客、微博,自动留言、发帖、评论;各大金融网站、上交所、深交所、巨潮网络、互动平台等等数据任爬。

第三阶段就是现在了。四年多过去了,重新学习审视爬虫技术,发现武器更强大了:go语言,goquery,colly,chromedp,webloop等,强大的语言及工具使爬虫更简单、更高效。

多年的爬虫经验总结了开头那句话。已知的爬虫手段无外乎三大类:一,分析HTTP协议,构造请求;二,利用浏览器控件,获取cookie、页面元素、调用js脚本等;phantomjs、webloop属于此类;第三类是直接操作浏览器,chromedp属于此类;微软还提供了操纵ie浏览器的com接口,很早以前用C++写过,比较难用,代码写起来很恶心,需要较多的条件判断。构造请求直接快速,浏览器控件和操纵浏览器可靠安全,可以省去很多不必要的协议分析、js脚本分析,但速度慢,加载了很多无用的数据、图片等;第二、三种与第一种混用效果更佳,只要表演地越像浏览器就越安全可靠,或者干脆操纵浏览器,只要不超过服务器的人类操作阈值判定,ip基本不会被封。单ip不够用时,就设置代理来切换。

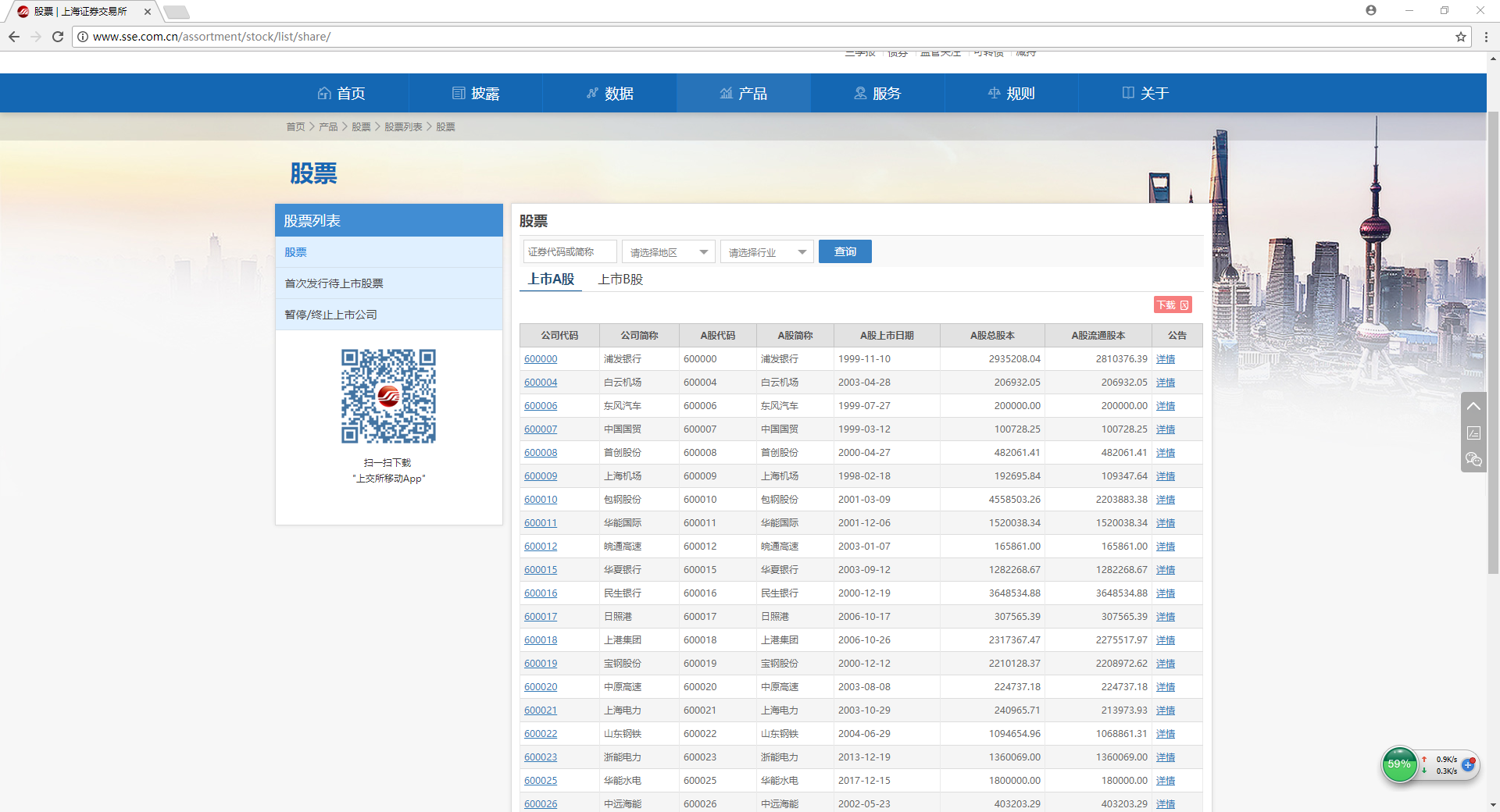

学无止境,不断用新的武器武装自己。下面贡献一个小例子,爬取上交所的AB股股票列表,简单地show下演技。(哈哈哈)

该页面提供了下载功能,A股的下载地址 http://query.sse.com.cn/security/stock/downloadStockListFile.do?csrcCode=&stockCode=&areaName=&stockType=1

B股的下载地址 http://query.sse.com.cn/security/stock/downloadStockListFile.do?csrcCode=&stockCode=&areaName=&stockType=2

拿到了这个地址就开始Visit了

c.Visit("http://query.sse.com.cn/security/stock/downloadStockListFile.do?csrcCode=&stockCode=&areaName=&stockType=1")

UserAgent设置成了Chrome

c.UserAgent = "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.108 Safari/537.36"

发现不行,程序会报错,

// :: Forbidden

把这个网址直接在浏览器地址栏中打开也是不行的,会报告“Error 403: SRVE0190E: 找不到文件:/error/error_cn.jsp”

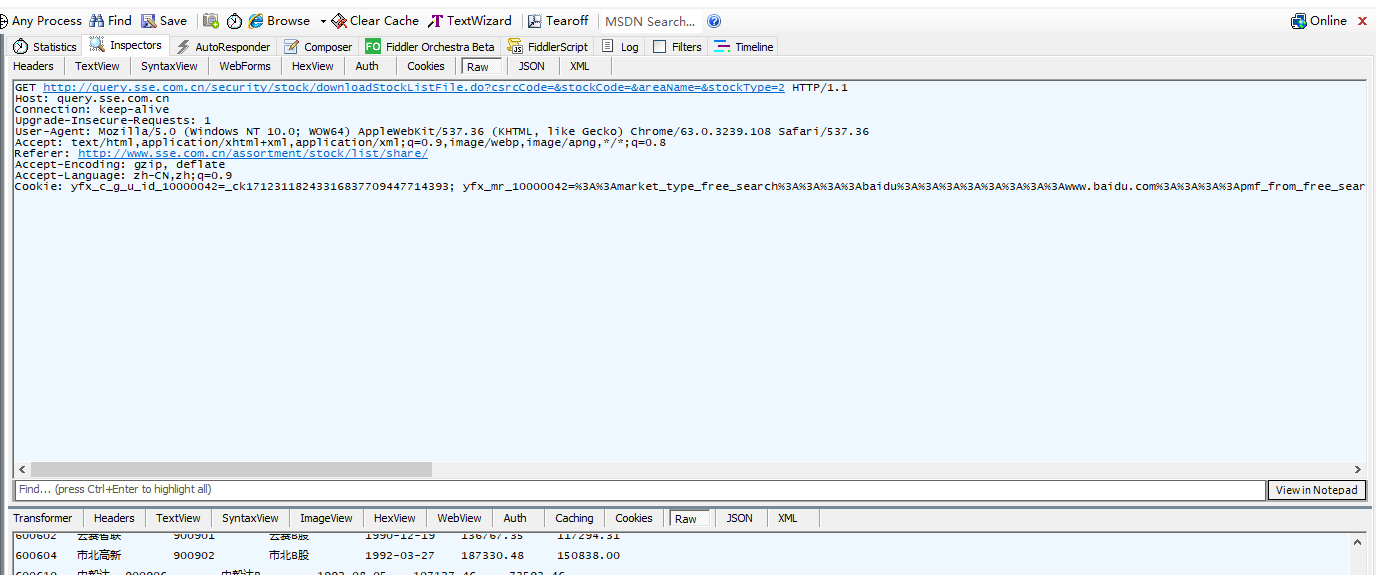

服务端做了些限制,打开fiddler看下协议

请求中有一大堆cookie,第一感觉是可能没有加cookie的缘故,于是利用chromedp打开页面,再调用ajax去请求,刚开始ajax没有带cookie也请求成功了,

后来发现关键在于请求头中的“Referer”,有了Referer就行了。

干脆把所有的头补全,更像浏览器些,这不会吃亏:

c.OnRequest(func(r *colly.Request) {

r.Headers.Set("Host", "query.sse.com.cn")

r.Headers.Set("Connection", "keep-alive")

r.Headers.Set("Accept", "*/*")

r.Headers.Set("Origin", "http://www.sse.com.cn")

r.Headers.Set("Referer", "http://www.sse.com.cn/assortment/stock/list/share/") //关键头 如果没有 则返回 错误

r.Headers.Set("Accept-Encoding", "gzip, deflate")

r.Headers.Set("Accept-Language", "zh-CN,zh;q=0.9")

})

附上完整的代码,将股票保存到CSV文件

package sse import (

"encoding/csv"

"os"

"strings" "github.com/gocolly/colly"

) /*GetStockListA 获取上海证券交易所股票列表

A股

*/

func GetStockListA(saveFile string) (err error) { stocks, err := getStockList("http://query.sse.com.cn/security/stock/downloadStockListFile.do?csrcCode=&stockCode=&areaName=&stockType=1")

if err != nil {

return err

} err = saveStockList2CSV(stocks, saveFile)

return

} /*GetStockListB 获取上海证券交易所股票列表

B股

*/

func GetStockListB(saveFile string) (err error) {

stocks, err := getStockList("http://query.sse.com.cn/security/stock/downloadStockListFile.do?csrcCode=&stockCode=&areaName=&stockType=2")

if err != nil {

return err

}

err = saveStockList2CSV(stocks, saveFile)

return

}

func saveStockList2CSV(stockList string, file string) (err error) { vals := strings.Split(stockList, "\n") f, err := os.Create(file)

if err != nil {

return err

}

defer f.Close()

fw := csv.NewWriter(f) for _, row := range vals { rSplits := strings.Split(row, "\t") rSplitsRslt := make([]string, 0)

for _, sp := range rSplits {

trimSp := strings.Trim(sp, " ")

if len(trimSp) > 0 {

rSplitsRslt = append(rSplitsRslt, trimSp)

}

}

if len(rSplitsRslt) > 0 {

err = fw.Write(rSplitsRslt)

if err != nil {

return err

}

}

}

fw.Flush() return

} func getStockList(url string) (stockList string, err error) { //GET http://query.sse.com.cn/security/stock/downloadStockListFile.do?csrcCode=&stockCode=&areaName=&stockType=1 HTTP/1.1

//Host: query.sse.com.cn

//Connection: keep-alive

//Accept: */*

//Origin: http://www.sse.com.cn

//User-Agent: Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.108 Safari/537.36

//Referer: http://www.sse.com.cn/assortment/stock/list/share/

//Accept-Encoding: gzip, deflate

//Accept-Language: zh-CN,zh;q=0.9` c := colly.NewCollector() c.UserAgent = "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.108 Safari/537.36"

c.OnRequest(func(r *colly.Request) {

r.Headers.Set("Host", "query.sse.com.cn")

r.Headers.Set("Connection", "keep-alive")

r.Headers.Set("Accept", "*/*")

r.Headers.Set("Origin", "http://www.sse.com.cn")

r.Headers.Set("Referer", "http://www.sse.com.cn/assortment/stock/list/share/") //关键头 如果没有 则返回 错误

r.Headers.Set("Accept-Encoding", "gzip, deflate")

r.Headers.Set("Accept-Language", "zh-CN,zh;q=0.9")

})

c.OnResponse(func(resp *colly.Response) {

stockList = string(resp.Body)

}) c.OnError(func(resp *colly.Response, errHttp error) {

err = errHttp

}) err = c.Visit(url) return

}

func main() {

var err error

err = sse.GetStockListA("e:\\sseA.csv")

if err != nil {

log.Fatal(err)

}

err = sse.GetStockListB("e:\\sseB.csv")

if err != nil {

log.Fatal(err)

}

}

转载请注明出处: http://www.cnblogs.com/majianguo/p/8186429.html

Golang 网络爬虫框架gocolly/colly 四的更多相关文章

- Golang 网络爬虫框架gocolly/colly 五 获取动态数据

Golang 网络爬虫框架gocolly/colly 五 获取动态数据 gcocolly+goquery可以非常好地抓取HTML页面中的数据,但碰到页面是由Javascript动态生成时,用goque ...

- Golang 网络爬虫框架gocolly/colly 三

Golang 网络爬虫框架gocolly/colly 三 熟悉了<Golang 网络爬虫框架gocolly/colly一>和<Golang 网络爬虫框架gocolly/colly二& ...

- Golang 网络爬虫框架gocolly/colly 二 jQuery selector

Golang 网络爬虫框架gocolly/colly 二 jQuery selector colly框架依赖goquery库,goquery将jQuery的语法和特性引入到了go语言中.如果要灵活自如 ...

- Golang 网络爬虫框架gocolly/colly 一

Golang 网络爬虫框架gocolly/colly 一 gocolly是用go实现的网络爬虫框架,目前在github上具有3400+星,名列go版爬虫程序榜首.gocolly快速优雅,在单核上每秒可 ...

- 试验一下Golang 网络爬虫框架gocolly/colly

参考:http://www.cnblogs.com/majianguo/p/8186429.html 框架源码在 github.com/gocolly/colly 代码如下(github源码中的dem ...

- 网络爬虫框架Scrapy简介

作者: 黄进(QQ:7149101) 一. 网络爬虫 网络爬虫(又被称为网页蜘蛛,网络机器人),是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本:它是一个自动提取网页的程序,它为搜索引擎从万维 ...

- 基于java的网络爬虫框架(实现京东数据的爬取,并将插入数据库)

原文地址http://blog.csdn.net/qy20115549/article/details/52203722 本文为原创博客,仅供技术学习使用.未经允许,禁止将其复制下来上传到百度文库等平 ...

- [原创]一款基于Reactor线程模型的java网络爬虫框架

AJSprider 概述 AJSprider是笔者基于Reactor线程模式+Jsoup+HttpClient封装的一款轻量级java多线程网络爬虫框架,简单上手,小白也能玩爬虫, 使用本框架,只需要 ...

- Scrapy (网络爬虫框架)入门

一.Scrapy 简介: Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,Scrapy 使用了 Twisted['twɪstɪd](其主要对手是Tornado) ...

随机推荐

- WebVR认识

什么是WebVR WebVR是一种开放标准,可以在浏览器中体验VR,目标是让每个人都能轻松进入虚拟现实体验.

- JavaWeb框架_Struts2_(六)----->Struts2的输入校验

1. 输入校验章节目录 输入校验概述 客户端校验 服务器端校验 手动编程校验 重写validate方法 重写validateXxx()方法 输入校验流程 校验框架校验 Struts2 内置的校验器 常 ...

- POST和GET有什么区别?

1. GET主要用于从服务器查询数据,POST用于向服务器提交数据 2. GET通过URL传递数据,POST通过http请求体传递数据 3. GET传输数据量有限制,不能大于2kb,POST传递的数据 ...

- UWP 重启App

今天看见了阿迪王的博客,写到了重启App自身的代码,微软终于在16299加进来了 其实就加上一句话 await CoreApplication.RequestRestartAsync(string.E ...

- javascript设计模式——模板方法模式

前面的话 在javascript开发中用到继承的场景其实并不是很多,很多时候喜欢用mix-in的方式给对象扩展属性.但这不代表继承在javascript里没有用武之地,虽然没有真正的类和继承机制,但可 ...

- VSCode插件及用户设置

第一部分:插件 VSCode内置"emmet"插件,"convert to utf-8"等插件效果!十分强大!代码提示功能特别强悍! 插件地址:点击此处! 推荐 ...

- speedment 入门教程

speedment 是基于 Java8 的 orm 框架,相比较 hibernate 和 mybatis 你只要很少的代码就可以实现对数据库的操作,而且根据查询自动帮你优化SQL,开发者无需编写SQL ...

- java 内存数据存储

近期在学习的过程中,越发认为基础知识的重要性,so 恶补一下 直接上图上演示样例: 图一:

- outb,inb等I/Oport操作函数

功能: 如 i386 .在差别 I/O 空间和内存空间的进程的 I/O 空间写入数据. outb() I/O 上写入 8 位数据 ( 1 字节 ). outw() I/O 上写入 16 位数据 ( ...

- UML总结复习指南

用例图 1. 參与者(Actor) 表示与您的应用程序或系统进行交互的用户.组织或外部系统.用一个小人表示. 2. 用例(Use Case) 用例就是外部可见的系统功能,对系统提供的服务进行描 ...