【sparkSQL】创建DataFrame及保存

首先我们要创建SparkSession

val spark = SparkSession.builder()

.appName("test")

.master("local")

.getOrCreate()

import spark.implicits._ //将RDD转化成为DataFrame并支持SQL操作

然后我们通过SparkSession来创建DataFrame

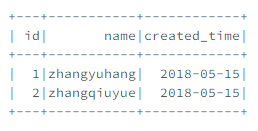

1.使用toDF函数创建DataFrame

通过导入(importing)spark.implicits, 就可以将本地序列(seq), 数组或者RDD转为DataFrame。

只要这些数据的内容能指定数据类型即可。

import spark.implicits._

val df = Seq(

(1, "zhangyuhang", java.sql.Date.valueOf("2018-05-15")),

(2, "zhangqiuyue", java.sql.Date.valueOf("2018-05-15"))

).toDF("id", "name", "created_time")

注意:如果直接用toDF()而不指定列名字,那么默认列名为"_1", "_2"

可以通过df.withColumnRenamed("_1", "newName1").withColumnRenamed("_2", "newName2")进行修改列名

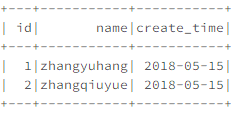

2.使用createDataFrame函数创建DataFrame

通过schema + row 来创建

我们可以通俗的理解为schema为表的表头,row为表的数据记录

import org.apache.spark.sql.types._

//定义dataframe的结构的schema

val schema = StructType(List(

StructField("id", IntegerType, nullable = false),

StructField("name", StringType, nullable = true),

StructField("create_time", DateType, nullable = true)

))

//定义dataframe内容的rdd

val rdd = sc.parallelize(Seq(

Row(1, "zhangyuhang", java.sql.Date.valueOf("2018-05-15")),

Row(2, "zhangqiuyue", java.sql.Date.valueOf("2018-05-15"))

))

//创建dataframe

val df = spark.createDataFrame(rdd, schema)

不过,我们可以把文件结构当做参数来使用,通过rdd自动产生schema和row,不用自己手动生成。

import org.apache.spark.sql.types._ //传入属性参数

val schemaString = " id name create_time"

//解析参数变成StructField

val fields = schemaString.split(" ")

.map(fieldName => StructField(fieldname, StringType, nullable = true))

//定义dataframe的结构的schema

val schema = StructType(fields) //定义dataframe内容的rdd

val lines = sc.textFile("file:///people.txt")

val rdd = lines.spilt(_.split(","))

.map(attributes=>ROW(attributes(0),attributes(1).trim) ) //创建dataframe

val df = spark.createDataFrame(rdd, schema)

3.通过反射机制创建DataFrame

首先要定义一个case class,因为只有case class才能被Spark隐式转化为DataFrame

import org.apache.spark.sql.catalyst.encoders.ExpressionEncoder

import org.apache.spark.sql.Encoder

import spark.implicits._

//创建匹配类

case class Person(id:Int,name:String,age:Long)

//读取文件生成rdd

val rdd = sc.textFile("file:///")

//通过匹配类把rdd转化成dataframe

val df = rdd.map(_.split(","))

.map(attributes => Person(attributes(0),attributes(1),attributes(2).trim.toInt)) .toDF()

4.通过文件直接创建DataFrame

(1)使用parquet文件read创建

val df = spark.read.parquet("hdfs:/path/to/file")

(2)使用json文件read创建

val df = spark.read.json("examples/src/main/resources/people.json")

(3)使用csv文件load创建

val df = spark.read

.format("com.databricks.spark.csv")

.option("header", "true") //reading the headers

.option("mode", "DROPMALFORMED")

.load("csv/file/path")

(4)使用Hive表创建

spark.table("test.person") // 库名.表名 的格式

.registerTempTable("person") // 注册成临时表

spark.sql(

"""

| select *

| from person

| limit 10

""".stripMargin).show()

记得,最后我们要调用spark.stop()来关闭SparkSession。

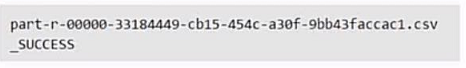

5.保存

(1)通过df.write.format().save("file:///")保存

write.format()支持输出的格式有 JSON、parquet、JDBC、orc、csv、text等文件格式

,save()定义保存的位置

当我们保存成功后可以在保存位置的目录下看到文件,但是这个文件并不是一个文件而是一个目录。

里面的内容一般为

不用担心,这是没错的。

我们读取的时候,并不需要使用文件夹里面的part-xxxx文件,直接读取目录即可。

(2)通过df.rdd.saveAsTextFile("file:///")转化成rdd再保存

我们对于不同格式的文件读写来说,我们一般使用两套对应方式

val df = spark.read.格式("file:///")//读取文件

df.write.格式("file:///")//保存文件

val df = spark.read.format("").load("file:///")//读取文件

df.write.save("file:///")//保存文件

具体read和load方法有什么不同,我还不是很清楚,弄明白了回来补充。

6.通过JDBC创建DataFrame

我们在启动Spark-shell或者提交任务的时候需要添加相应的jar包

spark-shell(spark-submit)

--jars /usr/local/spark/mysql-connector-java-5.1.40/mysql-connector-java-5.1.40-bin.jar \

--driver-class-path /usr/local/spark/mysql-connector-java-5.1.40-bin.jar

val jdbcDf = spark.read.format("jdbc")

.option("driver", "com.mysql.jdbc.Driver") //驱动

.option("url", "jdbc:mysql://ip:3306") //数据库地址

.option("dbtable", "db.user_test") //表名:数据库名.表名

.option("user", "test") //用户名

.option("password", "123456") //密码

.load()

jdbcDf.show()

【sparkSQL】创建DataFrame及保存的更多相关文章

- 【Spark篇】---SparkSQL初始和创建DataFrame的几种方式

一.前述 1.SparkSQL介绍 Hive是Shark的前身,Shark是SparkSQL的前身,SparkSQL产生的根本原因是其完全脱离了Hive的限制. SparkSQL支持查询原 ...

- JAVA SparkSQL初始和创建DataFrame的几种方式

建议参考SparkSQL官方文档:http://spark.apache.org/docs/latest/sql-programming-guide.html 一.前述 1.SparkSQ ...

- 大数据学习day24-------spark07-----1. sortBy是Transformation算子,为什么会触发Action 2. SparkSQL 3. DataFrame的创建 4. DSL风格API语法 5 两种风格(SQL、DSL)计算workcount案例

1. sortBy是Transformation算子,为什么会触发Action sortBy需要对数据进行全局排序,其需要用到RangePartitioner,而在创建RangePartitioner ...

- Spark SQL初始化和创建DataFrame的几种方式

一.前述 1.SparkSQL介绍 Hive是Shark的前身,Shark是SparkSQL的前身,SparkSQL产生的根本原因是其完全脱离了Hive的限制. SparkSQL支持查询原 ...

- SparkSQL和DataFrame

SparkSQL和DataFrame SparkSQL简介 Spark SQL是Spark用来处理结构化数据的一个模块,它提供了一个编程抽象叫做DataFrame并且作为分布式SQL查询引擎的作用.它 ...

- Spark之 SparkSql、DataFrame、DataSet介绍

SparkSql SparkSql是专门为spark设计的一个大数据仓库工具,就好比hive是专门为hadoop设计的一个大数据仓库工具一样. 特性: .易整合 可以将sql查询与spark应用程序进 ...

- 小记--------sparksql和DataFrame的小小案例java、scala版本

sparksql是spark中的一个模块,主要用于进行结构化数据的处理,他提供的最核心的编程抽象,就是DataFrame.同时,sparksql还可以作为分布式的sql查询引擎. 最最重要的功能就是从 ...

- Spark Java创建DataFrame

以前用Python和Scala操作Spark的时候比较多,毕竟Python和Scala代码写起来要简洁很多. 今天一起来看看Java版本怎么创建DataFrame,代码写起来其实差不多,毕竟公用同一套 ...

- 大数据学习day25------spark08-----1. 读取数据库的形式创建DataFrame 2. Parquet格式的数据源 3. Orc格式的数据源 4.spark_sql整合hive 5.在IDEA中编写spark程序(用来操作hive) 6. SQL风格和DSL风格以及RDD的形式计算连续登陆三天的用户

1. 读取数据库的形式创建DataFrame DataFrameFromJDBC object DataFrameFromJDBC { def main(args: Array[String]): U ...

随机推荐

- Linux(2)- linux目录结构、shell基本命令

一.Linux之文档与目录结构 1.Linux文件系统结构 Linux目录结构的组织形式和Windows有很大的不同.Linux没有“盘(如C盘.D盘.E盘)”的概念,而是建立一个根"/&q ...

- 生成vuejs项目

生成项目 npm i -g vue-cli > mkdir my-project && cd my-project > vue init webpack npm i ...

- (2.2)学习笔记之mysql基础操作(登录及账户权限设置)

本系列学习笔记主要讲如下几个方面: 本文笔记[三:mysql登录][四:账户权限设置][五:mysql数据库安全配置] 三.mysql登录 常用登录方式如下: 四.账户权限设置 (4.1)查看用户表, ...

- 006-HotSpot JVM收集器

一.概述 1.1.图解 上面有7中收集器,分为两块,上面为新生代收集器,下面是老年代收集器.如果两个收集器之间存在连线,就说明它们可以搭配使用. JVM给出了3类选择:串行收集器.并行收集器.并发收集 ...

- (转)Nginx反向代理设置 从80端口转向其他端口

from :http://www.cnblogs.com/wuyou/p/3455381.html Nginx反向代理设置 从80端口转向其他端口 反向代理(Reverse Proxy)方式是指以 ...

- LightOJ - 1356 Prime Independence (数论+二分图匹配)

题意:有N个数的集合,其中选出若干个数组成一个子集,要求这个子集中的任意两个数a,b都不能通过a=k*b得到,其中k是一个素数.求这个子集最大的size. 分析:集合中任意两数的关系是二者之间是否之差 ...

- 单元测试JUnit 4

介绍 JUnit 4.x 是利用了 Java 5 的特性(Annotation)的优势,使得测试比起 3.x 版本更加的方便简单,JUnit 4.x 不是旧版本的简单升级,它是一个全新的框架,整个 ...

- display:inline-block; 去除间隙的方法 总结:

个人常用: 如: <ul> <li><a href="#" >实时数据</a></li> <li><a ...

- libvirt-qemu-虚拟机设备热插拔

cpu热插拔 # virsh setvcpus $domain_name --count 4 --live (--config可写入配置文件永久保存) #前提条件和后续激活参考<libvirt- ...

- 【WIN7】windows\system32 下的几乎所有文件的简单说明【2】

1: System32的详解 C:\WINDOWS\system32... 2: 3: 这个 system32 文件夹中包含了大量的用于 Windows 的文件. 这里主要用于存储 DLL 文件, ...