利用Java API通过路径过滤上传多文件至HDFS

在本地文件上传至HDFS过程中,很多情况下一个目录包含很多个文件,而我们需要对这些文件进行筛选,选出符合我们要求的文件,上传至HDFS。这时就需要我们用到文件模式。 在项目开始前,我们先掌握文件模式

1、文件模式

在某个单一操作中处理一系列文件是很常见的。例如一个日志处理的MapReduce作业可能要分析一个月的日志量。如果一个文件一个文件或者一个目录一个目录的声明那就太麻烦了,我们可以使用通配符(wild card)来匹配多个文件(这个操作也叫做globbing)。

Hadoop提供了两种方法来处理文件组:

public FileStatus[] globStatus(Path pathPattern) throws IOException; public FileStatus[] globStatus(Path pathPattern, PathFilter filter) throws IOException;

- PathFilter

使用文件模式有时候并不能有效的描述你想要的一系列文件,例如如果你想排除某个特定文件就很难。所以FileSystem的listStatus()和globStatus()方法就提供了一个可选参数:PathFilter——它允许你一些更细化的控制匹配:

package org.apache.hadoop.fs; public interface PathFilter

{

boolean accept(Path path);

}

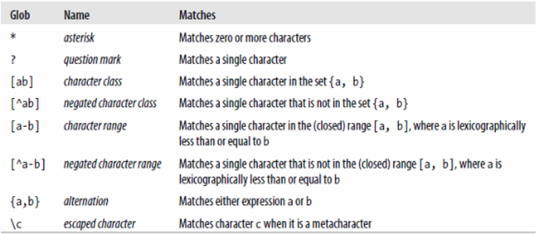

- Hadoop中的匹配符与Unix中bash相同,如下图所示:、

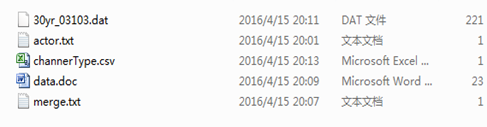

2、数据

我们利用通配符和PathFilter 对象,将本地多种格式的文件上传至 HDFS,并过滤掉txt文本格式以外的文件

数据我随便造了些,如下

3、分析

基于需求,我们通过以下两步完成:

1、首先使用globStatus(Path pathPattern, PathFilter filter),完成文件格式过滤,获取所有 txt 格式的文件。

2、然后使用 Java API 接口 copyFromLocalFile,将所有 txt 格式的文件上传至 HDFS

4、实现

首先定义一个类 RegexAcceptPathFilter实现 PathFilter,过滤掉 txt 文本格式以外的文件。

/**

* @ProjectName PathFilter

* @PackageName com.buaa

* @ClassName RegexAcceptPathFilter

* @Description 只接受符合regex的文件

* @Author 刘吉超

* @Date 2016-04-15 20:39:21

*/

public static class RegexAcceptPathFilter implements PathFilter {

private final String regex; public RegexAcceptPathFilter(String regex) {

this.regex = regex;

} @Override

public boolean accept(Path path) {

boolean flag = path.toString().matches(regex);

// 只接受符合regex的文件

return flag;

}

}

如果要接收 regex格式的文件,则accept()方法就return flag; 如果想要过滤掉regex格式的文件,则accept()方法就return !flag。

接下来在 uploadFile方法中,使用globStatus方法获取所有txt文件,然后通过copyFromLocalFile方法将文件上传至HDFS。

/**

* 过滤文件格式 将多个文件上传至 HDFS

*

* @param srcPath 源路径

* @param destPath 目标路径

* @param filter 正则

* @throws URISyntaxException

* @throws IOException

*/

public static void uploadFile(String srcPath,String destPath,String filter) throws URISyntaxException, IOException {

// 读取配置文件

Configuration conf = new Configuration();

// 远端文件系统

URI uri = new URI(HDFSUri.trim());

FileSystem remote = FileSystem.get(uri,conf);;

// 获得本地文件系统

FileSystem local = FileSystem.getLocal(conf); // 只上传srcPath目录下符合filter条件的文件

FileStatus[] localStatus = local.globStatus(new Path(srcPath), new RegexAcceptPathFilter(filter));

// 获得所有文件路径

Path[] listedPaths = FileUtil.stat2Paths(localStatus); if(listedPaths != null){

for(Path path : listedPaths){

// 将本地文件上传到HDFS

remote.copyFromLocalFile(path, new Path(HDFSUri + destPath));

}

}

}

在 main() 方法在调用 uploadFile,执行多文件上传至 HDFS

public static void main(String[] args) throws IOException,URISyntaxException {

// 第一个参数:代表是源路径

// 第二个参数:代表是目录路径

// 第三个参数:代表是正则,这里我们只有上传txt文件,所以正则是^.*txt$

uploadFile("D:\\data\\*","/buaa/data","^.*txt$");

}

利用Java API通过路径过滤上传多文件至HDFS的更多相关文章

- java调用svnkit工具类上传本地文件到svn服务器

package org.jenkinsci.plugins.svn.upload.step; import java.io.*; import org.tmatesoft.svn.core.SVNCo ...

- 【转】Java IOUtils方式上传下载文件 on HDFS

[From]https://www.cnblogs.com/areyouready/p/9795442.html package com.css.hdfs04; import java.io.File ...

- Hadoop HDFS编程 API入门系列之路径过滤上传多个文件到HDFS(二)

不多说,直接上代码. 代码 package zhouls.bigdata.myWholeHadoop.HDFS.hdfs6; import java.io.IOException;import jav ...

- Spring学习---Spring中利用组件实现从FTP服务器上传/下载文件

FtpUtil.java import java.io.File; import java.io.FileInputStream; import java.io.FileNotFoundExcepti ...

- 上传本地文件到HDFS

源代码: import java.io.IOException; import org.apache.hadoop.conf.Configuration; import org.apache.hado ...

- 利用Python,方便局域网内上传下载文件

因为一直在用windows系统,最近需要用到linux的服务器,两个电脑之间总是需要来回拷贝文件 这样使得很繁琐,之前一直在用Python,开启一个简单的服务器,可以在另外一台同一局域网下的电脑,在线 ...

- eclipse (ADT) svn插件 过滤上传的 文件 文件夹 一劳永逸

其实很简单哈,过滤的有三种类型,1.文件.2.文件夹.3.android的target 在ADT中 window->preferences-> 会打开如下界面 ignore就是忽视的意思 ...

- Hadoop Shell命令(基于linux操作系统上传下载文件到hdfs文件系统基本命令学习)

Apache-->hadoop的官网文档命令学习:http://hadoop.apache.org/docs/r1.0.4/cn/hdfs_shell.html FS Shell 调用文件系统( ...

- flume 增量上传日志文件到HDFS中

1.采集日志文件时一个很常见的现象 采集需求:比如业务系统使用log4j生成日志,日志内容不断增加,需要把追加到日志文件中的数据实时采集到hdfs中. 1.1.根据需求,首先定义一下3大要素: 采集源 ...

随机推荐

- python中的buildin函数详解(第一篇)

这会是很长的一个帖子,因为我打算从python最基础的东西开始,尝试去完全的掌握它,buildin中有一些常用的函数比如 abs, open, setattr, getattr, 大家都很了解他们的用 ...

- 对rsync进行封装的shell脚本

抓取 #!/bin/bash . push.sh # 错误处理:尝试查找备份文件 function onError() { local errFile="err" local se ...

- 关于scroll无法绑定的问题

关于jQuery的scroll([[data],fn])事件, 概述是:当用户滚动指定的元素(元素包括:所有可滚动的元素和 window 对象)时,会触发该事件. 如绑定窗口对象: $(window) ...

- spoj cot: Count on a tree 主席树

10628. Count on a tree Problem code: COT You are given a tree with N nodes.The tree nodes are number ...

- Java cookie的使用

1.cookie是什么? cookie是web应用当中非常常用的一种技术,用于储存某些特定的用户信息. 2.cookie的作用? 在用户登陆时将用户的信息存放在cookie中,用户在一定的时间中再次登 ...

- VS2010编译、调用Lua程序

一) .建立lua源代码工程,编译lua的静态库 1.下载Lua源码 http://www.lua.org/download.html a 下载后解压到一个目录下,这里假设解压到D:\lua-5.1. ...

- DLL ActiveForm 线程同步问题

本文试着从分析Synchronize同步执行的实现机制入手,来解决DLL/ActiveForm中线程同步的问题. 线程中进行同步时调用的Synchronize函数,仅仅是把调用调用线程.调用方法地址. ...

- c#后台验证

#region 后台验证 panda /// 验证电话号码的主要代码如下: public bool IsTelephone(string str_telephone) { return System. ...

- 解决导入lib,关联源码问题

关联源代码:在libs目录下新建文件,以jar包全名(包括.jar)为文件名称,以.properties结尾 在文件中新建键值对:src=jar包源代码绝对路径:根据提示将单斜线变成双斜线, 然后cl ...

- 新学Linux时遇到的一些问题

1.如何进入到Linux的命令终端 (1)按ctrl+alt+t (2)按ctrl+alt+(F1-F6都可以),按ctrl+alt+F7退出 2.按ctrl+alt+(F1-F6)进入命令终端,登录 ...