sparkthriftserver启动及调优

Sparkthriftserver启用及优化

1、 概述

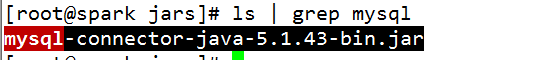

sparkthriftserver用于提供远程odbc调用,在远端执行hive sql查询。默认监听10000端口,Hiveserver2默认也是监听10000端口,为了避免冲突,需要修改sparkthriftserver的端口。启用sparkthriftserver需要将hive-site.xml文件copy到spakr的conf目录下,元数据存储在mysql中,所以还需要mysql-connector-java-5.1.43-bin.jar,用于连接mysql。

2、 配置

1)hive-site.xml配置文明如下:

# cat hive-site.xml

<configuration>

<property>

<name>hive.server2.thrift.bind.host</name>

<value>0.0.0.0</value>

<description>metadata is stored in a MySQL server</description>

</property>

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/metastore?createDatabaseIfNotExist=true</value>

<description>metadata is stored in a MySQL server</description>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

<description>MySQL JDBC driver class</description>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description>user name for connecting to mysql server</description>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>1qaz*@WSX</value>

<description>password for connecting to mysql server</description>

</property>

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/data/metastore/</value>

<description>location of default database for the warehouse</description>

</property>

<property>

<name>bson.output.build_splits</name>

<value>false</value>

</property>

<property>

<name>bson.split.write_splits</name>

<value>false</value>

</property>

<property>

<name>bson.split.read_splits</name>

<value>false</value>

</property>

<property>

<name>hive.cli.print.header</name>

<value>true</value>

</property>

<property>

<name>mapred.reduce.child.java.opts</name>

<value>-Xmx2g</value>

</property>

</configuration>

2)首先将下载好的mysql-connector-java-5.1.43-bin.jar复制到spark的jars目录下

重新启动spark服务,会将jar加载进去。本文用的是将metastore存储到mysql,通过如下配置实现:

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/metastore?createDatabaseIfNotExist=true</value>

<description>metadata is stored in a MySQL server</description>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

<description>MySQL JDBC driver class</description>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

<description>user name for connecting to mysql server</description>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>1qaz*@WSX</value>

<description>password for connecting to mysql server</description>

</property>

配置完成后,需要到mysql里面进行授权,例如本例:

>grant metastore.* to root@localhost identified by ‘1qaz*@WSX’;

>flush privileges;

3、 启动

启动sparkthriftserver很简单,只需要到spark的sbin目录下,有个start-thriftserver.sh,直接执行这个脚本就可以成功启动了。如果内网有防火墙只需要开放端口或做端口映射就可以了,这里不做详尽的介绍。

#cd /data/spark-2.2.0-bin-hadoop2.7/sbin

#./start-thriftserver.sh

这样一个默认配置的服务就启动好了,可以通过远端下载相应的ODBC工具进行连接,我们需要tableau使用,所以下载Simba Spark 1.2 64-bit。具体安装配置见另外一篇文章:。

这样测试环境可以使用,但是线上用这样的配置就会经常发生服务蹦掉现象,所以需要进行优化。

4、 优化

优化主要在两个方面入手:1是spark;2是thriftserver

Spark优化,见spark的文章。此处只对2进行介绍:

启动的时候指定executor-memory、total-executor-cores:

启动方式如下:

./start-thriftserver.sh --hiveconf hive.server2.thrift.port=10000 --master spark://spark:7077 --driver-class-path /data/spark-2.2.0-bin-hadoop2.7/jars/mysql-connector-java-5.1.43-bin.jar --executor-memory 5g --total-executor-cores 5

--hiveconf 指定启动的端口,也可以写在hive-site.xml里面;--master指定spark的地址 spark://spark:7077 第二个spark是spark所在服务器的主机名,需要在hosts文件里面做一下解析,添加一条记录。

--executor-memory 5g 指定每个executor占用的内存大小,我这里设置了5g这个需要根据自己的环境和数据量的大小来确定;--total-executor-cores 5指定占用的cpu核数,这个值需要根据当前服务器的总的cpu核数以及其他服务使用cpu的情况来确定。此处指定的内存和cpu的core是永久占用的。可以在spark UI来查看。

5、为了方便启动和重启,制作了一个启动脚本

#cat /etc/init.d/spark-thriftserver.sh

#!/bin/bash

# chkconfig: 90 79 80

# descriptions: This script is using to satrt|stop spark-thriftserver

pid=`netstat -tunlp | grep 10000| awk '{print $NF}'|awk -F "/" '{print $1}'`

case $1 in

start)

cd /data/spark-2.2.0-bin-hadoop2.7/sbin/

./start-thriftserver.sh --hiveconf hive.server2.thrift.port=10000 --master spark://spark:7077 --driver-class-path /data/spark-2.2.0-bin-hadoop2.7/jars/mysql-connector-java-5.1.43-bin.jar --executor-memory 5g --total-executor-cores 5

;;

stop)

kill -9 $pid

;;

*)

echo "Usage: $0 satrt|stop"

esac

sparkthriftserver启动及调优的更多相关文章

- jvm启动参数调优

1.背景 eclipse启动了一个项目,用了15分钟,我佛了,在家办公也懒得弄一直没管,好嘛,越用越气,越来越慢,现在启动一次要半小时了,气不气,然后下定决心调优一下. 2.知识库(自认为调优重要的几 ...

- Intellj IDEA 启动参数调优

(修改前记得备份) 修改IntellJ/bin/idea.exe.vmoptions修改成 -Xms512m -Xmx512m -Xmn164m -XX:MaxPermSize=250m -XX:Re ...

- 技能篇:linux服务性能问题排查及jvm调优思路

只要业务逻辑代码写正确,处理好业务状态在多线程的并发问题,很少会有调优方面的需求.最多就是在性能监控平台发现某些接口的调用耗时偏高,然后再发现某一SQL或第三方接口执行超时之类的.如果你是负责中间件或 ...

- [hadoop] 集群启动和内存调优

1.启动Hadoop集群 #首先查看下zoo.cfg里面配置的server.id和集群主机的id是否一致 #如果不一致会造成yarn控制不了从节点的启动 cat /home/hadoop/zookee ...

- Eclipse的设置、调优、使用(解决启动卡顿等问题)----转

eclipse调优 一般在不对eclipse进行相关设置的时候,使用eclipse总是会觉得启动好慢,用起来好卡,其实只要对eclipse的相关参数进行一些配置,就会有很大的改善. 加快启动速度 1. ...

- Tomcat性能调优后, 启动出现警告问题 [did not find a matching property.]

http://blog.csdn.net/dracotianlong/article/details/8963594 Tomcat性能调优后, 启动出现警告问题 [did not find a mat ...

- eclipse定制化配置调优、初始化配置指南、可以解决启动慢等问题

配置eclipse的jvm参数 打开eclipse根目录下的eclipse.ini在最后面加上如下的jvm参数 -Xms400m -Xmx1400m -XX:NewSize=128m -XX:MaxN ...

- Java启动参数及调优

java启动参数共分为三类: 其一是标准参数(-),所有的JVM实现都必须实现这些参数的功能,而且向后兼容:其二是非标准参数(-X),默认jvm实现这些参数的功能,但是并不保证所有jvm实现都满足,且 ...

- 阿里云下 centos7下启动程序总是被killed ,看内存占用情况以检查哪些服务存在问题并调整参数作调优

很久不搭理自己的网站了,几天突然发现启动程序总是被killed, 于是查看了系统日志 vi /var/log/messages 发现出现 kernel: Out of memory: Kill pro ...

随机推荐

- 对SpringDAO层支持的总结

1.问题 1.JDBC/ORM框架(如Hibernate)开发中编程模型有哪些缺点? 如JDBC 2.解决方案(模板设计模式,本质:将可变的和不可变的分离) 模板方法模式:定义操作的步骤(固定的 ...

- 最佳编程字体:M+

英文原文:The Best Font for Programming: M+ 程序员的最佳等宽字体是 M+. 一个偶然机会遇到了这个字体,在命运多舛的 kod 编辑器体验了.这个字体非比寻常,我坚持 ...

- Android-控制整个APP的异常收集与处理

控制整个App的异常收集与处理,使用前记得要在Application中初始化initCrasHandler CrasHandler APP异常收集类: package common.library.e ...

- Gitlab搭建安装及使用中遇到的问题。

一.CentOS7安装gitlab-ce 1.下载及安装rpm软件包. 下载RPM包 curl -LJO https://mirrors.tuna.tsinghua.edu.cn/gitlab-ce/ ...

- 使用jetty-maven-plugin运行maven多项目

1.准备工作 org.eclipse.jetty jetty-maven-plugin 9.2.11.v20150529 jdk 1.7 maven 3.1 2.采用maven管理多项目 ...

- netcore 发布 到 windows server IIS 可能会报错

当发布netcore 到windows server iis可能会报这种错:An error occurred while starting the application 不要慌,这个时候可能是你用 ...

- CSS精灵技术

在CSDN中浏览博客时,在博客的结束有上一篇和下一篇的按钮,当我们把鼠标放上去的时候,可以看到这两个按钮会进行颜色的改变,这种技术称为CSS精灵技术.通过查看源发现,其实他是通过超级链接的伪类实现的, ...

- Hbuilder系列索引

『原创』手把手教你搭建一个实用的油耗App(一)

- Linux中目录proc/net/dev详解

在Linux系统中,系统调用是操作系统提供给应用程序使用操作系统服务的重要接口,但同时也正是通过系统调用机制,操作系统屏蔽了用户直接访问系统内核的可能性.幸运的是Linux提供了LKM机制可以使我们在 ...

- L-BFGS算法介绍

可以看出,拟牛顿法每次迭代只需要根据前次迭代的即可以计算出,不需要求出Hesse矩阵的逆. 2.4 L-BFGS(limited-memory BFGS) BFGS算法中每次迭代计算需要前次迭代得到的 ...