神经网络(BP)算法Python实现及简单应用

首先用Python实现简单地神经网络算法:

import numpy as np

# 定义tanh函数

def tanh(x):

return np.tanh(x)

# tanh函数的导数

def tan_deriv(x):

return 1.0 - np.tanh(x) * np.tan(x)

# sigmoid函数

def logistic(x):

return 1 / (1 + np.exp(-x))

# sigmoid函数的导数

def logistic_derivative(x):

return logistic(x) * (1 - logistic(x))

class NeuralNetwork:

def __init__(self, layers, activation='tanh'):

"""

神经网络算法构造函数

:param layers: 神经元层数

:param activation: 使用的函数(默认tanh函数)

:return:none

"""

if activation == 'logistic':

self.activation = logistic

self.activation_deriv = logistic_derivative

elif activation == 'tanh':

self.activation = tanh

self.activation_deriv = tan_deriv

# 权重列表

self.weights = []

# 初始化权重(随机)

for i in range(1, len(layers) - 1):

self.weights.append((2 * np.random.random((layers[i - 1] + 1, layers[i] + 1)) - 1) * 0.25)

self.weights.append((2 * np.random.random((layers[i] + 1, layers[i + 1])) - 1) * 0.25)

def fit(self, X, y, learning_rate=0.2, epochs=10000):

"""

训练神经网络

:param X: 数据集(通常是二维)

:param y: 分类标记

:param learning_rate: 学习率(默认0.2)

:param epochs: 训练次数(最大循环次数,默认10000)

:return: none

"""

# 确保数据集是二维的

X = np.atleast_2d(X)

temp = np.ones([X.shape[0], X.shape[1] + 1])

temp[:, 0: -1] = X

X = temp

y = np.array(y)

for k in range(epochs):

# 随机抽取X的一行

i = np.random.randint(X.shape[0])

# 用随机抽取的这一组数据对神经网络更新

a = [X[i]]

# 正向更新

for l in range(len(self.weights)):

a.append(self.activation(np.dot(a[l], self.weights[l])))

error = y[i] - a[-1]

deltas = [error * self.activation_deriv(a[-1])]

# 反向更新

for l in range(len(a) - 2, 0, -1):

deltas.append(deltas[-1].dot(self.weights[l].T) * self.activation_deriv(a[l]))

deltas.reverse()

for i in range(len(self.weights)):

layer = np.atleast_2d(a[i])

delta = np.atleast_2d(deltas[i])

self.weights[i] += learning_rate * layer.T.dot(delta)

def predict(self, x):

x = np.array(x)

temp = np.ones(x.shape[0] + 1)

temp[0:-1] = x

a = temp

for l in range(0, len(self.weights)):

a = self.activation(np.dot(a, self.weights[l]))

return a

使用自己定义的神经网络算法实现一些简单的功能:

小案例:

from NN.NeuralNetwork import NeuralNetwork

import numpy as np

nn = NeuralNetwork([2, 2, 1], 'tanh')

temp = [[0, 0], [0, 1], [1, 0], [1, 1]]

X = np.array(temp)

y = np.array([0, 1, 1, 0])

nn.fit(X, y)

for i in temp:

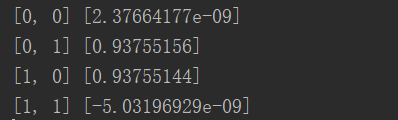

print(i, nn.predict(i))

发现结果基本机制,无限接近0或者无限接近1

第二个例子:识别图片中的数字

导入数据:

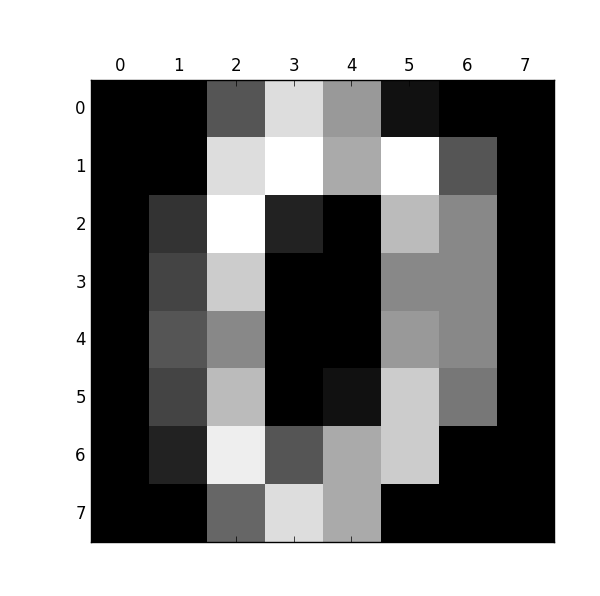

from sklearn.datasets import load_digits import pylab as pl digits = load_digits() print(digits.data.shape) pl.gray() pl.matshow(digits.images[0]) pl.show()

观察下:大小:(1797, 64)

数字0

接下来的代码是识别它们:

import numpy as np

from sklearn.datasets import load_digits

from sklearn.metrics import confusion_matrix, classification_report

from sklearn.preprocessing import LabelBinarizer

from NN.NeuralNetwork import NeuralNetwork

from sklearn.cross_validation import train_test_split

# 加载数据集

digits = load_digits()

X = digits.data

y = digits.target

# 处理数据,使得数据处于0,1之间,满足神经网络算法的要求

X -= X.min()

X /= X.max()

# 层数:

# 输出层10个数字

# 输入层64因为图片是8*8的,64像素

# 隐藏层假设100

nn = NeuralNetwork([64, 100, 10], 'logistic')

# 分隔训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y)

# 转化成sklearn需要的二维数据类型

labels_train = LabelBinarizer().fit_transform(y_train)

labels_test = LabelBinarizer().fit_transform(y_test)

print("start fitting")

# 训练3000次

nn.fit(X_train, labels_train, epochs=3000)

predictions = []

for i in range(X_test.shape[0]):

o = nn.predict(X_test[i])

# np.argmax:第几个数对应最大概率值

predictions.append(np.argmax(o))

# 打印预测相关信息

print(confusion_matrix(y_test, predictions))

print(classification_report(y_test, predictions))

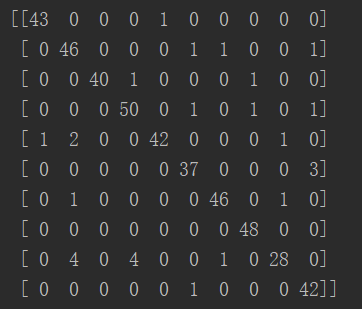

结果:

矩阵对角线代表预测正确的数量,发现正确率很多

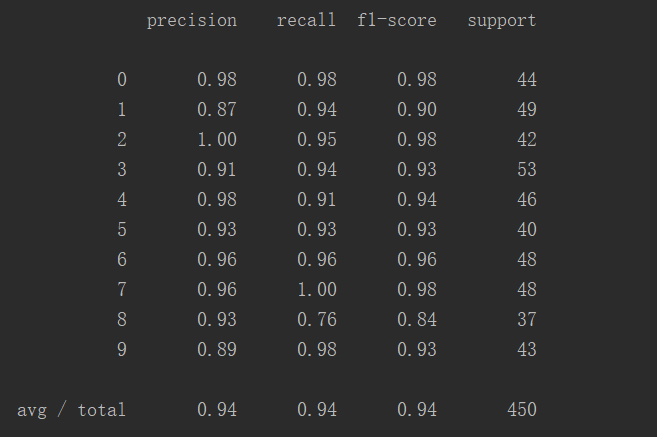

这张表更直观地显示出预测正确率:

共450个案例,成功率94%

神经网络(BP)算法Python实现及简单应用的更多相关文章

- 神经网络BP算法C和python代码

上面只显示代码. 详BP原理和神经网络的相关知识,请参阅:神经网络和反向传播算法推导 首先是前向传播的计算: 输入: 首先为正整数 n.m.p.t,分别代表特征个数.训练样本个数.隐藏层神经元个数.输 ...

- DNN的BP算法Python简单实现

BP算法是神经网络的基础,也是最重要的部分.由于误差反向传播的过程中,可能会出现梯度消失或者爆炸,所以需要调整损失函数.在LSTM中,通过sigmoid来实现三个门来解决记忆问题,用tensorflo ...

- 多层神经网络BP算法 原理及推导

首先什么是人工神经网络?简单来说就是将单个感知器作为一个神经网络节点,然后用此类节点组成一个层次网络结构,我们称此网络即为人工神经网络(本人自己的理解).当网络的层次大于等于3层(输入层+隐藏层(大于 ...

- kNN算法python实现和简单数字识别

kNN算法 算法优缺点: 优点:精度高.对异常值不敏感.无输入数据假定 缺点:时间复杂度和空间复杂度都很高 适用数据范围:数值型和标称型 算法的思路: KNN算法(全称K最近邻算法),算法的思想很简单 ...

- 深度学习——前向传播算法和反向传播算法(BP算法)及其推导

1 BP算法的推导 图1 一个简单的三层神经网络 图1所示是一个简单的三层(两个隐藏层,一个输出层)神经网络结构,假设我们使用这个神经网络来解决二分类问题,我们给这个网络一个输入样本,通过前向运算得到 ...

- 神经网络中 BP 算法的原理与 Python 实现源码解析

最近这段时间系统性的学习了 BP 算法后写下了这篇学习笔记,因为能力有限,若有明显错误,还请指正. 什么是梯度下降和链式求导法则 假设我们有一个函数 J(w),如下图所示. 梯度下降示意图 现在,我们 ...

- BP神经网络原理及python实现

[废话外传]:终于要讲神经网络了,这个让我踏进机器学习大门,让我读研,改变我人生命运的四个字!话说那么一天,我在乱点百度,看到了这样的内容: 看到这么高大上,这么牛逼的定义,怎么能不让我这个技术宅男心 ...

- BP算法从原理到python实现

BP算法从原理到实践 反向传播算法Backpropagation的python实现 觉得有用的话,欢迎一起讨论相互学习~Follow Me 博主接触深度学习已经一段时间,近期在与别人进行讨论时,发现自 ...

- 从 0 开始机器学习 - 神经网络反向 BP 算法!

最近一个月项目好忙,终于挤出时间把这篇 BP 算法基本思想写完了,公式的推导放到下一篇讲吧. 一.神经网络的代价函数 神经网络可以看做是复杂逻辑回归的组合,因此与其类似,我们训练神经网络也要定义代价函 ...

随机推荐

- [转]windows中断与共享的连接(samba)

问题:window下当成功登录到samba服务器上的共享的目录的时候,若要是再系想登录此服务器上另外一个共享目录时,会弹出登录窗口. 但是不管输入的用户名和密码对错都会提示. “不允许一个用户使用一个 ...

- mercury水星路由wifi连接不上的坑

如题,房东发给我的水星路由,是有些bug的,比方说我的手机会偶尔某天连上了没有网络,但是其他wifi设备和有线就没问题. 这种wifi网络很差甚至没有网络的问题会随机在你的wifi设备上发生,你甚至连 ...

- nodeJS接入微信公众平台开发

一.写在前面的话 Node.js是一个开放源代码.跨平台的JavaScript语言运行环境,采用Google开发的V8运行代码,使用事件驱动.非阻塞和异步输入输出模型等技术来提高性能,可优化应用程 ...

- centos6.6安装Elasticsearch

1. 安装jar8 yum list java-1.8* sudo yum install java-1.8.0-openjdk* -y java --version 2. 安装elasticsear ...

- SQL: Cannot create JDBC driver of class '' for connect URL

使用数据库数据源的web 项目,发布后,访问数据库500报错: 浏览器端: 控制台: 数据库连接池在不启动Tomcat的情况下,测试类通过,没有问题. 一旦在服务器发布,就会出现问题,考虑是Tomca ...

- Lambda表达式按字段名字排序

using System; using System.Collections.Generic; using System.Linq; using System.Linq.Expressions; us ...

- Oracle 中DATE类型的计算

select sysdate,add_months(sysdate,12) from dual; --加1年 select sysdate,add_months(sysdate,1) f ...

- 解决sqlserver数据库表空间不自动释放问题

在项目中遇到了sql server数据库经过频繁地删减数据后,查询变慢的问题. 我把数据导到另一个库中,发现查询就很快. 查了下原因,根本原因是删除数据并不释放表空间,日志文件太过巨大的原因. 网上查 ...

- redis学习-散列表常用命令(hash)

redis学习-散列表常用命令(hash) hset,hmset:给指定散列表插入一个或者多个键值对 hget,hmget:获取指定散列表一个或者多个键值对的值 hgetall:获取所欲哦键值以及 ...

- unic

在线考试 答题剩余时间0小时51分18秒 考生须知 1.本次考试结束后,剩余补考次数:2次 2.考试时间为60分钟,超时系统自动交卷 3.本次考试满分100分(5*20道),60分通过考试 1. (单 ...