SparkSql学习笔记(包含IDEA编写的本地代码)

Spark SQL and DataFrame

1.为什么要用Spark Sql

原来我们使用Hive,是将Hive Sql 转换成Map Reduce 然后提交到集群上去执行,大大简化了编写MapReduce的程序的复杂性,由于MapReduce这种计算模型执行效率比较慢,所以Spark Sql的应运而生,它是将SparkSql转换成RDD,然后提交到集群执行,执行效率非常的快。

Spark Sql的有点:1、易整合 2、统一的数据访问方式 3、兼容Hvie 4、标准的数据连接

2、DataFrames

什么是DataFrames?

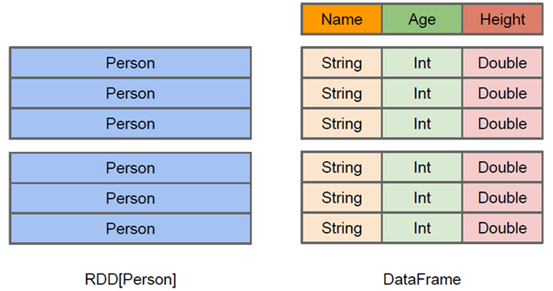

与RDD类似,DataFrames也是一个分布式数据容器,然而DataFrame更像是传统数据库的二维表格,除了数据以外,还记录数据的结构信息,即schema。同时,与Hive类似,DataFrame与支持嵌套数据类型(struct、array和map)。从API的易用性上看,DataFrame API提供的是一套高层的关系操作,比函数式的RDD API要更加友好,门槛更低。由于与R和Pandas的DataFrame类似,Spark DataFrame很好地继承了传统单机数据分析的开发体验。

创建DataFrames

在Spark SQL中SQLContext是创建DataFrames和执行SQL的入口,在spark-1。5.2中已经内置了一个sqlContext。

1.在本地创建一个文件,有三列,分别是id、name、age,用空格分隔,然后上传到hdfs上

hdfs dfs -put person.txt /

2.在spark shell执行下面命令,读取数据,将每一行的数据使用列分隔符分割

val lineRDD = sc.textFile("hdfs://hadoop01:9000/person.txt").map(_.split(" "))

3.定义case class(相当于表的schema)

case class Person(id:Int, name:String, age:Int)

4.将RDD和case class关联

val personRDD = lineRDD.map(x => Person(x(0).toInt, x(1), x(2).toInt))

5.将RDD转换成DataFrame

val personDF = personRDD.toDF

6.对DataFrame进行处理

personDF.show

代码:

object SparkSqlTest {

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local").setAppName("SQL-1")

val sc = new SparkContext(conf)

fun1(sc)

}

//定义case class 相当于表的schema

case class Person(id:Int,name:String,age:Int)

def fun1(sc:SparkContext): Unit ={

val sqlContext = new SQLContext(sc)

// 位置一般情况下是换成HDFS文件路径

val lineRdd = sc.textFile("D:\\data\\person.txt").map(_.split(" "))

val personRdd = lineRdd.map(x=>Person(x(0).toInt,x(1),x(2).toInt))

import sqlContext.implicits._

val personDF = personRdd.toDF

//注册表

personDF.registerTempTable("person_df")

//传入sql

val df = sqlContext.sql("select * from person_df order by age desc")

//将结果以JSON的方式存储到指定位置

df.write.json("D:\\data\\personOut")

sc.stop()

}

DataFrame 常用操作

DSL风格语法(个人理解短小精悍的含义)

// 查看DataFrame部分列中的内容

df.select(personDF.col("name")).show()

df.select(col = "age").show()

df.select("id").show() // 打印DataFrame的Schema信息

df.printSchema() //查询所有的name 和 age ,并将 age+2

df.select(df("id"),df("name"),df("age")+2).show() //查询所有年龄大于20的

df.filter(df("age")>20).show() // 按年龄分组并统计相同年龄人数

df.groupBy("age").count().show()

SQL风格语法(前提:需要将DataFrame注册成表)

//注册成表

personDF.registerTempTable("person_df") // 查询年龄最大的两位 并用对象接接收

val persons = sqlContext.sql("select * from person_df order by age desc limit 2")

persons.foreach(x=>print(x(0),x(1),x(2)))

通过StructType直接指定Schema

/*通过StructType直接指定Schema*/

def fun2(sc: SparkContext): Unit = {

val sqlContext = new SQLContext(sc)

val personRDD = sc.textFile("D:\\data\\person.txt").map(_.split(" "))

// 通过StructType直接指定每个字段的Schema

val schema = StructType(List(StructField("id", IntegerType, true), StructField("name", StringType, true), StructField("age", IntegerType)))

//将rdd映射到RowRDD

val rowRdd = personRDD.map(x=>Row(x(0).toInt,x(1).trim,x(2).toInt))

//将schema信息应用到rowRdd上

val dataFrame = sqlContext.createDataFrame(rowRdd,schema)

//注册

dataFrame.registerTempTable("person_struct") sqlContext.sql("select * from person_struct").show() sc.stop() }

连接数据源

/*连接mysql数据源*/

def fun3(sc:SparkContext): Unit ={

val sqlContext = new SQLContext(sc)

val jdbcDF = sqlContext.read.format("jdbc").options(Map("url"->"jdbc:mysql://192.168.180.100:3306/bigdata","driver"->"com.mysql.jdbc.Driver","dbtable"->"person","user"->"root","password"->"123456")).load()

jdbcDF.show()

sc.stop()

}

再回写到数据库中

// 写入数据库

val personTextRdd = sc.textFile("D:\\data\\person.txt").map(_.split(" ")).map(x=>Row(x(0).toInt,x(1),x(2).toInt)) val schema = StructType(List(StructField("id", IntegerType), StructField("name", StringType), StructField("age", IntegerType))) val personDataFrame = sqlContext.createDataFrame(personTextRdd,schema) val prop = new Properties()

prop.put("user","root")

prop.put("password","123456")

//写入数据库

personDataFrame.write.mode("append").jdbc("jdbc:mysql://192.168.180.100:3306/bigdata","bigdata.person",prop) sc.stop()

SparkSql学习笔记(包含IDEA编写的本地代码)的更多相关文章

- AM335x(TQ335x)学习笔记——触摸屏驱动编写

前面几篇文章已经通过配置DTS的方式完成了多个驱动的移植,接下来我们解决TQ335x的触摸驱动问题.由于种种原因,TQ335x的触摸屏驱动是以模块方式提供的,且Linux官方内核中也没有带该触摸屏的驱 ...

- SparkSQL学习笔记

概述 冠状病毒来临,宅在家中给国家做贡献之际,写一篇随笔记录SparkSQL的学习笔记,目的有二,一是记录整理之前的知识作为备忘录,二是分享技术,大家共同进步,有问题也希望大家不吝赐教.总体而言,大数 ...

- Android学习笔记(第一篇)编写第一个程序Hello World+Activity

PS:终于开始正式的搞Android了...无人带的一介菜鸟,我还是自己默默的努力吧... 学习内容: 1.编写第一个Hello World程序.. 学习Android,那么就需要有一个编译器来集 ...

- 【大数据】SparkSql学习笔记

第1章 Spark SQL概述 1.1 什么是Spark SQL Spark SQL是Spark用来处理结构化数据的一个模块,它提供了2个编程抽象:DataFrame和 DataSet,并且作为分布式 ...

- <深入理解JavaScript>学习笔记(1)_编写高质量JavaScript代码的基本要点

注:本文是拜读了 深入理解JavaScript 之后深有感悟,故做次笔记方便之后查看. JQuery是一个很强大的JavaScript 类库,在我刚刚接触JavaScript的就开始用了. JQuer ...

- ROS学习笔记三:编写第一个ROS节点程序

在编写第一个ROS节点程序之前需要创建工作空间(workspace)和功能包(package). 1 创建工作空间(workspace) 创建一个catkin_ws: #注意:如果使用sudo一次 ...

- CSS学习笔记——包含块 containing block

以下内容翻译自CSS 2.1官方文档.网址:https://www.w3.org/TR/CSS2/visudet.html#strut 有时,一个元素的盒子的位置和尺寸根据一个确定的矩形计算,这个确定 ...

- jquery学习笔记-----插件开发的编写总结

一.对jQuery对象的扩展 ;(function($){ $.fn.extend( { fun1:abc,fun2:1bc … } ) })(jQuery) 这里采用立即执行模式,即不用调用也能执 ...

- EntityFramework Core 学习笔记 —— 包含与排除属性

原文地址:https://docs.efproject.net/en/latest/modeling/included-properties.html 在模型中包含一个属性意味着 EF 拥有了这个属性 ...

随机推荐

- 小代学Spring Boot之自定义Starter

想要获取更多文章可以访问我的博客 - 代码无止境. 上一篇小代同学在Spring Boot项目中配置了数据源,但是通常来讲我们访问数据库都会通过一个ORM框架,很少会直接使用JDBC来执行数据库操作的 ...

- [HDOJ] 2026.Max Sum

2026.Max Sum (c++) Problem Description Consider the aggregate An= { 1, 2, -, n }. For example, A1={1 ...

- hibernate 命名策略

对于Java开发人员,Hibernate 3 annotations提供了非常好的方式来展示域分层.你可以很轻松的通过Hibernate自动生成需要的数据库架构,带有完整的SQL脚本.然而回到现实世界 ...

- 【iOS】UILabel 常用属性设置

UILabel 的一些常用属性,示例代码如下: // 字体大小 label.font = [UIFont systemFontOfSize:14.0]; label.font = [UIFont fo ...

- 【SVN】eclipse 安装 SVN 插件

链接:eclipse中svn插件的安装 SVN 插件地址:http://subclipse.tigris.org/servlets/ProjectProcess;jsessionid=8EB28B11 ...

- Mac Android 配置环境变量

进入终端,输入以下命令: cd ~ touch .bash_profile //没有该文件的话新建一个 vi .bash_profile //vim 形式打开 输入内容jdk变量配置内容: expor ...

- .Net集合详解

前言 前面几篇文章讲了泛型.讲了数组,都有提到集合,这一节重点对集合进行详细解说.本文主要使用各种集合类型.以至于评估其性能,针对不同的场景选择不同的集合使用. 集合分类详解 一.列表 列表的创建 v ...

- 详解 Diff 算法以及循环要加 key 值问题

上一篇文章我简述了什么是 Virtual DOM,这一章我会详细讲 Diff 算法以及为什么在 React 和 Vue 中循环都需要 key 值. 什么是 DOM Diff 算法 Web 界面其实就是 ...

- 转载 vue-awesome-swiper - 基于vue实现h5滑动翻页效果

说到h5的翻页,很定第一时间想到的是swiper.但是我当时想到的却是,vue里边怎么用swiper?! 中国有句古话叫:天塌下来有个高的顶着. 在前端圈里,总有前仆后继的仁人志士相继挥洒着热汗(这里 ...

- java8-流的操作

流的操作 流的使用一般包括三件事: 一个数据源来执行一个查询; 一个中间操作链,形成一条流的流水线; 一个终端操作,执行流水线,并能生成结果 中间操作 操作 类型 返回类型 操作参数 函数描述符 fi ...