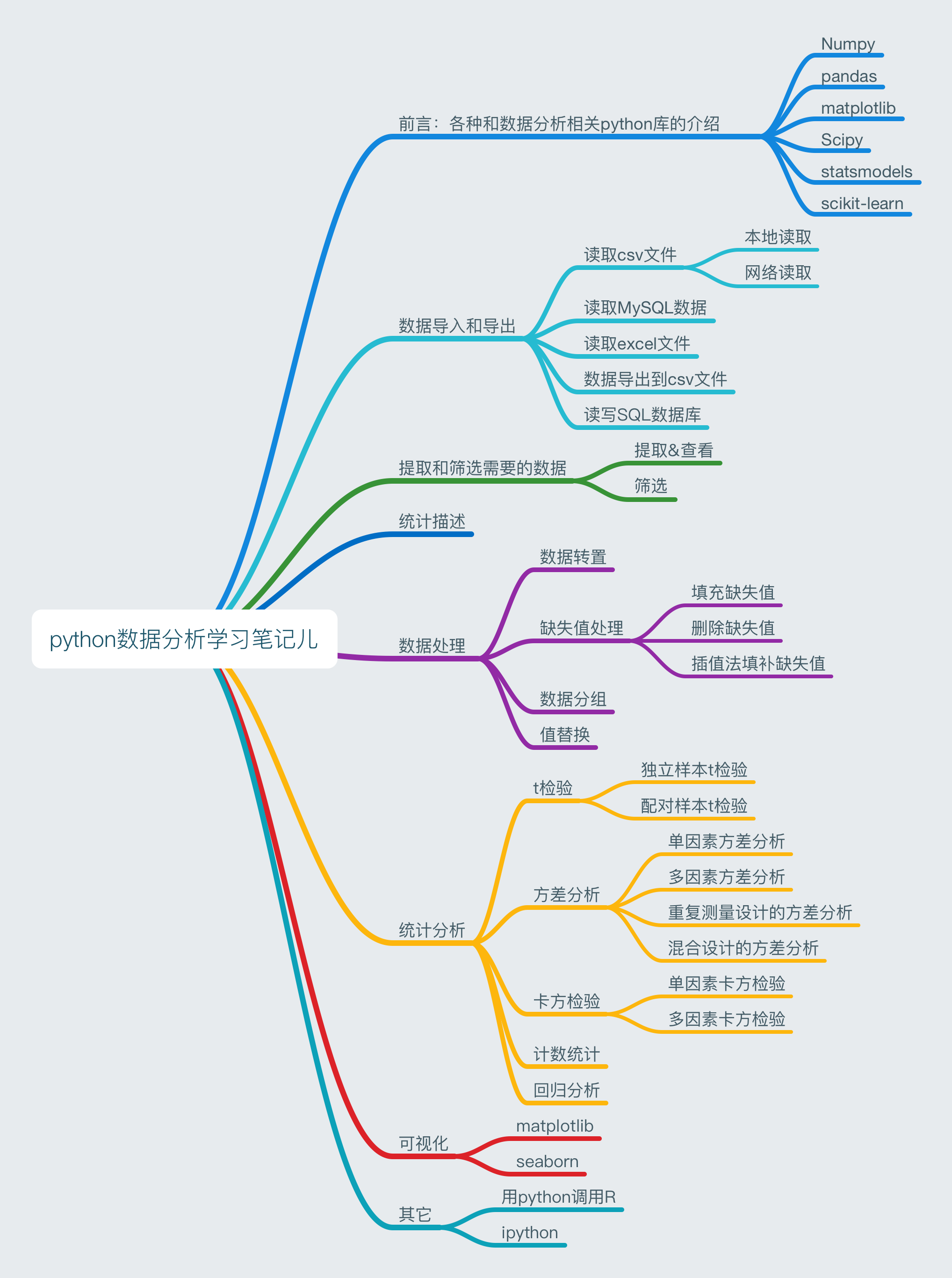

python数据分析入门笔记[1]

1.Numpy:

Numpy是python科学计算的基础包,它提供以下功能(不限于此):

(1)快速高效的多维数组对象naarray

(2)用于对数组执行元素级计算以及直接对数组执行数学运算的函数

(3)用于读写硬盘上基于数组的数据集的工具

(4)线性代数运算、傅里叶变换,以及随机数生成

(5)用于将C、C++、Fortran代码集成到python的工具 2.pandas

pandas提供了使我们能够快速便捷地处理结构化数据的大量数据结构和函数。pandas兼具Numpy高性能的数组计算功能以及电子表格和关系型数据(如SQL)灵活的数据处理能力。它提供了复杂精细的索引功能,以便更为便捷地完成重塑、切片和切块、聚合以及选取数据子集等操作。

对于金融行业的用户,pandas提供了大量适用于金融数据的高性能时间序列功能和工具。

DataFrame是pandas的一个对象,它是一个面向列的二维表结构,且含有行标和列标。

ps.引用一段网上的话说明DataFrame的强大之处:

Excel 2007及其以后的版本的最大行数是1048576,最大列数是16384,超过这个规模的数据Excel就会弹出个框框“此文本包含多行文本,无法放置在一个工作表中”。Pandas处理上千万的数据是易如反掌的事情,同时随后我们也将看到它比SQL有更强的表达能力,可以做很多复杂的操作,要写的code也更少。 说了一大堆它的好处,要实际感触还得动手码代码。 3.matplotlib

matplotlib是最流行的用于绘制数据图表的python库。 4.Scipy

Scipy是一组专门解决科学计算中各种标准问题域的包的集合。

5.statsmodels: https://github.com/statsmodels/statsmodels

6.scikit-learn: http://scikit-learn.org/stable/

一.数据导入和导出

(一)读取csv文件

1.本地读取

import pandas as pd

df = pd.read_csv('E:\\tips.csv') #根据自己数据文件保存的路径填写(p.s. python填写路径时,要么使用/,要么使用\\)

#输出:

total_bill tip sex smoker day time size

0 16.99 1.01 Female No Sun Dinner 2

1 10.34 1.66 Male No Sun Dinner 3

2 21.01 3.50 Male No Sun Dinner 3

3 23.68 3.31 Male No Sun Dinner 2

4 24.59 3.61 Female No Sun Dinner 4

5 25.29 4.71 Male No Sun Dinner 4

.. ... ... ... ... ... ... ...

240 27.18 2.00 Female Yes Sat Dinner 2

241 22.67 2.00 Male Yes Sat Dinner 2

242 17.82 1.75 Male No Sat Dinner 2

243 18.78 3.00 Female No Thur Dinner 2

[244 rows x 7 columns]

2.网络读取

import pandas as pd

data_url = "https://raw.githubusercontent.com/mwaskom/seaborn-data/master/tips.csv" #填写url读取

df = pd.read_csv(data_url)

#输出同上,为了节省篇幅这儿就不粘贴了

3.read_csv详解 功能: Read CSV (comma-separated) file into DataFrame

read_csv(filepath_or_buffer, sep=',', dialect=None, compression='infer', doublequote=True, escapechar=None, quotechar='"', quoting=0, skipinitialspace=False, lineterminator=None, header='infer', index_col=None, names=None, prefix=None, skiprows=None, skipfooter=None, skip_footer=0, na_values=None, true_values=None, false_values=None, delimiter=None, converters=None, dtype=None, usecols=None, engine=None, delim_whitespace=False, as_recarray=False, na_filter=True, compact_ints=False, use_unsigned=False, low_memory=True, buffer_lines=None, warn_bad_lines=True, error_bad_lines=True, keep_default_na=True, thousands=None, comment=None, decimal='.', parse_dates=False, keep_date_col=False, dayfirst=False, date_parser=None, memory_map=False, float_precision=None, nrows=None, iterator=False, chunksize=None, verbose=False, encoding=None, squeeze=False, mangle_dupe_cols=True, tupleize_cols=False, infer_datetime_format=False, skip_blank_lines=True)

参数详解:

http://pandas.pydata.org/pandas-docs/stable/generated/pandas.read_csv.html (二)读取Mysql数据

假设数据库安装在本地,用户名为myusername,密码为mypassword,要读取mydb数据库中的数据

import pandas as pd

import MySQLdb

mysql_cn= MySQLdb.connect(host='localhost', port=3306,user='myusername', passwd='mypassword', db='mydb')

df = pd.read_sql('select * from test;', con=mysql_cn)

mysql_cn.close()

上面的代码读取了test表中所有的数据到df中,而df的数据结构为Dataframe。

ps.MySQL教程:http://www.runoob.com/mysql/mysql-tutorial.html

(三)读取excel文件

要读取excel文件还需要安装xlrd模块,pip install xlrd即可。

df = pd.read_excel('E:\\tips.xls')

(四)数据导出到csv文件

df.to_csv('E:\\demo.csv', encoding='utf-8', index=False)

#index=False表示导出时去掉行名称,如果数据中含有中文,一般encoding指定为‘utf-8’

(五)读写SQL数据库

import pandas as pd

import sqlite3

con = sqlite3.connect('...')

sql = '...'

df=pd.read_sql(sql,con) #help文件

help(sqlite3.connect)

#输出

Help on built-in function connect in module _sqlite3: connect(...)

connect(database[, timeout, isolation_level, detect_types, factory]) Opens a connection to the SQLite database file *database*. You can use

":memory:" to open a database connection to a database that resides in

RAM instead of on disk.

#############

help(pd.read_sql)

#输出

Help on function read_sql in module pandas.io.sql: read_sql(sql, con, index_col=None, coerce_float=True, params=None, parse_dates=None, columns=None, chunksize=None)

Read SQL query or database table into a DataFrame.

ps.数据库的代码是我直接从网络上粘贴过来的,没有测试过是不是可行,先贴上来。

数据库我还在摸索中,学习心得学习笔记之类的大家可以一起分享23333~

二.提取和筛选需要的数据

(一)提取和查看相应数据 (用的是tips.csv的数据,数据来源:https://github.com/mwaskom/seaborn-data)

print df.head() #打印数据前五行

#输出

total_bill tip sex smoker day time size

0 16.99 1.01 Female No Sun Dinner 2

1 10.34 1.66 Male No Sun Dinner 3

2 21.01 3.50 Male No Sun Dinner 3

3 23.68 3.31 Male No Sun Dinner 2

4 24.59 3.61 Female No Sun Dinner 4

print df.tail() #打印数据后5行

#输出

total_bill tip sex smoker day time size

239 29.03 5.92 Male No Sat Dinner 3

240 27.18 2.00 Female Yes Sat Dinner 2

241 22.67 2.00 Male Yes Sat Dinner 2

242 17.82 1.75 Male No Sat Dinner 2

243 18.78 3.00 Female No Thur Dinner 2

print df.columns #打印列名

#输出

Index([u'total_bill', u'tip', u'sex', u'smoker', u'day', u'time', u'size'], dtype='object')

print df.index #打印行名

#输出

Int64Index([ 0, 1, 2, 3, 4, 5, 6, 7, 8, 9,

...

234, 235, 236, 237, 238, 239, 240, 241, 242, 243],

dtype='int64', length=244)

print df.ix[10:20, 0:3] #打印10~20行前三列数据

#输出

total_bill tip sex

10 10.27 1.71 Male

11 35.26 5.00 Female

12 15.42 1.57 Male

13 18.43 3.00 Male

14 14.83 3.02 Female

15 21.58 3.92 Male

16 10.33 1.67 Female

17 16.29 3.71 Male

18 16.97 3.50 Female

19 20.65 3.35 Male

20 17.92 4.08 Male

#提取不连续行和列的数据,这个例子提取的是第1,3,5行,第2,4列的数据

df.iloc[[1,3,5],[2,4]]

#输出

sex day

1 Male Sun

3 Male Sun

5 Male Sun

#专门提取某一个数据,这个例子提取的是第三行,第二列数据(默认从0开始算哈)

df.iat[3,2]

#输出

'Male'

print df.drop(df.columns[1, 2], axis = 1) #舍弃数据前两列

print df.drop(df.columns[[1, 2]], axis = 0) #舍弃数据前两行

#为了节省篇幅结果就不贴出来了哈~

print df.shape #打印维度

#输出

(244, 7)

df.iloc[3] #选取第3行

#输出1

total_bill 23.68

tip 3.31

sex Male

smoker No

day Sun

time Dinner

size 2

Name: 3, dtype: object df.iloc[2:4] #选取第2到第3行

#输出2

total_bill tip sex smoker day time size

2 21.01 3.50 Male No Sun Dinner 3

3 23.68 3.31 Male No Sun Dinner 2 df.iloc[0,1] #选取第0行1列的元素

#输出3

1.01

(二)筛选出需要的数据(用的是tips.csv的数据,数据来源:https://github.com/mwaskom/seaborn-data)

#example:假设我们要筛选出小费大于$8的数据

df[df.tip>8]

#输出

total_bill tip sex smoker day time size

170 50.81 10 Male Yes Sat Dinner 3

212 48.33 9 Male No Sat Dinner 4

#数据筛选同样可以用”或“和”且“作为筛选条件,比如

#1

df[(df.tip>7)|(df.total_bill>50)] #筛选出小费大于$7或总账单大于$50的数据

#输出

total_bill tip sex smoker day time size

23 39.42 7.58 Male No Sat Dinner 4

170 50.81 10.00 Male Yes Sat Dinner 3

212 48.33 9.00 Male No Sat Dinner 4 #2

df[(df.tip>7)&(df.total_bill>50)]#筛选出小费大于$7且总账单大于$50的数据

#输出

total_bill tip sex smoker day time size

170 50.81 10 Male Yes Sat Dinner 3

#接上

#假如加入了筛选条件后,我们只关心day和time

df[['day','time']][(df.tip>7)|(df.total_bill>50)]

#输出

day time

23 Sat Dinner

170 Sat Dinner

212 Sat Dinner

三.统计描述(用的是tips.csv的数据,数据来源:https://github.com/mwaskom/seaborn-data)

print df.describe() #描述性统计

#输出 各指标都比较简单就不解释了哈

total_bill tip size

count 244.000000 244.000000 244.000000

mean 19.785943 2.998279 2.569672

std 8.902412 1.383638 0.951100

min 3.070000 1.000000 1.000000

25% 13.347500 2.000000 2.000000

50% 17.795000 2.900000 2.000000

75% 24.127500 3.562500 3.000000

max 50.810000 10.000000 6.000000

四.数据处理

(一)数据转置(用的是tips.csv的数据,数据来源:https://github.com/mwaskom/seaborn-data)

print df.T

#output

0 1 2 3 4 5 6 7 \

total_bill 16.99 10.34 21.01 23.68 24.59 25.29 8.77 26.88

tip 1.01 1.66 3.5 3.31 3.61 4.71 2 3.12

sex Female Male Male Male Female Male Male Male

smoker No No No No No No No No

day Sun Sun Sun Sun Sun Sun Sun Sun

time Dinner Dinner Dinner Dinner Dinner Dinner Dinner Dinner

size 2 3 3 2 4 4 2 4 8 9 ... 234 235 236 237 238 \

total_bill 15.04 14.78 ... 15.53 10.07 12.6 32.83 35.83

tip 1.96 3.23 ... 3 1.25 1 1.17 4.67

sex Male Male ... Male Male Male Male Female

smoker No No ... Yes No Yes Yes No

day Sun Sun ... Sat Sat Sat Sat Sat

time Dinner Dinner ... Dinner Dinner Dinner Dinner Dinner

size 2 2 ... 2 2 2 2 3 239 240 241 242 243

total_bill 29.03 27.18 22.67 17.82 18.78

tip 5.92 2 2 1.75 3

sex Male Female Male Male Female

smoker No Yes Yes No No

day Sat Sat Sat Sat Thur

time Dinner Dinner Dinner Dinner Dinner

size 3 2 2 2 2 [7 rows x 244 columns]

(二)数据排序(用的是tips.csv的数据,数据来源:https://github.com/mwaskom/seaborn-data)

df.sort_values(by='tip') #按tip列升序排序

#输出(为了不占篇幅我简化了一部分)

total_bill tip sex smoker day time size

67 3.07 1.00 Female Yes Sat Dinner 1

236 12.60 1.00 Male Yes Sat Dinner 2

92 5.75 1.00 Female Yes Fri Dinner 2

111 7.25 1.00 Female No Sat Dinner 1

0 16.99 1.01 Female No Sun Dinner 2

.. ... ... ... ... ... ... ...

214 28.17 6.50 Female Yes Sat Dinner 3

141 34.30 6.70 Male No Thur Lunch 6

59 48.27 6.73 Male No Sat Dinner 4

23 39.42 7.58 Male No Sat Dinner 4

212 48.33 9.00 Male No Sat Dinner 4

170 50.81 10.00 Male Yes Sat Dinner 3 [244 rows x 7 columns]

(三)缺失值处理

1.填充缺失值(数据来自《利用python进行数据分析》第二章 usagov_bitly_data2012-03-16-1331923249.txt,需要的同学可以找我要)

import json #python有许多内置或第三方模块可以将JSON字符串转换成python字典对象

import pandas as pd

import numpy as np

from pandas import DataFrame

path = 'F:\PycharmProjects\pydata-book-master\ch02\usagov_bitly_data2012-03-16-1331923249.txt' #根据自己的路径填写

records = [json.loads(line) for line in open(path)]

frame = DataFrame(records)

frame['tz'] #输出(为了节省篇幅我删除了部分输出结果)

0 America/New_York

1 America/Denver

2 America/New_York

3 America/Sao_Paulo

4 America/New_York

5 America/New_York

6 Europe/Warsaw

7

8

9

10 America/Los_Angeles

11 America/New_York

12 America/New_York

13 NaN

...

Name: tz, dtype: object

从以上输出值可以看出数据存在未知或缺失值,接着咱们来处理缺失值。

print frame['tz'].fillna(1111111111111) #以数字代替缺失值

#输出结果(为了节省篇幅我删除了部分输出结果)

0 America/New_York

1 America/Denver

2 America/New_York

3 America/Sao_Paulo

4 America/New_York

5 America/New_York

6 Europe/Warsaw

7

8

9

10 America/Los_Angeles

11 America/New_York

12 America/New_York

13 1111111111111

Name: tz, dtype: object

print frame['tz'].fillna('YuJie2333333333333') #用字符串代替缺失值

#输出(为了节省篇幅我删除了部分输出结果)

0 America/New_York

1 America/Denver

2 America/New_York

3 America/Sao_Paulo

4 America/New_York

5 America/New_York

6 Europe/Warsaw

7

8

9

10 America/Los_Angeles

11 America/New_York

12 America/New_York

13 YuJie2333333333333

Name: tz, dtype: object

还有:

print frame['tz'].fillna(method='pad') #用前一个数据代替缺失值

print frame['tz'].fillna(method='bfill') #用后一个数据代替缺失值

2.删除缺失值 (数据同上)

print frame['tz'].dropna(axis=0) #删除缺失行

print frame['tz'].dropna(axis=1) #删除缺失列

3.插值法填补缺失值

由于没有数据,这儿插播一个小知识点:创建一个随机的数据框

import pandas as pd

import numpy as np

#创建一个6*4的数据框,randn函数用于创建随机数

czf_data = pd.DataFrame(np.random.randn(6,4),columns=list('ABCD'))

czf_data

#输出

A B C D

0 0.355690 1.165004 0.810392 -0.818982

1 0.496757 -0.490954 -0.407960 -0.493502

2 -0.202123 -0.842278 -0.948464 0.223771

3 0.969445 1.357910 -0.479598 -1.199428

4 0.125290 0.943056 -0.082404 -0.363640

5 -1.762905 -1.471447 0.351570 -1.546152

好啦,数据就出来了。接着我们用空值替换数值,创造出一个含有空值的DataFrame。

#把第二列数据设置为缺失值

czf_data.ix[2,:]=np.nan

czf_data

#输出

A B C D

0 0.355690 1.165004 0.810392 -0.818982

1 0.496757 -0.490954 -0.407960 -0.493502

2 NaN NaN NaN NaN

3 0.969445 1.357910 -0.479598 -1.199428

4 0.125290 0.943056 -0.082404 -0.363640

5 -1.762905 -1.471447 0.351570 -1.546152

#接着就可以利用插值法填补空缺值了~

print czf_data.interpolate()

#输出

A B C D

0 0.355690 1.165004 0.810392 -0.818982

1 0.496757 -0.490954 -0.407960 -0.493502

2 0.733101 0.433478 -0.443779 -0.846465

3 0.969445 1.357910 -0.479598 -1.199428

4 0.125290 0.943056 -0.082404 -0.363640

5 -1.762905 -1.471447 0.351570 -1.546152

(四)数据分组(用的是tips.csv的数据,数据来源:https://github.com/mwaskom/seaborn-data)

group = df.groupby('day') #按day这一列进行分组

#1

print group.first()#打印每一组的第一行数据

#输出

total_bill tip sex smoker time size

day

Fri 28.97 3.00 Male Yes Dinner 2

Sat 20.65 3.35 Male No Dinner 3

Sun 16.99 1.01 Female No Dinner 2

Thur 27.20 4.00 Male No Lunch 4

#2

print group.last()#打印每一组的最后一行数据

#输出

total_bill tip sex smoker time size

day

Fri 10.09 2.00 Female Yes Lunch 2

Sat 17.82 1.75 Male No Dinner 2

Sun 15.69 1.50 Male Yes Dinner 2

Thur 18.78 3.00 Female No Dinner 2

(五)值替换

import pandas as pd

import numpy as np

#首先创造一个Series(没有数据情况下的福音233)

Series = pd.Series([0,1,2,3,4,5])

#输出

Series

0 0

1 1

2 2

3 3

4 4

5 5

dtype: int64

#数值替换,例如将0换成10000000000000

print Series.replace(0,10000000000000)

#输出

0 10000000000000

1 1

2 2

3 3

4 4

5 5

dtype: int64

#列和列的替换同理

print Series.replace([0,1,2,3,4,5],[11111,222222,3333333,44444,55555,666666])

#输出

0 11111

1 222222

2 3333333

3 44444

4 55555

5 666666

dtype: int64

五.统计分析

(一)t检验

1.独立样本t检验

两独立样本t检验就是根据样本数据对两个样本来自的两独立总体的均值是否有显著差异进行推断;进行两独立样本t检验的条件是,两样本的总体相互独立且符合正态分布。

开始找不到合适的数据,我就在网上随便摘抄了个spss做独立样本t检验的实例数据作为例子大家暂时看着吧找到合适的例子再给大家举~

数据如下,我将数据保存为本地xlsx格式:

group data

0 1 34

1 1 37

2 1 28

3 1 36

4 1 30

5 2 43

6 2 45

7 2 47

8 2 49

9 2 39

import pandas as pd

from scipy.stats import ttest_ind

IS_t_test = pd.read_excel('E:\\IS_t_test.xlsx')

Group1 = IS_t_test[IS_t_test['group']==1]['data']

Group2 = IS_t_test[IS_t_test['group']==2]['data']

print ttest_ind(Group1,Group2) #输出

(-4.7515451390104353, 0.0014423819408438474)

输出结果的第一个元素为t值,第二个元素为p-value

ttest_ind默认两组数据方差齐性的,如果想要设置默认方差不齐,可以设置equal_var=False

print ttest_ind(Group1,Group2,equal_var=True)

print ttest_ind(Group1,Group2,equal_var=False)

#输出

(-4.7515451390104353, 0.0014423819408438474)

(-4.7515451390104353, 0.0014425608643614844)

2.配对样本t检验

同样找不到数据,让我们暂且假设上边独立样本是配对样本吧,使用同样的数据。

import pandas as pd

from scipy.stats import ttest_rel

IS_t_test = pd.read_excel('E:\\IS_t_test.xlsx')

Group1 = IS_t_test[IS_t_test['group']==1]['data']

Group2 = IS_t_test[IS_t_test['group']==2]['data']

print ttest_rel(Group1,Group2) #输出

(-5.6873679190073361, 0.00471961872448184)

同样的,输出结果的第一个元素为t值,第二个元素为p-value。

(二)方差分析

1.单因素方差分析

这里依然沿用t检验的数据

import pandas as pd

from scipy import stats

IS_t_test = pd.read_excel('E:\\IS_t_test.xlsx')

Group1 = IS_t_test[IS_t_test['group']==1]['data']

Group2 = IS_t_test[IS_t_test['group']==2]['data']

w,p = stats.levene(*args)

#levene方差齐性检验。levene(*args, **kwds) Perform Levene test for equal variances.如果p<0.05,则方差不齐

print w,p

#进行方差分析

f,p = stats.f_oneway(*args)

print f,p #输出

(0.019607843137254936, 0.89209916055865535)

22.5771812081 0.00144238194084

2.多因素方差分析

数据是我从网上找的多因素方差分析的一个例子,研究区组和营养素对体重的影响。我做成了excel文件,需要的同学可以问我要哈~做多因素方差分析需要加载statsmodels模块,如果电脑没有安装可以pip install一下。

#数据导入

import pandas as pd

MANOVA=pd.read_excel('E:\\MANOVA.xlsx')

MANOVA

#输出(为了节省篇幅删掉了中间部分的输出结果)

id nutrient weight

0 1 1 50.1

1 2 1 47.8

2 3 1 53.1

3 4 1 63.5

4 5 1 71.2

5 6 1 41.4

.......................

21 6 3 38.5

22 7 3 51.2

23 8 3 46.2

#多因素方差分析

from statsmodels.formula.api import ols

from statsmodels.stats.anova import anova_lm

formula = 'weight~C(id)+C(nutrient)+C(id):C(nutrient)'

anova_results = anova_lm(ols(formula,MANOVA).fit())

print anova_results

#output

df sum_sq mean_sq F PR(>F)

C(id) 7 2.373613e+03 339.087619 0 NaN

C(nutrient) 2 1.456133e+02 72.806667 0 NaN

C(id):C(nutrient) 14 3.391667e+02 24.226190 0 NaN

Residual 0 8.077936e-27 inf NaN NaN

也许数据选得不对,p-value全是空值23333,待我找个好点儿的数据再做一次多因素方差分析。

3.重复测量设计的方差分析(单因素) ********待完善

重复测量设计是对同一因变量进行重复测度,重复测量设计的方差分析可以是同一条件下进行的重复测度,也可以是不同条件下的重复测量。

代码和多因素方差分析一样,思路不一样而已~但我还找不到多因素方差分析合适的数据所以这儿就先不写了2333

4.混合设计的方差分析 ********待完善

#########统计学学得好的同学们,教教我吧。。

(三)卡方检验

卡方检验就是统计样本的实际观测值与理论推断值之间的偏离程度,实际观测值与理论推断值之间的偏离程度就决定卡方值的大小,卡方值越大,越不符合;卡方值越小,偏差越小,越趋于符合,若两个值完全相等时,卡方值就为0,表明理论值完全符合。(from 百度百科2333)

1.单因素卡方检验

数据源于网络,男女化妆与不化妆人数的理论值与实际值。

import numpy as np

from scipy import stats

from scipy.stats import chisquare

observed = np.array([15,95])

#观测值:110学生中化妆的女生95人,化妆的男生15人

expected = np.array([55,55])

#理论值:110学生中化妆的女生55人,化妆的男生55人

chisquare(observed,expected)

#output

(58.18181818181818, 2.389775628860044e-14)

2.多因素卡方检验*****正在研究中,学会了完善这一块~

(四)计数统计(用的数据为tips.csv)

#example:统计性别

count = df['sex'].value_counts()

#输出

print count

Male 157

Female 87

Name: sex, dtype: int64

(五)回归分析 *****待学习: 数据拟合,广义线性回归。。。。等等

六.可视化

我觉得吧,其实看着excel就可以实现的功能为何那么复杂,excel确实够通用够便捷,但是处理很大数据量的话也许吃不消吧。学学python绘图也不赖,而且讲真,有的成效真的挺好看的。

(一)Seaborn

我学数据分析可视化是从学习Seaborn入门的,Seaborn是基于matplotlib的Python可视化库,刚开始便接触matplotlib难免有些吃力,参数多且难理解,但是慢慢来总会学会的。还有关键的一点是,seaborn画出来的图好好看。。

#基础导入

import numpy as np

import pandas as pd

import seaborn as sns

import matplotlib as mpl

import matplotlib.pyplot as plt

#小费数据真的挺好的,这儿用tips作为example

tips = sns.load_dataset('tips') #从网络环境导入数据tips

1.lmplot函数

lmplot(x, y, data, hue=None, col=None, row=None, palette=None, col_wrap=None, size=5, aspect=1, markers='o', sharex=True, sharey=True, hue_order=None, col_order=None, row_order=None, legend=True, legend_out=True, x_estimator=None, x_bins=None, x_ci='ci', scatter=True, fit_reg=True, ci=95, n_boot=1000, units=None, order=1, logistic=False, lowess=False, robust=False, logx=False, x_partial=None, y_partial=None, truncate=False, x_jitter=None, y_jitter=None, scatter_kws=None, line_kws=None)

功能:Plot data and regression model fits across a FacetGrid.

下面就不同的例子,对lmplot的参数进行解释

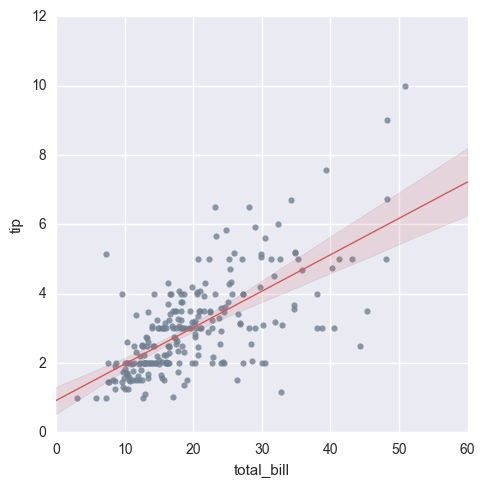

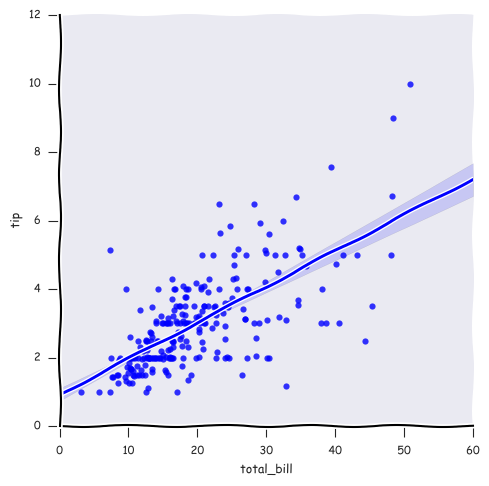

例子1. 画出总账单和小费回归关系图

用到了lmplot(x, y, data,scatter_kws)

x,y,data一目了然这儿就不多解释了,scatter_kws和line_kws的官方解释如下:

{scatter,line}_kws : dictionarie

Additional keyword arguments to pass to plt.scatter and plt.plot.

scatter为点,line为线。其实就是用字典去限定点和线的各种属性,如例子所示,散点的颜色为灰石色,线条的颜色为印度红,成像效果就是这样点线颜色分离,展现效果很好。大家也可以换上自己想要的图片属性。

sns.lmplot("total_bill", "tip", tips,

scatter_kws={"marker": ".", "color": "slategray"},

line_kws={"linewidth": 1, "color": "indianred"}).savefig('picture2')

另外:颜色还可以使用RGB代码,具体对照表可以参考这个网站,可以自己搭配颜色:

http://www.114la.com/other/rgb.htm

marker也可以有多种样式,具体如下:

. Point marker

, Pixel marker

o Circle marker

v Triangle down marker

^ Triangle up marker

< Triangle left marker

> Triangle right marker

1 Tripod down marker

2 Tripod up marker

3 Tripod left marker

4 Tripod right marker

s Square marker

p Pentagon marker

* Star marker

h Hexagon marker

H Rotated hexagon D Diamond marker

d Thin diamond marker

| Vertical line (vlinesymbol) marker

_ Horizontal line (hline symbol) marker

+ Plus marker

x Cross (x) marker

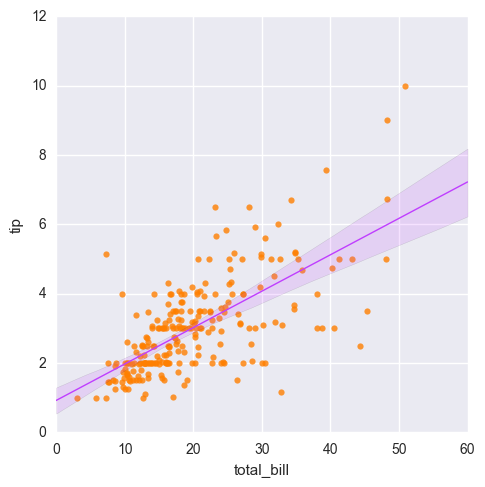

sns.lmplot("total_bill", "tip", tips,

scatter_kws={"marker": ".","color":"#FF7F00"},

line_kws={"linewidth": 1, "color": "#BF3EFF"}).savefig('s1')

ps.我修改maker属性不成功不知为何,求解答

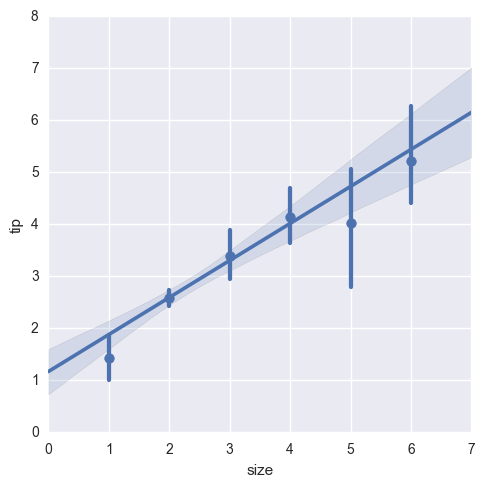

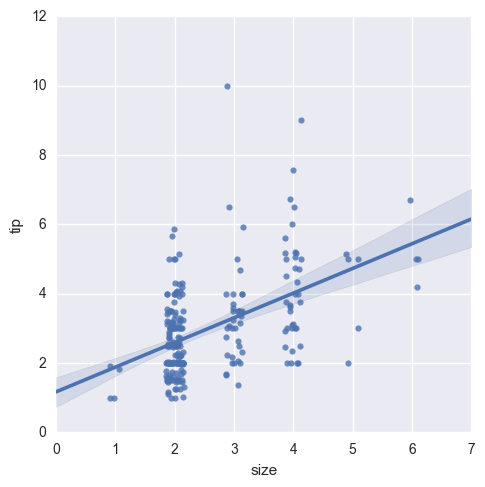

例子2.用餐人数(size)和小费(tip)的关系图

官方解释:

x_estimator : callable that maps vector -> scalar, optional

Apply this function to each unique value of x and plot the resulting estimate. This is useful when x is a discrete variable. If x_ci is not None, this estimate will be bootstrapped and a confidence interval will be drawn.

大概解释就是:对拥有相同x水平的y值进行映射

plt.figure()

sns.lmplot('size', 'tip', tips, x_estimator= np.mean).savefig('picture3')

{x,y}_jitter : floats, optional

Add uniform random noise of this size to either the

xoryvariables. The noise is added to a copy of the data after fitting the regression, and only influences the look of the scatterplot. This can be helpful when plotting variables that take discrete values.

jitter是个很有意思的参数, 特别是处理靶数据的overlapping过于严重的情况时, 通过增加一定程度的噪声(noise)实现数据的区隔化, 这样原始数据是若干 点簇 变成一系列密集邻近的点群. 另外, 有的人会经常将

rug与jitter结合使用. 这依人吧.对于横轴取离散水平的时候, 用x_jitter可以让数据点发生水平的扰动.但扰动的幅度不宜过大。

sns.lmplot('size', 'tip', tips, x_jitter=.15).savefig('picture4')

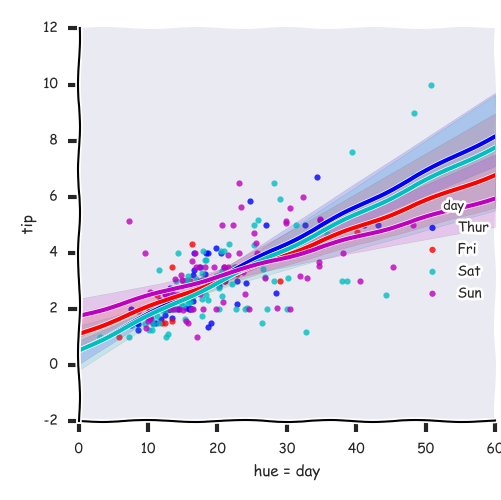

seaborn还可以做出xkcd风格的图片,还挺有意思的

with plt.xkcd():

sns.color_palette('husl', 8)

sns.set_context('paper')

sns.lmplot(x='total_bill', y='tip', data=tips, ci=65).savefig('picture1')

with plt.xkcd():

sns.lmplot('total_bill', 'tip', data=tips, hue='day')

plt.xlabel('hue = day')

plt.savefig('picture5')

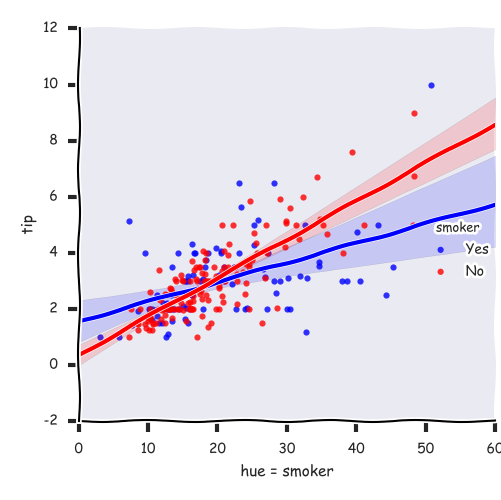

with plt.xkcd():

sns.lmplot('total_bill', 'tip', data=tips, hue='smoker')

plt.xlabel('hue = smoker')

plt.savefig('picture6')

sns.set_style('dark')

sns.set_context('talk')

sns.lmplot('size', 'total_bill', tips, order=2)

plt.title('# poly order = 2')

plt.savefig('picture7')

plt.figure()

sns.lmplot('size', 'total_bill', tips, order=3)

plt.title('# poly order = 3')

plt.savefig('picture8')

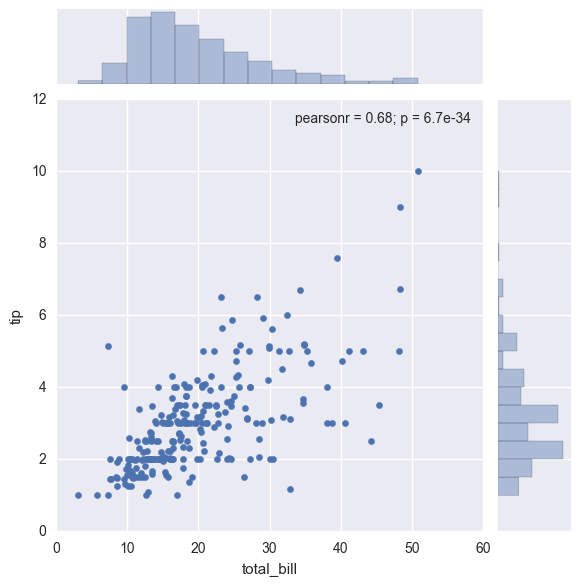

sns.jointplot("total_bill", "tip", tips).savefig('picture9')

(二)matplotlib ********待完善

python数据分析入门笔记[1]的更多相关文章

- Python数据分析入门

Python数据分析入门 最近,Analysis with Programming加入了Planet Python.作为该网站的首批特约博客,我这里来分享一下如何通过Python来开始数据分析.具体内 ...

- Python数据分析入门之pandas基础总结

Pandas--"大熊猫"基础 Series Series: pandas的长枪(数据表中的一列或一行,观测向量,一维数组...) Series1 = pd.Series(np.r ...

- Python数据分析入门与实践 ✌✌

Python数据分析入门与实践 (一个人学习或许会很枯燥,但是寻找更多志同道合的朋友一起,学习将会变得更加有意义✌✌) 这是一个数据驱动的时代,想要从事机器学习.人工智能.数据挖掘等前沿技术,都离不开 ...

- Python数据分析入门与实践

Python数据分析入门与实践 整个课程都看完了,这个课程的分享可以往下看,下面有链接,之前做java开发也做了一些年头,也分享下自己看这个视频的感受,单论单个知识点课程本身没问题,大家看的时候可以关 ...

- python数据分析入门学习笔记儿

学习利用python进行数据分析的笔记儿&下星期二内部交流会要讲的内容,一并分享给大家.博主粗心大意,有什么不对的地方欢迎指正~还有许多尚待完善的地方,待我一边学习一边完善~ 前言:各种和数据 ...

- 《Python 数据分析》笔记——pandas

Pandas pandas是一个流行的开源Python项目,其名称取panel data(面板数据)与Python data analysis(Python 数据分析)之意. pandas有两个重要的 ...

- python数据分析入门(一)----安装pandas

打算入坑, python数据分析 , 所以下载了 <利用python数据分析>的电子书, 影印版 , 14年出版的 , 现在有很多工具对不上号, 但是整体思想还是不变的 , 所以准备工作要 ...

- 10个步骤教你如何安装Anaconda安装,Python数据分析入门必看

前言 文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者:小白 PS:如有需要Python学习资料的小伙伴可以加点击下方链接自行 ...

- python数据分析入门学习笔记

学习利用python进行数据分析的笔记&下星期二内部交流会要讲的内容,一并分享给大家.博主粗心大意,有什么不对的地方欢迎指正~还有许多尚待完善的地方,待我一边学习一边完善~ 前言:各种和数据分 ...

随机推荐

- mysql自动安装脚本

#!/bin/bashif [ -d /software ] ;then cd /softwareelse mkdir /software && cd /softwarefi #is ...

- vim - 显示不可见字符(:set list)

默认情况下,vim是不会显示space,tabs,newlines,trailing space,wrapped lines等不可见字符的.我们可以使用以下命令打开list选项,来显示非可见字符: : ...

- AI系统——梯度累积算法

明天博士论文要答辩了,只有一张12G二手卡,今晚通宵要搞定10个模型实验 挖槽,突然想出一个T9开天霹雳模型,加载不进去我那张12G的二手卡,感觉要错过今年上台Best Paper领奖 上面出现的 ...

- Hive的连接和运行模式

原文链接: https://www.toutiao.com/i6771018203687551495/ Hive的连接 启动hadoop的时候将history也启动,如果出问题,可以方便我们后续定位 ...

- SSM工程常见问题

1.引入Junit测试 <!--引入junit单元测试,两个一起引用,spring-test版本要与Spring-core保持一致--> <dependency> <gr ...

- 都2022年了,你的前端工具集应该有vueuse

摘要:一款基于Vue组合式API的函数工具集. 本文分享自华为云社区<vueuse:我不许身为vuer的前端,你的工具集只有lodash!>,作者: 前端要摸鱼 . vueuse 是什么? ...

- Web安全攻防(一)XSS注入和CSRF

跨站脚本攻击(XSS) XSS(Cross Site Scripting),为不和层叠样式表CSS混淆,故将跨站脚本攻击缩写为XSS. 攻击原理: 恶意攻击者往Web页面里插入恶意Script代码,当 ...

- C#获取http图片

public Image GetHttpImage(string url) { var client = new HttpClient(); var uri = new Uri(Uri.EscapeU ...

- 解决new Thread().Start导致高并发CPU 100%的问题

背景 之前接手一个项目的时候,发现到处是 new Thread(()=>{ //do something }).Start(); 这么做的目的,无非是为了减少页面等待时间提高用户体验,把一些浪费 ...

- vue学习17-插槽作用域

<!DOCTYPE html> <html lang='en'> <head> <meta charset='UTF-8'> <meta http ...