一致性Hash 分析和实现

一致性Hash 分析和实现

---

title: 1.一致性Hash

date: 2018-02-05 12:03:22

categories:

- 一致性Hash

---

一下分析来源于网络总结:算法参照自己实现,共参考和指正。

一致性Hash算法背景

一致性哈希算法在1997年由麻省理工学院的Karger等人在解决分布式Cache中提出的,设计目标是为了解决因特网中的热点(Hot spot)问题,初衷和CARP十分类似。一致性哈希修正了CARP使用的简单哈希算法带来的问题,使得DHT可以在P2P环境中真正得到应用。

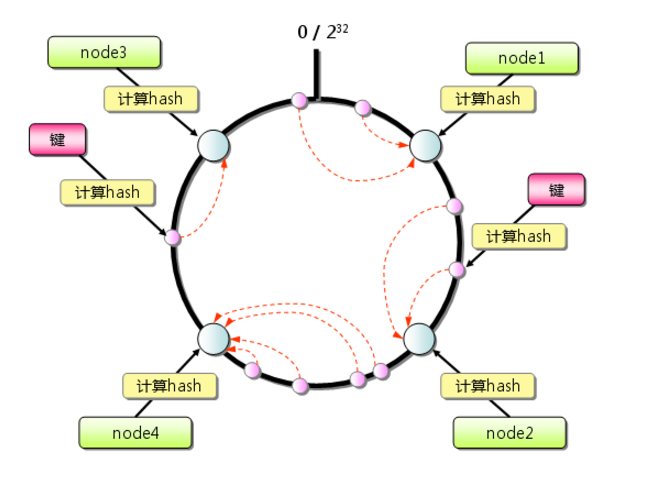

但现在一致性hash算法在分布式系统中也得到了广泛应用,研究过memcached缓存数据库的人都知道,memcached服务器端本身不提供分布式cache的一致性,而是由客户端来提供,具体在计算一致性hash时采用如下步骤:

- - 首先求出memcached服务器(节点)的哈希值,并将其配置到0~232的圆(continuum)上。

- - 然后采用同样的方法求出存储数据的键的哈希值,并映射到相同的圆上。

- - 然后从数据映射到的位置开始顺时针查找,将数据保存到找到的第一个服务器上。如果超过232仍然找不到服务器,就会保存到第一台memcached服务器上。

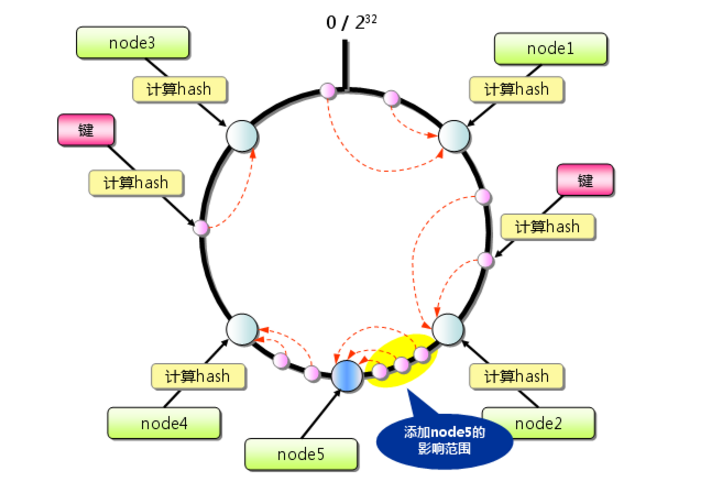

从上图的状态中添加一台memcached服务器。余数分布式算法由于保存键的服务器会发生巨大变化而影响缓存的命中率,但Consistent Hashing中,只有在园(continuum)上增加服务器的地点逆时针方向的第一台服务器上的键会受到影响,如下图所示:

原理

基本概念

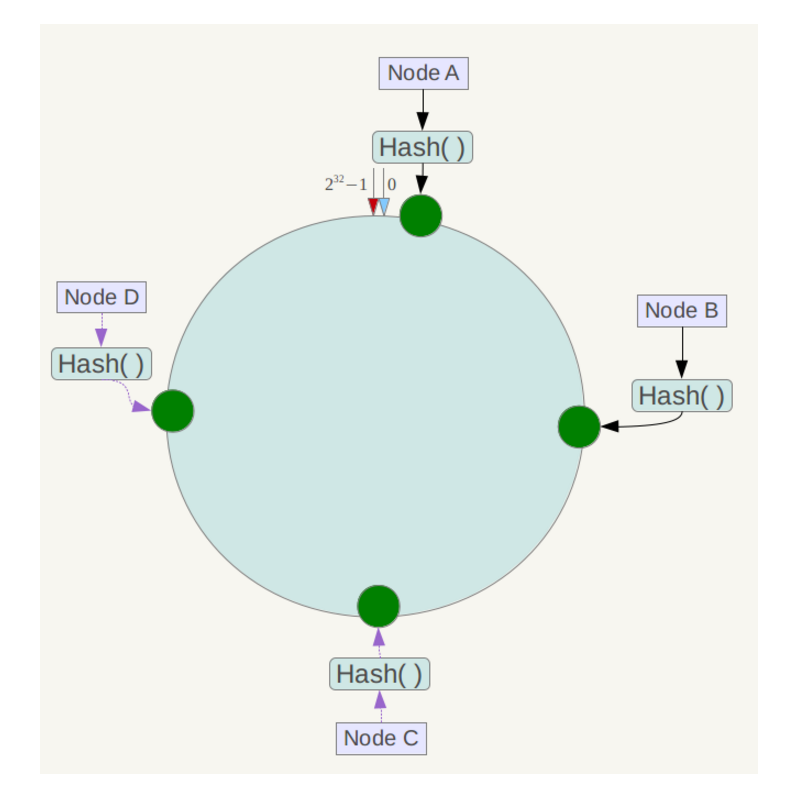

简单来说,一致性哈希将整个哈希值空间组织成一个虚拟的圆环,如假设某哈希函数H的值空间为0-2^32-1(即哈希值是一个32位无符号整形),整个哈希空间环如下:

整个空间按顺时针方向组织。0和232-1在零点中方向重合。

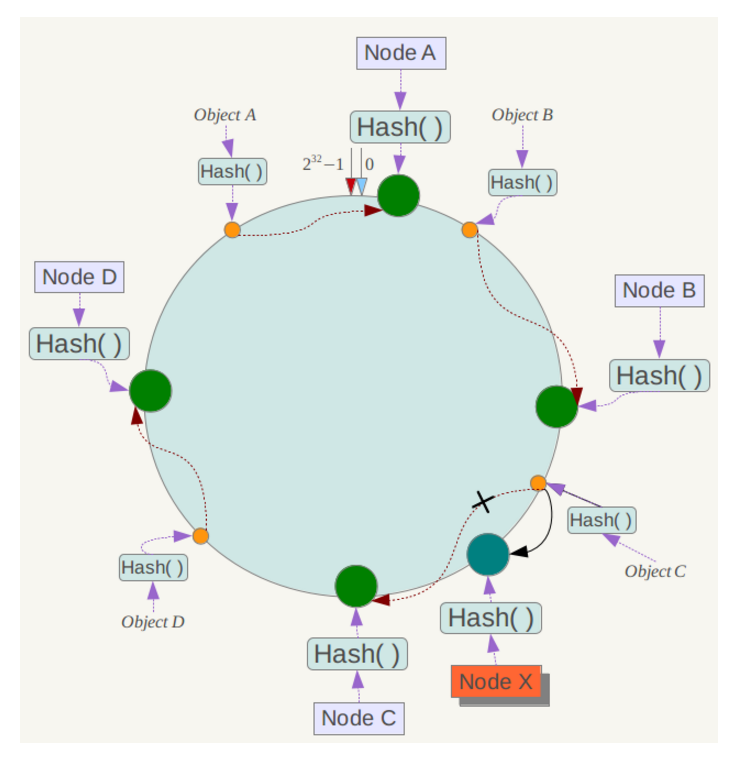

下一步将各个服务器使用Hash进行一个哈希,具体可以选择服务器的ip或主机名作为关键字进行哈希,这样每台机器就能确定其在哈希环上的位置,这里假设将上文中四台服务器使用ip地址哈希后在环空间的位置如下:

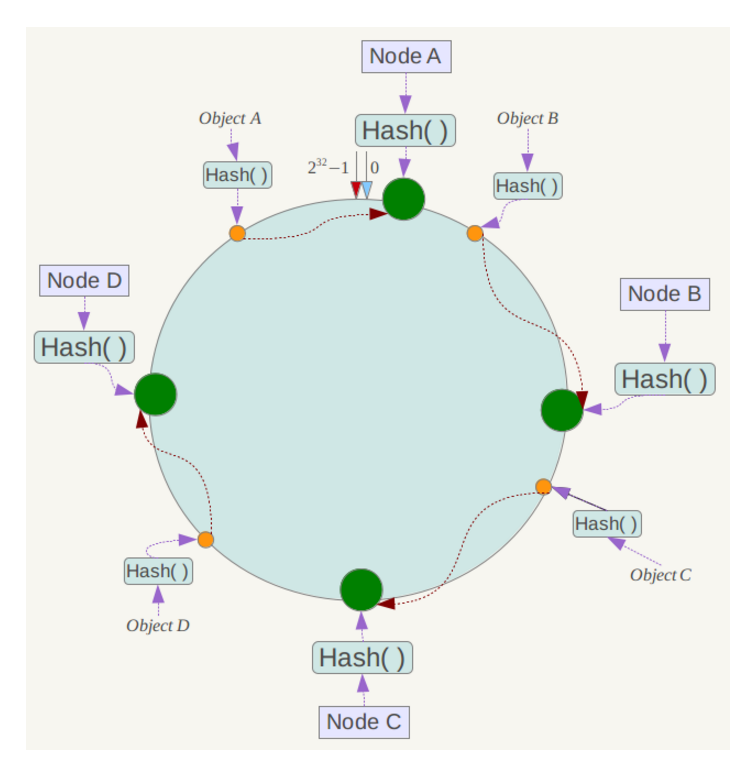

接下来使用如下算法定位数据访问到相应服务器:将数据key使用相同的函数Hash计算出哈希值,并确定此数据在环上的位置,从此位置沿环顺时针“行走”,第一台遇到的服务器就是其应该定位到的服务器。

例如我们有Object A、Object B、Object C、Object D四个数据对象,经过哈希计算后,在环空间上的位置如下:

根据一致性哈希算法,数据A会被定为到Node A上,B被定为到Node B上,C被定为到Node C上,D被定为到Node D上。

下面分析一致性哈希算法的容错性和可扩展性。现假设Node C不幸宕机,可以看到此时对象A、B、D不会受到影响,只有C对象被重定位到Node D。一般的,在一致性哈希算法中,如果一台服务器不可用,则受影响的数据仅仅是此服务器到其环空间中前一台服务器(即沿着逆时针方向行走遇到的第一台服务器)之间数据,其它不会受到影响。

下面考虑另外一种情况,如果在系统中增加一台服务器Node X,如下图所示:

此时对象Object A、B、D不受影响,只有对象C需要重定位到新的Node X 。一般的,在一致性哈希算法中,如果增加一台服务器,则受影响的数据仅仅是新服务器到其环空间中前一台服务器(即沿着逆时针方向行走遇到的第一台服务器)之间数据,其它数据也不会受到影响。

综上所述,一致性哈希算法对于节点的增减都只需重定位环空间中的一小部分数据,具有较好的容错性和可扩展性。

算法实现:

package com.maozw.algorithm; import java.util.SortedMap;

import java.util.TreeMap; /**

* @author MAOZW

* @Description: 不带虚拟节点的一致性Hash算法

* @date 2018/11/22 16:30

*/

public class ConsistentHashNoNode { /**

* 初始化 key表示服务器的hash值,value表示服务器的名称

*/

private static SortedMap<Integer, String> serverHashMap = new TreeMap<Integer, String>(); public static String getServer(String data) {

return serverHashMap.get(serverHashMap.tailMap(hash(data)).firstKey());

} /**

* 构建hash环

* @param servers

*/

public ConsistentHashNoNode(String[] servers) {

for (int i = 0; i < servers.length; i++) {

int hash = hash(servers[i]);

serverHashMap.put(hash, servers[i]);

}

} /**

* FNV1_32_HASH 百度

* @param str

* @return

*/

public static int hash(String str) {

final int p = 16777619;

int hash = (int)2166136261L;

for (int i = 0; i < str.length(); i++) {

hash = (hash ^ str.charAt(i)) * p;

}

hash += hash << 13;

hash ^= hash >> 7;

hash += hash << 3;

hash ^= hash >> 17;

hash += hash << 5;

return Math.abs(hash);

} public static void main(String[] args) {

//构建服务器列表

String[] servers = {"192.168.1.0:098", "192.168.1.0:099", "192.168.1.0:100","192.168.1.0:111", "192.168.1.1:112", "192.168.1.2:113", "192.168.0.3:114", "192.168.0.4:115"};

new ConsistentHashNoNode(servers);

for (int i = 0; i < 10; i++) {

System.out.println("data : " + i + ", hash " + hash(String.valueOf(i)) + " >>>>>>> " + getServer(String.valueOf(i)));

}

}

}

输出结果:

data : 0, hash 1360261864 >>>>>>> 192.168.0.4:115

data : 1, hash 1081142246 >>>>>>> 192.168.0.3:114

data : 2, hash 1310673766 >>>>>>> 192.168.0.4:115

data : 3, hash 895667540 >>>>>>> 192.168.0.3:114

data : 4, hash 1066967047 >>>>>>> 192.168.0.3:114

data : 5, hash 1039214538 >>>>>>> 192.168.0.3:114

data : 6, hash 853429834 >>>>>>> 192.168.0.3:114

data : 7, hash 679338660 >>>>>>> 192.168.0.3:114

data : 8, hash 570677376 >>>>>>> 192.168.0.3:114

data : 9, hash 1632757952 >>>>>>> 192.168.1.0:098

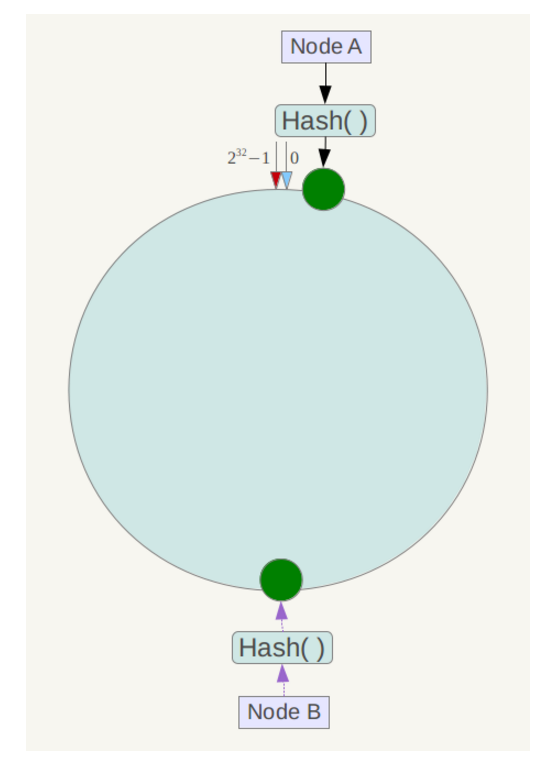

另外,一致性哈希算法在服务节点太少时,容易因为节点分部不均匀而造成数据倾斜问题。例如系统中只有两台服务器,其环分布如下,

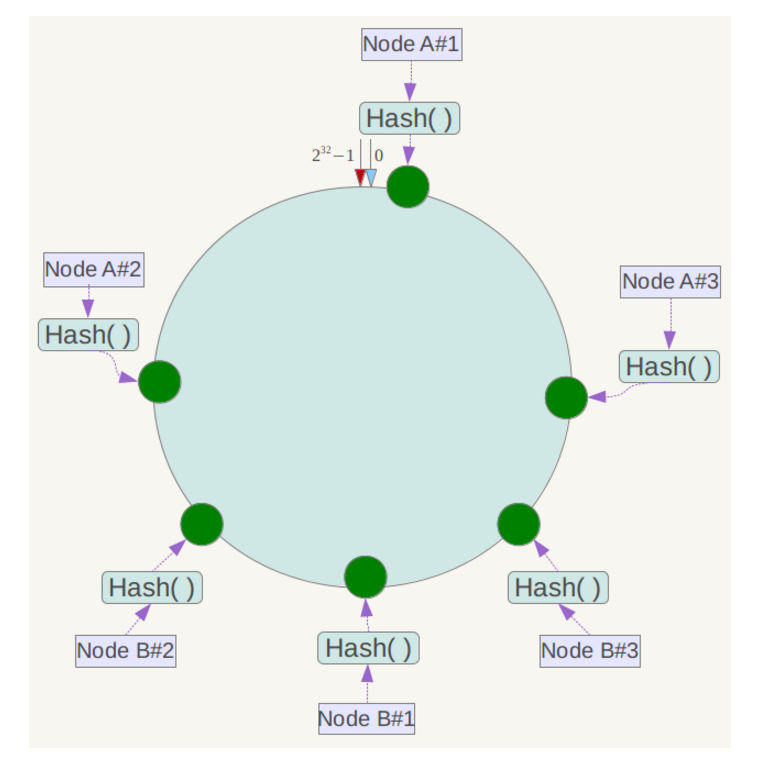

此时必然造成大量数据集中到Node A上,而只有极少量会定位到Node B上。为了解决这种数据倾斜问题,一致性哈希算法引入了虚拟节点机制,即对每一个服务节点计算多个哈希,每个计算结果位置都放置一个此服务节点,称为虚拟节点。具体做法可以在服务器ip或主机名的后面增加编号来实现。例如上面的情况,可以为每台服务器计算三个虚拟节点,于是可以分别计算 “Node A#1”、“Node A#2”、“Node A#3”、“Node B#1”、“Node B#2”、“Node B#3”的哈希值,于是形成六个虚拟节点:

同时数据定位算法不变,只是多了一步虚拟节点到实际节点的映射,例如定位到“Node A#1”、“Node A#2”、“Node A#3”三个虚拟节点的数据均定位到Node A上。这样就解决了服务节点少时数据倾斜的问题。在实际应用中,通常将虚拟节点数设置为32甚至更大,因此即使很少的服务节点也能做到相对均匀的数据分布。

算法实现:

package com.maozw.algorithm; import java.util.*; /**

* @author MAOZW 分隔符

* @Description: 带虚拟节点的一致性Hash算法

* @date 2018/11/22 16:30

*/

public class ConsistentHashWithNode { private static final String VIR_NODE_NAME_SEPARATOR = "@VirNode"; private static List<String> instanceInfo = new LinkedList<>(); /**

* 初始化虚拟节点 key表示服务器虚拟节点的hash值,value表示服务器虚拟节点的名称

*/

private static SortedMap<Integer, String> serverHashMap = new TreeMap<Integer, String>();

/**

* 设置每台服务器需要的虚拟节点

*/

private static final int VIRTUAL_NODES = 10; /**

* 构建hash环

* @param servers

*/

public ConsistentHashWithNode(String[] servers) {

//首先本地缓存一份实例信息

instanceInfo.addAll(Arrays.asList(servers));

instanceInfo.forEach(instance -> {

for (int i = 0; i < VIRTUAL_NODES; i++) {

//构建虚拟节点

String virNodeName = instance + VIR_NODE_NAME_SEPARATOR + String.valueOf(i);

serverHashMap.put(hash(virNodeName), virNodeName);

}

});

} public static void addNode(String servers) {

//首先本地缓存一份实例信息

instanceInfo.addAll(Arrays.asList(servers));

instanceInfo.forEach(instance -> {

for (int i = 0; i < VIRTUAL_NODES; i++) {

//构建虚拟节点

String virNodeName = instance + VIR_NODE_NAME_SEPARATOR + String.valueOf(i);

serverHashMap.put(hash(virNodeName), virNodeName);

}

});

} /**

* 根据数据获取真实存储服务节点

* @param data

* @return

*/

public static String getServer(String data) {

Integer firstKey;

SortedMap<Integer, String> subSortedMap = serverHashMap.tailMap(hash(data));

if (subSortedMap.isEmpty()){

firstKey = serverHashMap.firstKey();

}else

firstKey = subSortedMap.firstKey();

String virNodeName = serverHashMap.get(firstKey);

return virNodeName.substring(0, virNodeName.indexOf(VIR_NODE_NAME_SEPARATOR));

} /**

* FNV1_32_HASH 百度

* @param str

* @return

*/

public static int hash(String str) {

final int p = 16777619;

int hash = (int)2166136261L;

for (int i = 0; i < str.length(); i++) {

hash = (hash ^ str.charAt(i)) * p;

}

hash += hash << 13;

hash ^= hash >> 7;

hash += hash << 3;

hash ^= hash >> 17;

hash += hash << 5;

return Math.abs(hash);

} public static void main(String[] args) {

//构建服务器列表

String[] servers = {"192.168.1.0:098", "192.168.1.0:099", "192.168.1.0:100","192.168.1.0:111", "192.168.1.1:112", "192.168.1.2:113", "192.168.0.3:114", "192.168.0.4:115"};

new ConsistentHashWithNode(servers);

for (int i = 0; i < 100; i++) {

//动态增删节点

if(i%10 == 0){

addNode("192.168.0.5:" + String.valueOf(i));

}

System.out.println("data : " + i + ", hash " + hash(String.valueOf(i)) + " >>>>>>> " + getServer(String.valueOf(i)));

}

}

}

输出结果:

"C:\Program Files\Java\jdk1.8.0_121\bin\java" "-javaagent:C:\Program Files\JetBrains\IntelliJ IDEA 2017.2.4\lib\idea_rt.jar=56902:C:\Program Files\JetBrains\IntelliJ IDEA 2017.2.4\bin" -Dfile.encoding=UTF-8 -classpath "C:\Program Files\Java\jdk1.8.0_121\jre\lib\charsets.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\deploy.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\access-bridge-64.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\cldrdata.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\dnsns.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\jaccess.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\jfxrt.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\localedata.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\nashorn.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\sunec.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\sunjce_provider.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\sunmscapi.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\sunpkcs11.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\ext\zipfs.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\javaws.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\jce.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\jfr.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\jfxswt.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\jsse.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\management-agent.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\plugin.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\resources.jar;C:\Program Files\Java\jdk1.8.0_121\jre\lib\rt.jar;D:\data\baiduyun\creditnet-cloud-parent\base-agent\target\classes;D:\maven\maven_resource\javassist\javassist\3.12.1.GA\javassist-3.12.1.GA.jar;D:\maven\maven_resource\org\springframework\boot\spring-boot-starter-web\1.5.11.RELEASE\spring-boot-starter-web-1.5.11.RELEASE.jar;D:\maven\maven_resource\org\springframework\boot\spring-boot-starter\1.5.11.RELEASE\spring-boot-starter-1.5.11.RELEASE.jar;D:\maven\maven_resource\org\springframework\boot\spring-boot\1.5.11.RELEASE\spring-boot-1.5.11.RELEASE.jar;D:\maven\maven_resource\org\springframework\boot\spring-boot-autoconfigure\1.5.11.RELEASE\spring-boot-autoconfigure-1.5.11.RELEASE.jar;D:\maven\maven_resource\org\springframework\boot\spring-boot-starter-logging\1.5.11.RELEASE\spring-boot-starter-logging-1.5.11.RELEASE.jar;D:\maven\maven_resource\ch\qos\logback\logback-classic\1.1.11\logback-classic-1.1.11.jar;D:\maven\maven_resource\ch\qos\logback\logback-core\1.1.11\logback-core-1.1.11.jar;D:\maven\maven_resource\org\slf4j\slf4j-api\1.7.25\slf4j-api-1.7.25.jar;D:\maven\maven_resource\org\slf4j\jcl-over-slf4j\1.7.25\jcl-over-slf4j-1.7.25.jar;D:\maven\maven_resource\org\slf4j\jul-to-slf4j\1.7.25\jul-to-slf4j-1.7.25.jar;D:\maven\maven_resource\org\slf4j\log4j-over-slf4j\1.7.25\log4j-over-slf4j-1.7.25.jar;D:\maven\maven_resource\org\springframework\spring-core\4.3.15.RELEASE\spring-core-4.3.15.RELEASE.jar;D:\maven\maven_resource\org\yaml\snakeyaml\1.17\snakeyaml-1.17.jar;D:\maven\maven_resource\org\springframework\boot\spring-boot-starter-tomcat\1.5.11.RELEASE\spring-boot-starter-tomcat-1.5.11.RELEASE.jar;D:\maven\maven_resource\org\apache\tomcat\embed\tomcat-embed-core\8.5.29\tomcat-embed-core-8.5.29.jar;D:\maven\maven_resource\org\apache\tomcat\tomcat-annotations-api\8.5.29\tomcat-annotations-api-8.5.29.jar;D:\maven\maven_resource\org\apache\tomcat\embed\tomcat-embed-el\8.5.29\tomcat-embed-el-8.5.29.jar;D:\maven\maven_resource\org\apache\tomcat\embed\tomcat-embed-websocket\8.5.29\tomcat-embed-websocket-8.5.29.jar;D:\maven\maven_resource\org\hibernate\hibernate-validator\5.3.6.Final\hibernate-validator-5.3.6.Final.jar;D:\maven\maven_resource\javax\validation\validation-api\1.1.0.Final\validation-api-1.1.0.Final.jar;D:\maven\maven_resource\org\jboss\logging\jboss-logging\3.3.2.Final\jboss-logging-3.3.2.Final.jar;D:\maven\maven_resource\com\fasterxml\classmate\1.3.4\classmate-1.3.4.jar;D:\maven\maven_resource\com\fasterxml\jackson\core\jackson-databind\2.8.11.1\jackson-databind-2.8.11.1.jar;D:\maven\maven_resource\com\fasterxml\jackson\core\jackson-annotations\2.8.0\jackson-annotations-2.8.0.jar;D:\maven\maven_resource\com\fasterxml\jackson\core\jackson-core\2.8.11\jackson-core-2.8.11.jar;D:\maven\maven_resource\org\springframework\spring-web\4.3.15.RELEASE\spring-web-4.3.15.RELEASE.jar;D:\maven\maven_resource\org\springframework\spring-beans\4.3.15.RELEASE\spring-beans-4.3.15.RELEASE.jar;D:\maven\maven_resource\org\springframework\spring-context\4.3.15.RELEASE\spring-context-4.3.15.RELEASE.jar;D:\maven\maven_resource\org\springframework\spring-webmvc\4.3.15.RELEASE\spring-webmvc-4.3.15.RELEASE.jar;D:\maven\maven_resource\org\springframework\spring-expression\4.3.15.RELEASE\spring-expression-4.3.15.RELEASE.jar;D:\maven\maven_resource\org\springframework\boot\spring-boot-starter-aop\1.5.11.RELEASE\spring-boot-starter-aop-1.5.11.RELEASE.jar;D:\maven\maven_resource\org\springframework\spring-aop\4.3.15.RELEASE\spring-aop-4.3.15.RELEASE.jar;D:\maven\maven_resource\org\aspectj\aspectjweaver\1.8.13\aspectjweaver-1.8.13.jar;D:\maven\maven_resource\org\javassist\javassist\3.22.0-CR2\javassist-3.22.0-CR2.jar" com.maozw.algorithm.ConsistentHashWithNode

data : 0, hash 1360261864 >>>>>>> 192.168.0.4:115

data : 1, hash 1081142246 >>>>>>> 192.168.1.0:111

data : 2, hash 1310673766 >>>>>>> 192.168.1.0:111

data : 3, hash 895667540 >>>>>>> 192.168.1.0:098

data : 4, hash 1066967047 >>>>>>> 192.168.1.0:111

data : 5, hash 1039214538 >>>>>>> 192.168.1.0:111

data : 6, hash 853429834 >>>>>>> 192.168.1.0:111

data : 7, hash 679338660 >>>>>>> 192.168.1.1:112

data : 8, hash 570677376 >>>>>>> 192.168.0.4:115

data : 9, hash 1632757952 >>>>>>> 192.168.0.5:0

data : 10, hash 1740656752 >>>>>>> 192.168.1.0:098

data : 11, hash 2006937980 >>>>>>> 192.168.0.3:114

data : 12, hash 1796605027 >>>>>>> 192.168.1.2:113

data : 13, hash 1784583057 >>>>>>> 192.168.1.2:113

data : 14, hash 2038748830 >>>>>>> 192.168.0.3:114

data : 15, hash 2102931218 >>>>>>> 192.168.1.2:113

data : 16, hash 1773944215 >>>>>>> 192.168.1.2:113

data : 17, hash 1484764485 >>>>>>> 192.168.0.5:10

data : 18, hash 1806306984 >>>>>>> 192.168.0.3:114

data : 19, hash 1627633430 >>>>>>> 192.168.1.0:100

data : 20, hash 769227900 >>>>>>> 192.168.1.2:113

data : 21, hash 2093235260 >>>>>>> 192.168.0.5:20

data : 22, hash 965020188 >>>>>>> 192.168.1.0:098

data : 23, hash 1284791438 >>>>>>> 192.168.1.0:100

data : 24, hash 1624147572 >>>>>>> 192.168.1.0:100

data : 25, hash 1813276176 >>>>>>> 192.168.1.0:099

data : 26, hash 1240165918 >>>>>>> 192.168.1.0:100

data : 27, hash 1443113986 >>>>>>> 192.168.0.5:10

data : 28, hash 848195239 >>>>>>> 192.168.1.0:111

data : 29, hash 487229693 >>>>>>> 192.168.0.5:0

data : 30, hash 1179882046 >>>>>>> 192.168.0.5:20

data : 31, hash 687519996 >>>>>>> 192.168.1.1:112

data : 32, hash 1347314987 >>>>>>> 192.168.0.4:115

data : 33, hash 1252150144 >>>>>>> 192.168.0.5:30

data : 34, hash 1243961826 >>>>>>> 192.168.0.5:30

data : 35, hash 1331369343 >>>>>>> 192.168.0.4:115

data : 36, hash 382702589 >>>>>>> 192.168.1.0:111

data : 37, hash 1333159807 >>>>>>> 192.168.0.4:115

data : 38, hash 1629520602 >>>>>>> 192.168.1.0:100

data : 39, hash 600512651 >>>>>>> 192.168.0.4:115

data : 40, hash 595583100 >>>>>>> 192.168.0.4:115

data : 41, hash 879405290 >>>>>>> 192.168.0.5:20

data : 42, hash 1852330956 >>>>>>> 192.168.1.0:099

data : 43, hash 298372213 >>>>>>> 192.168.0.5:30

data : 44, hash 1200283293 >>>>>>> 192.168.0.5:10

data : 45, hash 1372130372 >>>>>>> 192.168.0.5:40

data : 46, hash 347117451 >>>>>>> 192.168.1.2:113

data : 47, hash 1882437695 >>>>>>> 192.168.1.2:113

data : 48, hash 999071944 >>>>>>> 192.168.1.0:111

data : 49, hash 365185474 >>>>>>> 192.168.1.2:113

data : 50, hash 817297870 >>>>>>> 192.168.1.2:113

data : 51, hash 1273490745 >>>>>>> 192.168.1.0:100

data : 52, hash 13188041 >>>>>>> 192.168.0.5:30

data : 53, hash 983610652 >>>>>>> 192.168.0.5:0

data : 54, hash 1433440743 >>>>>>> 192.168.0.5:10

data : 55, hash 675921773 >>>>>>> 192.168.0.5:50

data : 56, hash 2096618612 >>>>>>> 192.168.0.5:20

data : 57, hash 1242863439 >>>>>>> 192.168.0.5:30

data : 58, hash 506782701 >>>>>>> 192.168.0.5:0

data : 59, hash 1419244973 >>>>>>> 192.168.0.5:10

data : 60, hash 1671023507 >>>>>>> 192.168.1.1:112

data : 61, hash 1696027153 >>>>>>> 192.168.1.0:100

data : 62, hash 2023040435 >>>>>>> 192.168.0.3:114

data : 63, hash 806852734 >>>>>>> 192.168.0.5:60

data : 64, hash 1375292931 >>>>>>> 192.168.0.5:40

data : 65, hash 1167635221 >>>>>>> 192.168.1.2:113

data : 66, hash 1414244172 >>>>>>> 192.168.0.5:40

data : 67, hash 1665196834 >>>>>>> 192.168.1.0:111

data : 68, hash 1422126430 >>>>>>> 192.168.0.5:10

data : 69, hash 1758210714 >>>>>>> 192.168.0.5:40

data : 70, hash 852634916 >>>>>>> 192.168.1.0:111

data : 71, hash 659904949 >>>>>>> 192.168.0.4:115

data : 72, hash 2068039778 >>>>>>> 192.168.1.1:112

data : 73, hash 295785540 >>>>>>> 192.168.0.5:30

data : 74, hash 477451518 >>>>>>> 192.168.0.5:70

data : 75, hash 1128963530 >>>>>>> 192.168.0.5:0

data : 76, hash 436692773 >>>>>>> 192.168.0.5:70

data : 77, hash 2114685002 >>>>>>> 192.168.0.5:10

data : 78, hash 2037055164 >>>>>>> 192.168.0.3:114

data : 79, hash 305399288 >>>>>>> 192.168.0.5:30

data : 80, hash 637111365 >>>>>>> 192.168.1.0:100

data : 81, hash 824524375 >>>>>>> 192.168.1.2:113

data : 82, hash 219099783 >>>>>>> 192.168.0.5:20

data : 83, hash 698561011 >>>>>>> 192.168.1.1:112

data : 84, hash 838744949 >>>>>>> 192.168.1.2:113

data : 85, hash 494853706 >>>>>>> 192.168.0.5:0

data : 86, hash 828902150 >>>>>>> 192.168.1.2:113

data : 87, hash 392055866 >>>>>>> 192.168.0.5:50

data : 88, hash 439746725 >>>>>>> 192.168.0.5:70

data : 89, hash 336078296 >>>>>>> 192.168.0.5:30

data : 90, hash 524049458 >>>>>>> 192.168.0.5:10

data : 91, hash 1741707214 >>>>>>> 192.168.0.5:70

data : 92, hash 1432943238 >>>>>>> 192.168.0.5:80

data : 93, hash 544112048 >>>>>>> 192.168.0.5:90

data : 94, hash 253717288 >>>>>>> 192.168.0.5:20

data : 95, hash 82340904 >>>>>>> 192.168.1.0:099

data : 96, hash 1495879208 >>>>>>> 192.168.0.5:10

data : 97, hash 543491482 >>>>>>> 192.168.0.5:90

data : 98, hash 1024553895 >>>>>>> 192.168.0.5:50

data : 99, hash 1769578442 >>>>>>> 192.168.1.2:113 Process finished with exit code 0

一致性Hash 分析和实现的更多相关文章

- 【原】 twemproxy ketama一致性hash分析

转贴请注明原帖位置:http://www.cnblogs.com/basecn/p/4288456.html 测试Twemproxy集群,双主双活 向twemproxy集群做写操作时,发现key的分布 ...

- [转] twemproxy ketama一致性hash分析

评注:提到HAProxy业务层proxy, twemproxy存储的proxy. 其中还提到了ketama算法的实现源码 转自:http://www.cnblogs.com/basecn/p/4288 ...

- SOFA 源码分析 — 负载均衡和一致性 Hash

前言 SOFA 内置负载均衡,支持 5 种负载均衡算法,随机(默认算法),本地优先,轮询算法,一致性 hash,按权重负载轮询(不推荐,已被标注废弃). 一起看看他们的实现(重点还是一致性 hash) ...

- OpenStack_Swift源代码分析——Ring基本原理及一致性Hash算法

1.Ring的基本概念 Ring是swfit中最重要的组件.用于记录存储对象与物理位置之间的映射关系,当用户须要对Account.Container.Object操作时,就须要查询相应的Ring文件( ...

- 一致性hash算法详解

转载请说明出处:http://blog.csdn.net/cywosp/article/details/23397179 一致性哈希算法在1997年由麻省理工学院提出的一种分布式哈希(DHT) ...

- 分布式缓存技术memcached学习(四)—— 一致性hash算法原理

分布式一致性hash算法简介 当你看到“分布式一致性hash算法”这个词时,第一时间可能会问,什么是分布式,什么是一致性,hash又是什么.在分析分布式一致性hash算法原理之前,我们先来了解一下这几 ...

- 一致性 hash 算法( consistent hashing )a

一致性 hash 算法( consistent hashing ) 张亮 consistent hashing 算法早在 1997 年就在论文 Consistent hashing and rando ...

- memcache的一致性hash算法使用

一.概述 1.我们的memcache客户端(这里我看的spymemcache的源码),使用了一致性hash算法ketama进行数据存储节点的选择.与常规的hash算法思路不同,只是对我们要存储数据的k ...

- 【转载】一致性hash算法释义

http://www.cnblogs.com/haippy/archive/2011/12/10/2282943.html 一致性Hash算法背景 一致性哈希算法在1997年由麻省理工学院的Karge ...

随机推荐

- 使用Python基于OpenCV的验证码识别

Blog:https://blog.csdn.net/qq_40962368/article/details/89312429(Verification_Code_Identification) 步骤 ...

- 可能是把 Java 内存区域讲的最清楚的一篇文章

出处: 可能是把 Java 内存区域讲的最清楚的一篇文章 Java 内存区域详解 写在前面 (常见面试题) 基本问题 拓展问题 一 概述 二 运行时数据区域 2.1 程序计数器 2.2 Java 虚 ...

- python基础之函数当中的装饰器

在实际工作当中存在一个开放封闭原则 1.对扩展是开放的 为什么要对扩展开放呢? 我们说,任何一个程序,不可能在设计之初就已经想好了所有的功能并且未来不做任何更新和修改.所以我们必须允许代码扩展.添加新 ...

- Antdesign Form 实现页面控件的赋值加载

使用Antdesign Form时,当页面加载时,需要从后台获取数据,对Form中控件的默认赋值.看似比较简单的需求,而且Antdesign 官方文档中也有相应介绍,然后对于Form 的CheckBo ...

- 如何同步多个 git 远程仓库

请看 -> 如何同步多个 git 远程仓库

- 分布式的几件小事(三)dubbo的通信协议与序列化

1.dubbo的通信协议 ①dubbo协议 Dubbo缺省协议采用单一长连接和NIO异步通讯,适合于小数据量大并发的服务调用,以及服务消费者机器数远大于服务提供者机器数的情况. 特点 : dubbo缺 ...

- appium基础之简单的小例子

appium环境搭建了,当然也要开始用起来了,记录一下学习的过程 遇到问题 1.The permission to start '.ui.home.view.HomeActivity' activit ...

- springboot启动出错,

ssm框架 启动后报错 内容如下 [RMI TCP Connection(2)-127.0.0.1] WARN org.springframework.boot.context.embedded.An ...

- c++ 实时通信系统(c++socket篇)

在上一篇简单的介绍了TCP/IP协议,在这一篇我们主要介绍socket的具体实现的函数 第一步首先我们套添加上头文件:(#pragma comment(lib, "WS2_32") ...

- Nginx的软件架构

nginx原理架构图 Nginx是 master/worker 模型 一个master进程,可生成一个或多个worker进程,每个worker进程基于事件驱动机制响应客户端请求: 事件驱动机制:epo ...