kafka2.12 集群搭建

前提:

1、下载 kafka http://kafka.apache.org/downloads

2、下载配置zookeeper http://www.cnblogs.com/eggplantpro/p/7120893.html

3、服务器3台,我这边是5台

s1:10.211.55.16 zk&kafka zk是zookeeper

s2:10.211.55.17 zk

s3:10.211.55.18 zk

s4:10.211.55.19 kafka

s5:10.211.55.20 kafka

安装:

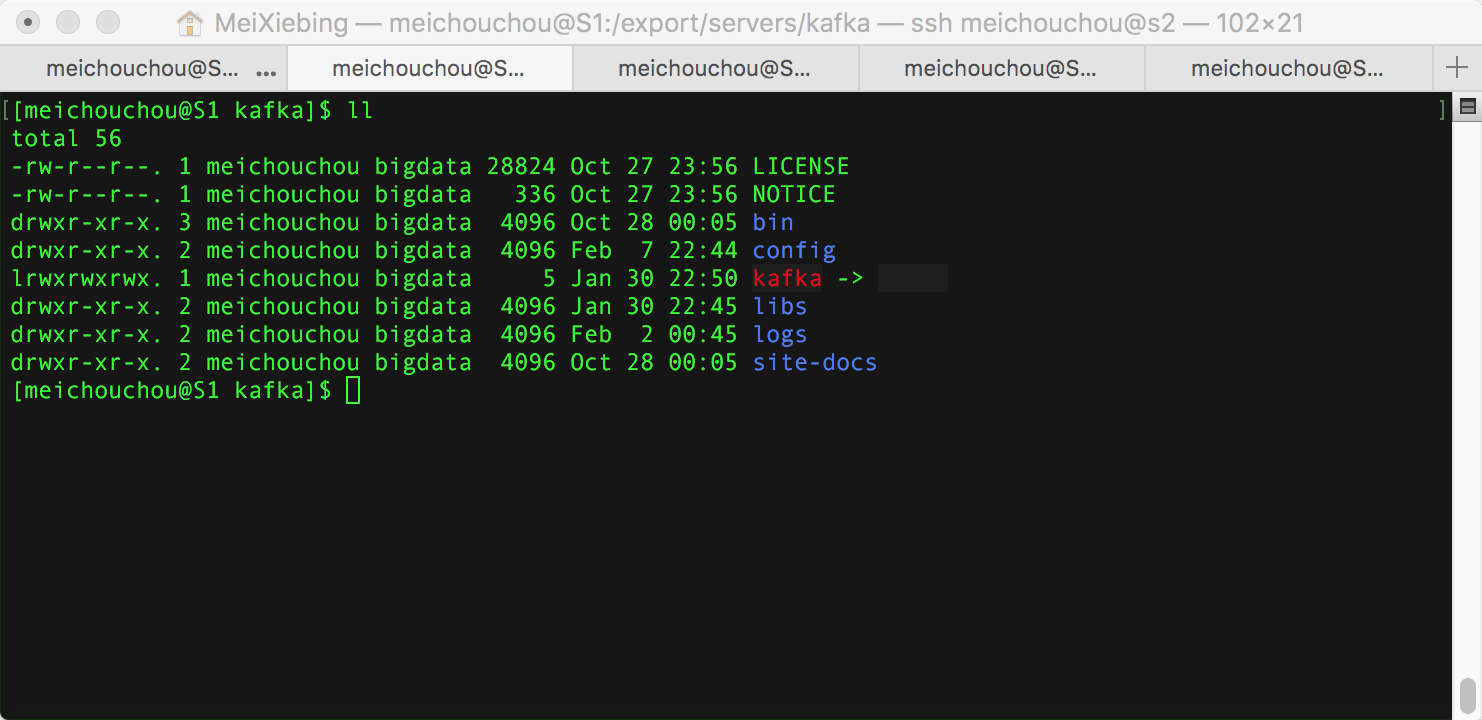

1、解压

结构如上,中规中矩的

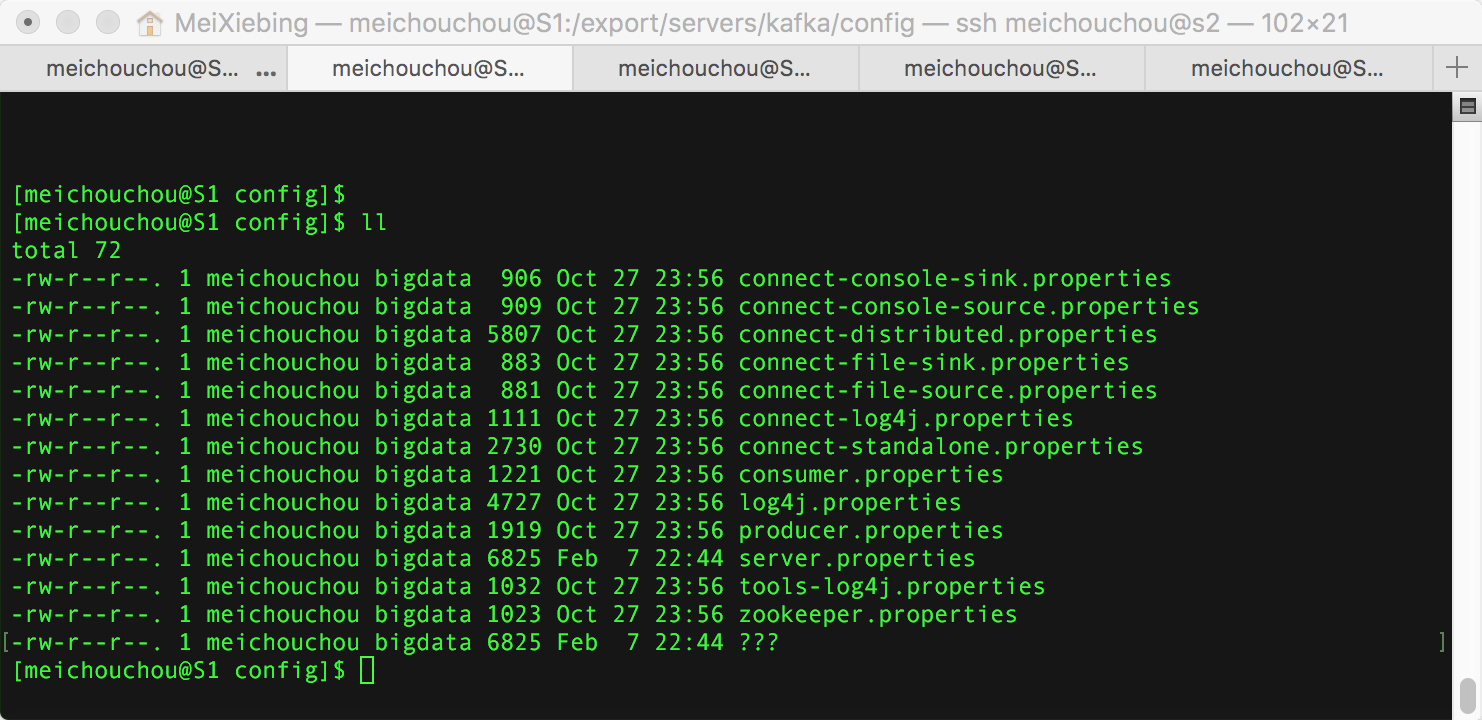

2、配置

cd config/

ls

其中server.properties kafka服务主要的配置

基本配置注意四个地方

第一个:

# The id of the broker. This must be set to a unique integer for each broker. broker.id=4 # 这个是broker 的id,必须和其它机器上的broker.id 不同 ,例如 s1中的 broker.id=0,s2中的 broker.id=1

第二个:

# The address the socket server listens on. It will get the value returned from # java.net.InetAddress.getCanonicalHostName() if not configured. # FORMAT: # listeners = listener_name://host_name:port # EXAMPLE: # listeners = PLAINTEXT://your.host.name:9092 listeners=PLAINTEXT://s1:9092 #s1 当前服务器的host 用ip 也一样。标识当前 kafka ip 和 端口

第三个:(可以不用配置,应该有默认的目录。建议配置一下):

# A comma seperated list of directories under which to store log files log.dirs=/export/servers/logs/kafka/kafka-logs #kafka 日志存放目录

第四个:

############################# Zookeeper ############################# # Zookeeper connection string (see zookeeper docs for details). # This is a comma separated host:port pairs, each corresponding to a zk # server. e.g. "127.0.0.1:3000,127.0.0.1:3001,127.0.0.1:3002". # You can also append an optional chroot string to the urls to specify the # root directory for all kafka znodes. zookeeper.connect=s1:2181,s2:2181,s3:2181 #配置zk的地址和ip kafka通过 zk 保持通信

3、启动:

kafka-server-start.sh ../config/server.properties #启动的时候注意看错误 jps 看到 Kafka 就表示服务已经启动了,

[meichouchou@S1 ~]$ jps

4199 Kafka

3735 QuorumPeerMain

8121 Jps

kafka2.12 集群搭建的更多相关文章

- kafka2.10集群搭建(一)

一.kafka集群搭建 1.上传解压 2.配置文件的配置 1.修改 server.properties文件 broker.id=11 #192.168.199.11 #21 一般使用ip后三位 lis ...

- kafka2.3集群搭建

环境: 3台centos7.4 3台zookeeper3.4.14 1. wget http://mirror.bit.edu.cn/apache/kafka/2.3.0/kafka_2.11-2.3 ...

- Debian下Hadoop 3.12 集群搭建

Debian系统配置 我这里在Vmware里面虚拟4个Debian系统,一个master,三个solver.hostname分别是master.solver1.solver2.solver3.对了,下 ...

- Ubuntu 12.04下Hadoop 2.2.0 集群搭建(原创)

现在大家可以跟我一起来实现Ubuntu 12.04下Hadoop 2.2.0 集群搭建,在这里我使用了两台服务器,一台作为master即namenode主机,另一台作为slave即datanode主机 ...

- Kafka+Zookeeper集群搭建

上次介绍了ES集群搭建的方法,希望能帮助大家,这儿我再接着介绍kafka集群,接着上次搭建的效果. 首先我们来简单了解下什么是kafka和zookeeper? Apache kafka 是一个分布式的 ...

- 【Data Cluster】真机环境下MySQL数据库集群搭建

真机环境下MySQL-Cluster搭建文档 摘要:本年伊始阶段,由于实验室对不同数据库性能测试需求,才出现MySQL集群搭建.购置主机,交换机,双绞线等一系列准备工作就绪,也就开始集群搭建.起初笔 ...

- (四)Spark集群搭建-Java&Python版Spark

Spark集群搭建 视频教程 1.优酷 2.YouTube 安装scala环境 下载地址http://www.scala-lang.org/download/ 上传scala-2.10.5.tgz到m ...

- (三)Spark-Hadoop集群搭建-Java&Python版Spark

Spark-Hadoop集群搭建 视频教程: 1.优酷 2.YouTube 配置java 启动ftp [root@master ~]# /etc/init.d/vsftpd restart 关闭 vs ...

- kafka集群搭建和使用Java写kafka生产者消费者

1 kafka集群搭建 1.zookeeper集群 搭建在110, 111,112 2.kafka使用3个节点110, 111,112 修改配置文件config/server.properties ...

随机推荐

- 【Linux】一步一步学Linux——Linux系统常用快捷键(12) 待更新...

目录 00. 目录 01. Gnome下的快捷键 02. 其它 03. 参考 00. 目录 @ 参考博客:https://blog.csdn.net/dengjin20104042056/articl ...

- Shiro集成SSM基于动态URL权限管理(二)

这个案例基于上一个demo扩展而来.所以数据库表,在Shiro集成SSM基于URL权限管理(一)开篇的一致.如果上个demo操作的建议重新导入一次,避免出现问题. 而这次都不是通过固定写在方法上的注解 ...

- helm chart应用使用示例

有两种方法 一是按照正常流程直接用yaml文件的形式发布应用到k8s集群上 二是把生成好的yaml文件发布到kubeapps应用商店,在应用商店中操作发布应用到k8s集群中 这里采用第二种方式的变种方 ...

- 数据结构与算法(周测7-拓扑排序和AOV网络)

判断题 1.AOE图的关键路径就是最长的路径 T F 2.AOE图的权值最大的边(活动)一定是关键活动. T F 两条边相加可能比最大的边还要大. 3.在AOE ...

- canvas上画出坐标集合,并标记新坐标,背景支持放大缩小拖动功能

写在前面:项目需求,用户上传一个区位的平面图片,用户可以在图片上添加新的相机位置,并且展示之前已绑定的相机坐标位置,图片支持放大缩小&拖动的功能.新增坐标,页面展示相对canvas定位,保存时 ...

- 采集15个代理IP网站,打造免费代理IP池

采集的站点: 免费代理IP http://ip.yqie.com/ipproxy.htm66免费代理网 http://www.66ip.cn/89免费代理 http://www.89ip.cn/无忧代 ...

- Winmanager,NERDTree和MiniBufExplorer

NERDTree树形浏览文件 MiniBufExplorer多文件同时编辑 Winmanager将NERDTree和MiniBufExplorer界面整合 下载 http://www.vim.org/ ...

- Android笔记(六十二)网络框架volley

什么是Volley 很多时候,我们的APP都需要用到网络技术,使用HTTP协议来发送接收数据,谷歌推出了一个网络框架——volley,该框架适合进行数据量不大,但通信频繁的网络操作. 它的优点: (1 ...

- 【CMDB】获取服务器数据

一.通过agent的方式 原理:服务器定制执行py文件通过subprocess模块采集数据发送给数据收集的机器 数据收集的机器:192.168.11.62 服务器:192.168.11.169 数据收 ...

- 45 个常用Linux 命令,让你轻松玩转Linux!

Linux 的命令确实非常多,然而熟悉 Linux 的人从来不会因为 Linux 的命令太多而烦恼.因为我们仅仅只需要掌握常用命令,就完全可以驾驭 Linux. 接下来,让我们一起来看看都有那些常用的 ...