Batch Normalization 引出的一系列问题

Batch Normalization,拆开来看,第一个单词意思是批,出现在梯度下降的概念里,第二个单词意思是标准化,出现在数据预处理的概念里。

我们先来看看这两个概念。

数据预处理

方法很多,后面我会在其他博客中专门讲,这里简单回忆下

归一化,x-min/max-min,

标准化,包括标准差标准化,x-mean/std,极差标准化,x-mean/(max-min),

中心化,x-mean,

白化,pac-->归一化

梯度下降

梯度下降中 mini batch sgd 是比 sgd 更好的一种方法,因为min batch是平均梯度,使得梯度更平稳,容易收敛,而且batch能够并行计算,减少运算。

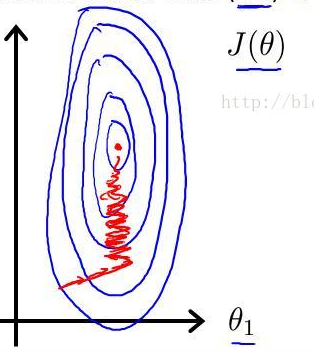

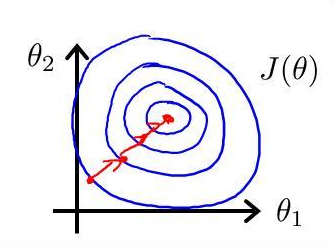

我们知道,在机器学习中,梯度下降是要归一化的,因为如果不归一化,y在各个维度上的量纲不一样,使得y的图形不规则,扁平或者瘦高,这样在求梯度时经常会歪歪曲曲,一般会陷入局部最优。

图示如下

神经网络也是用的梯度下降,从这点来看,也是需要数据预处理的。

独立同分布 IID

在机器学习中有这个概念,意思是训练数据和测试数据需要服从同样的分布,这样才有意义,很好理解。

但是在深度学习中,训练和测试都是图片(cnn为例,图片为例),似乎不牵扯IID。

那这根batch normalization 有什么关系呢?

因为在神经网络中有层的概念,每一层都有输入,每一层的输入是上一层的输出,而输出是经过非线性函数的,非线性函数的取值都有特定的区间,这就和原始的输入在数据分布上存在很大不同,

此时需要用一定的方法统一数据分布。

神经网络的训练问题

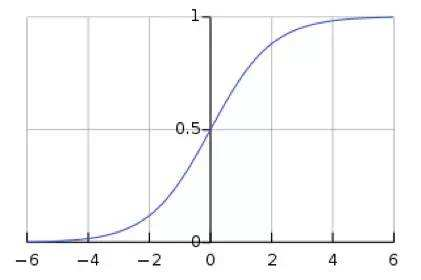

神经网络层数越深,越是难以训练,收敛速度越来越慢,为什么呢?下面我以sigmoid函数为例简要说明。(后面我会专门写一篇激活函数的博客,详细阐述)

在数学建模时一般会要求样本服从正态分布,正态分布标准化后就是标准正态分布。图像如下

可以看到标准正态分布95%的概率落在 [-2, 2] 之间

sigmoid 函数的特点是在绝大多数x上(除了-2到2的区间)取值要么无限接近于1,要么无限接近于0,而且,这种情况下其梯度无限接近于0,这就是神经网络梯度消息的本质,这也是sigmoid函数很难作为深度神经网络的激活函数的原因。

而 batch normalization 的作用是把x规范到0附近,此时其梯度很大,收敛很快。

scale and shift

batch normalization 虽然增加了梯度,但是同时我们发现,当x在0附近时,其函数非常接近于线性,这大大降低了模型的表达能力。

为了解决这个问题,作者又提出了 scale and shift,即y=scale*x+shift,这相当于是把数据从0向左或向右平移了一段并拉伸或压缩,使得y处于线性和非线性的交界处,这样既保证了较大的梯度,也保留了模型的非线性表达能力。

scale 和 shift 通过训练学习到。

到这基本就讲完 batch normalization 的原理了,下面看看具体怎么使用。

使用方法

之前讲到batch normalization使得神经网络每一层的输入变得规范,也就是说它是把 wx+b 变得规范,即用在线性变换之后,非线性变换之前。如图

总体计算方法如下

这里在标准化时分母加了个ε,是防止分母为0。

总结

batch normalization的优点

1. 提高神经网络的训练效率,避免梯度消失

2. 使得神经网络不依赖于初始值,方便调参

3. 抑制过拟合,降低dropout的使用,提高泛化能力

batch normalization的缺点

1. batch normalization 仍然有很多地方科学理论无法解释

2. batch大小对其效果影响很大,batch 很小时,其梯度不够稳定,收敛变慢,极端情况就是 sgd

参考资料:

https://www.cnblogs.com/guoyaohua/p/8724433.html

https://www.zhihu.com/question/38102762

https://blog.csdn.net/whitesilence/article/details/75667002

https://blog.csdn.net/liangjiubujiu/article/details/80977502

Batch Normalization 引出的一系列问题的更多相关文章

- 神经网络之 Batch Normalization

知乎 csdn Batch Normalization 学习笔记 原文地址:http://blog.csdn.net/hjimce/article/details/50866313 作者:hjimce ...

- 图像分类(二)GoogLenet Inception_v2:Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift

Inception V2网络中的代表是加入了BN(Batch Normalization)层,并且使用 2个 3*3卷积替代 1个5*5卷积的改进版,如下图所示: 其特点如下: 学习VGG用2个 3* ...

- 转载-通俗理解BN(Batch Normalization)

转自:参数优化方法 1. 深度学习流程简介 1)一次性设置(One time setup) -激活函数(Activation functions) - 数据预处理(Data Prep ...

- 《RECURRENT BATCH NORMALIZATION》

原文链接 https://arxiv.org/pdf/1603.09025.pdf Covariate 协变量:在实验的设计中,协变量是一个独立变量(解释变量),不为实验者所操纵,但仍影响实验结果. ...

- 【转载】 详解BN(Batch Normalization)算法

原文地址: http://blog.csdn.net/hjimce/article/details/50866313 作者:hjimce ------------------------------- ...

- Tensorflow BatchNormalization详解:4_使用tf.nn.batch_normalization函数实现Batch Normalization操作

使用tf.nn.batch_normalization函数实现Batch Normalization操作 觉得有用的话,欢迎一起讨论相互学习~Follow Me 参考文献 吴恩达deeplearnin ...

- Batch Normalization 详解

一.背景意义 本篇博文主要讲解2015年深度学习领域,非常值得学习的一篇文献:<Batch Normalization: Accelerating Deep Network Training b ...

- Batch Normalization详解

目录 动机 单层视角 多层视角 什么是Batch Normalization Batch Normalization的反向传播 Batch Normalization的预测阶段 Batch Norma ...

- 深度学习(二十九)Batch Normalization 学习笔记

Batch Normalization 学习笔记 原文地址:http://blog.csdn.net/hjimce/article/details/50866313 作者:hjimce 一.背景意义 ...

随机推荐

- 安卓四大组件之Sevice组件的简单使用 --Android基础

1.本例实现了简单的Service(服务)的创建.启动和停止,点击“启动SERVICE”页面会显示“服务被创建”,接着是“服务被启动”.点击“停止SERVICE”页面提示“服务被停止”.太过基础,直接 ...

- webpack添加热更新

之前的wbepack一直没有加上热更新,这是一种遗憾,今天终于加上去了,看不懂我博客的可以看这篇文章:http://blog.csdn.net/hyy1115/article/details/5302 ...

- 0.11内核rd_load@ramdisk.c中memcpy函数好像有bug

0.11内核rd_load@ramdisk.c中memcpy函数好像有bug,如:#define memcpy(dst,src,n) \ __asm__("cld;rep;movsl& ...

- Django 的 orm 查询

一.模型关系表 1. 一对一 Author-AuthorDetail 关联字段可以在任意表下,但必须唯一约束.(unique约束) ad_id(unique约束) ad = models.oneToO ...

- 『计算机视觉』Mask-RCNN_推断网络其五:目标检测结果精炼

一.Detections网络 经过了ROI网络,我们已经获取了全部推荐区域的信息,包含: 推荐区域特征(ROIAlign得到) 推荐区域类别 推荐区域坐标修正项(deltas) 再加上推荐区域原始坐标 ...

- 关于react16.4——上下文Context

首先我们来聊一聊(上下文)Context. 上下文(Context) 提供了一种通过组件树传递数据的方法,无需在每个级别手动传递 props 属性. 在典型的 React 应用程序中,数据通过 pro ...

- mysql创建存储过程,批量建表分表00到99

这里以sqlyong为软件示例: --创建存储过程DELIMITER $$ CREATE PROCEDURE `createTablesWithIndex`() BEGIN DECLARE `@i` ...

- SpringMVC,Controller的返回页面类型以及路径设置默认值

一般设置在spring-servlet.xml里面设置 <!-- 对转向页面的路径解析.prefix:前缀, suffix:后缀 --> <bean class="org. ...

- js时间与时间戳互相转换

var _time1 = Date.parse(new Date(‘2017-05-02 00:00:00’))/1000; //将设定的日期转换为时间戳 _time1 = getLocalTime( ...

- MongoDB文档的基本操作

1. MongoDB的安装方法 (1)下载MongoDB 相应的版本: (2)设置数据文件和日志文件的存放目录: (3)启动MongoDB服务: (4)将MongoDB作为服务启动. 2. Mongo ...