Spark读取文件

spark默认读取的是hdfs上的文件。

如果读取本地文件,则需要加file:///usr/local/spark/README.md。 (测试时候发现,本地文件必须在spark的安装路径内部或者平行)

读取hdfs文件, 可以这样指定路径 hdfs://ns1/tmp/test.txt。

如果不指定任何前缀,则使用hdfs的默认路径/user/data/

启动spark-shell:

由于已经在spark-defaults.conf中指定了spark.master,所以启动时默认以standalone模式加载

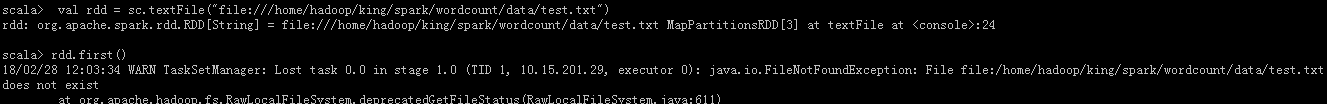

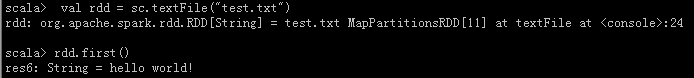

1. 读取本地文件:

spark安装路径下/usr/local/spark/README.md

然鹅使用其他路径 /home/hadoop/king/spark/wordcount/data/test.txt

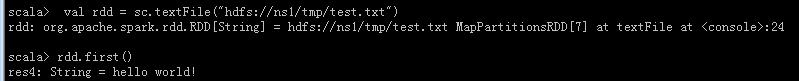

2. 读取hdfs文件

hdfs://ns1/tmp/test.txt

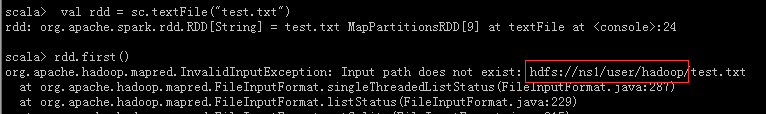

3. 不加任何前缀

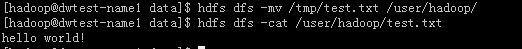

默认识别的hadoop用户的目录,将刚才的test.txt拷贝到目录:hdfs://ns1/user/hadoop/

再次读取:

在实际的使用中推荐使用第二种方式处理数据。

Spark读取文件的更多相关文章

- 【原创】大数据基础之Spark(7)spark读取文件split过程(即RDD分区数量)

spark 2.1.1 spark初始化rdd的时候,需要读取文件,通常是hdfs文件,在读文件的时候可以指定最小partition数量,这里只是建议的数量,实际可能比这个要大(比如文件特别多或者特别 ...

- spark读取文件机制 源码剖析

Spark数据分区调研 Spark以textFile方式读取文件源码 textFile方法位于 spark-core_2.11/org.apache.spark.api.java/JavaSparkC ...

- SparkHiveContext和直接Spark读取hdfs上文件然后再分析效果区别

最近用spark在集群上验证一个算法的问题,数据量大概是一天P级的,使用hiveContext查询之后再调用算法进行读取效果很慢,大概需要二十多个小时,一个查询将近半个小时,代码大概如下: try: ...

- spark读取本地文件

/** * Read a text file from HDFS, a local file system (available on all nodes), or any * Hadoop-supp ...

- Spark读取HDFS中的Zip文件

1. 任务背景 近日有个项目任务,要求读取压缩在Zip中的百科HTML文件,经分析发现,提供的Zip文件有如下特点(=>指代对应解决方案): (1) 压缩为分卷文件 => 只需将解压缩在同 ...

- 大数据学习day20-----spark03-----RDD编程实战案例(1 计算订单分类成交金额,2 将订单信息关联分类信息,并将这些数据存入Hbase中,3 使用Spark读取日志文件,根据Ip地址,查询地址对应的位置信息

1 RDD编程实战案例一 数据样例 字段说明: 其中cid中1代表手机,2代表家具,3代表服装 1.1 计算订单分类成交金额 需求:在给定的订单数据,根据订单的分类ID进行聚合,然后管理订单分类名称, ...

- HTML5 file api读取文件的MD5码工具

1.工具的用途:用HTML5 file api读取文件的MD5码.MD5码在文件的唯一性识别上有很重要的应用,业内常用MD5进行文件识别.文件秒传.文件安全性检查等: 2.适用性:IE.Chrome皆 ...

- 关于spark写入文件至文件系统并制定文件名之自定义outputFormat

引言: spark项目中通常我们需要将我们处理之后数据保存到文件中,比如将处理之后的RDD保存到hdfs上指定的目录中,亦或是保存在本地 spark保存文件: 1.rdd.saveAsTextFile ...

- Spark 保存文件 自定义分隔符

Spark 保存文件 调整分隔符 废话 找了半天没找到,在某个地方看到了类似的(文中说的是读取的时候指定),试了一下保存,发现也好用,详细如下. 用法 df.write.option("de ...

随机推荐

- 【LeetCode】24. Swap Nodes in Pairs (3 solutions)

Swap Nodes in Pairs Given a linked list, swap every two adjacent nodes and return its head. For exam ...

- 【LeetCode】115. Populating Next Right Pointers in Each Node (2 solutions)

Populating Next Right Pointers in Each Node Given a binary tree struct TreeLinkNode { TreeLinkNode * ...

- android自动弹出软键盘(输入键盘)

很多应用中对于一个界面比如进入搜索界面或者修改信息等等情况,为了用户体验应该自动弹出软键盘而不是让用户主动点击输入框才弹出(因为用户进入该界面必然是为了更改信息).具体实现这种效果如下: [代 ...

- nodejs request gb2312乱码的问题

http://www.cnblogs.com/linka/p/6658055.html https://cnodejs.org/topic/53142ef833dbcb076d007230 // np ...

- <图形图像,动画,多媒体> 读书笔记 --- AirPlay

AirPlay技术是之前一直没有接触过的技术,正好这次做一个笔记 共用: 1.能够通过AirPlay将iOS和MAC设备上的视频或音频输出到高清电视上或高保真音响 2.能够通过AirPlay将iOS和 ...

- Spring 一二事(10) - annotation AOP

先贴出POM的内容,这个毕竟是用的maven来简单构建的 <project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:x ...

- Synplify9.6.2破解(转帖)

Synplify9.6.2破解(转帖) 转载自:http://www.cnblogs.com/mark-sun/archive/2012/02/26/2368773.html Abstract本文 ...

- spring bean autowire自动装配

转自:http://blog.csdn.net/xiao_jun_0820/article/details/7233139 autowire="byName"会自动装配属性与Bea ...

- .NET url 的编码与解码

举例: aaa.aspx?tag=.net%bc%bc%ca%f5 aaa.aspx?tag=.net%e6%8a%80%e6%9c%af看起来好像是不一样,其实他们都是对".net技术&q ...

- 详解设计模式在Spring中的应用---转载

Spring作为业界的经典框架,无论是在架构设计方面,还是在代码编写方面,都堪称行内典范.好了,话不多说,开始今天的内容. spring中常用的设计模式达到九种,我们一一举例: 第一种:简单工厂 又叫 ...